Clear Sky Science · fr

Modèle fondamental vidéo auto-supervisé à grande échelle pour la chirurgie intelligente

Une aide plus intelligente au bloc opératoire

Les chirurgiens modernes s’appuient de plus en plus sur des caméras et des ordinateurs pour guider leur travail, mais l’intelligence artificielle actuelle peine encore à comprendre pleinement ce qui se passe pendant une opération. Cet article présente une nouvelle méthode d’entraînement d’IA sur des milliers de vidéos chirurgicales afin qu’elle suive mieux les étapes d’une procédure, reconnaisse les instruments et les tissus, et évalue la sécurité et la qualité de l’intervention. À long terme, ce type de technologie pourrait assister les chirurgiens en temps réel, améliorer la formation et contribuer à rendre la chirurgie plus sûre pour les patients.

Pourquoi il est difficile d’apprendre la chirurgie aux machines

Apprendre la chirurgie aux ordinateurs n’est pas aussi simple que leur fournir quelques images étiquetées. Chaque procédure implique des caméras mobiles, des changements de point de vue, de la fumée, du sang, et des mains et des outils qui se masquent constamment les uns les autres. À cela s’ajoutent des milliers de types d’opérations différents, dont beaucoup sont rares. L’annotation minutieuse des vidéos image par image demande du temps d’expert, une ressource rare, et devient vite trop coûteuse. Les systèmes IA précédents ont tenté d’alléger ce fardeau avec des astuces qui apprennent à partir d’images non étiquetées, mais ils considéraient principalement des images fixes et n’ont ajouté le facteur temporel que plus tard. En conséquence, ils manquaient souvent de saisir le déroulement d’une opération : ce qui s’est passé avant, ce qui se passe maintenant et ce qui est susceptible d’arriver ensuite.

Apprendre directement à partir de films chirurgicaux

Les auteurs soutiennent qu’une IA destinée à assister la chirurgie devrait être entraînée sur des vidéos plutôt que sur des images isolées. Pour cela, ils ont rassemblé l’une des plus grandes collections de vidéos d’endoscopie à ce jour : 3 650 enregistrements représentant 3,55 millions d’images, issus de jeux de données de recherche publics et d’une large sélection de contenus chirurgicaux en ligne. Ces vidéos couvrent plus de 20 types de procédures et plus de 10 régions anatomiques, de l’ablation de la vésicule biliaire à la chirurgie du foie en passant par des interventions gynécologiques. Cette diversité permet à l’IA de voir de nombreuses façons dont une procédure peut apparaître dans la réalité, incluant différents hôpitaux, outils et styles de caméra.

Un nouveau plan d’apprentissage centré sur la vidéo

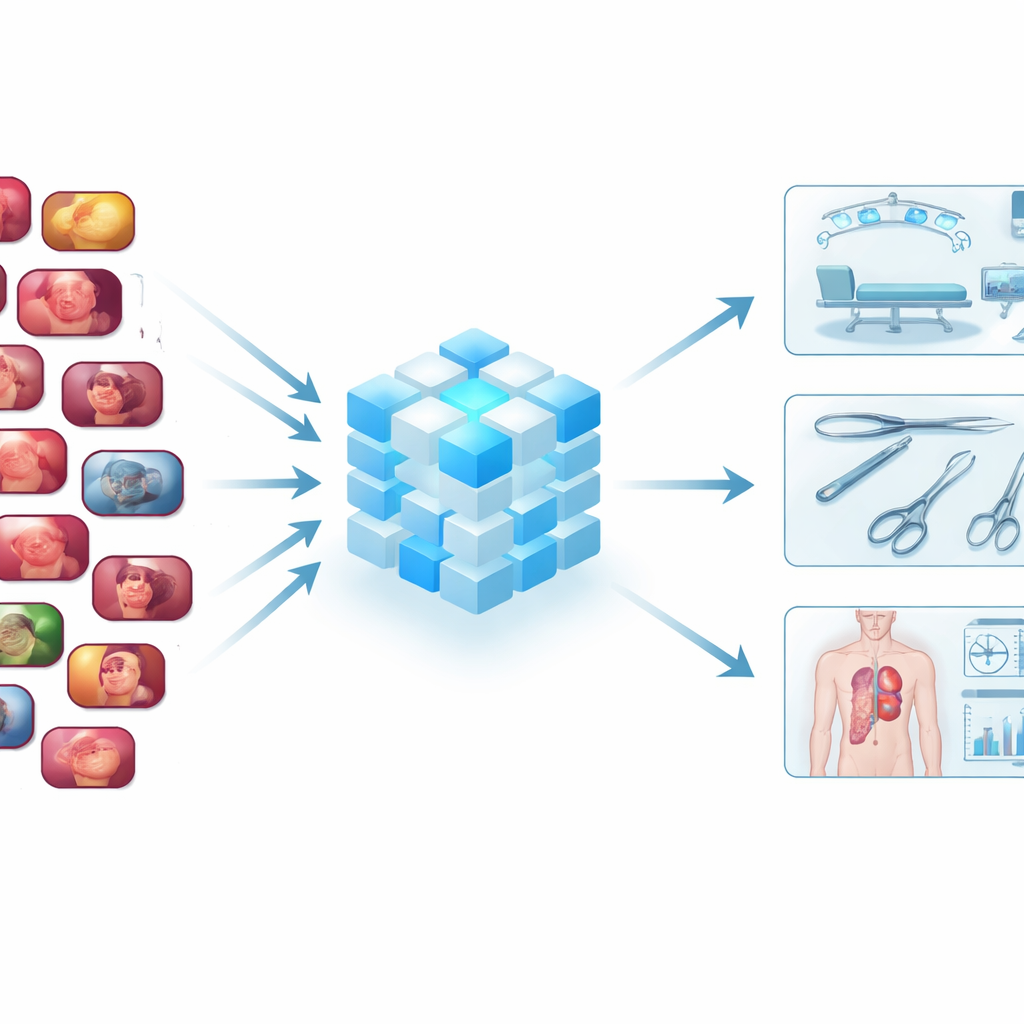

À partir de ce trésor de données, l’équipe a conçu SurgVISTA, un « modèle fondamental » spécifiquement adapté aux vidéos chirurgicales. Plutôt que d’essayer d’étiqueter chaque image, SurgVISTA apprend en reconstituant ce qui manque. Pendant l’entraînement, des parties de chaque clip vidéo sont masquées et le modèle doit reconstruire les régions manquantes. Cela l’oblige à prêter attention à la façon dont les tissus, les instruments et les mouvements évoluent dans le temps. En parallèle, une seconde branche du système est entraînée à faire correspondre les indices visuels détaillés capturés par un modèle expert basé sur l’image, déjà très performant pour reconnaître les scènes chirurgicales. Cette combinaison aide SurgVISTA à saisir à la fois les détails fins de chaque image et le flux global de l’intervention, le tout au sein d’un seul réseau unifié.

Mettre le modèle à l’épreuve

Pour vérifier l’efficacité de cette approche, les auteurs ont testé SurgVISTA sur 13 jeux de données différents couvrant six types de chirurgie et quatre tâches pratiques. Ces tâches comprenaient la reconnaissance de la phase opératoire en cours, l’identification d’actions chirurgicales spécifiques, la capture de la relation tripartite entre instrument, action et tissu cible, et l’évaluation de la sécurité d’exécution d’étapes clés. Dans l’ensemble, SurgVISTA a surpassé les modèles de pointe entraînés sur des vidéos grand public, ainsi que les meilleurs systèmes spécialisés en chirurgie basés principalement sur des images fixes. Il a bien performé même sur des procédures qu’il n’avait jamais vues pendant l’entraînement, montrant que les schémas appris ne sont pas liés à un organe, un ensemble d’outils ou un hôpital en particulier.

Pourquoi plus de données vidéo et plus variées comptent

L’étude a également exploré comment les performances évoluaient à mesure que le volume de données d’entraînement augmentait. Au fur et à mesure que les auteurs élargissaient la taille et la diversité du corpus vidéo, les résultats de SurgVISTA s’amélioraient presque partout, y compris sur des procédures absentes du jeu d’entraînement. Fait intéressant, le modèle a tiré profit non seulement d’un plus grand nombre d’exemples d’une même opération, mais aussi de différents types de chirurgies : l’exposition à des « récits » chirurgicaux variés l’aidait à repérer des motifs visuels et de mouvement généraux transférables entre spécialités. Des expériences supplémentaires ont montré que l’apport du modèle expert basé sur l’image affinait encore la capacité du modèle à préserver les détails anatomiques fins, indispensable pour distinguer, par exemple, une structure vitale du tissu environnant.

Ce que cela signifie pour la chirurgie de demain

Concrètement, ce travail montre qu’une IA entraînée sur de grandes quantités de vidéos chirurgicales réelles, prenant en compte l’espace et le temps, peut développer une compréhension beaucoup plus profonde de ce qui se passe au bloc opératoire. SurgVISTA n’est pas encore un outil qui prend des décisions de manière autonome, mais il fournit une base puissante à laquelle d’autres applications peuvent se raccorder — qu’il s’agisse de suivre la progression chirurgicale, de signaler des moments à risque, de soutenir la formation ou de comparer des techniques entre établissements. Les auteurs notent que des jeux de données plus larges et des essais cliniques restent nécessaires, mais leurs résultats suggèrent que les modèles fondamentaux basés sur la vidéo pourraient devenir un ingrédient clé des futurs systèmes chirurgicaux intelligents visant à rendre les interventions plus sûres, plus cohérentes et mieux adaptées à chaque patient.

Citation: Yang, S., Zhou, F., Mayer, L. et al. Large-scale self-supervised video foundation model for intelligent surgery. npj Digit. Med. 9, 220 (2026). https://doi.org/10.1038/s41746-026-02403-0

Mots-clés: IA vidéo chirurgicale, apprentissage auto-supervisé, flux opératoire, chirurgie assistée par ordinateur, modélisation spatiotemporelle