Clear Sky Science · fr

Collaboration humain–grands modèles de langage en médecine clinique : revue systématique et méta-analyse

Pourquoi cela compte pour les soins quotidiens

Les médecins se tournent de plus en plus vers des chatbots d’IA puissants, appelés grands modèles de langage, pour les aider à analyser des cas complexes, rédiger des notes et interpréter des examens médicaux. Cette étude pose une question simple mais cruciale : lorsque les médecins s’associent à ces outils, les patients en tirent‑ils vraiment bénéfice ? En rassemblant les résultats des meilleurs essais disponibles, les auteurs montrent que la réponse est plus nuancée que ne le suggère le battage médiatique — parfois le partenariat aide, parfois il n’apporte que peu, et dans quelques situations il peut même gêner.

Ce que les chercheurs ont examiné

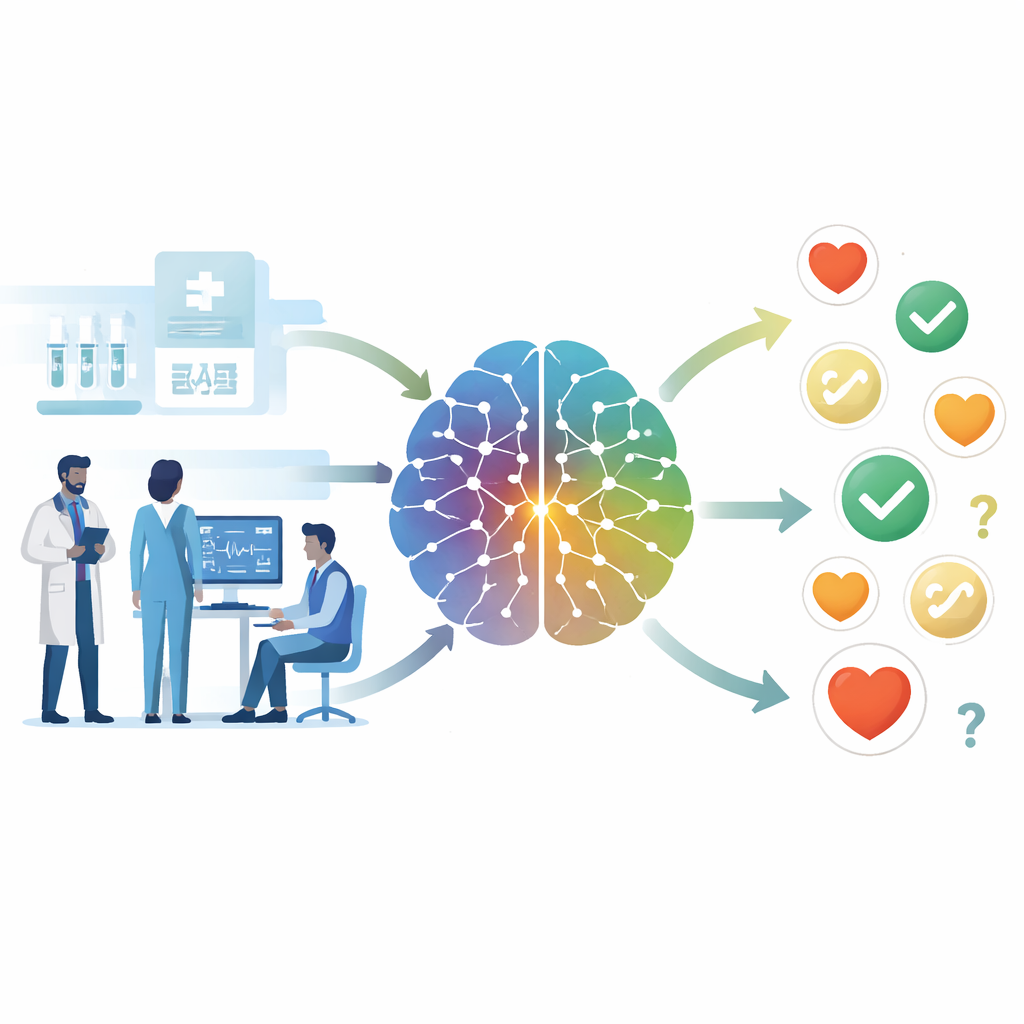

L’équipe a effectué une recherche systématique dans les principales bases de données médicales pour trouver des études où des cliniciens travaillaient avec ou sans l’aide d’un système d’IA basé sur des grands modèles de langage tels que GPT‑4. Pour être incluse, une étude devait confronter directement un flux de travail « médecin + IA » aux soins habituels dispensés par des médecins seuls, et parfois aussi à l’IA opérant seule. Les tâches cliniques couvraient une gamme de problèmes réels : déterminer ce qui pouvait affecter un patient en état critique, interpréter des images cérébrales, rédiger et lire des notes de consultation, et décider comment prendre en charge des douleurs thoraciques et d’autres plaintes courantes. Au total, 10 essais évalués par des pairs ont constitué l’ossature de l’analyse, avec quelques prépublications supplémentaires utilisées uniquement pour vérifier la robustesse des conclusions.

Performance des équipes médecin–IA

Dans l’ensemble de ces études, l’association des médecins avec l’IA a montré de petites mais perceptibles améliorations sur certaines mesures de qualité diagnostique et de prise en charge. Dans deux essais randomisés utilisant des systèmes de notation détaillés pour les décisions de cas, les équipes médecin–IA ont obtenu des scores supérieurs d’environ cinq points de pourcentage par rapport aux médecins seuls. Pour dire les choses simplement, si des médecins travaillant seuls prenaient environ 100 décisions clés, l’ajout de l’IA pourrait éviter à peu près cinq de ces décisions erronées. Cependant, les auteurs soulignent que les données sous‑jacentes sont maigres : seulement quelques essais contribuent à ces estimations, et l’éventail des résultats plausibles en conditions réelles est assez large pour inclure l’absence de bénéfice — voire un préjudice — dans d’autres contextes.

Vitesse, documentation et erreurs cachées

Beaucoup espèrent que l’IA libérera du temps pour les médecins. Ici, les preuves sont décevantes. Lorsque les chercheurs ont combiné trois essais mesurant la durée des tâches, ils n’ont trouvé pratiquement aucun gain de temps global. Dans certains exercices simulés, les médecins étaient un peu plus rapides avec l’IA ; dans une étude en clinique réelle, l’effet net sur la durée de la consultation était presque nul, bien que certains sous‑groupes aient bénéficié de gains modestes. La documentation raconte une histoire similaire « mixte ». L’assistance par l’IA rend souvent les notes plus claires et mieux structurées, et elle a aidé des non‑spécialistes à mieux comprendre des comptes rendus ophtalmologiques techniques. Pourtant, lorsque les chercheurs ont vérifié les faits, ils ont constaté qu’environ une note sur trois assistée par l’IA contenait encore des erreurs. Ce constat — des dossiers qui ont meilleure apparence mais peuvent rester erronés — soulève des préoccupations évidentes de sécurité.

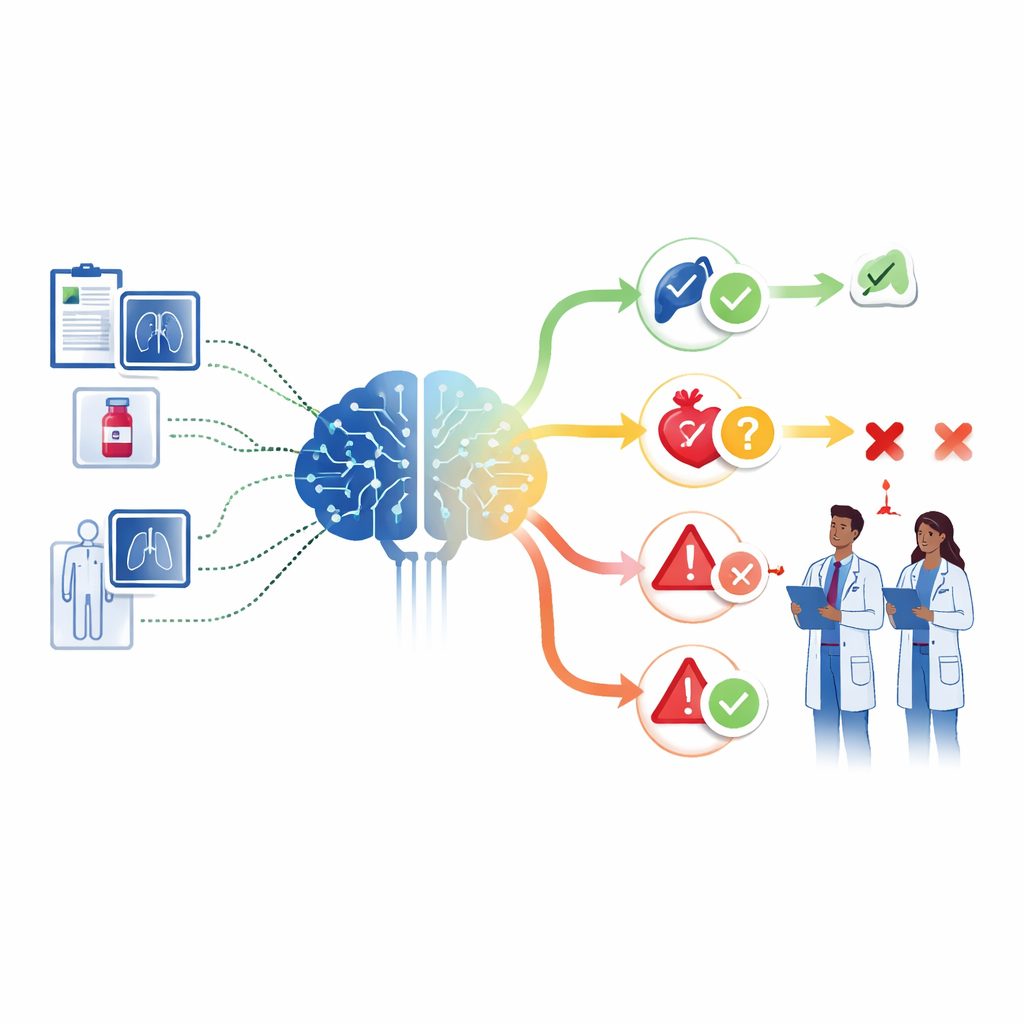

Quand la collaboration n’arrive pas à surpasser la machine

Un constat frappant provient des essais qui ont aussi testé l’IA seule. Dans une étude portant sur des patients en état critique, l’IA utilisée seule a obtenu des résultats à peu près équivalents à ceux de l’équipe médecin–IA, et meilleurs que ceux de nombreux médecins travaillant seuls. Dans une autre, les rapports d’examen générés par l’IA étaient clairement moins bons que ceux produits par des experts humains, que l’IA ait été ou non utilisée comme assistante. Ensemble, ces résultats mettent en lumière ce que les auteurs appellent un « paradoxe de la collaboration » : insérer simplement un humain dans la boucle ne garantit pas une amélioration par rapport à une IA performante, et dans certaines situations le partenariat peut diluer les forces de chacun. Des facteurs tels que la façon dont le conseil est présenté, le degré de confiance ou de méfiance des médecins à son égard, et l’intégration de l’outil dans le flux de travail quotidien influencent tous si la collaboration aide ou entrave.

Ce que cela signifie pour l’avenir des équipes médecin–IA

Globalement, la revue dresse le tableau d’une promesse prudente plutôt que d’une révolution déjà accomplie. Les équipes médecin–IA peuvent améliorer modestement certains scores décisionnels et rendre la rédaction médicale plus lisible, mais elles ne font pas gagner du temps de façon fiable et génèrent toujours un nombre préoccupant d’erreurs factuelles. Les auteurs soutiennent que les systèmes de santé devraient déployer ces outils progressivement, avec des garde‑fous solides axés sur la détection des erreurs plutôt que sur la seule amélioration de l’efficacité. Ils appellent également à des essais cliniques plus vastes et en conditions réelles qui évaluent l’assistance par l’IA dans des hôpitaux et cliniques fréquentés, pas seulement dans des simulations contrôlées. Tant que de telles preuves ne seront pas disponibles, la voie la plus sûre est de considérer les grands modèles de langage comme des assistants puissants mais faillibles — et de concevoir des flux de travail où les cliniciens agissent comme examinateurs critiques et gardiens, et non comme accepteurs passifs des conseils de l’IA.

Citation: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Mots-clés: collaboration humain–IA, assistance à la décision clinique, grands modèles de langage, précision diagnostique, documentation médicale