Clear Sky Science · fr

Mise à l’échelle de la science réglementaire des dispositifs médicaux à l’aide de grands modèles de langage

Pourquoi cela compte pour les patients et les médecins

La médecine moderne se dote rapidement d’appareils « intelligents » qui utilisent l’intelligence artificielle pour interpréter des images, suivre les signes vitaux et aider les médecins à prendre des décisions. Rien qu’aux États‑Unis, plus d’un millier de ces outils ont déjà été autorisés ou approuvés par la Food and Drug Administration (FDA). Chaque dispositif laisse une traînée documentaire faite de résumés de décision, de rapports de sécurité et d’autres dossiers complexes. Aujourd’hui, la plupart de ces informations sont encore examinées manuellement, ce qui est lent, coûteux et rapidement dépassé. Cet article explore si les grands modèles de langage — le même type d’IA derrière les chatbots avancés — peuvent lire ces documents à grande échelle de façon fiable et les transformer en données utilisables pour aider les régulateurs, les chercheurs et le public à comprendre la qualité de conception de ces dispositifs et la sécurité de leur fonctionnement.

Le problème du trop grand nombre de documents complexes

Chaque dispositif médical piloté par l’IA est accompagné de longs résumés de décision, de rapports de sécurité et d’avis de rappel. Ces documents sont longs, rédigés dans un jargon dense et incluent souvent des tableaux, des images et des formats incohérents. Des travaux antérieurs ont montré que répondre à des questions de base — par exemple comment un dispositif a été testé avant approbation, ou ce qui a exactement mal tourné lors d’un dysfonctionnement — nécessitait des équipes d’experts lisant des centaines de PDF ligne par ligne. Les outils de recherche simples et la détection de motifs retrouvent des détails évidents comme des numéros d’identification, mais peinent sur des questions plus profondes demandant du jugement, comme savoir si une étude a été menée dans plusieurs hôpitaux ou si un dispositif a réellement contribué à une blessure ou à un décès. Alors que le nombre de dispositifs équipés d’IA a explosé, cette approche manuelle est devenue impossible à soutenir.

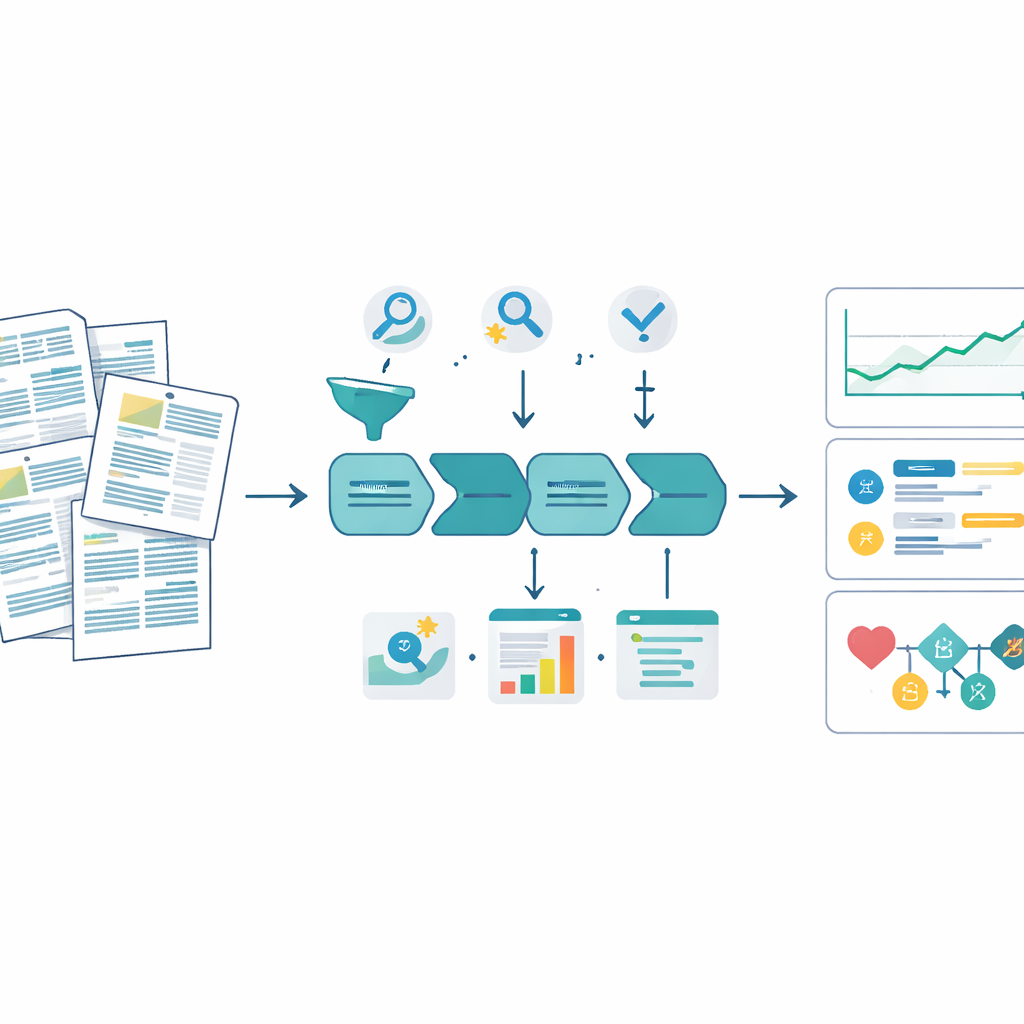

Un pipeline IA qui lit comme un expert

Les auteurs ont construit un pipeline général fondé sur un grand modèle de langage à la pointe pour relever ce défi. D’abord, ils ont rassemblé tous les résumés de décision et rapports de sécurité publics de la FDA pour 1 247 dispositifs d’IA ou d’apprentissage automatique et 1 852 rapports d’événements indésirables connexes jusqu’à la mi‑2025, nettoyant les PDF et utilisant la reconnaissance optique de caractères lorsque nécessaire. Ensuite, plutôt que de demander au modèle de répondre à de larges questions d’emblée, ils ont décomposé le travail en sous‑tâches plus petites et bien définies. Pour chaque type de document, le modèle a reçu des instructions détaillées ancrées dans les directives officielles de la FDA, ainsi que des exemples de la manière dont des humains étiquetteraient l’information. Le modèle devait raisonner étape par étape et produire ses réponses dans un format strict et structuré, transformant le texte libre en champs clairs tels que « nombre de sites d’étude », « type d’événement de sécurité » ou « nature du changement de dispositif ».

Vérifier la précision sur des questions réglementaires réelles

Pour savoir si ce système était digne de confiance, l’équipe a réalisé trois études de cas où des chercheurs antérieurs avaient déjà passé des mois en revue manuelle. D’abord, ils ont réexaminé la façon dont les dispositifs sont testés avant approbation en demandant si les essais étaient menés de manière prospective (collecte de données en avant) et s’ils impliquaient plusieurs hôpitaux. En comparant les sorties du modèle aux étiquettes d’experts, ils ont observé des taux d’accord souvent supérieurs à 80–90 %, comparables à l’accord entre annotateurs humains. Ensuite, ils ont utilisé le modèle pour réétiqueter des rapports de sécurité décrivant des dysfonctionnements, des blessures ou des décès, et pour classer ce qui avait mal fonctionné avec le dispositif. Lorsque des réviseurs humains ont comparé les codes originaux du fabricant avec ceux suggérés par le modèle — sans savoir lequel venait de qui — ils ont préféré les choix du modèle la grande majorité du temps, en particulier pour des catégories sensibles comme décès versus dysfonctionnement. Troisièmement, les chercheurs ont relié des détails des documents pré‑approbation à des rapports de sécurité ultérieurs pour explorer quelles décisions initiales — comme choisir un dispositif prédécesseur ayant déjà fait l’objet de rappels ou effectuer des changements matériels majeurs — étaient statistiquement associées à un risque accru de problèmes futurs.

Ce que les résultats révèlent sur la sécurité et la surveillance

Une fois validé, le pipeline a permis à l’équipe d’étendre ces analyses de quelques dizaines de dispositifs à l’ensemble de la population connue d’outils médicaux équipés d’IA. Ils ont constaté, par exemple, que les évaluations cliniques prospectives sont restées relativement rares sur trois décennies, tournant autour d’un dispositif sur dix, tandis que les mentions d’essais multi‑sites ont beaucoup augmenté. Dans les rapports de sécurité, le modèle a mis au jour des cas où le type de problème décrit dans le texte ne correspondait pas au code soumis à la FDA — par exemple des défauts matériels étiquetés comme des problèmes de qualité d’image. Lorsqu’ils ont relié des caractéristiques pré‑approbation aux événements de sécurité ultérieurs, les dispositifs dont les prédécesseurs avaient déjà subi des rappels ou eu des antécédents d’événements indésirables présentaient un bien plus grand risque de nouveaux rapports, alors que les dispositifs soutenus par des essais cliniques semblaient présenter un risque plus faible. Ces résultats sont exploratoires mais illustrent le type de questions qui peuvent désormais être posées de façon routinière plutôt que comme des projets ponctuels.

Limites, garde‑fous et perspectives

Les auteurs soulignent que leur approche n’est pas parfaite et ne doit pas remplacer le jugement d’experts. Une précision autour de 80 % peut suffire pour analyser des tendances d’ensemble mais pas pour décider du sort d’un dispositif ou d’un patient individuel. Les performances peuvent varier selon les types de dispositifs et les années, et la qualité des documents FDA et des bases de données de sécurité sous‑jacentes reste un goulot d’étranglement majeur. Néanmoins, cette étude montre que des systèmes de modèles de langage soigneusement conçus peuvent transformer des montagnes de texte réglementaire non structuré en données structurées et auditées en quelques jours plutôt qu’en plusieurs années. Pour le grand public, la conclusion est que les mêmes technologies d’IA qui animent les chatbots grand public peuvent aussi aider les veilleurs et les chercheurs à suivre la façon dont les dispositifs médicaux IA sont conçus, testés et surveillés — ce qui pourrait conduire à une détection plus rapide des problèmes et à des preuves meilleures pour orienter des règles et des produits plus sûrs.

Citation: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Mots-clés: dispositifs médicaux IA, science réglementaire, grands modèles de langage, rapports de sécurité FDA, surveillance des technologies de santé