Clear Sky Science · fr

Modélisation de l'incertitude dans l'analyse multimodale de la parole à travers le spectre de la psychose

À l'écoute d'indices cachés dans la parole quotidienne

La psychose est souvent perçue comme soudaine et spectaculaire — des voix, des visions, une rupture avec la réalité. Mais bien avant une crise, des changements subtils peuvent apparaître dans la manière de parler : le timbre de la voix, le choix des mots, voire le rythme des phrases. Cette étude examine si des ordinateurs peuvent détecter ces signaux faibles dans la parole et, surtout, indiquer à quel point ils sont confiants dans leurs détections. En procédant ainsi, le travail ouvre la voie à des outils futurs qui pourraient aider les cliniciens à suivre la santé mentale de façon plus objective et à personnaliser les soins sur tout le continuum, du risque léger à la maladie manifeste.

Du bavardage informel aux entretiens cliniques

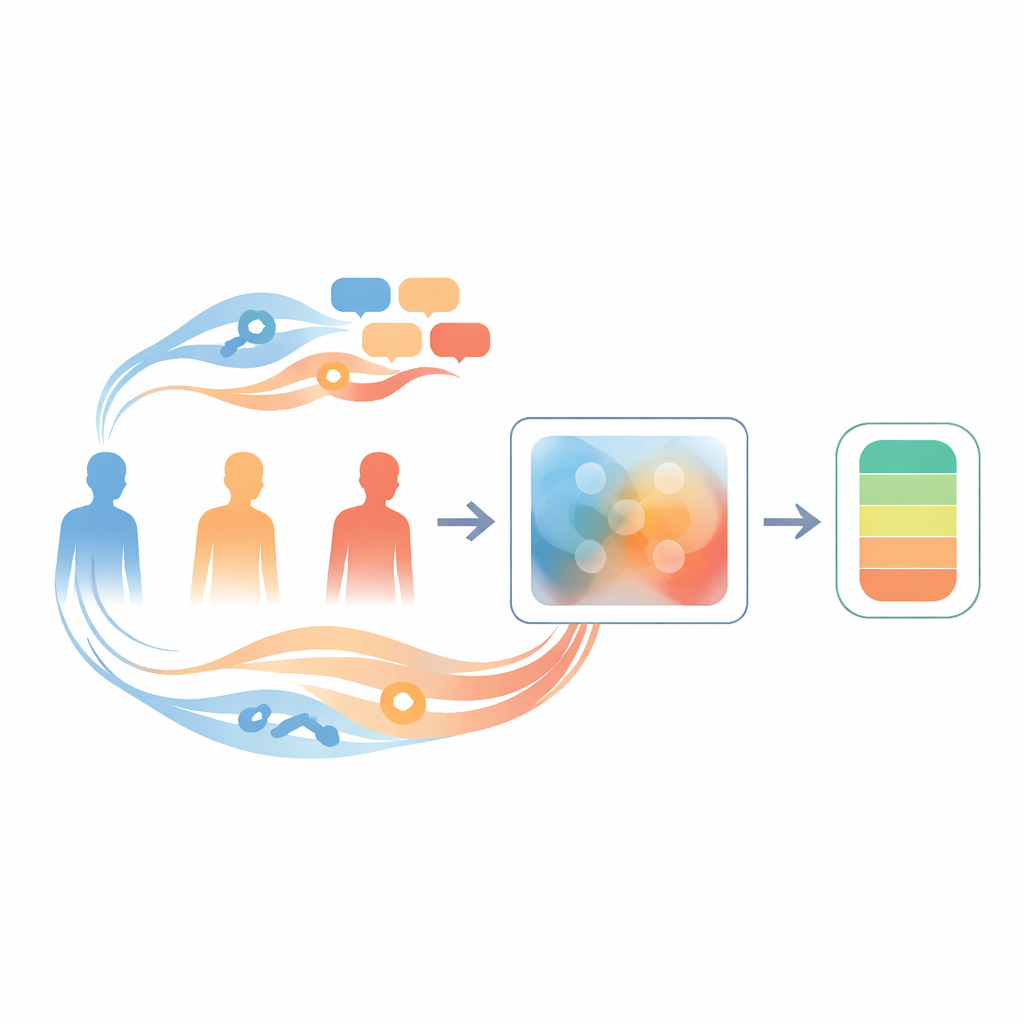

Les chercheurs ont enregistré la parole de 114 volontaires germanophones couvrant le spectre de la psychose : des personnes atteintes de troubles psychotiques précoces et des personnes sans diagnostic mais présentant des niveaux faibles ou élevés de traits proches de la psychose (connus sous le nom de schizoïdie). Chaque participant a réalisé quatre types de tâches orales, allant d'entretiens cliniques structurés à des récits autobiographiques plus libres, en passant par des contes à partir d'images et des conversations de la vie quotidienne. Ces contextes différents sont importants car un entretien fortement guidé peut faire ressortir certains symptômes, comme l'émoussement affectif, tandis que des récits ouverts peuvent révéler des divagations de pensée ou des perceptions inhabituelles. En échantillonnant ces différents contextes, l'équipe a pu évaluer la fiabilité des signaux de la parole dans des situations proches du réel.

Entendre à la fois comment nous parlons et ce que nous disons

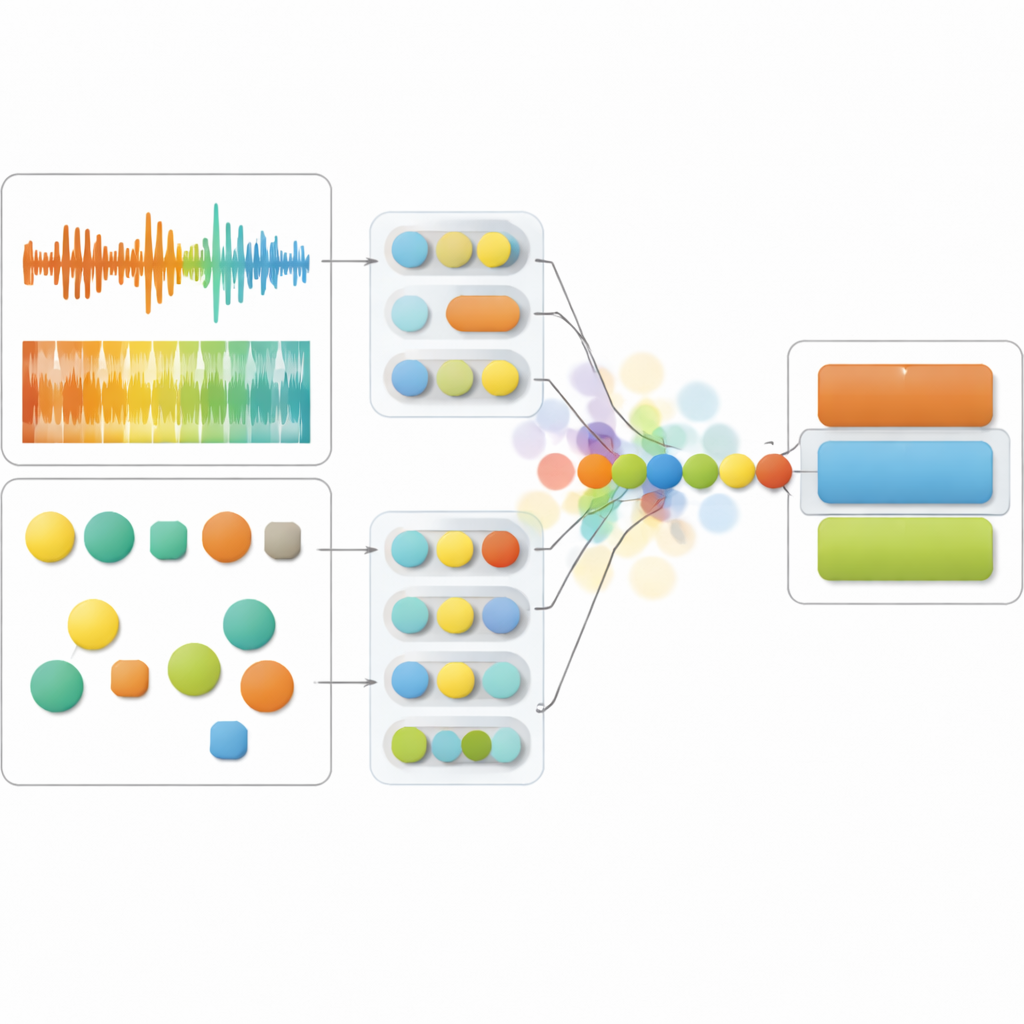

Le système étudié analyse simultanément deux facettes de la parole. Côté sonore, il suit des caractéristiques telles que les variations de hauteur, l'intensité et la structure fine de la voix, qui capturent ensemble l'expressivité, la tension et la fluidité. Côté langage, il analyse les mots eux-mêmes — leur charge émotionnelle, s'ils portent sur des perceptions ou des liens sociaux, et leur cohérence. Des réseaux neuronaux avancés, initialement entraînés sur de vastes corpus audio et textuels, transforment ces signaux bruts en empreintes numériques compactes. Le modèle central fusionne ensuite ces empreintes au fil du temps afin de juger, à chaque instant, quel canal — le sonore ou le linguistique — fournit l'indice le plus fiable sur l'état mental d'une personne.

Apprendre au modèle à reconnaître ses incertitudes

Ce qui distingue ce travail, c'est que le modèle ne se contente pas de produire une prédiction ; il estime aussi son propre degré d'incertitude. Plutôt que de considérer les flux audio et textuels comme fixes, il les représente comme des nuages de probabilité qui peuvent s'élargir lorsque les données sont bruitées ou atypiques. Si l'enregistrement vocal est dégradé ou que la personne marmonne, le système minimise l'importance du signal sonore et mise davantage sur les mots. Si la transcription est peu fiable ou le discours très fragmenté, il fait l'inverse. Cette fusion consciente de l'incertitude, baptisée Temporal Context Fusion, a obtenu de bonnes performances : elle a distingué les groupes de faible schizoïdie, de forte schizoïdie et de psychose précoce avec un F1-score de 83 % et a montré une bonne calibration de la confiance, c'est-à-dire que le niveau de certitude annoncé correspondait étroitement à la probabilité réelle d'exactitude.

Des schémas de parole qui reflètent différents types de symptômes

En sondant les mécanismes internes du modèle, les chercheurs ont identifié quels aspects de la parole suivaient de façon la plus constante différentes dimensions symptomatiques. Les personnes présentant des symptômes positifs plus intenses — comme des expériences inhabituelles ou des idées délirantes — avaient tendance à montrer une hauteur plus élevée et plus variable, des changements rapides dans le spectre de la voix et de plus grandes fluctuations d'intensité, notamment lors de récits ouverts. Leur langage contenait aussi de nombreux termes liés à la perception (associés au voir, entendre ou ressentir) et des mots à forte charge émotionnelle. En revanche, les personnes présentant des symptômes négatifs plus marqués — comme le retrait social et l'émoussement affectif — parlaient de façon plus monotone, avec une hauteur restreinte et une articulation moins flexible, et utilisaient moins de mots exprimant des émotions positives ou des liens sociaux. Les traits désorganisés, observés chez les patients et chez les volontaires à forte schizoïdie, se manifestaient par une intensité instable, des hésitations et un langage fragmenté rempli de mots liés au risque et aux processus cognitifs, suggérant un effort mental sans structure claire.

Pourquoi cela importe pour les soins de santé mentale futurs

Globalement, les résultats montrent que la parole porte des traces mesurables de traits liés à la psychose, même chez des personnes non malades sur le plan clinique, et que ces traces varient selon la situation de parole. Le modèle conscient de son incertitude a su exploiter à la fois le signal sonore et le langage pour suivre les caractéristiques positives, négatives et désorganisées le long d'un continuum, tout en signalant ouvertement lorsque ses preuves étaient faibles. Pour un non-spécialiste, l'idée essentielle est que l'écoute attentive — amplifiée par une IA qui connaît ses limites — pourrait à terme aider les cliniciens à surveiller la santé mentale de manière plus objective, réduire les conjectures et repérer plus tôt des changements significatifs. Plutôt que de remplacer le jugement humain, de tels outils pourraient servir de seconde paire d'oreilles, mettant en évidence des motifs dans la parole quotidienne qui méritent une attention plus approfondie.

Citation: Rohanian, M., Hüppi, R., Nooralahzadeh, F. et al. Uncertainty modeling in multimodal speech analysis across the psychosis spectrum. npj Digit. Med. 9, 218 (2026). https://doi.org/10.1038/s41746-025-02309-3

Mots-clés: psychose, analyse de la parole, apprentissage automatique, évaluation de la santé mentale, IA multimodale