Clear Sky Science · fr

L’application des grands modèles visuo‑linguistiques préentraînés pour le diagnostic préliminaire des plaques blanchâtres œsophagiennes dans le dépistage à grande échelle du cancer de l’œsophage

Pourquoi ces taches dans la gorge comptent

Lors des examens courants de l’estomac et de la gorge, les médecins observent souvent de petites plages blanches à l’intérieur de l’œsophage. La plupart sont bénignes, mais certaines annoncent un cancer précoce, curable s’il est détecté à temps. Distinguer ces taches qui se ressemblent dans des programmes de dépistage de grande ampleur est difficile, même pour les experts. Cette étude étudie si un système d’intelligence artificielle (IA) avancée peut aider les médecins à trier rapidement les lésions dangereuses des lésions inoffensives, et même décrire ce qu’il voit en langage clair.

Des taches blanches communes mais de risques très différents

Les plaques blanches dans l’œsophage sont étonnamment fréquentes : dans ce vaste programme de dépistage, plus d’un patient sur cinq en présentait. Pourtant ces plaques peuvent provenir de problèmes très différents. Certaines sont des cancers œsophagiens précoces, se manifestant comme des zones blanches légèrement surélevées et rugueuses qui ne s’enlèvent pas au frottement. D’autres résultent d’une infection fongique, formant des dépôts blancs mous qui peuvent se détacher et révéler un tissu cru en dessous. D’autres encore sont de petites excroissances bénignes appelées papillomes, ou des plaques plates granuleuses connues sous le nom d’acanthose glycogénique, généralement sans gravité et conciliables avec un simple suivi. Comme les options thérapeutiques vont d’une biopsie urgente à une simple observation, bien porter ce premier jugement visuel est crucial.

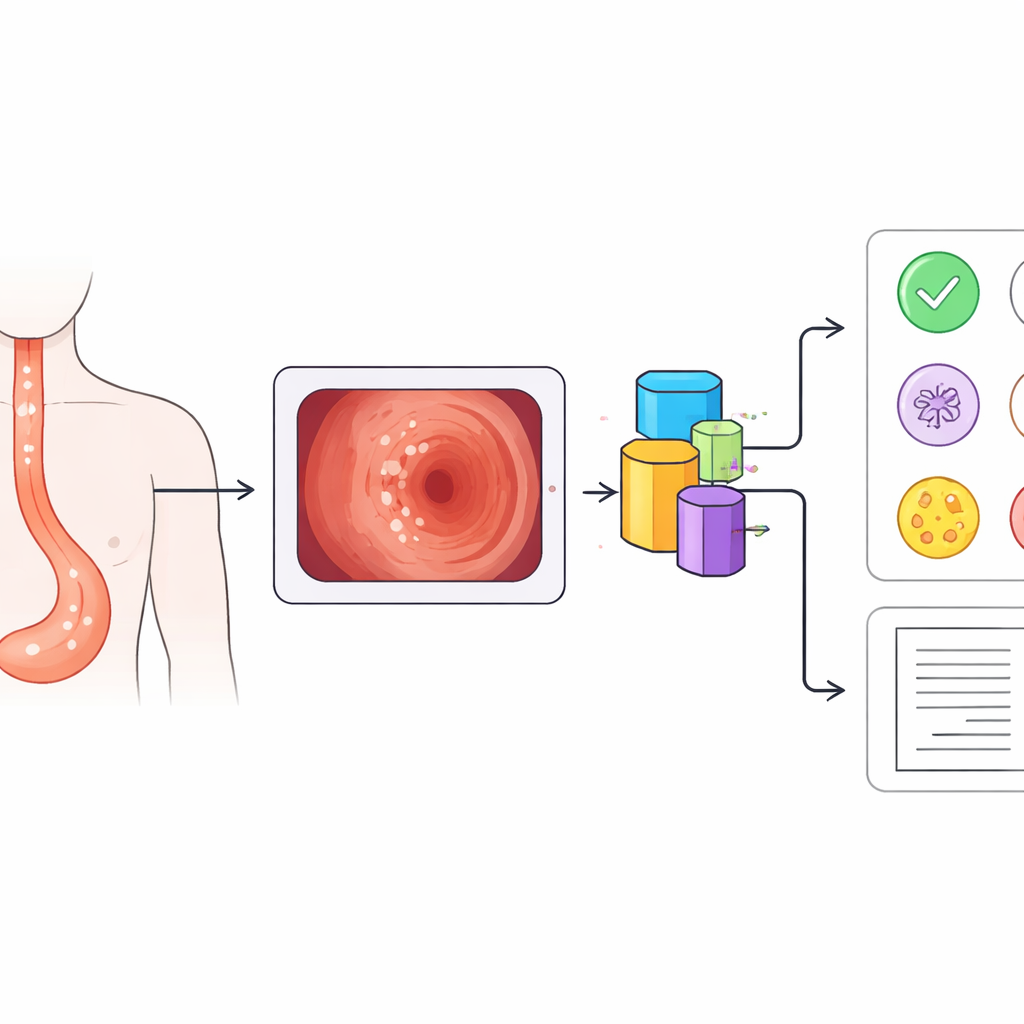

Transformer les images d’endoscopie en conseils intelligents

Les chercheurs ont construit un système d’aide au diagnostic sur la base d’un puissant modèle vision‑langage nommé BLIP, initialement entraîné sur d’énormes collections d’images et de textes. Ils ont alimenté le système avec 13 922 images endoscopiques provenant de plus de 2 000 patients, couvrant les quatre causes principales des plaques blanchâtres et utilisant à la fois les vues standard en lumière blanche et un mode de contraste spécial appelé imagerie à bande étroite. Contrairement aux outils antérieurs qui se contentaient d’attribuer une étiquette de maladie, ce système fait deux choses à la fois : il prédit laquelle des quatre affections est présente et génère une courte description écrite de ce qu’il « voit » dans l’image, par exemple la localisation et l’aspect des plaques.

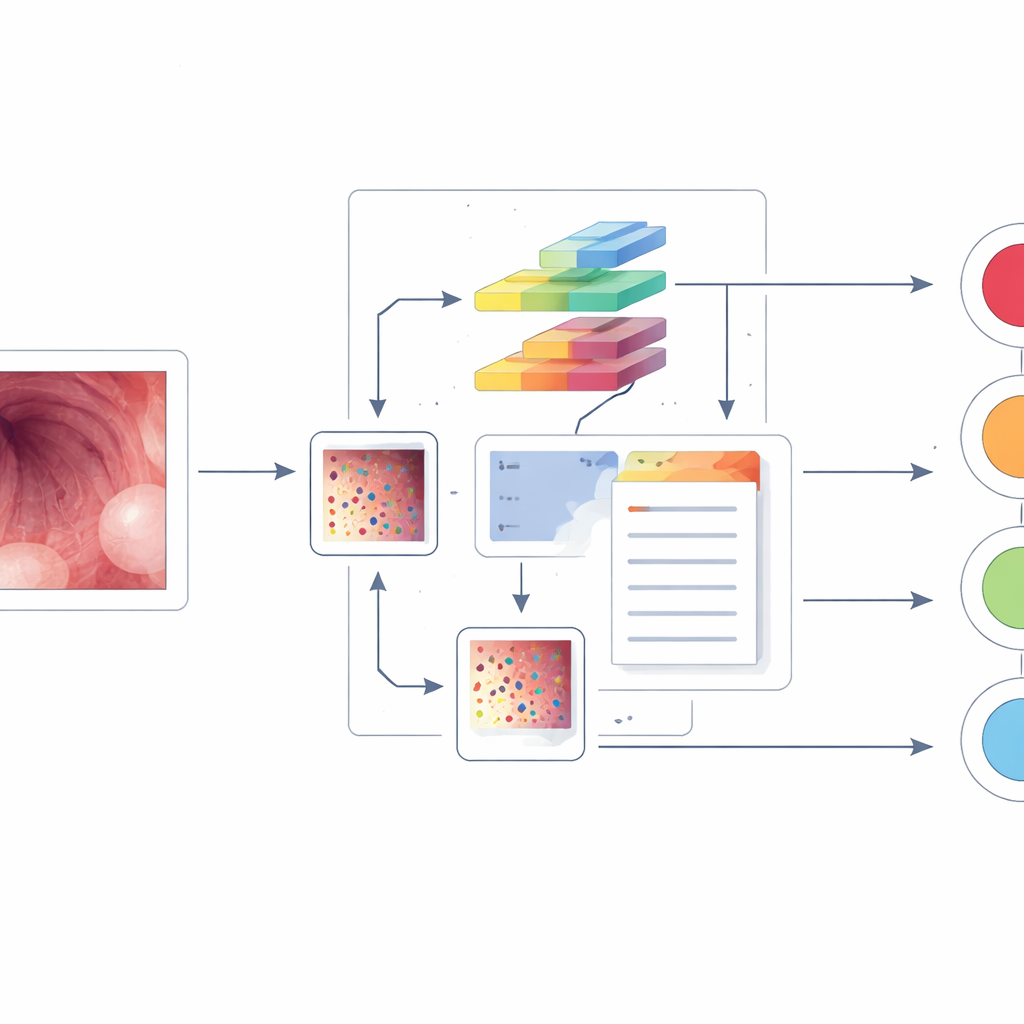

Apprendre davantage à l’IA avec des données médicales limitées

Les collections d’images médicales sont petites comparées aux archives de photos courantes, ce qui peut limiter les performances de l’IA. Pour répondre à cela, l’équipe a ajouté des modules spéciaux de « bruit à incitation positive » au modèle BLIP. En termes simples, ces modules créent des variations douces, guidées par les données, de chaque image et des cartes de caractéristiques internes du modèle, incitant le système à apprendre des motifs plus robustes sans le submerger par des changements aléatoires. Le modèle a ensuite été affiné pour que sa compréhension des images s’aligne étroitement sur les diagnostics d’experts et les descriptions textuelles fournies par des endoscopistes expérimentés.

Performances supérieures à la fois aux modèles concurrents et aux experts humains

Lors des évaluations, le nouveau système a surpassé plusieurs modèles d’IA centrés sur l’image sur toutes les mesures clés de performance pour les quatre maladies, en utilisant les deux modes d’endoscopie. Il a également devancé un modèle vision‑langage médical spécialisé appelé LLaVA‑Med dans la tâche de génération de mots‑clés diagnostiques précis au sein de ses descriptions textuelles. Dans une « compétition de lecture » directe contre quatre endoscopistes — deux seniors et deux juniors — l’IA a obtenu une précision globale supérieure pour la classification des images. De façon particulièrement marquante, elle a surpassé tous les médecins pour la détection du cancer œsophagien précoce, surtout en termes de rappel, c’est‑à‑dire qu’elle a manqué moins de cas de cancer tout en conservant une précision solide.

Ce que cela pourrait signifier pour les futurs bilans

L’étude suggère que des IA vision‑langage soigneusement adaptées pourraient devenir des assistants précieux dans les programmes de dépistage à grande échelle. Un tel système pourrait signaler en temps réel les plaques blanches suspectes, réduire les cancers précoces manqués et épargner de nombreux patients de biopsies inutiles en rassurant les médecins quand une lésion paraît bénigne. Le travail doit encore être testé sur des vidéos d’endoscopie, sur des types plus rares de plaques blanches et dans plusieurs hôpitaux, mais il ouvre la voie à un avenir où l’IA non seulement repère les anomalies dans les images médicales, mais explique aussi son raisonnement en langage utile pour des décisions cliniques plus rapides et plus cohérentes.

Citation: Li, Y., Li, X., Zhang, D. et al. The application of pre-trained large visual-language models for preliminary diagnosis of esophageal whitish plaques in large-scale esophageal cancer screening. npj Precis. Onc. 10, 94 (2026). https://doi.org/10.1038/s41698-026-01301-8

Mots-clés: dépistage du cancer de l’œsophage, IA en endoscopie, modèles vision‑langage, aide au diagnostic par ordinateur, plaques œsophagiennes blanchâtres