Clear Sky Science · fr

Un ensemble de vision et de swin transformers avec des explications basées sur un LLM pour le diagnostic des maladies des feuilles de canne à sucre

Pourquoi il est important de repérer les feuilles de canne malades

La canne à sucre est une culture essentielle pour le sucre, les biocarburants et de nombreux moyens de subsistance ruraux, mais ses feuilles sont vulnérables à diverses maladies qui diminuent discrètement les rendements. Les agriculteurs s'appuient généralement sur l'inspection visuelle, qui peut être lente, incohérente et difficile à étendre sur de grandes parcelles. Cet article examine comment l'intelligence artificielle moderne peut automatiquement analyser des photos de feuilles pour détecter plusieurs maladies de la canne à sucre avec une grande précision, puis utiliser un modèle de langage pour transformer ces prédictions en conseils en langage clair destinés aux agriculteurs.

Comment les photos de feuilles sont transformées en données

Les chercheurs ont construit leur système à partir d'une collection ouverte d'images de feuilles de canne disponible sur Kaggle, comprenant près de vingt mille photos en couleur. Chaque image appartient à l'une des six catégories : saine ou l'une des cinq maladies communes, notamment la brûlure bactérienne (Bacterial Blight), la mosaïque, la pourriture rouge (Red Rot), la rouille et la maladie des feuilles jaunes (Yellow Leaf Disease). Les photos ont été prises dans des conditions agricoles réelles, incluant des variations d'éclairage, des ombres et des arrière-plans encombrés. Pour préparer les données, l'équipe a supprimé les doublons et les images corrompues, puis a divisé le jeu de données en ensembles d'entraînement, de validation et de test tout en conservant le même équilibre de types de maladies dans chacun. Pendant l'entraînement, seules les images d'entraînement ont été augmentées par rotations, retournements et zooms afin d'imiter différents angles et distances de prise de vue, rendant le système plus robuste sans gonfler ses performances de test.

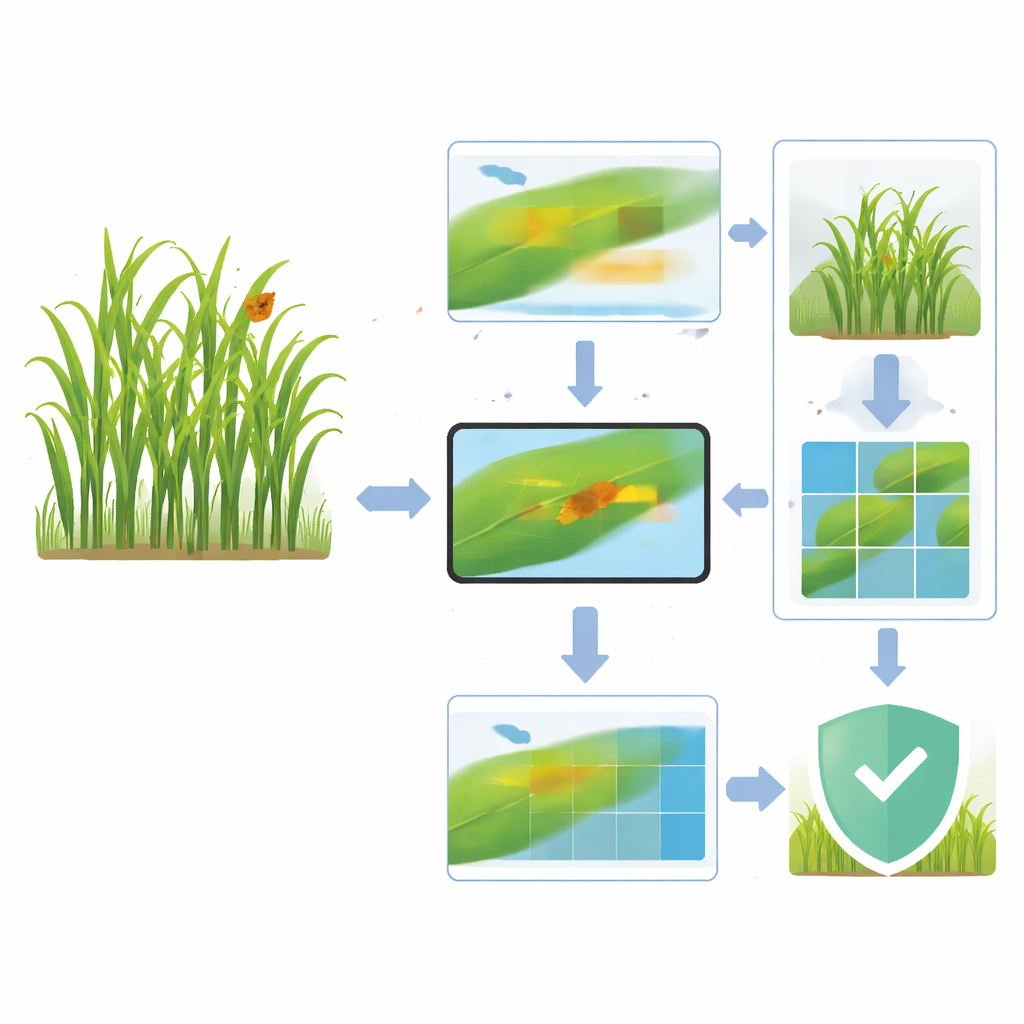

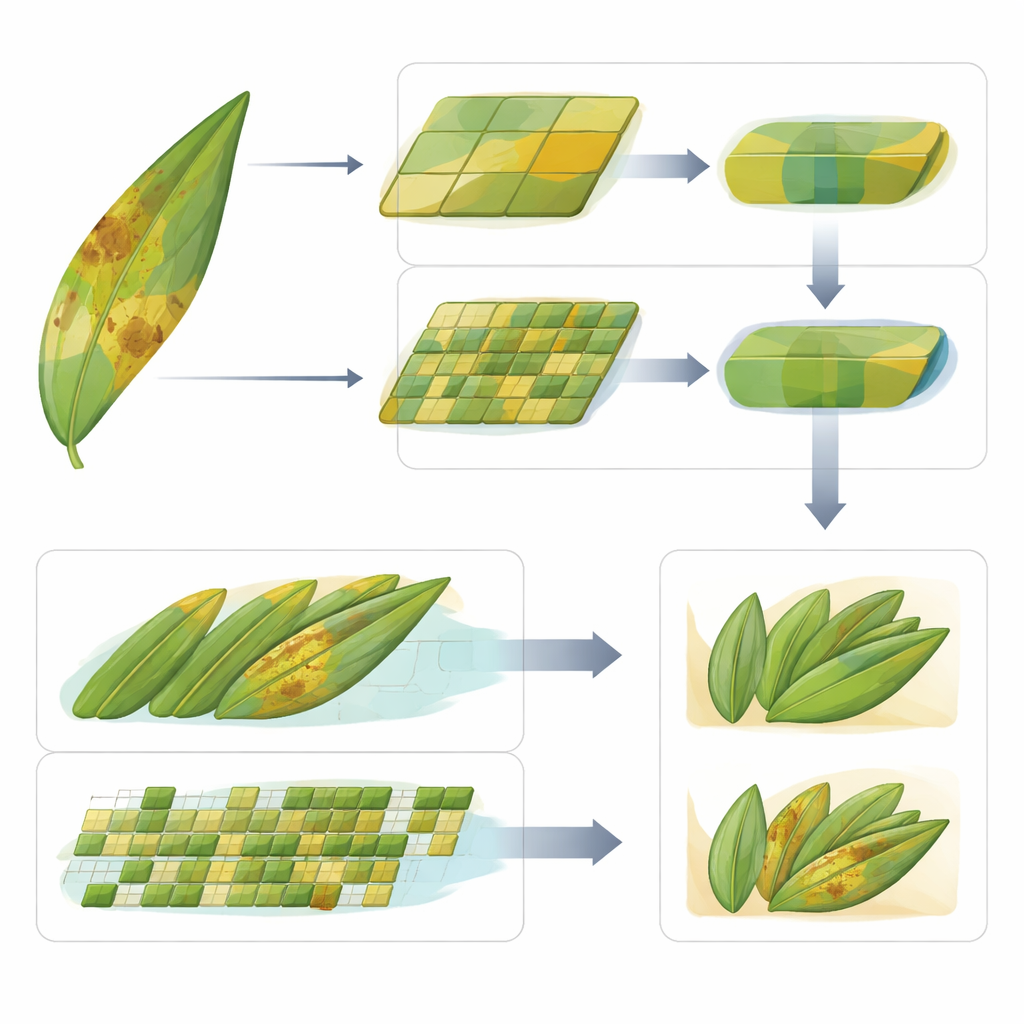

Deux manières complémentaires d'observer une feuille

Au cœur de l'étude se trouve un « ensemble » qui combine deux modèles visuels avancés appelés transformers. L'un, le Vision Transformer (ViT), considère chaque image comme un ensemble de patchs et apprend des motifs à travers l'ensemble de la feuille en une fois. Cette vue globale convient bien aux maladies qui se propagent sous forme de larges zones diffuses de décoloration. L'autre, nommé Swin Transformer, fonctionne avec de petites fenêtres chevauchantes qui parcourent l'image, construisant une compréhension en couches des textures fines et des petites taches. Ce focus local aide pour les maladies qui apparaissent sous forme de minuscules lésions, stries ou points. Par conception, ViT est sensible aux changements de couleur étendus tandis que Swin accorde de l'attention aux détails petits et regroupés — deux facettes de la manière dont les maladies foliaires se manifestent sur le terrain.

Comment les deux modèles unissent leurs forces

Plutôt que de concevoir un réseau nouveau et complexe, les auteurs combinent ViT et Swin de façon simple et transparente. Chaque modèle examine d'abord la même image de feuille et produit ses propres scores de probabilité pour les six classes. Ces scores sont ensuite moyennés, sans poids entraînables supplémentaires, et la plus haute probabilité combinée détermine le diagnostic final. Cette stratégie d'égalisation équilibre les forces de chaque modèle et évite le surapprentissage sur un jeu de données qui, bien que raisonnablement grand, reflète encore un ensemble spécifique de régions et de conditions. Les expériences montrent que remplacer Swin par un réseau convolutionnel traditionnel fait perdre des détails locaux cruciaux, et n'utiliser que ViT manque d'indices subtils — preuve que le gain provient de la synergie réelle entre attention globale et locale, et non simplement de l'empilement de modèles.

Quelle est l'efficacité du système en pratique

Sur l'ensemble de test distinct d'environ trois mille images, l'ensemble atteint une précision d'environ 97 %, avec des valeurs de précision, rappel et F1 également élevées pour les six classes. Il surpasse de solides baselines convolutionnels comme ResNet, EfficientNet, MobileNet et DenseNet, ainsi que les modèles ViT et Swin pris isolément. La matrice de confusion montre que la plupart des erreurs se produisent entre des maladies visuellement similaires, telles que Yellow Leaf et Mosaic, mais les taux de mauvaise classification restent globalement faibles. Les courbes ROC pour chaque classe sont presque parfaites, indiquant que l'ensemble est très confiant et cohérent pour séparer les feuilles saines des feuilles malades et distinguer les différents types de maladies.

Transformer les prédictions en conseils accessibles aux agriculteurs

Pour aller au-delà des simples étiquettes, les auteurs relient leur ensemble d'images à un grand modèle de langage (LLM) hébergé en ligne. Dès qu'une photo de feuille est classifiée, le nom de la maladie prédit est envoyé au LLM, qui renvoie une courte explication des symptômes probables et des suggestions générales de gestion, destinées aux agriculteurs et aux conseillers agricoles. Une interface web basée sur la plateforme Hugging Face permet aux utilisateurs de téléverser une image de feuille, de voir la maladie prédite et de lire les conseils générés par l'IA en quelques secondes. Les auteurs insistent sur le fait que ces recommandations sont consultatives et doivent être vérifiées par des experts agronomes, car les LLM peuvent parfois générer des conseils trop affirmatifs ou incomplets. Néanmoins, cette couche linguistique rend le système plus accessible aux non-spécialistes.

Ce que cela signifie pour les futurs outils d'agriculture intelligente

En termes simples, l'étude montre que combiner deux « manières de voir » la même feuille — l'une qui voit la forêt, l'autre qui voit les arbres — peut produire un éclaireur numérique très fiable pour les maladies de la canne à sucre. L'ensemble ViT et Swin capture à la fois les symptômes larges et les symptômes fins, tandis que le modèle de langage associé aide à traduire les prédictions techniques en suggestions compréhensibles par des humains. Bien que les modèles doivent encore être testés sur davantage de régions, de conditions d'éclairage et d'appareils, et que les sorties textuelles nécessitent une validation experte, ce travail ouvre la voie à des outils pratiques sur téléphone ou tablette qui pourraient aider les agriculteurs à détecter les problèmes tôt, réduire les approximations et favoriser une utilisation plus précise des traitements pour la canne à sucre et, à terme, pour de nombreuses autres cultures.

Citation: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

Mots-clés: détection des maladies de la canne à sucre, modèles vision Transformer, agriculture de précision, imagerie des feuilles de plantes, soutien décisionnel par IA