Clear Sky Science · fr

Ségrégation d’instruments chirurgicaux faiblement supervisée et indépendante du domaine

Pourquoi une meilleure vision des instruments chirurgicaux compte

Les chirurgiens modernes opèrent de plus en plus à l’aide de caméras, de microscopes et de scanners avancés. Pour guider des robots, aligner des vues 3D ou masquer des instruments sur certaines images, les ordinateurs doivent repérer de manière fiable chaque instrument chirurgical dans chaque image — une tâche appelée segmentation. Aujourd’hui, cela exige généralement des milliers d’annotations laborieuses et pixel-par-pixel réalisées par des experts médicaux — et même ainsi, les systèmes échouent souvent lorsque le dispositif d’imagerie ou la procédure change. Cette étude présente une méthode permettant à de puissants modèles de vision de détecter des instruments à travers des types d’images médicales très différents, sans avoir besoin de dessins détaillés de chaque outil au préalable.

Le défi de trouver des outils dans de nombreux types d’images

Les chirurgiens utilisent une large palette de systèmes d’imagerie : vidéos couleur provenant de caméras laparoscopiques dans l’abdomen, vues au microscope de l’œil pendant une chirurgie de la cataracte, et coupes transversales telles que l’OCT (tomographie par cohérence optique) ou l’échographie. Dans chacun de ces cas, les instruments chirurgicaux ont des apparences très différentes — tiges métalliques brillantes sur des images couleur, lignes fines et lumineuses ou croissants en OCT, ou tâches granuleuses en échographie. Les méthodes d’apprentissage profond existantes peuvent très bien fonctionner, mais seulement après entraînement sur de grands jeux de données étiquetés et spécifiques à un contexte. Si l’appareil d’imagerie, l’anatomie ou le type d’instrument change, les performances chutent souvent fortement, et collecter de nouvelles annotations est lent, coûteux et contraint par la confidentialité et l’expertise requise.

Une nouvelle idée : traiter les instruments comme des objets hors de place

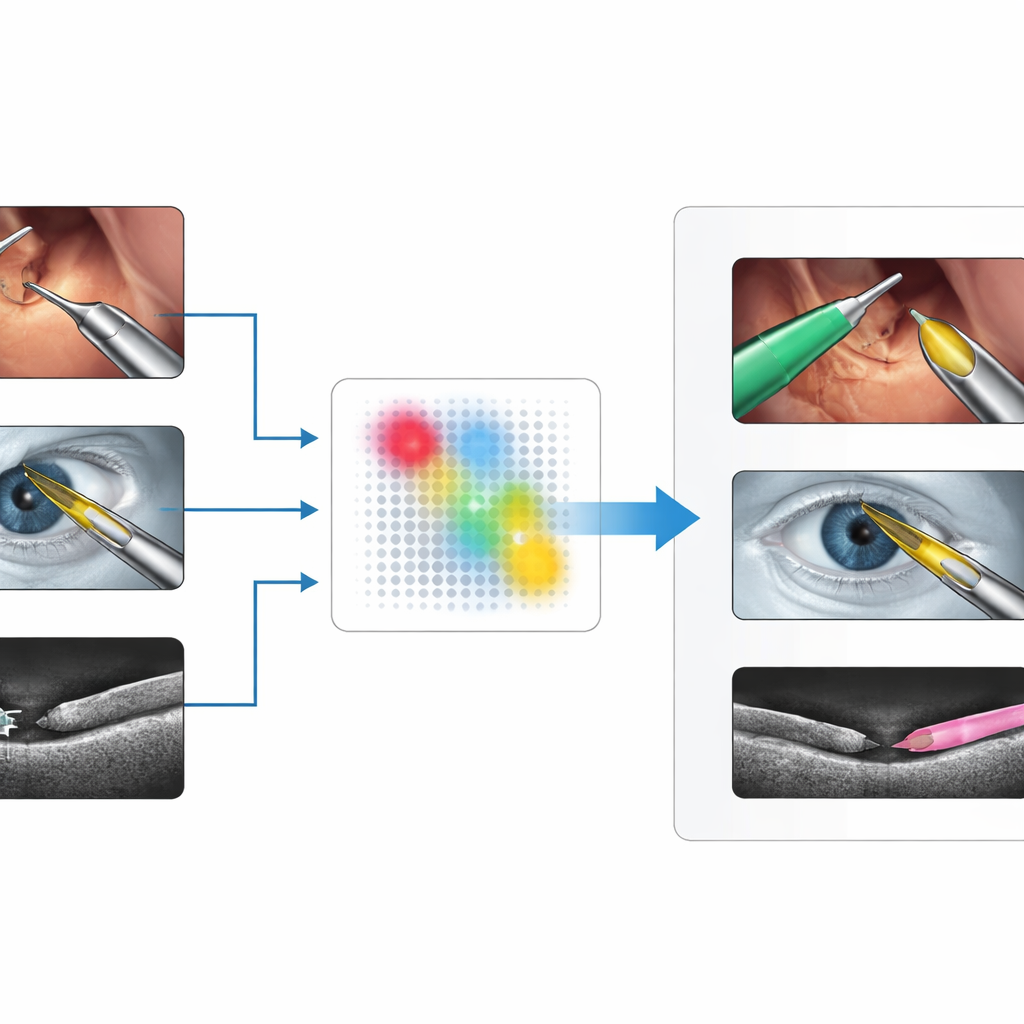

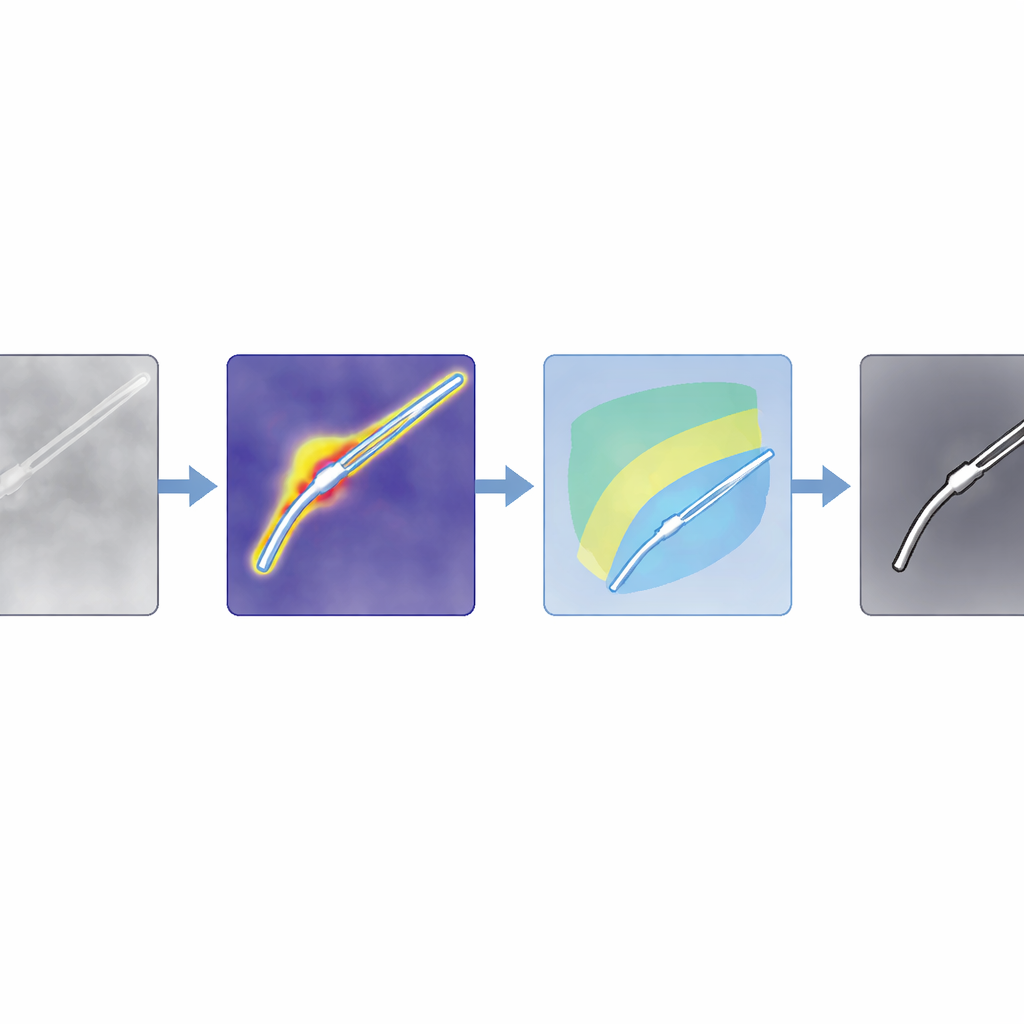

Les auteurs proposent une méthode qu’ils appellent SAM4SIS qui renverse le problème. Plutôt que d’apprendre au système l’apparence précise de chaque instrument, ils lui montrent d’abord des images sans aucun outil, lui permettant d’apprendre à quoi ressemble un tissu « normal ». Ils utilisent un détecteur d’anomalies nommé PatchCore pour construire une mémoire de ces motifs normaux. Lorsqu’une nouvelle image arrive, PatchCore met en évidence les régions dont l’apparence ne correspond pas à cette mémoire — des zones susceptibles de contenir des instruments chirurgicaux. Cette étape ne nécessite qu’une information simple au niveau de l’image indiquant si un outil est présent, et non des dessins pixelisés de sa silhouette, ce qui simplifie grandement la configuration.

Des indices grossiers aux contours précis

Les cartes d’anomalie sont grossières, aussi l’équipe les combine-t-elle avec un puissant modèle fondamental, Segment Anything Model 2 (SAM2), qui peut tracer des contours précis si on lui donne un point à l’intérieur de l’objet d’intérêt. L’astuce clé consiste à choisir automatiquement ces points à partir de la carte d’anomalie, plutôt que de demander à un humain de cliquer. Les auteurs conçoivent des filtres adaptés aux images couleur ordinaires et aux images d’intensité comme l’OCT, amplifiant les régions susceptibles de contenir des instruments tout en supprimant ombres et artefacts lumineux. Ils évaluent ensuite des régions candidates et sélectionnent les points les plus prometteurs comme incitations pour SAM2. Parce que SAM2 renvoie plusieurs contours possibles, les auteurs introduisent une nouvelle règle de notation, SAM4SIS, qui mesure dans quelle mesure chaque candidat correspond à la carte d’anomalie et choisit le masque qui s’ajuste le mieux.

Fonctionne sur de nombreuses chirurgies et appareils d’imagerie

Les chercheurs testent leur approche sur trois jeux de données exigeants : vidéos de chirurgie robotique abdominale (EndoVis2017), images au microscope d’opérations de la cataracte (CaDIS), et coupes OCT d’yeux porcins avec de tout petits outils (PASO-SIS). Ces ensembles couvrent des vues, des couleurs et des motifs de bruit très différents. Sans jamais réentraîner le grand modèle de segmentation ni dessiner de nouveaux masques, SAM4SIS atteint des scores de précision de contour situés entre environ 53 % et 73 %, rivalisant avec ou surpassant des méthodes de suggestion basées sur du texte et se rapprochant de certains systèmes supervisés. Il obtient de très bons résultats là où les méthodes traditionnelles peinent, comme sur les données OCT et échographie, et nécessite moins d’une minute de configuration. L’équipe montre aussi que la même idée peut mettre en évidence d’autres objets étrangers, comme des boules de coton dans des échographies cérébrales, suggérant que le concept n’est pas limité aux seuls instruments.

Ce que cela signifie pour la chirurgie intelligente de demain

Pour le lecteur, le message central est que les ordinateurs peuvent désormais apprendre à « segmenter tout ce qui est nouveau » dans des scènes chirurgicales en apprenant d’abord à reconnaître le tissu normal, puis en signalant les formes inconnues comme des outils probables, qui sont ensuite raffinées par un modèle de vision polyvalent. Cette approche évite un travail d’annotation lourd, s’adapte à différentes technologies d’imagerie et peut s’intégrer aux flux de travail chirurgicaux avec une préparation minimale. Si des modèles spécialisés soigneusement entraînés restent supérieurs lorsqu’un grand nombre de données annotées est disponible, SAM4SIS offre une alternative pratique pour de nouvelles procédures, des configurations d’imagerie rares ou la recherche en phase précoce, rapprochant la détection automatisée et robuste d’instruments de la réalité clinique quotidienne.

Citation: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Mots-clés: segmentation d’instruments chirurgicaux, IA en imagerie médicale, détection d’anomalies, modèles de vision fondamentaux, chirurgie robotique