Clear Sky Science · fr

Développement et évaluation d’un cadre d’apprentissage par transfert multi‑étapes pour une analyse robuste d’images médicales

Pourquoi une lecture d’images plus intelligente compte

La médecine moderne s’appuie fortement sur les images — des mammographies aux radiographies thoraciques — pour détecter les maladies précocement et orienter les traitements. Mais apprendre aux ordinateurs à interpréter ces images avec la même précision que des experts humains exige généralement d’énormes jeux de données soigneusement annotés, que de nombreux hôpitaux n’ont tout simplement pas. Cette étude présente une nouvelle façon d’entraîner des systèmes d’intelligence artificielle qui exploite mieux les images existantes, y compris des photos de laboratoire peu coûteuses de cellules cancéreuses, afin d’améliorer les performances sur des scans réels tout en allégeant les contraintes de confidentialité et de données.

Des photos du quotidien aux examens hospitaliers

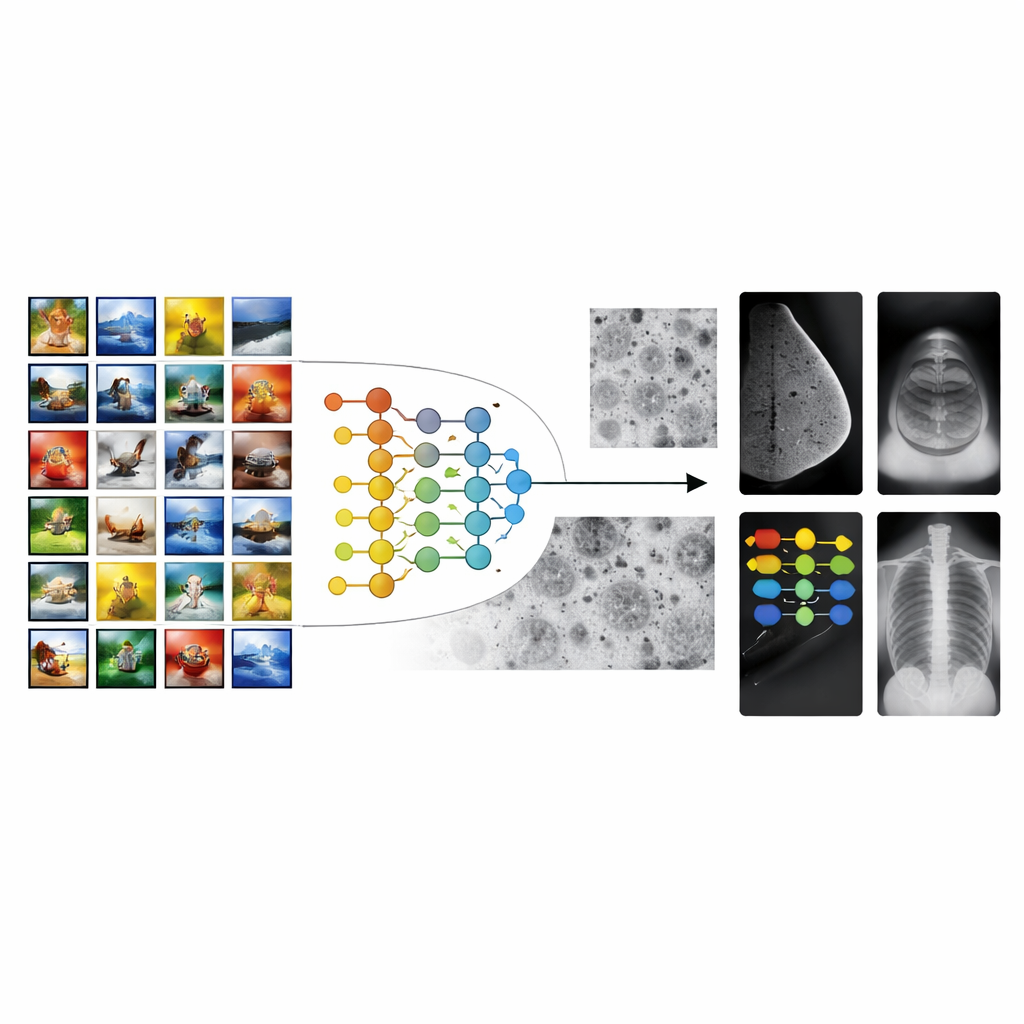

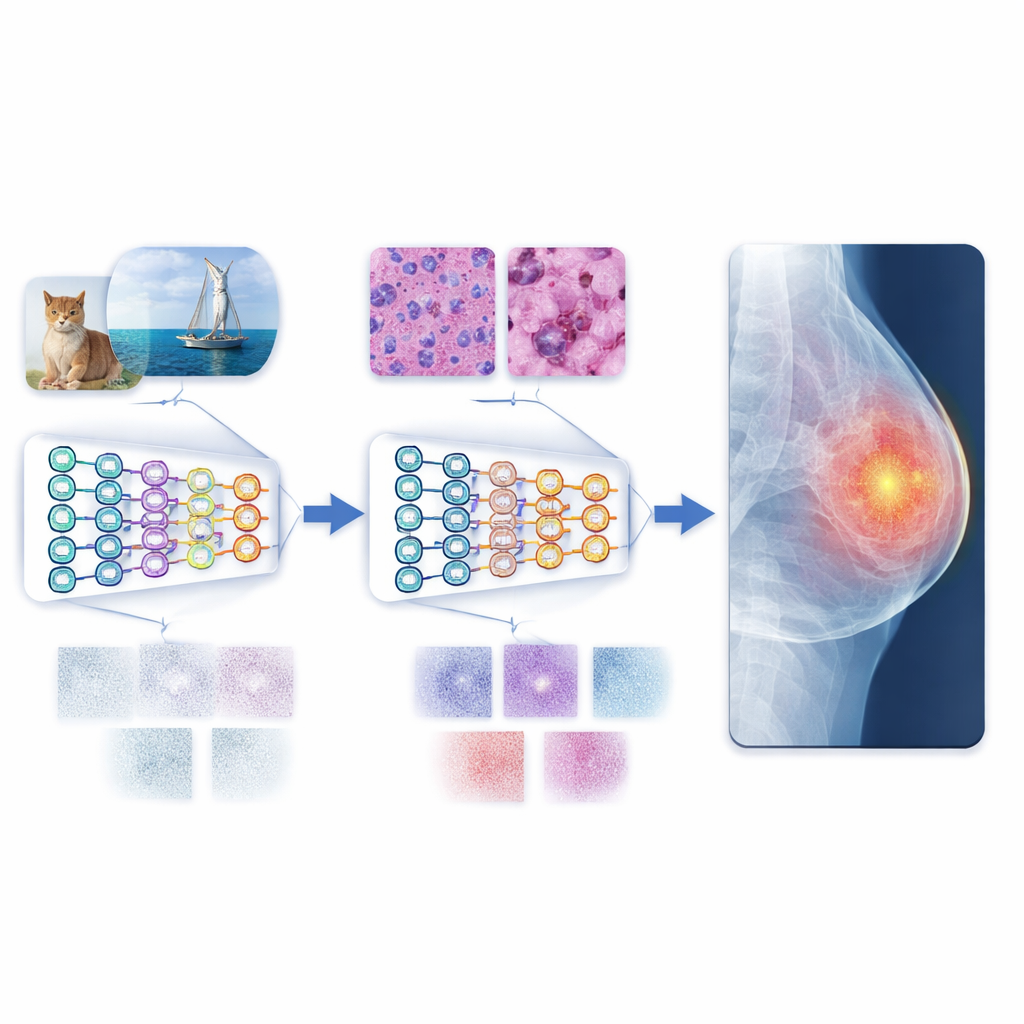

La plupart des systèmes d’IA pour l’imagerie médicale partent de modèles entraînés sur des millions de photos ordinaires, comme des animaux, des objets ou des paysages. Cette stratégie, appelée apprentissage par transfert, donne aux algorithmes une « longueur d’avance » pour reconnaître formes et textures. Cependant, il existe un grand fossé entre les photos de vacances et les examens médicaux. Les motifs qui comptent dans une mammographie ou une radiographie — petits grains, ombres fugitives ou textures tissulaires subtiles — ne ressemblent en rien aux objets des photos courantes. En conséquence, l’apprentissage par transfert conventionnel peut s’enliser, produisant des outils qui fonctionnent bien en laboratoire mais peinent à généraliser selon les hôpitaux, les appareils ou les populations de patients.

Construire un pont avec des images cellulaires

Les auteurs proposent un cadre d’apprentissage par transfert multi‑étapes (MSTL) qui ajoute une étape intermédiaire cruciale entre les images générales et les scans cliniques. Après un premier entraînement sur une grande collection d’images naturelles, le modèle est affiné sur des images microscopiques de lignées cellulaires cancéreuses cultivées en laboratoire. Ces images cellulaires partagent de nombreuses caractéristiques visuelles avec les examens médicaux : structures denses et encombrées ; textures fines ; variations subtiles de luminosité. Elles sont aussi relativement peu coûteuses à produire, peuvent être générées en grand nombre et évitent les problèmes de confidentialité liés aux données patients. En s’adaptant d’abord à cet univers d’images cellulaires, le modèle apprend des caractéristiques plus pertinentes pour les motifs de maladie avant même de voir une mammographie, une échographie ou une radiographie.

Tester sur différents types d’examens

Pour évaluer cette stratégie, les chercheurs ont entraîné à la fois des réseaux de neurones convolutifs traditionnels et des transformeurs de vision plus récents sur trois tâches d’imagerie courantes : détection du cancer du sein dans les mammographies, analyse des lésions mammaires en échographie et détection de pneumonie dans les radiographies thoraciques. Ils ont comparé trois modes d’entraînement : partir de zéro, utiliser l’apprentissage par transfert conventionnel à partir d’images naturelles, et utiliser la nouvelle méthode multi‑étapes avec des images de cellules cancéreuses comme pont. L’approche multi‑étapes a systématiquement donné les meilleurs résultats, rapprochant souvent la précision de la perfection sur les jeux de données testés. Les transformeurs de vision, capables de capturer des motifs à longue portée sur l’ensemble de l’image, ont surpassé les réseaux convolutifs standards dans presque tous les cas, surtout lorsqu’ils étaient associés à l’entraînement multi‑étapes.

Mesurer la transférabilité des connaissances

Au‑delà des simples scores de précision, l’équipe a examiné la facilité avec laquelle les caractéristiques apprises à une étape se transféraient à la suivante. Ils ont utilisé trois mesures de transférabilité qui reflètent la compatibilité des motifs d’image appris avec de nouvelles tâches. Pour les mammographies et les radiographies thoraciques en particulier, ces mesures suivaient de près les performances réelles, surtout pour le modèle le plus performant, un transformeur de base (ViTB‑16). Cette corrélation forte suggère que l’étape intermédiaire sur images cellulaires fait plus qu’améliorer les chiffres : elle produit des représentations qui « collent » réellement mieux aux images médicales. Des expériences supplémentaires ont montré que réduire de moitié le nombre d’images cellulaires détériorait les performances, et les remplacer par d’autres modalités médicales (comme l’endoscopie ou des images oculaires) était moins efficace, ce qui souligne la valeur particulière des lignées cellulaires cancéreuses comme pont.

Vers un diagnostic automatisé plus fiable

En termes concrets, l’étude montre que former un système d’IA à lire d’abord des images de cellules cultivées en laboratoire avant les scans hospitaliers en fait un « lecteur » d’images médicales plus habile et fiable. Ce chemin multi‑étapes réduit le décalage entre les photos colorées du quotidien et les motifs sourds et complexes des images cliniques, permettant au modèle de mieux généraliser même lorsque seules des quantités modestes de données médicales annotées sont disponibles. Associée aux transformeurs de vision modernes, l’approche offre des performances à la pointe sur plusieurs jeux de référence. Bien que des données plus diversifiées et des tests plus étendus soient encore nécessaires, le cadre ouvre la voie à des outils évolutifs et respectueux de la vie privée qui pourraient aider les médecins à diagnostiquer les maladies avec plus de précision et de constance à l’échelle mondiale.

Citation: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Mots-clés: analyse d’images médicales, apprentissage par transfert, apprentissage profond, transformeurs de vision, imagerie de cellules cancéreuses