Clear Sky Science · fr

Conception et mise en œuvre d’un cadre d’apprentissage profond pour la classification automatisée des cultures et le diagnostic sanitaire en agriculture de précision

Des champs plus intelligents pour un monde affamé

Pour nourrir une population mondiale en croissance, il faut extraire davantage de nourriture de chaque parcelle tout en réduisant le gaspillage d’eau, d’engrais et de travail. Pourtant, les agriculteurs passent encore d’innombrables heures à parcourir leurs terres, inspectant visuellement feuilles et sols. Cet article présente une méthode automatisée pour surveiller les cultures à l’aide de drones volants, de satellites en orbite et de capteurs enfouis, tous connectés à un système d’apprentissage profond capable de détecter précocement les problèmes et de proposer des actions rapides.

Rapprocher ciel et sol

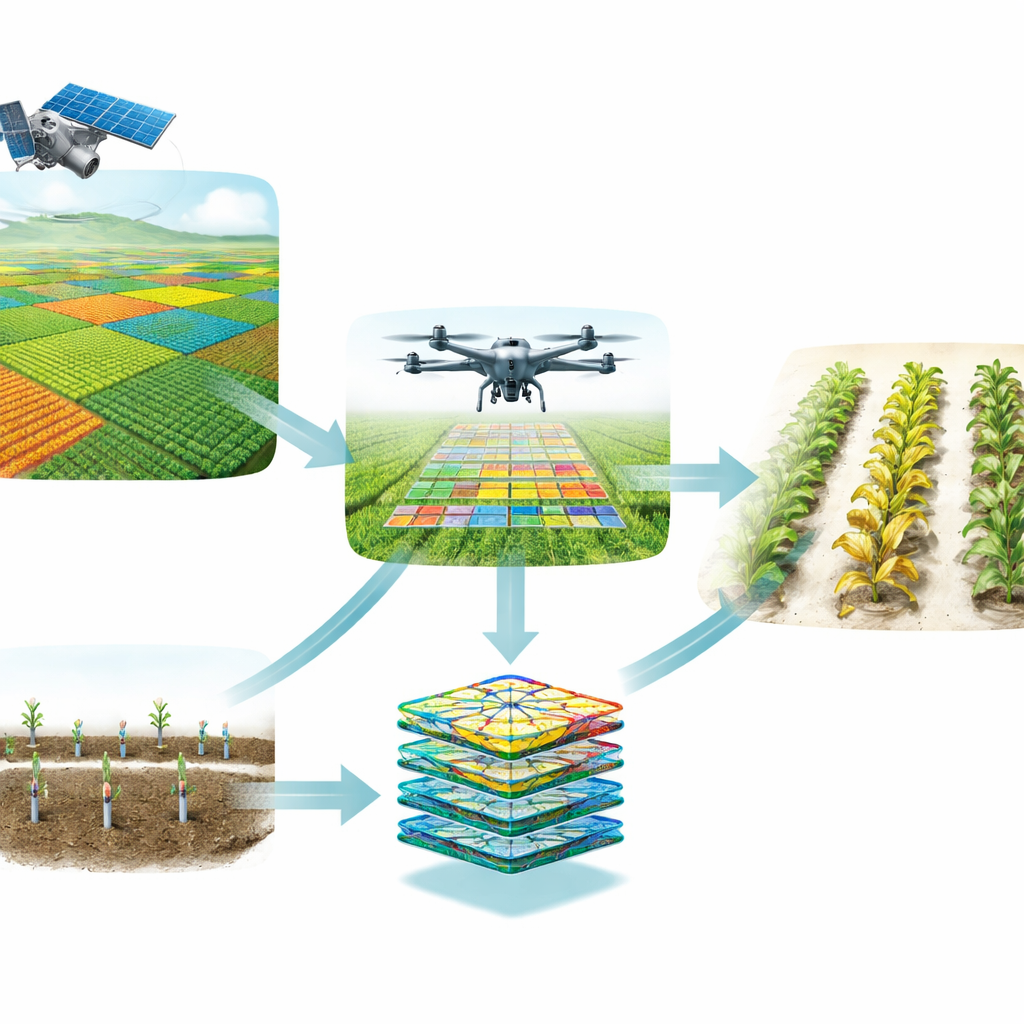

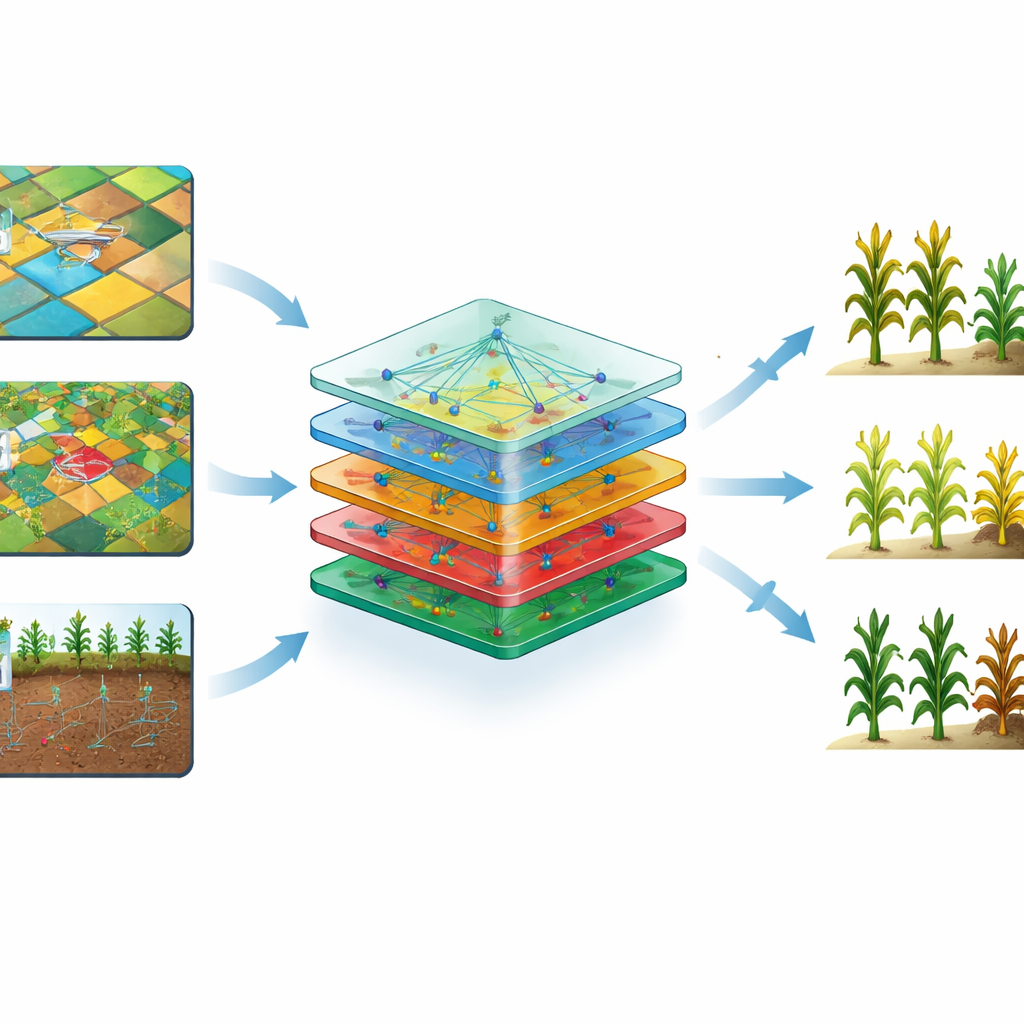

La plupart des outils agricoles high-tech n’examinent qu’un seul aspect du problème : des photos rapprochées des feuilles ou des relevés bruts des sondes de sol. Les auteurs soutiennent que cette vision « en silo » laisse passer des indices importants. Leur cadre fusionne plutôt trois points de vue. Depuis l’espace, les images satellites révèlent des motifs à grande échelle, par exemple les parties d’un champ en stress. Depuis les airs, les drones capturent des vues détaillées en couleurs et en proche infrarouge des plantes individuelles. Sous la surface, des capteurs connectés à Internet suivent l’humidité, les nutriments, la température et d’autres conditions. En alignant ces sources de données dans le temps et l’espace, le système peut relier ce qu’il observe sur les feuilles à ce qui se passe dans le sol et l’environnement alentour.

Comment le docteur numérique des cultures apprend

Le cœur du cadre est un modèle d’apprentissage profond entraîné à reconnaître les types de cultures et les états sanitaires. D’abord, toutes les données entrantes sont nettoyées et standardisées : les scènes satellitaires nuageuses sont normalisées, les images de drone sont redimensionnées et ajustées pour les variations d’éclairage, et les lacunes dans les relevés météorologiques sont comblées. Le système augmente aussi les données d’image en faisant pivoter et retourner les photos pour que le modèle apprenne à ignorer l’angle de prise de vue et se concentrer sur les caractéristiques réelles des plantes. Ensuite, un réseau d’analyse d’images spécialisé, connu sous le nom de réseau de neurones convolutionnel, extrait des motifs comme la texture des feuilles, les changements de couleur et la forme des lésions, tandis que des couches supplémentaires traitent les relevés numériques des capteurs. Un mécanisme d’« attention » aide le modèle à se concentrer sur les régions les plus informatives — comme une tache de feuilles maculées — tout en mettant de côté le sol ou le ciel en arrière-plan.

Des données brutes aux décisions en temps réel

Une fois entraîné, le modèle fonctionne comme un docteur des cultures toujours actif. Les données multi-sources sont diffusées dans le système et fusionnées en une représentation interne unique. Les couches guidées par l’attention comparent ce qu’elles voient à des milliers d’exemples passés, puis le bloc de classification final décide si une plante est saine ou présente des signes de maladie, de dégâts causés par des ravageurs ou de stress. Plutôt que de se contenter d’étiqueter un champ comme bon ou mauvais, le cadre relie son diagnostic visuel aux niveaux actuels d’humidité et de nutriments du sol. Cette combinaison lui permet de hiérarchiser les alertes : par exemple, un schéma de maladie associé à des conditions humides peut déclencher un avertissement de haute urgence, incitant à un traitement ciblé immédiat plutôt qu’à une pulvérisation généralisée sur toute la ferme.

Tester le système sur le terrain

Pour vérifier si cette approche fonctionne au-delà de la théorie, les auteurs ont entraîné et évalué leur cadre sur un jeu de données public d’agriculture de précision qui comprend des images satellites, des photos de drones et des relevés de capteurs au sol pour les principales cultures de base : maïs, pomme de terre et blé. Ils ont divisé les données en ensembles d’entraînement, de validation et de test pour éviter le surapprentissage et ont comparé leur modèle aux techniques standard d’apprentissage profond et d’apprentissage automatique traditionnelles. Leur système multi-modal a systématiquement atteint plus de 90 % de précision pour l’identification du type de culture et de l’état sanitaire, tout en fournissant des prédictions plus rapides que les modèles de référence. De façon importante, lorsque l’une des sources de données était dégradée — par exemple des images de drone affectées par des ombres — le système pouvait maintenir une haute précision en s’appuyant davantage sur les informations du sol et des satellites.

Ce que cela signifie pour les agriculteurs

La conclusion de l’étude est que la combinaison des vues du ciel au sol permet aux ordinateurs d’évaluer la santé des cultures de manière plus fiable que des éclaireurs humains ou des outils à capteur unique. Pour les agriculteurs, cela pourrait signifier des alertes plus précoces en cas d’épidémies, une utilisation plus précise de l’eau et des produits chimiques, des coûts de main-d’œuvre réduits et, en fin de compte, des rendements plus élevés avec un moindre impact environnemental. Bien que le système actuel dépende encore d’une bonne connectivité pour envoyer les données vers le cloud, des versions futures pourraient s’exécuter directement sur des drones ou des dispositifs en périphérie sur le terrain. S’il est déployé à grande échelle, un tel gardien multi‑œil et intelligent de la ferme pourrait devenir une pierre angulaire d’une agriculture véritablement durable et pilotée par les données.

Citation: Pal, A.K., Patro, B.D.K. & Chaube, S. Design and implementation of a deep learning framework for automated crop classification and health diagnosis in precision agriculture. Sci Rep 16, 11436 (2026). https://doi.org/10.1038/s41598-026-42151-5

Mots-clés: agriculture de précision, détection des maladies des cultures, apprentissage profond, imagerie par drone et satellite, agriculture intelligente