Clear Sky Science · fr

Un système optimisé de servo‑commande visuelle qualitative en temps réel basé sur HOG pour fauteuil roulant autonome

Des déplacements plus intelligents pour ceux qui en ont le plus besoin

Pour de nombreuses personnes dépendant d’un fauteuil roulant électrique, manœuvrer dans des couloirs encombrés ou sur des trottoirs irréguliers peut être fatigant, stressant, voire impossible sans aide. Cet article présente une nouvelle façon pour un fauteuil de « voir » son environnement via une petite caméra et de se diriger de manière fluide et sûre en temps réel, même avec du matériel peu coûteux. En repensant soigneusement la manière dont l’information visuelle est traitée et convertie en mouvement, l’auteur montre qu’une navigation intelligente de fauteuil peut fonctionner sur un petit ordinateur à faible consommation tout en conservant le confort et la maîtrise des utilisateurs.

Pourquoi les fauteuils classiques peinent dans la vie réelle

Les fauteuils électriques traditionnels sont généralement pilotés directement par un joystick ou s’appuient sur de simples capteurs de contact pour éviter les obstacles. Ces approches échouent souvent dans des espaces denses et changeants comme les couloirs d’hôpital, les centres commerciaux ou les trottoirs urbains. Les utilisateurs déclarent vouloir avant tout des déplacements fluides, prédictibles et fiables sous différentes conditions d’éclairage, plutôt que de la vitesse brute. Parallèlement, de nombreuses méthodes robotiques avancées qui utilisent des caméras et des calculs complexes exigent des ordinateurs puissants, trop coûteux et encombrants pour un fauteuil quotidien. Cet écart — entre les besoins des utilisateurs et ce que le matériel à faible coût peut offrir — est précisément ce que l’étude vise à combler.

Apprendre au fauteuil à lire des motifs plutôt que des points

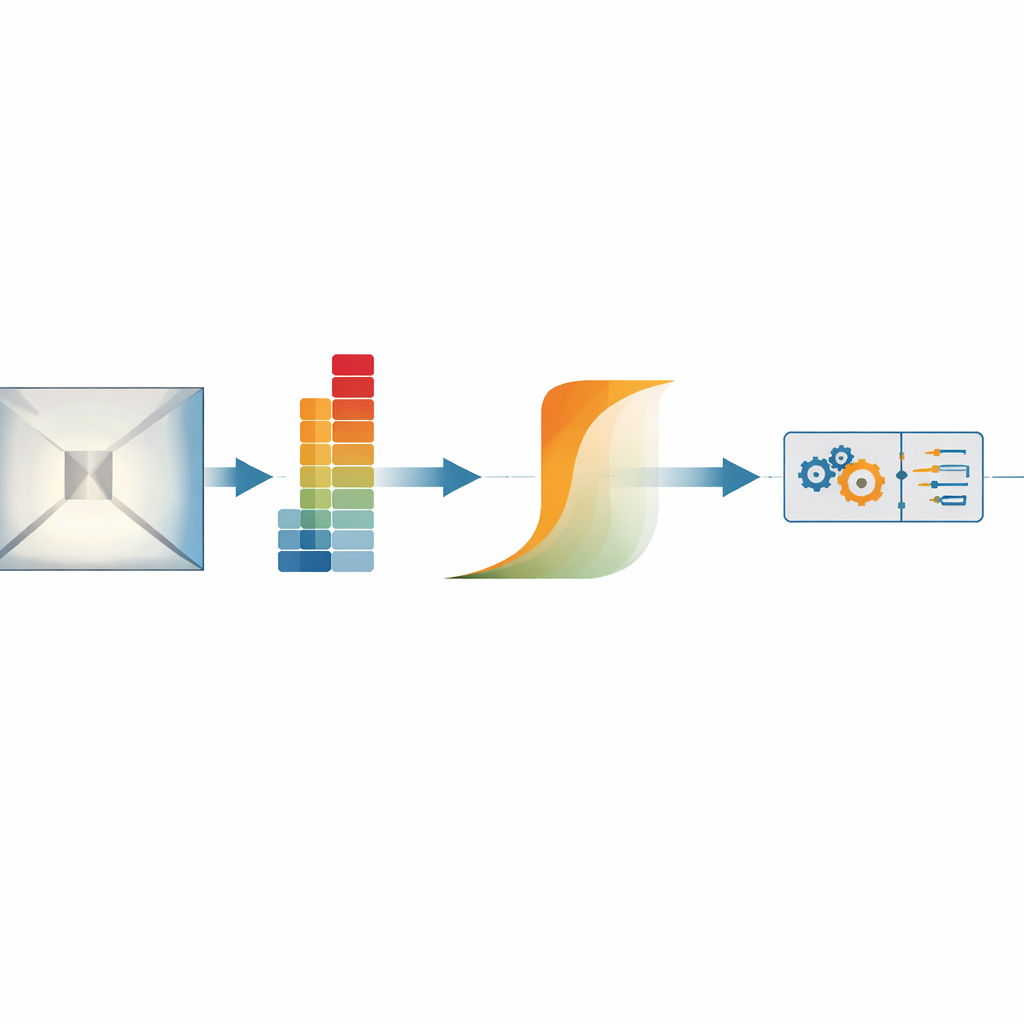

Le système utilise une caméra montée sur le fauteuil pour observer la scène devant lui et la représenter non pas comme des points ou des repères individuels, mais comme des motifs de contours et de lignes connus sous le nom d’histogrammes de gradients. En termes simples, il analyse les variations de luminosité dans l’image et les condense en une empreinte compacte de la scène. Ce type de description de motif tolère naturellement les changements d’éclairage et les occultations partielles, par exemple lorsqu’un passant traverse brièvement le champ de la caméra. Le fauteuil compare le motif actuel à un « motif objectif » correspondant à une vue désirée — comme l’apparence d’un couloir droit ou d’un repère au bout d’un chemin — puis ajuste sa trajectoire pour rapprocher les deux motifs.

Laisser de la marge pour un contrôle plus sûr

Plutôt que d’exiger une correspondance parfaite entre la vue actuelle et la vue cible, la méthode introduit une « zone de confiance » flexible. Si la vue de la caméra est suffisamment proche de l’objectif, le système de commande se relâche délibérément, évitant des corrections nerveuses d’avant en arrière. Cela s’obtient par une fonction d’activation mathématique qui module progressivement la réponse de direction en fonction de l’ampleur de l’erreur visuelle, au lieu d’accentuer automatiquement la correction au moindre écart. En conséquence, le fauteuil peut gérer des occultations partielles et l’incertitude visuelle sans à‑coups brusques, en maintenant des trajectoires fluides pour des tâches comme le suivi d’un couloir ou l’approche d’une séquence de cibles visuelles.

Faire fonctionner la vision avancée sur un petit ordinateur

Un défi majeur est que ces empreintes visuelles riches sont généralement coûteuses à calculer. L’auteur s’y attaque en réécrivant les calculs pour utiliser des opérations efficaces « tout‑en‑une » plutôt que des boucles imbriquées lentes, en réduisant la précision inutile et en organisant soigneusement l’utilisation de la mémoire. Exécuté sur un Raspberry Pi — un ordinateur de la taille d’une carte de crédit souvent employé dans les projets amateurs — le logiciel amélioré augmente la vitesse de traitement d’un niveau inutilisable (environ une image toutes les 12 secondes) à environ cinq images et demie par seconde. Les moteurs du fauteuil reçoivent des commandes à un rythme beaucoup plus élevé et constant, de sorte que les roues se déplacent en douceur pendant que la caméra et le système de vision se mettent à jour en arrière‑plan. Des couches de sécurité supplémentaires, incluant des freins matériels et un « watchdog » qui arrête le fauteuil si les commandes cessent d’arriver, sont intégrées pour un usage d’assistance réel.

De la théorie de laboratoire à l’aide quotidienne

Au travers d’expériences dans des couloirs, sur des trottoirs et de tests vidéo contrôlés, le système dirige de façon répétée le fauteuil d’un objectif visuel à l’autre tout en réduisant progressivement ses corrections de direction à l’approche de chaque cible. L’erreur de correspondance de motifs de la caméra diminue régulièrement, confirmant que le fauteuil s’aligne visuellement sans perdre les caractéristiques importantes en chemin. En termes clairs, l’étude montre qu’un petit ordinateur abordable et une caméra simple suffisent à doter un fauteuil électrique d’un « pilote automatique » guidé par la caméra, respectueux du confort et de la sécurité. Cela ouvre la voie à des aides à la navigation basées sur la caméra plus accessibles pour les personnes à mobilité réduite et prépare le terrain pour des améliorations futures telles qu’une perception 3D enrichie et une évitement d’obstacles encore plus fluide.

Citation: Hafez, A.H.A. An optimized real-time qualitative HOG-based visual servoing system for autonomous wheelchair. Sci Rep 16, 8688 (2026). https://doi.org/10.1038/s41598-026-41566-4

Mots-clés: fauteuil roulant autonome, robotique d'assistance, vision par ordinateur, navigation visuelle, commande en temps réel