Clear Sky Science · fr

Prédiction, syntaxe et ancrage sémantique dans le cerveau et les grands modèles de langage

Comment votre cerveau devine le mot suivant

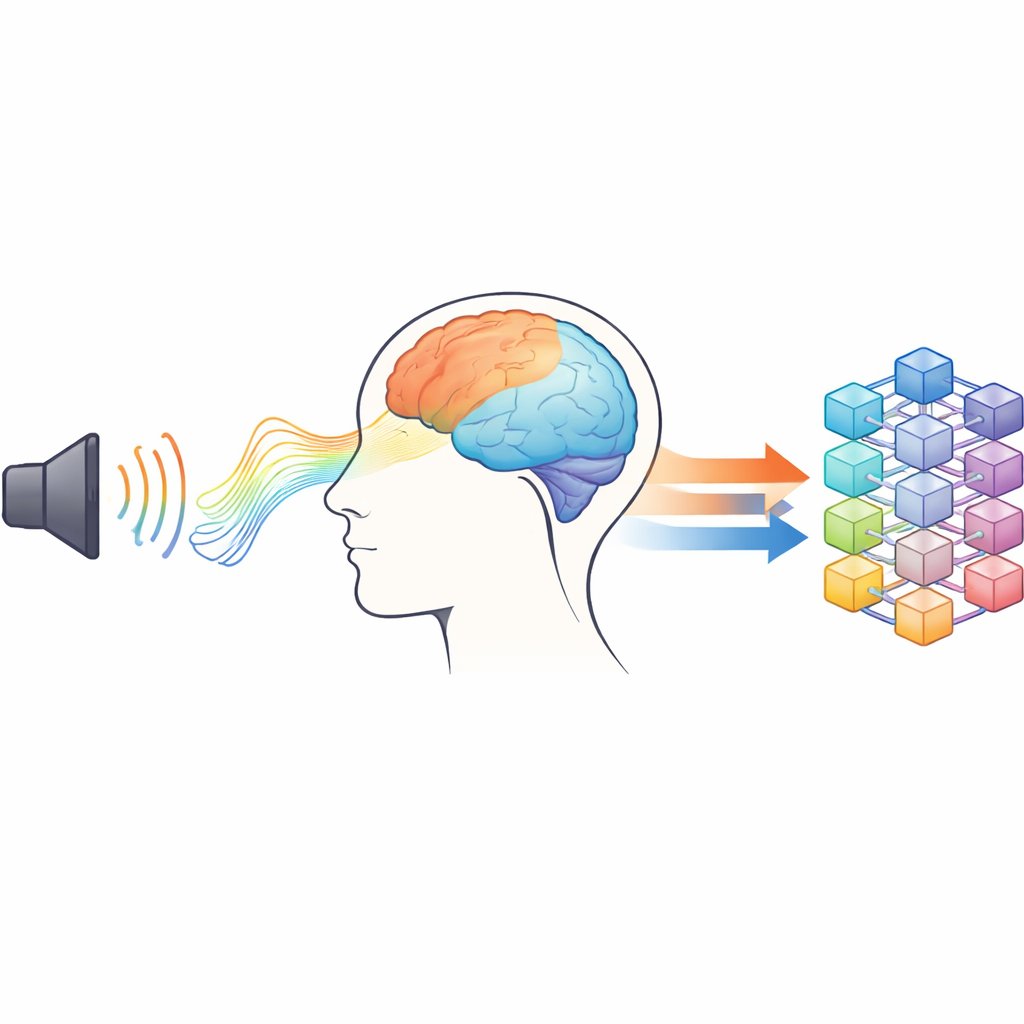

Quand vous écoutez une histoire, il est souvent facile d’en suivre le fil — mais en surface, votre cerveau devine constamment ce qui va venir ensuite. Dans le même temps, les systèmes d’IA modernes comme les grands modèles de langage (GML) prédisent également les mots à venir pour produire un texte fluide. Cette étude réunit ces deux univers en se demandant comment le cerveau humain anticipe les mots en temps réel et comment ces processus se comparent au fonctionnement d’un modèle informatique avancé.

Écouter une histoire au laboratoire

Pour étudier la compréhension du langage naturel, les chercheurs sont allés au-delà de listes artificielles de mots ou de courtes phrases isolées. Vingt-neuf volontaires jeunes ont ainsi écouté environ 50 minutes d’un livre audio de science-fiction en allemand pendant que leur activité cérébrale était enregistrée. Deux techniques complémentaires ont été utilisées simultanément : l’électroencéphalographie (EEG), qui mesure de très faibles variations de tension au niveau du scalp, et la magnétoencéphalographie (MEG), qui détecte les champs magnétiques générés par l’activité cérébrale. Ensemble, ces méthodes permettent de suivre les réponses du cerveau à chaque mot avec une précision de l’ordre de la milliseconde pendant que les personnes suivent une narration continue.

Suivre différents types de mots

Le livre audio a été automatiquement découpé en mots individuels et étiqueté selon le type grammatical : noms (par exemple « planet »), verbes (par exemple « run »), adjectifs (par exemple « dark ») et noms propres. Pour chaque mot de l’histoire, les scientifiques ont extrait une courte fenêtre temporelle des signaux EEG et MEG avant et après la prononciation du mot puis ont moyenné ces segments au sein de chaque catégorie de mots. Cela a révélé des « signatures » électriques et magnétiques fiables pour les différents types de mots, incluant des composants bien connus liés au sens et à la structure des phrases. Fait important, l’équipe a observé que l’activité liée aux noms commençait à se former même avant le début effectif du mot, ce qui suggère que le cerveau était particulièrement prêt à recevoir ce type de mot dans le contexte.

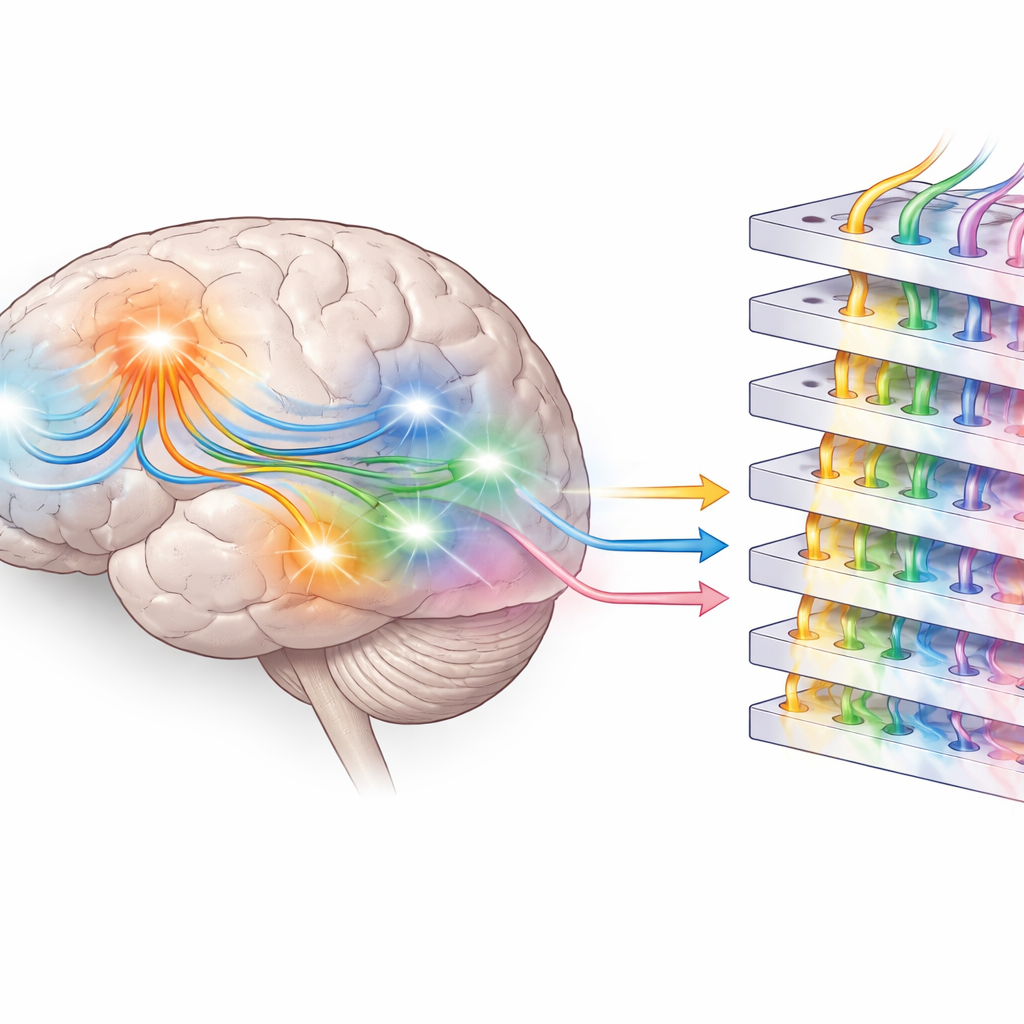

Là où le sens rencontre le mouvement

Pour déterminer où dans le cerveau ces signaux prenaient naissance, les chercheurs ont utilisé des modèles informatiques pour estimer les sources probables des patrons MEG et EEG à l’intérieur de la tête. Les noms n’activaient pas seulement les régions linguistiques classiques des lobes temporaux ; ils mobilisaient aussi des zones compatibles avec des parties du système sensorimoteur, proches de régions impliquées dans le mouvement et la sensation corporelle. Les verbes, en revanche, présentaient un patron différent et plus restreint. Cela soutient l’idée d’un langage « incarné », selon laquelle la compréhension d’un mot — en particulier d’un nom concret — réactive en partie des réseaux liés à la perception et à l’action, ancrant le sens dans des expériences sensorielles passées plutôt que dans des règles abstraites seules.

Comparer le cerveau et les grands modèles de langage

L’équipe s’est ensuite tournée vers Llama 3.2 de Meta pour disposer d’un point de référence computationnel. D’abord, ils ont testé la « prédiction sémantique » en fournissant au modèle le contexte précédent extrait du livre audio et en lui demandant d’évaluer la probabilité du vrai mot suivant. Les noms se sont avérés les plus faciles à prédire pour le modèle, ce qui correspond à leur rôle central dans la construction de l’histoire. Ensuite, les chercheurs ont exploré la « prédiction syntaxique » en examinant les activations internes, ou embeddings, à l’intérieur de Llama. Sans entraînement supplémentaire, les couches internes du modèle regroupaient naturellement les mots selon le type grammatical du mot suivant, et un simple réseau d’analyse pouvait souvent prédire la classe grammaticale à venir. À travers les couches, la structure interne pour les noms propres et les noms devenait plus distincte, faisant écho à la séparation croissante des rôles observée dans les schémas d’activité cérébrale.

Deux formes de préparation aux mots

Dans l’ensemble, les résultats suggèrent que le cerveau se prépare aux éléments du langage à au moins deux niveaux. Dans les régions temporales, l’activité avant l’apparition du mot semble refléter une sorte de préparation grammaticale ou « syntaxique » — une connaissance des positions où certain types de mots ont tendance à apparaître dans une phrase. Dans des régions plus frontales et sensorimotrices, les patrons de préparation semblent porter des attentes « sémantiques » plus riches, liées au sens et à l’expérience, en particulier pour les noms et les noms propres. Les grands modèles de langage, entraînés uniquement à prédire le mot suivant, développent leurs propres structures internes en couches qui reflètent en partie ces distinctions, mais ils manquent d’un ancrage direct dans le monde physique. En combinant enregistrements cérébraux à haute vitesse et analyses d’IA de pointe, ce travail aide à clarifier comment les humains anticipent les mots lors d’une écoute courante et jusqu’où les machines actuelles en sont pour reproduire cette caractéristique centrale de la compréhension du langage humain.

Citation: Kölbl, N., Rampp, S., Kaltenhäuser, M. et al. Prediction, syntax and semantic grounding in the brain and large language models. Sci Rep 16, 8728 (2026). https://doi.org/10.1038/s41598-026-41532-0

Mots-clés: prédiction linguistique, cerveau et IA, grands modèles de langage, ancrage sémantique, EEG MEG langage