Clear Sky Science · fr

Cadre de confidentialité stochastique intégré à Poisson pour l’apprentissage fédéré avec chiffrement homomorphe sécurisé en IA médicale

Protéger les secrets médicaux tout en formant des machines

Les hôpitaux collectent d’énormes quantités d’images radiographiques susceptibles d’aider les médecins à détecter des maladies comme la COVID‑19 plus tôt et avec plus de précision. Mais ces images sont aussi profondément personnelles, et des règles strictes de confidentialité rendent difficile la centralisation des données pour entraîner des outils d’intelligence artificielle (IA) puissants. Cette étude propose une méthode permettant aux hôpitaux de coopérer sur un système partagé de diagnostic par radiographie sans jamais transmettre leurs images brutes, visant à protéger les données des patients tout en obtenant une précision de premier plan.

Pourquoi le partage de données médicales est si compliqué

L’IA moderne prospère grâce à de grands jeux de données variés, pourtant les hôpitaux conservent généralement les images localement et sont réticents — ou légalement incapables — de les envoyer à un serveur central. Les approches traditionnelles qui copient toutes les données dans une grande base unique exposent au risque de fuites et de cyberattaques, minant la confiance du public et violant les réglementations. Même les méthodes plus récentes, où les hôpitaux entraînent conjointement un modèle dans un dispositif appelé « apprentissage fédéré », ne sont pas totalement sûres : des attaquants ingénieux peuvent parfois reconstruire des images de patients à partir des mises à jour du modèle. Par ailleurs, les données médicales sont souvent inégales et désordonnées, certains établissements ayant beaucoup plus de cas d’une maladie donnée que d’autres, ce qui peut déstabiliser l’entraînement et réduire la fiabilité.

Un réseau coopératif qui ne partage jamais les radiographies brutes

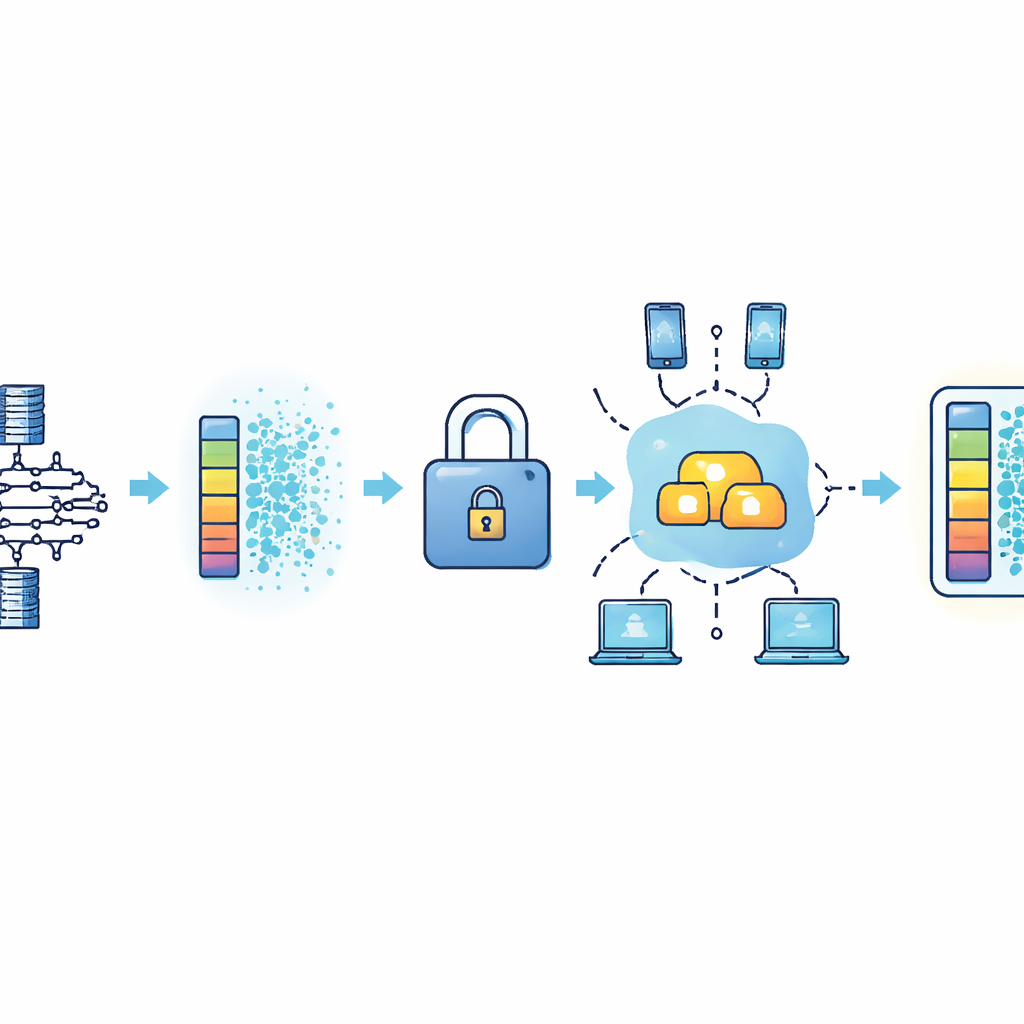

Les auteurs conçoivent un cadre d’apprentissage fédéré centré sur un modèle performant de reconnaissance d’images connu sous le nom de ResNet‑50 pour distinguer la COVID‑19 des radiographies thoraciques normales. Chaque hôpital entraîne sa propre copie de ce modèle sur ses images locales, en maintenant toutes les radiographies sur place. Au lieu d’envoyer des images, les hôpitaux transmettent seulement des mises à jour numériques décrivant comment leur modèle local devrait évoluer. Un serveur central agrège ces mises à jour par moyenne pour constituer un modèle global amélioré, puis renvoie le modèle affiné à chaque hôpital. La répétition de ce cycle permet au modèle partagé de bénéficier de l’expérience combinée de tous les participants sans exposer les clichés individuels.

Ajouter du « bruit » numérique et des boîtes-fortes pour renforcer la confidentialité

Pour empêcher les attaquants de reconstruire les images des patients à partir des mises à jour du modèle, le cadre superpose deux techniques de confidentialité à l’apprentissage fédéré. D’abord, chaque hôpital ajoute un bruit aléatoire soigneusement calibré à ses mises à jour de modèle, un peu comme ajouter de la fonte à un signal radio pour rendre les voix individuelles plus difficiles à isoler tout en laissant passer le message global. Ensuite, avant que les mises à jour ne circulent sur le réseau, elles sont chiffrées à l’aide d’une méthode qui permet au serveur de les additionner tout en restant verrouillées — similaire à sommer des valeurs à l’intérieur d’enveloppes scellées. Seul un détenteur de clé de confiance peut déverrouiller le résultat combiné, et le serveur central ne voit jamais à l’état clair la mise à jour d’un hôpital. Ensemble, ces étapes visent à contrecarrer les tentatives de rétroingénierie des données patients tout en préservant l’utilité du modèle partagé.

Mettre le système à l’épreuve

L’équipe évalue leur cadre sur un ensemble équilibré d’images radiographiques thoraciques COVID‑19 et normales, en simulant plusieurs hôpitaux comme sites d’entraînement distincts. Ils comparent trois configurations : l’entraînement centralisé classique avec toutes les données regroupées, l’apprentissage fédéré standard sans protections supplémentaires, et leur approche renforcée en confidentialité. Malgré le bruit et le chiffrement ajoutés, le système protégé atteint des scores remarquablement élevés — environ 99,6 % de précision, avec des valeurs de précision, rappel et F1 également très fortes — égalant ou surpassant à la fois la version centralisée et la version fédérée non protégée. Les mesures des tours de communication, de la perte d’entraînement et du temps de calcul montrent que la précision s’améliore régulièrement à mesure que les sites collaborent, tandis que le coût temporel supplémentaire dû au chiffrement reste modéré. Des expériences d’ablation, où des éléments du système sont activés ou désactivés, confirment que les niveaux de bruit choisis et la stratégie de chiffrement plus compression offrent une forte confidentialité avec seulement de faibles compromis de performance.

Ce que cela signifie pour les soins futurs

Pour le grand public, le message principal est que ce travail démontre une recette pratique pour entraîner l’IA à partir des radiographies de nombreux hôpitaux sans jamais exposer les images brutes ni affaiblir les lois sur la vie privée. En combinant un modèle d’images performant avec du « bruit » numérique et une agrégation chiffrée, le cadre montre que les établissements peuvent construire conjointement des outils de diagnostic précis tout en gardant les dossiers patients sur place et hors de portée des regards indiscrets. Bien que testé sur un jeu de données relativement petit et centré sur les radiographies COVID‑19, les mêmes idées pourraient s’étendre à d’autres maladies, types d’imagerie, et même à d’autres domaines sensibles comme la finance. En bref, l’étude pointe vers un avenir où une IA puissante et une forte confidentialité médicale peuvent se renforcer mutuellement plutôt que de s’opposer.

Citation: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

Mots-clés: apprentissage fédéré, imagerie médicale, confidentialité des données, chiffrement homomorphe, diagnostic par radiographie