Clear Sky Science · fr

Fonction génératrice d'information innovante pour les systèmes à durée de vie consécutive en recherche en santé

Pourquoi cela compte pour les systèmes du monde réel

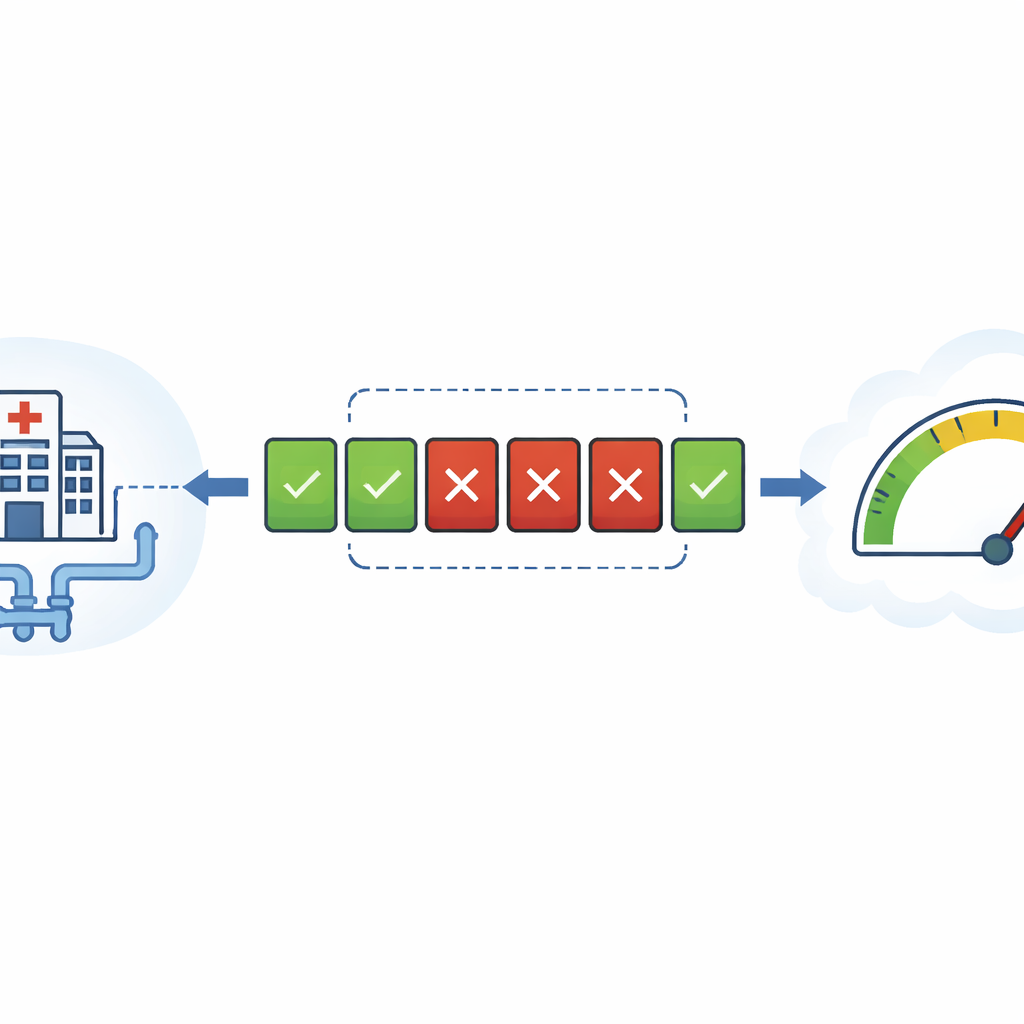

La société moderne repose sur des systèmes qui doivent continuer de fonctionner même lorsque certaines de leurs parties tombent en panne : lignes de surveillance hospitalière, oléoducs, câbles de données ou liaisons électriques. Les ingénieurs conçoivent beaucoup d’entre eux comme des « systèmes consécutifs », où l’intégralité du réseau est considérée comme en panne dès qu’une séquence de composants voisins cesse de fonctionner. Cet article développe de nouveaux outils mathématiques pour mesurer l’incertitude ou la fragilité de tels systèmes, et montre comment ces outils peuvent être transformés en tests statistiques pratiques, y compris un exemple réel portant sur des données de tumeurs malignes provenant d’hôpitaux saoudiens.

Comment l’incertitude est mesurée par l’information

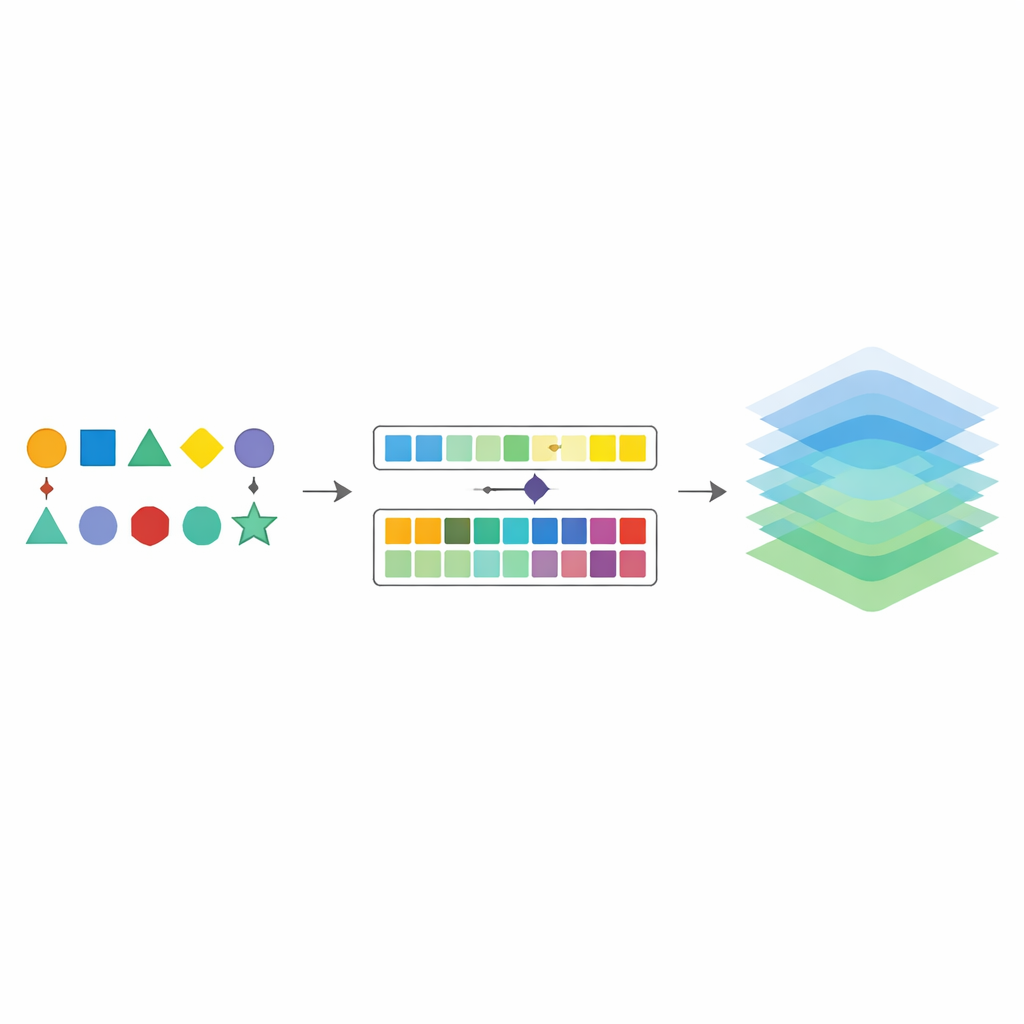

Au cœur du travail se trouve l’idée d’entropie, un concept de la théorie de l’information qui quantifie l’incertitude. L’entropie de Shannon classique mesure à quel point une quantité unique est imprévisible. En s’appuyant sur cela, les chercheurs ont introduit des fonctions génératrices d’information, qui forment une famille flexible de mesures contrôlées par un paramètre d’ajustement. Pour certains choix de ce paramètre, cette famille retrouve des quantités bien connues : le négatif de l’entropie de Shannon et une mesure apparentée de type énergie appelée extropie. L’article étudie le comportement de cette riche famille non seulement pour des composants isolés, mais pour des systèmes ingénierés entiers dont la durée de vie dépend de l’interaction de nombreuses pièces.

Des pièces isolées aux chaînes de composants liées

De nombreux agencements pratiques peuvent être décrits comme des systèmes « consécutifs l-sur-m » : imaginez une ligne de m composants identiques qui continue de fonctionner tant que l’on ne rencontre jamais l composants défaillants de suite. Cette structure couvre des extrêmes classiques comme les systèmes purement en série ou en parallèle, et se retrouve dans des technologies aussi variées que les systèmes sous vide, les oléoducs, les relais micro-ondes et les contrôles de stationnement. L’article établit de nouvelles formules qui expriment le contenu informationnel de la durée de vie globale du système directement en fonction du comportement de ses composants. Un point clé est que, en transformant astucieusement les durées de vie des composants en données équivalentes se comportant comme des échantillons d’une distribution uniforme simple, la mesure complexe au niveau du système peut s’écrire comme une intégrale plus maniable sur l’intervalle unité.

Comparer les conceptions et borner le risque

Les formules exactes pour les mesures d’information au niveau du système peuvent rapidement devenir intraitables lorsqu’il y a de nombreux composants ou lorsque leurs durées de vie suivent des lois compliquées. Pour faire face à cela, l’auteur développe des bornes supérieures et inférieures serrées qui « encadrent » la vraie valeur. Ces bornes dépendent de résumés simples du comportement des composants, tels que l’endroit où la densité est maximale (sa mode) ou le degré de dispersion des durées de vie. L’article élabore également des règles de comparaison stochastique : sous des conditions larges, si une conception de composant est plus variable ou plus sujette à la défaillance qu’une autre, alors le système consécutif correspondant aura une mesure d’information plus élevée, signalant une incertitude globale plus grande. Ces résultats permettent aux ingénieurs et aux statisticiens de comparer des conceptions alternatives sans résoudre chaque détail mathématique.

Explorer le mécanisme et caractériser les distributions

La mesure d’information pour un système consécutif s’avère suffisamment puissante pour « caractériser » la distribution de durée de vie sous-jacente. En termes simples, si deux modèles de composant différents produisent un comportement informationnel identique pour chaque configuration admissible de système consécutif, alors ils doivent en fait être des versions de la même distribution, ne différant que par une translation ou une mise à l’échelle. L’article démontre plusieurs théorèmes de caractérisation de ce type, y compris un résultat remarquable pour la loi uniforme : la façon dont l’information s’accumule dans certains systèmes consécutifs identifie de manière unique si les données sont réellement uniformes ou non. Cela pose les fondations théoriques de nouveaux tests d’adéquation.

Transformer la théorie en estimateurs et tests

Pour rendre ces idées utilisables sur des données réelles, l’auteur propose deux estimateurs non paramétriques pour la mesure d’information au niveau du système. Ces estimateurs opèrent directement sur les valeurs d’échantillon ordonnées, en utilisant les différences entre points de données voisins à l’intérieur d’une fenêtre glissante pour approcher la distribution sous-jacente. De vastes expériences numériques montrent que les deux estimateurs deviennent plus précis avec des tailles d’échantillon plus grandes, mais le second — légèrement plus raffiné — présente un biais et une erreur globalement plus faibles. Sur cette base, l’article propose un nouveau test pour vérifier si des données sont uniformes, question fréquente en simulation, contrôle qualité et modélisation en sciences sociales. Comparé à des tests classiques comme Kolmogorov–Smirnov, Anderson–Darling et Cramér–von Mises, le nouveau test montre une puissance compétitive ou supérieure sous de nombreuses alternatives, en particulier lorsque la distribution vraie est plus dispersée que l’uniforme.

Données de santé réelles et impact pratique

La méthodologie est appliquée à des données de tumeurs malignes provenant d’Arabie saoudite, où le modèle exponentiel est d’abord vérifié comme un ajustement raisonnable. En utilisant les estimateurs proposés, l’auteur évalue la structure d’information de systèmes consécutifs hypothétiques construits sur ce modèle, puis applique le nouveau test d’uniformité à des données de tumeurs transformées provenant d’une région et d’un groupe de patients différents. Les résultats soutiennent les affirmations théoriques : l’estimateur raffiné est plus stable, et le test se comporte comme prévu. Pour un lecteur non spécialiste, le message principal est que nous disposons désormais d’un regard « basé sur l’information » plus nuancé pour juger de la robustesse des systèmes à composants liés, et d’un moyen pratique d’utiliser ce regard dans l’analyse des données. Ces outils peuvent guider de meilleurs choix de conception et des décisions statistiques plus fiables, dans des domaines allant des infrastructures d’ingénierie à la recherche en santé.

Citation: Mohamed, M.S. Innovative generating-information function for consecutive lifetime systems in health research. Sci Rep 16, 9097 (2026). https://doi.org/10.1038/s41598-026-41369-7

Mots-clés: fiabilité des systèmes, théorie de l'information, entropie, tests d'uniformité, analyse des données de santé