Clear Sky Science · fr

Ouverture de la boîte noire : IA explicable pour l’analyse automatisée de la bioturbation dans les carottes et les affleurements

Déceler des indices cachés dans la boue ancienne

Lorsque des animaux creusent la boue molle du fond marin, ils laissent derrière eux un réseau de galeries qui peut se conserver pendant des millions d’années. Ces motifs subtils, appelés bioturbation, aident les géologues à reconstituer les environnements passés et même à localiser des réservoirs de pétrole et de gaz. Mais repérer et classer ces traces à l’œil nu est un travail lent et subjectif. Cette étude montre comment une nouvelle génération d’intelligences artificielles « explicables » peut non seulement automatiser cette tâche, mais aussi révéler exactement ce que l’ordinateur observe, transformant une boîte noire en une boîte transparente.

Pourquoi les galeries dans la roche comptent

Beaucoup de décisions géologiques commencent encore par l’observation : des falaises, des carottes de forage et des lames minces. La manière dont les couches sont disposées, leur état de conservation ou de perturbation, et l’endroit où les galeries les traversent indiquent la profondeur de l’eau, l’énergie des milieux, le taux d’oxygène et les organismes qui y vivaient. Les géologues résument souvent ce dérangement par une intensité de bioturbation, allant de couches intactes à sédiments entièrement remaniés. Ces niveaux sont essentiels pour reconstituer les anciens littoraux et pour évaluer la facilité de circulation des fluides dans des grès enfouis susceptibles de former des réservoirs. Pourtant, même des experts peuvent diverger, surtout dans les cas limites où la bioturbation est modérée plutôt que clairement faible ou forte.

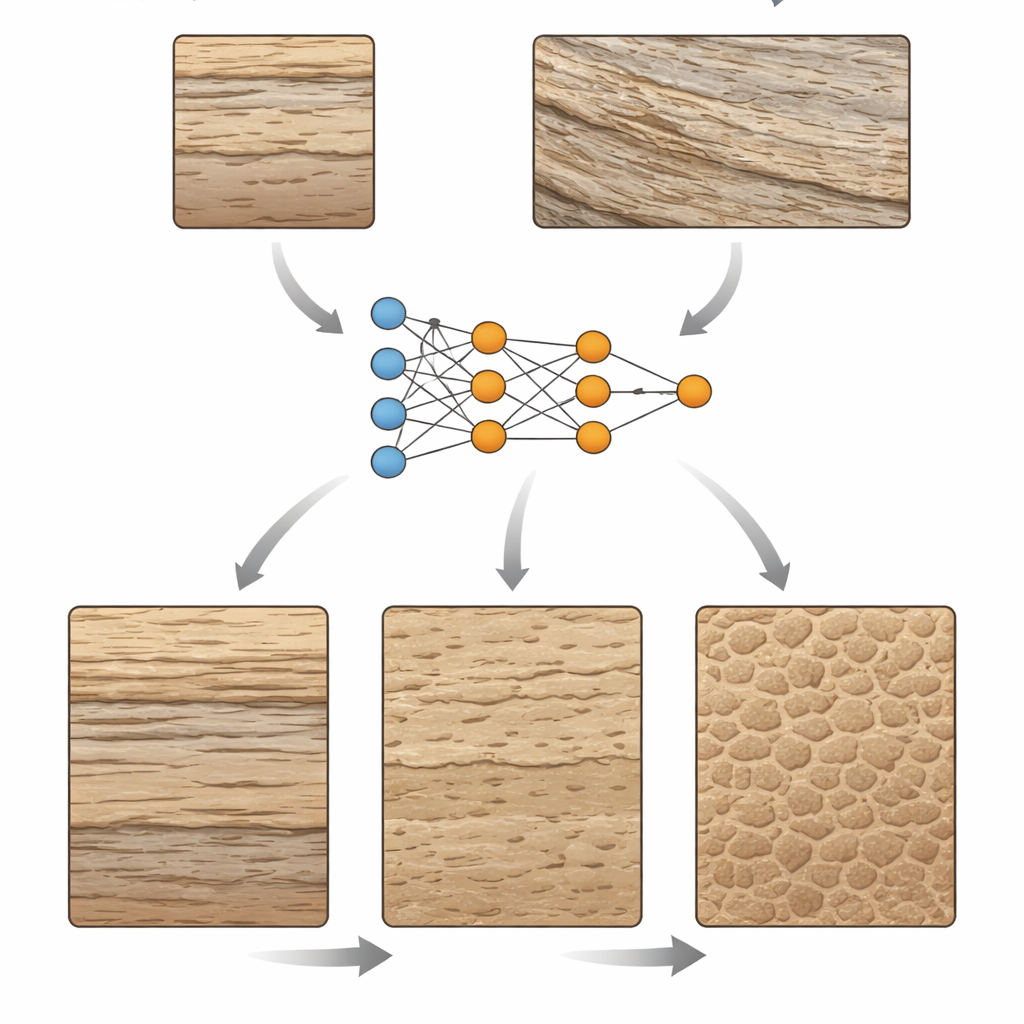

Apprendre à un ordinateur à lire des photos de roche

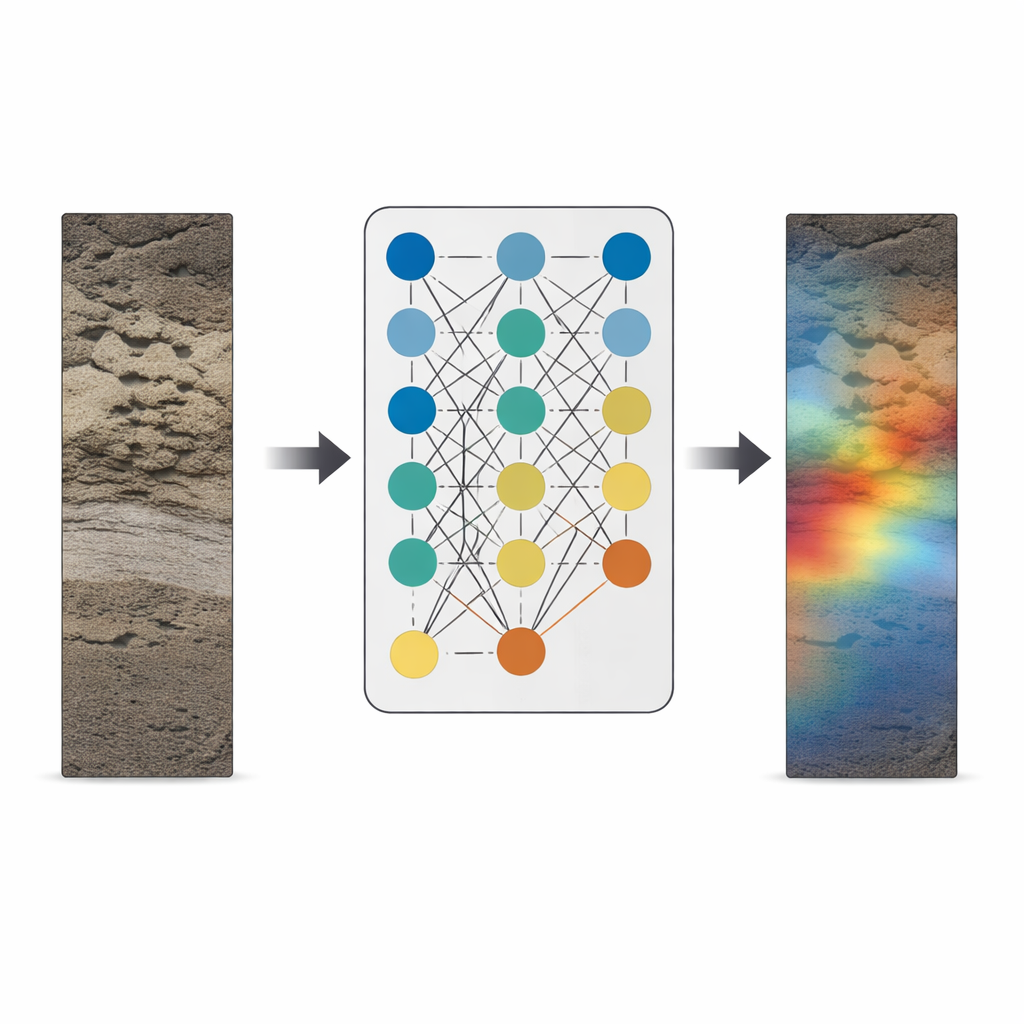

Les auteurs s’appuient sur un modèle d’apprentissage profond antérieur entraîné à classer des photos de carottes et d’affleurements de grès en trois niveaux larges de bioturbation : non remanié, modérément remanié et fortement remanié. Le modèle avait déjà montré une grande précision, classant correctement la plupart des 262 images de test. Dans cette étude, l’accent passe de « Quelle est sa performance ? » à « Que voit-il réellement ? ». Pour répondre, l’équipe utilise des outils d’IA explicable qui produisent des cartes de chaleur sur chaque image, mettant en évidence les régions qui ont le plus influencé le choix du modèle. Les zones les plus rouges pèsent davantage dans la décision ; les teintes plus froides comptent moins. Cette approche permet aux géologues de comparer l’attention visuelle de la machine à celle d’un ichnologue expérimenté — un spécialiste des traces fossiles.

Comment la boîte noire s’éclaire

La méthode, connue sous le nom de Grad-CAM, exploite les couches finales du réseau neuronal, où l’image est résumée en grands patchs de caractéristiques. Lorsque le modèle décide d’une classe, Grad-CAM mesure la sensibilité de cette décision à chaque patch, puis projette le résultat sur la photo originale sous la forme d’un masque coloré. Pour les roches non bioturbées, les cartes de chaleur ont tendance à s’illuminer sur des patchs de stratification bien conservée ou des unités massives et intactes, mettant parfois aussi en évidence des fractures naturelles ou des galets épars qui se détachent sur un fond uniforme. Dans les images modérément bioturbées, les cartes ciblent généralement des galeries individuelles ou des zones où la stratification est partiellement perturbée, correspondant étroitement à ce qu’un expert entourerait sur une page. Dans les échantillons fortement remaniés, où presque toute structure originelle est effacée, les cartes montrent un motif ponctué réparti sur l’image, reflétant le brassage généralisé du fond marin ancien.

Ce que le modèle se trompe — et pourquoi

Parce que les explications sont visuelles, les chercheurs peuvent examiner les erreurs du modèle au lieu de simplement les enregistrer comme des fautes. Certaines images non remaniées ont été interprétées à tort comme bioturbées lorsque certains clastes ou textures ressemblaient par hasard à des galeries. Dans d’autres cas, de très petites ou très discrètes traces fossiles ont été négligées, surtout lorsqu’elles n’occupaient qu’un petit coin de la photo. Des structures très larges ont aussi posé problème : si une seule large galerie remplissait la majeure partie du cadre et que ses détails internes étaient atténués, le modèle l’a traitée comme une masse sans structure plutôt que comme une trace. Fait important, les cartes de chaleur montrent que le système ignore généralement le bruit non géologique tel que les marques de stylo, les coupes de scie et les ombres, ce qui démontre qu’il a appris à se concentrer sur les textures rocheuses plutôt que sur le bruit photographique. Les auteurs suggèrent que des images d’entraînement plus variées et de meilleure qualité ainsi qu’une meilleure couverture des niveaux d’intensité limites amélioreraient encore les performances.

D’un outil pour experts à un support pédagogique

En ouvrant le fonctionnement interne du modèle à l’inspection, l’IA explicable contribue à réduire le fossé de confiance entre les géoscientifiques et les algorithmes. L’étude montre que l’attention du réseau s’aligne généralement sur le jugement des experts, se concentrant sur les mêmes galeries et zones perturbées qu’un ichnologue formé mettrait en évidence. Cette transparence facilite l’adoption de l’analyse automatisée de la bioturbation en recherche comme en industrie, où le criblage rapide et cohérent de grandes bibliothèques d’images peut faire gagner du temps et réduire les biais humains. Parallèlement, les cartes de chaleur colorées servent d’outil pédagogique, guidant le regard des étudiants vers les indices texturaux subtils qui distinguent la roche non remaniée, modérément remaniée et intensément remaniée. En rendant visibles des décisions de modèle jusque-là invisibles, ce travail ouvre la voie à un avenir où l’IA ne remplace pas l’intuition géologique, mais l’affûte et l’amplifie.

Citation: Ayranci, K., Yildirim, I.E., Yildirim, E.U. et al. Opening the black box: explainable AI for automated bioturbation analysis in cores and outcrops. Sci Rep 16, 9725 (2026). https://doi.org/10.1038/s41598-026-40747-5

Mots-clés: IA explicable, bioturbation, analyse d’images géologiques, apprentissage profond, carottes sédimentaires