Clear Sky Science · fr

Évaluation des modèles linguistiques d’IA pour répondre aux questions liées à la grossesse évaluée par des spécialistes en obstétrique

Pourquoi cela compte pour les futurs parents

La grossesse est une période remplie d’interrogations, et beaucoup de personnes consultent aujourd’hui des outils en ligne et des chatbots pour obtenir des réponses rapides. Cette étude posait une question simple mais importante : pour les préoccupations courantes pendant la grossesse, dans quelle mesure les chatbots d’intelligence artificielle (IA) populaires d’aujourd’hui fournissent-ils des informations claires, exactes et rassurantes que des médecins jugeraient fiables ?

Comparaison de trois « moteurs de réponse » numériques

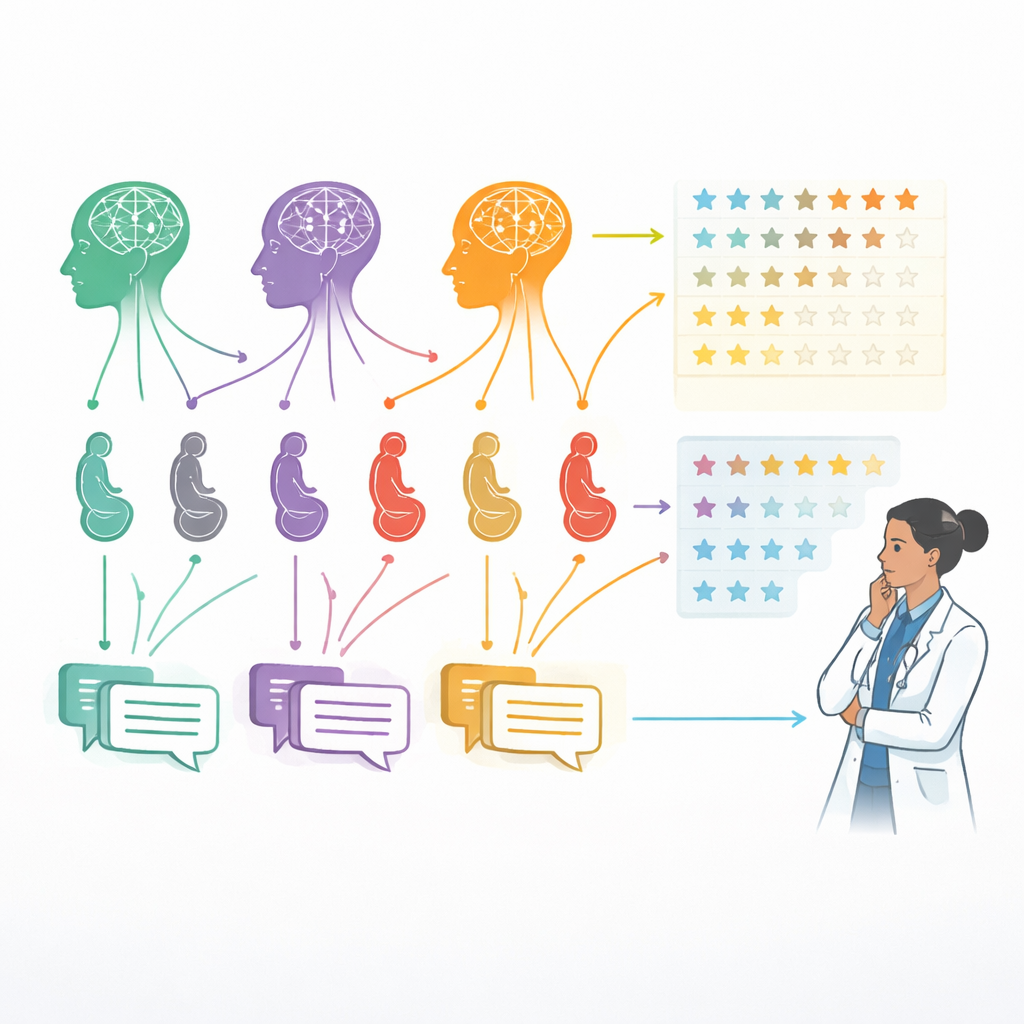

Des chercheurs en Turquie ont entrepris de comparer trois modèles linguistiques d’IA bien connus — une version antérieure de ChatGPT (3.5), une version plus récente (4.0) et Gemini de Google. Ils se sont concentrés sur dix questions quotidiennes que les personnes enceintes posent fréquemment, comme quels aliments éviter, si l’exercice et les rapports sexuels sont sans danger, ce que peut signifier un saignement précoce, comment interpréter les mouvements fœtaux et quels signes d’alerte nécessitent des soins urgents. Chaque question a été saisie dans les trois systèmes en utilisant les mêmes instructions simples, avec des réglages limitant l’aléa afin que les réponses soient cohérentes plutôt que bavardes ou créatives.

Chaque modèle a produit une réponse par question, en turc, sans relance ni édition. Les réponses ont ensuite été débarrassées de tout indice pouvant révéler quel système les avait rédigées et mélangées dans un ordre aléatoire. De cette façon, les évaluateurs humains — des spécialistes en obstétrique et gynécologie — jugeaient uniquement ce qui figurait sur la page, et non la marque ou le style d’écriture qu’ils croyaient reconnaître.

Comment les médecins ont jugé les réponses

Soixante-quinze spécialistes en obstétrique, allant de médecins en début de carrière à des cliniciens très expérimentés, ont noté les 30 réponses anonymisées. Pour chaque réponse, ils ont utilisé une échelle en cinq points pour évaluer quatre qualités : exactitude (correspond-elle aux connaissances médicales et aux recommandations actuelles ?), fiabilité (le message est-il cohérent en interne et exempt de conseils dangereux ?), convivialité pour le patient (le ton est-il adapté et rassurant pour des non-spécialistes ?) et compréhensibilité (le langage est-il clair, bien structuré et facile à suivre ?). Au total, les experts ont fourni 9 000 évaluations individuelles — un jeu de données important qui a permis aux chercheurs de détecter des différences significatives entre les trois outils d’IA.

L’équipe a ensuite utilisé des méthodes statistiques adaptées aux échelles de notation pour comparer les modèles. Ils ont aussi vérifié la cohérence des évaluations entre médecins et exploré si les cliniciens plus expérimentés notaient différemment leurs collègues plus jeunes. L’objectif n’était pas de construire un chatbot opérationnel, mais de réaliser un instantané rigoureux du comportement de ces systèmes dans des conditions contrôlées lorsqu’ils répondent à des questions réalistes sur la grossesse.

Quel chatbot s’en est le mieux sorti ?

Dans l’ensemble, la nouvelle version ChatGPT-4.0 arrive en tête. Les médecins ont jugé ses réponses comme les plus exactes et les plus adaptées aux patients ; elle a également obtenu les meilleures notes en fiabilité. Gemini se situe généralement au milieu : ses réponses étaient souvent claires et faciles à lire, et en termes de compréhensibilité brute, il était similaire à ChatGPT-4.0, mais il avait tendance à être un peu moins détaillé et précis. ChatGPT-3.5, le modèle plus ancien, a systématiquement reçu les notes les plus basses, fournissant souvent des explications plus courtes ou moins complètes. Fait intéressant, en ce qui concerne la clarté et la structure de base, les trois modèles se sont montrés relativement comparables, ce qui suggère que rendre un texte lisible peut être plus simple que d’assurer que chaque détail médical soit correct et bien nuancé.

Les notations des médecins ont été très cohérentes entre elles, indiquant que les résultats n’étaient pas dus à quelques opinions aberrantes. On a observé une tendance modeste selon laquelle les cliniciens plus expérimentés donnaient globalement des scores de fiabilité légèrement plus élevés, mais leurs avis ne différaient pas beaucoup concernant la convivialité ou la facilité de compréhension des réponses.

Ce que cela signifie pour l’utilisation dans la vie réelle

Pour un non-spécialiste, la conclusion est que les outils d’IA modernes — en particulier ChatGPT-4.0 — peuvent déjà fournir des informations sur la grossesse que de nombreux spécialistes en obstétrique considèrent comme raisonnablement exactes, sûres et faciles à lire. Cela dit, l’étude souligne aussi une limite importante : même le système le mieux classé n’est pas un médecin. Les chercheurs n’ont pas comparé les réponses des chatbots aux « références » officielles issues des lignes directrices, ni testé la façon dont les patients interprètent ou mettent en pratique ces conseils. Comme le travail a été réalisé entièrement en turc, les performances dans d’autres langues et cultures peuvent être différentes.

En termes simples, ces chatbots d’IA peuvent être des compagnons utiles pour s’informer sur la grossesse, notamment quand une consultation est éloignée ou que le temps passé avec un professionnel est limité. Ils peuvent aider, mais ne doivent pas remplacer les échanges avec les professionnels de santé. Les auteurs insistent sur le fait qu’une supervision experte reste essentielle pour détecter les erreurs, éviter des assurances trompeuses et s’assurer que les situations nuancées ou à haut risque reçoivent les soins personnels et en personne qu’elles nécessitent.

Citation: Keyif, B., Yurtçu, E., Başbuğ, A. et al. Evaluation of AI language models in answering pregnancy-related questions assessed by obstetrics specialists. Sci Rep 16, 9322 (2026). https://doi.org/10.1038/s41598-026-40609-0

Mots-clés: éducation sur la grossesse, chatbots IA, conseils de santé en ligne, obstétrique, qualité de l’information aux patients