Clear Sky Science · fr

Aborder l’équilibre entre équité et performance dans la prédiction du grade des gliomes à l’aide de techniques d’atténuation des biais

Pourquoi traiter les tumeurs de manière équitable est important

Quand les médecins s’appuient sur l’intelligence artificielle pour aider au diagnostic des tumeurs cérébrales, on pourrait supposer que l’ordinateur est neutre. Mais si les données utilisées pour entraîner ces outils reflètent des inégalités sanitaires existantes, le logiciel peut traiter certains patients de façon moins équitable que d’autres à leur insu. Cette étude examine comment des systèmes d’apprentissage automatique qui prédisent la gravité des gliomes — un type courant de tumeur cérébrale chez l’adulte — peuvent involontairement favoriser certains groupes raciaux ou de genre, et teste des moyens pratiques de rendre ces prédictions plus équitables sans sacrifier trop de précision.

Tumeurs cérébrales et aide computationnelle

Les gliomes sont des tumeurs cérébrales qui vont de formes plus lentes et traitables à des cancers très agressifs avec un mauvais pronostic. Bien évaluer le grade de ces tumeurs est crucial, car cela oriente la chirurgie, la radiothérapie et le traitement médicamenteux. Les chercheurs ont utilisé un jeu de données public comprenant 839 adultes présentant soit un gliome de bas grade, soit un glioblastome agressif. Pour chaque patient, ils disposaient de l’âge, du sexe, de la race et de 20 marqueurs génétiques courants de la tumeur. Ils ont entraîné trois modèles prédictifs standard — régression logistique, forêts aléatoires et gradient boosting — pour distinguer les deux grades tumoraux à partir de ces caractéristiques, puis ont évalué à la fois la précision globale des modèles et la manière dont ils traitaient différents groupes de patients.

À la recherche d’un déséquilibre caché

Pour étudier l’équité, l’équipe s’est concentrée sur deux traits « protégés » : la race (blanc vs non-blanc) et le genre (homme vs femme). Le jeu de données était lui-même biaisé — plus de 90 % des patients étaient blancs, et il y avait sensiblement plus d’hommes que de femmes. Les auteurs ont utilisé des mesures d’équité au niveau des groupes qui comparent la fréquence à laquelle différents groupes reçoivent une prédiction correcte de « haut grade » et la fréquence des erreurs pour chaque groupe. Les trois modèles étaient globalement assez précis, la régression logistique étant la meilleure. Mais derrière ce succès, les contrôles d’équité ont révélé que les patients non-blancs avaient généralement des résultats moins bons que les patients blancs, notamment pour l’identification correcte des tumeurs moins agressives. En revanche, les performances pour les hommes et les femmes étaient beaucoup plus équilibrées, avec seulement de faibles différences entre les sexes.

Essayer de corriger le biais

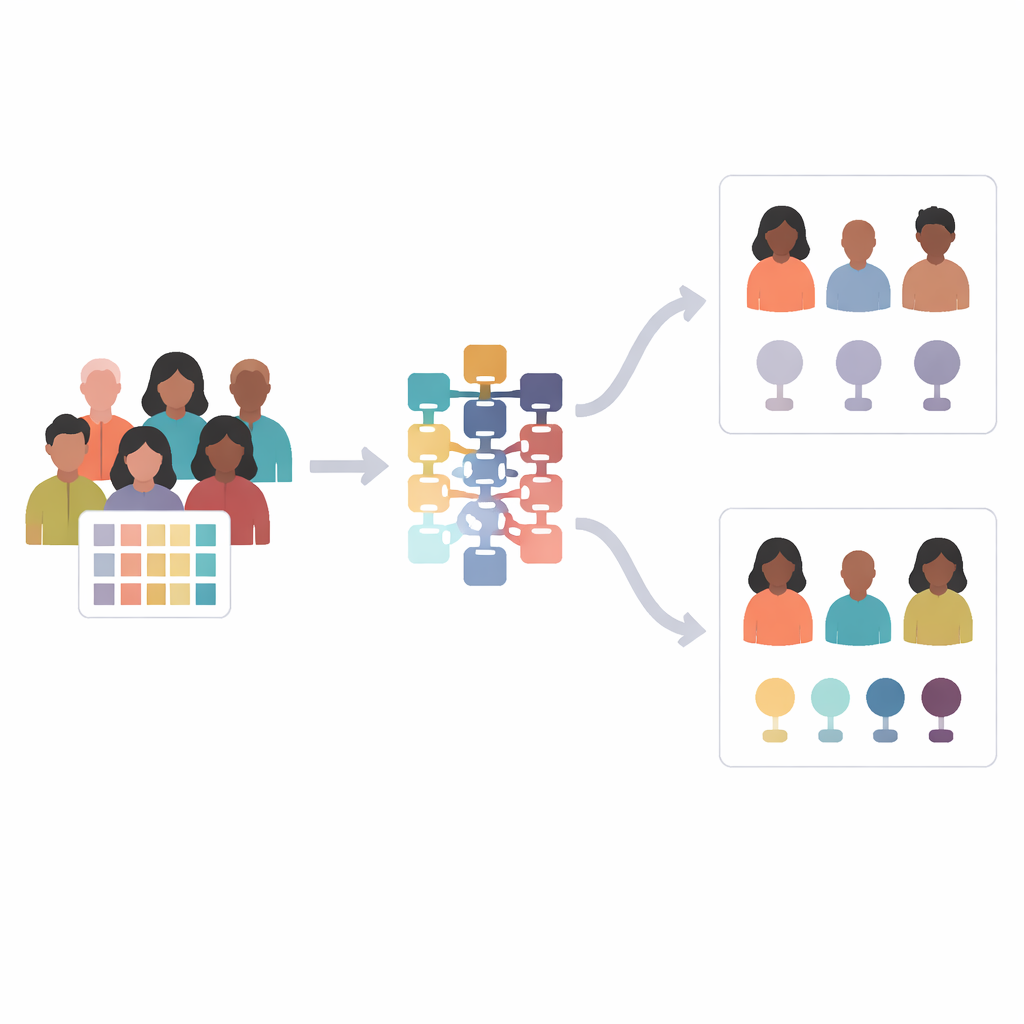

Les chercheurs ont ensuite cherché s’ils pouvaient améliorer l’équité sans affaiblir sérieusement l’utilité médicale du modèle. Ils ont choisi la régression logistique comme modèle de base, car c’était à la fois le plus précis et le plus équitable des trois. Ils ont testé deux stratégies courantes de dé-biaisation. Une approche de « prétraitement » appelée reweighting (rééchantillonnage par pondération) a donné plus d’importance aux patients sous-représentés pendant l’entraînement, afin que le modèle leur accorde plus d’attention. Une approche de « post-traitement » appelée equalized odds (égalité des cotes) a conservé le modèle entraîné mais ajusté ses sorties de sorte que les taux d’erreur deviennent plus similaires entre les groupes.

Ce qui a changé quand le modèle a été ajusté

Pour le genre, les deux stratégies ont généralement aidé : la qualité des prédictions pour les femmes s’est améliorée et les différences entre hommes et femmes se sont largement réduites. Pour la race, où le déséquilibre dans les données était beaucoup plus marqué, le bilan était plus complexe. La rééchantillonnage par pondération a parfois eu l’effet inverse, détériorant légèrement les performances pour les patients non-blancs et augmentant même l’iniquité selon certaines mesures. En revanche, la méthode de post-traitement a réduit de manière substantielle les écarts raciaux dans les taux d’erreur tout en maintenant une précision globale élevée du modèle, bien qu’elle ait légèrement diminué les performances pour le groupe majoritaire. Les auteurs montrent également que les indicateurs d’équité pour le groupe non-blanc, beaucoup plus petit, sont statistiquement instables — changer la prédiction d’une seule personne peut faire varier sensiblement les scores d’équité — de sorte que ces résultats doivent être interprétés avec prudence.

Ce que cela signifie pour les patients et les médecins

L’étude conclut qu’il n’y a pas de solution miracle : améliorer l’équité dans l’IA médicale implique souvent des compromis sur la performance, et la meilleure solution dépend de l’ampleur du biais dans les données et de l’objectif d’équité retenu. Dans cet exemple de tumeur cérébrale, ajuster les sorties du modèle après l’entraînement s’est avéré la manière la plus pratique de rendre les recommandations de traitement plus équitables selon la race et le genre, tout en préservant une forte puissance prédictive. Ce travail souligne que les contrôles d’équité devraient être systématiques lors du déploiement de l’IA en santé, en particulier pour des affections graves comme le gliome, et que des méthodes existent pour rendre ces outils plus justes — mais qu’elles doivent être choisies et interprétées avec soin.

Citation: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

Mots-clés: classification des gliomes, équité de l’IA médicale, biais algorithmique, tumeurs cérébrales, atténuation des biais