Clear Sky Science · fr

Attribution de la caméra source à l’aide d’un réseau de neurones convolutionnel explicable et fondé sur des règles

Pourquoi vos photos en disent plus que vous ne le pensez

Chaque photo que vous prenez porte des indices cachés sur l’appareil qui l’a capturée. Pour les enquêteurs numériques, ces indices peuvent aider à confirmer si une image est authentique, retracer l’appareil d’origine ou relier des photos entre différents scènes de crime. Aujourd’hui, des outils puissants d’intelligence artificielle (IA) repèrent ces motifs mieux que les humains — mais ils fonctionnent souvent comme des « boîtes noires » mystérieuses. Cet article présente une façon d’ouvrir cette boîte : une méthode fondée sur des règles qui explique comment un modèle d’apprentissage profond décide quelle caméra a pris une photo, sous une forme qu’un examinateur humain peut comprendre et juger fiable.

Le défi de faire confiance aux outils forensiques intelligents

La criminalistique numérique moderne doit trier d’énormes volumes de données — provenant de smartphones, de sauvegardes cloud et des réseaux sociaux — bien au-delà de ce que des analystes humains peuvent examiner manuellement. Les systèmes d’apprentissage profond peuvent rapidement signaler des images ou indiquer lesquelles sont importantes, mais leurs mécanismes internes sont notoirement opaques. Dans des contextes sensibles comme les tribunaux, dire simplement « le réseau neuronal le pense » ne suffit pas. Les outils d’explication existants mettent généralement en évidence des régions d’image jugées importantes par le modèle, ce qui est utile pour des tâches comme la reconnaissance de visages ou d’objets. Toutefois, pour l’identification de la caméra source, le signal crucial n’est pas une caractéristique visible mais une empreinte de capteur ténue — des motifs de bruit subtils imperceptibles à l’œil. Par conséquent, les outils d’explication visuelle actuels ne montrent pas clairement pourquoi un modèle considère qu’une image provient d’une caméra spécifique, ni n’aident l’examinateur à repérer quand le modèle se trompe.

Une nouvelle façon de regarder un réseau neuronal réfléchir

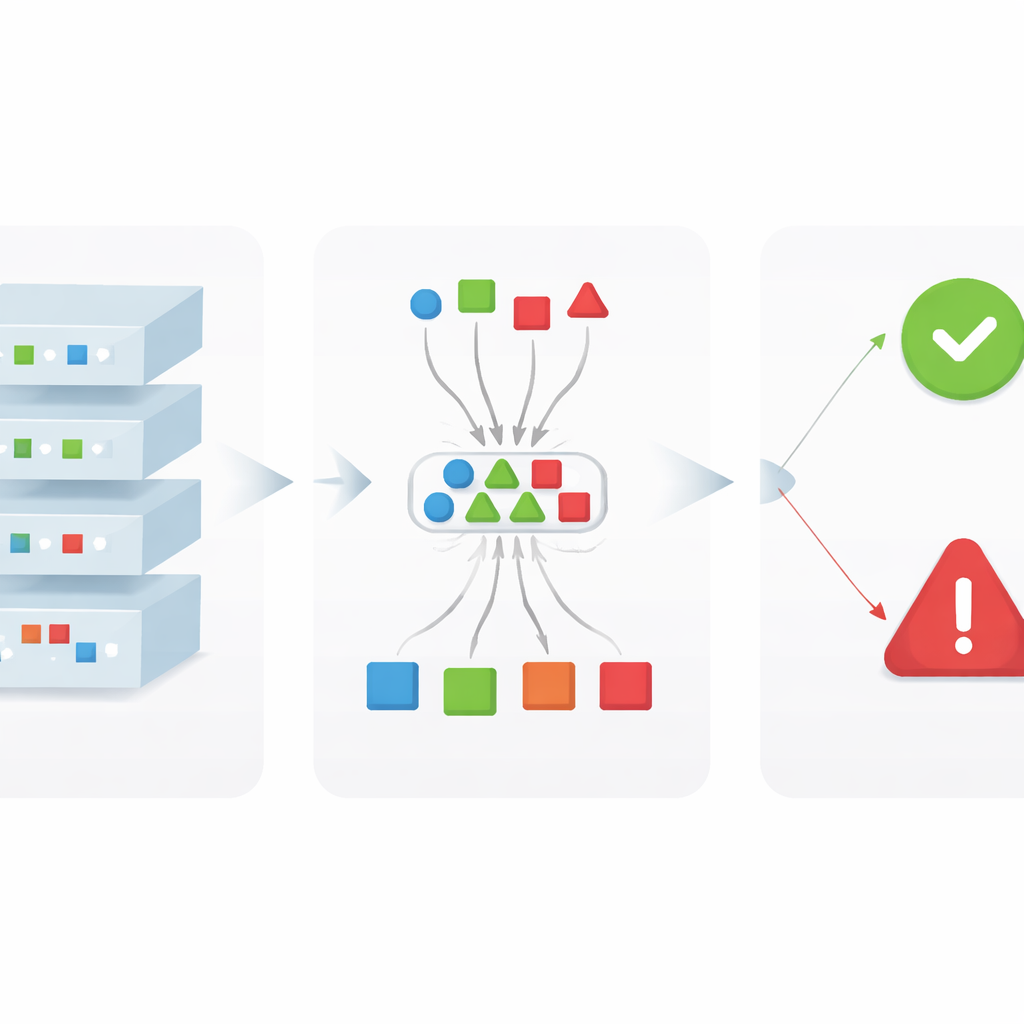

Les auteurs présentent xDFAI, un cadre conçu spécifiquement pour la criminalistique numérique qui explique comment un réseau de neurones convolutionnel (CNN) parvient à ses décisions sans modifier le modèle original. Plutôt que de considérer le réseau comme une boîte opaque unique, xDFAI l’examine couche par couche. Pour chaque couche et chaque classe d’appareil, il identifie un ensemble de motifs internes récurrents, appelés « traces », qui s’activent de façon cohérente lorsque le modèle estime qu’une image appartient à cette caméra. Ces traces sont extraites d’un modèle entraîné en utilisant des méthodes d’attribution existantes, puis filtrées pour ne conserver que les motifs qui apparaissent de manière fiable sur de nombreuses images d’entraînement. Ensemble, ces traces forment une carte structurée de la façon dont les indices d’identité de la caméra évoluent au fur et à mesure que l’image traverse le réseau.

Laisser voter les couches et transformer les votes en règles

Une fois les traces connues, xDFAI les utilise pour examiner de nouvelles images non vues. Pour une photo test donnée, le cadre mesure la similarité entre ses activations internes et les traces stockées pour chaque caméra à chaque couche. Chaque couche émet en quelque sorte des votes pour les modèles de caméra dont les traces lui correspondent le plus. Un « vote majoritaire » inter-couches résume ensuite à quel point le réseau, dans son ensemble, soutient chaque caméra candidate. Crucialement, les auteurs n’utilisent pas ce vote pour remplacer la prédiction du modèle ; ils s’en servent comme vérification. Des règles logiques simples comparent le vote majoritaire à la prédiction originale : si la caméra prédite reçoit aussi un fort soutien de nombreuses couches, la décision est confirmée ; si les votes sont dispersés ou favorisent une caméra différente, le comportement est signalé comme anormal et présenté à l’examinateur comme une erreur potentielle du modèle.

Mettre le cadre à l’épreuve

Pour démontrer xDFAI, les auteurs l’appliquent à un CNN à sept couches entraîné pour identifier laquelle des 27 modèles de caméra a capturé une image, en utilisant un jeu de données d’expertise bien connu. Le CNN de base seul fonctionne déjà très bien, classant correctement environ 97 % des images de test. Lorsqu’on applique les règles de xDFAI par-dessus, le système signale automatiquement 27 des 37 prédictions erronées comme suspectes. Ces cas signalés ne sont plus comptés comme des identifications confiantes, ce qui fait monter la précision — la fraction des décisions acceptées qui sont effectivement correctes — de 97,33 % à 99,2 %, tout en réduisant légèrement l’exactitude globale. Pour le travail forensique, où une attribution erronée peut avoir de graves conséquences, ce compromis est très souhaitable : moins de faux positifs parmi les conclusions que les analystes choisissent de croire.

Ce que cela signifie pour les enquêtes réelles

Ce travail montre qu’il est possible de conserver toute la puissance d’un modèle d’apprentissage profond moderne tout en ajoutant des explications compréhensibles par des humains et conformes aux règles d’intégrité forensique — sans réentraînement, sans altération du modèle original et sans s’appuyer uniquement sur des cartes de chaleur vagues. En exposant des traces internes stables, en les agrégeant via un schéma de vote transparent et en exprimant le résultat sous forme de règles simples, xDFAI donne aux examinateurs un moyen de confirmer ou de remettre en question les attributions de caméra générées par l’IA. Bien que l’étude se concentre sur l’identification de la source caméra, les mêmes idées pourraient être étendues à d’autres tâches d’attribution forensique. À long terme, des approches comme celle-ci pourraient contribuer à rapprocher des systèmes d’IA très précis du niveau de transparence et de fiabilité exigé en justice et dans la pratique d’enquête.

Citation: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Mots-clés: expertise numérique, IA explicable, identification d’appareil photo, réseaux de neurones convolutionnels, criminalistique d’image