Clear Sky Science · fr

MedicalPatchNet : une architecture d’IA auto-explicable basée sur des patchs pour la classification des radiographies thoraciques

Pourquoi des radiographies plus intelligentes comptent

Les radiographies thoraciques sont l’un des examens médicaux les plus courants au monde, et les systèmes d’intelligence artificielle (IA) aident de plus en plus les médecins à les interpréter. Mais bon nombre des modèles d’IA les plus performants agissent comme des « boîtes noires » : ils peuvent être précis, mais même des experts ont du mal à comprendre pourquoi ils ont abouti à un diagnostic donné. Ce manque de transparence rend difficile la confiance des cliniciens et l’utilisation sûre de l’IA dans la prise en charge réelle des patients. L’étude présente MedicalPatchNet, une nouvelle approche d’IA qui vise à conserver une forte exactitude tout en rendant son raisonnement visible et compréhensible, même pour des personnes sans formation en apprentissage automatique.

Découper les images en petites régions signifiantes

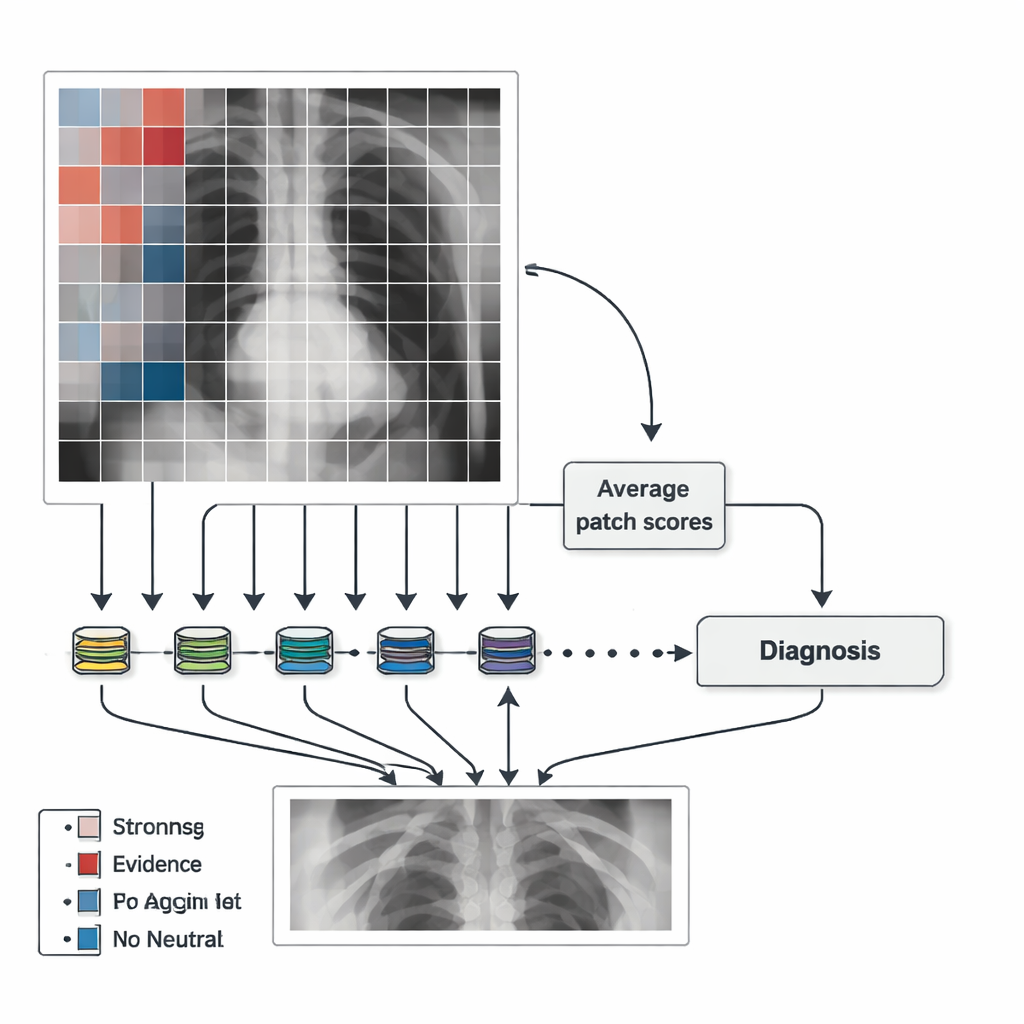

Plutôt que d’analyser une radiographie thoracique comme un grand tout mystérieux, MedicalPatchNet fonctionne en découpant l’image en nombreux petits carrés non chevauchants, ou « patchs ». Chaque patch est traité par le même réseau neuronal, qui produit un score pour plusieurs constatations possibles, comme une opacité pulmonaire, une pneumonie ou un épanchement pleural (liquide autour des poumons). Ces scores au niveau des patchs sont ensuite simplement moyennés pour obtenir une décision globale pour l’ensemble de l’image. Parce que la réponse finale n’est que la somme de nombreux votes locaux, il est simple de montrer combien chaque patch a contribué au diagnostic. Surtout, il n’y a pas de mécanismes d’attention cachés ni de schémas de pondération interne complexes : l’influence de chaque région est explicitement définie plutôt qu’apprise de façon opaque.

Transformer les décisions du modèle en cartes visuelles claires

Les auteurs utilisent ces scores de patch pour créer des « cartes de saillance » qui mettent en évidence où l’IA a trouvé des preuves en faveur ou en défaveur d’une maladie. Les patchs qui soutiennent fortement une constatation sont affichés en couleurs chaudes (par exemple en rouge), ceux qui s’y opposent en couleurs froides (par exemple en bleu), et les zones neutres en gris. Cela permet de voir facilement si le modèle se concentre sur les poumons, le cœur ou, de façon préoccupante, sur des éléments non pertinents comme des artefacts de bordure ou des étiquettes de texte. Pour rendre les cartes plus lisses et moins en blocs, l’équipe génère aussi des cartes après avoir légèrement décalé l’image par petites étapes et en moyennant les résultats. Cela ajoute un coût de calcul, mais produit des cartes de chaleur mieux adaptées à l’anatomie sous-jacente tout en conservant le lien clair entre chaque région et sa contribution à la décision finale.

Atteindre les performances des boîtes noires tout en améliorant la confiance

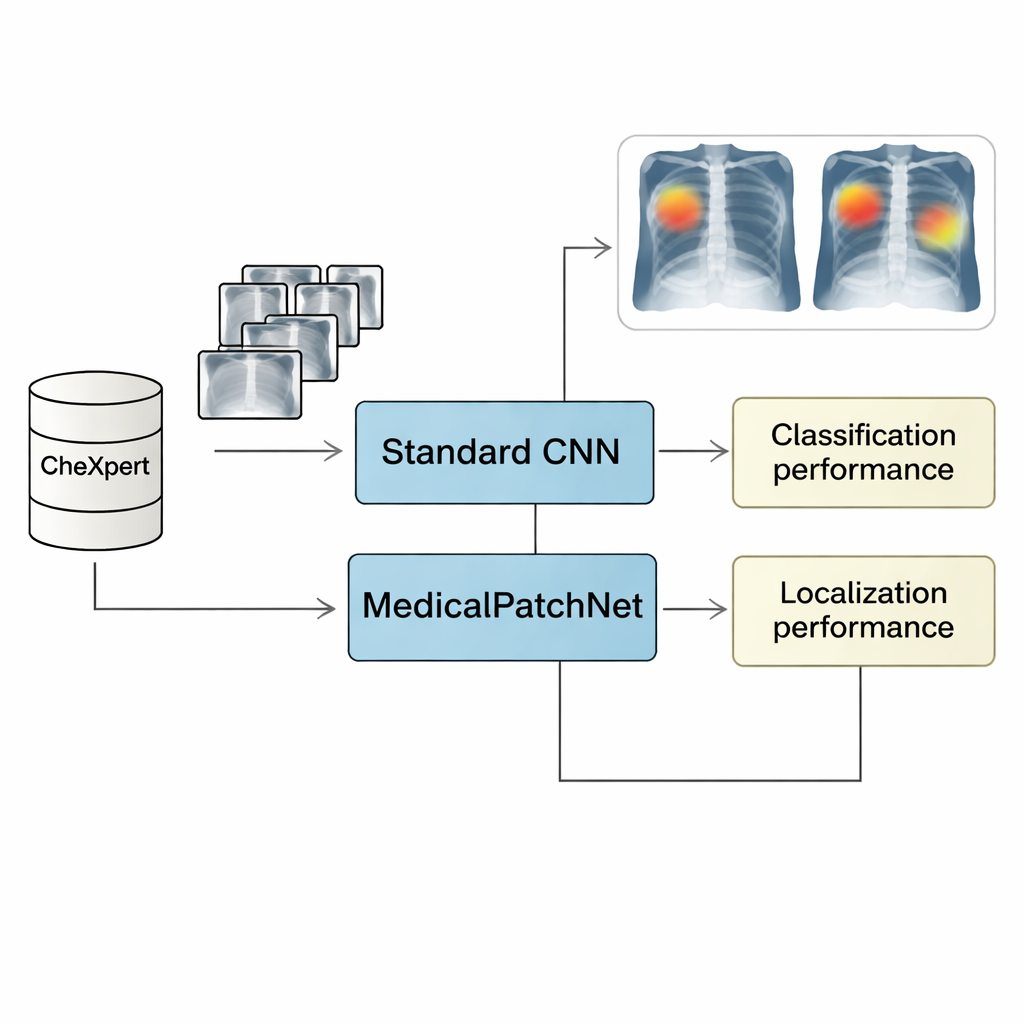

Pour tester MedicalPatchNet, les chercheurs l’ont entraîné sur CheXpert, une grande base de données publique de plus de 220 000 radiographies thoraciques annotées pour 14 constatations courantes. Ils ont comparé ses performances à un modèle classique au niveau de l’image utilisant le même réseau de base (EfficientNetV2-S). En moyenne, les deux modèles ont atteint des performances diagnostiques presque identiques, mesurées par l’aire sous la courbe ROC (AUROC), la sensibilité, la spécificité et la précision. Autrement dit, contraindre le modèle à raisonner patch par patch puis à moyenniser les résultats n’a pas affaibli de manière significative sa capacité à reconnaître la maladie. Cela suggère que, pour de nombreuses tâches sur radiographies thoraciques, l’information locale de l’image est suffisante et qu’il n’est pas nécessaire que le modèle s’appuie sur des schémas globaux complexes pour bien fonctionner.

Voir où le modèle « regarde » pour détecter la maladie

Au-delà de l’exactitude globale, la question clé est de savoir si MedicalPatchNet s’explique de manière plus fiable que des outils populaires « a posteriori » comme Grad-CAM et ses variantes. Pour cela, l’équipe a utilisé un second jeu de données, CheXlocalize, qui fournit des contours dessinés par des radiologues des régions de maladie réelles. Ils ont mesuré combien de fois le point le plus mis en évidence par une méthode se trouvait à l’intérieur de la zone anormale réelle (le « taux de réussite ») et à quel point la région mise en évidence recouvrait les annotations d’experts (Intersection over Union moyenne, ou mIoU). Les cartes basées sur les patchs de MedicalPatchNet ont obtenu des taux de réussite supérieurs à ceux des explications de type Grad-CAM pour neuf conditions sur dix, et le meilleur recouvrement global en comptant à la fois les prédictions correctes et incorrectes. Cette évaluation plus large est importante parce qu’elle pénalise les explications qui ont l’air convaincantes seulement lorsque le modèle a raison mais qui ne révèlent pas des comportements trompeurs lorsque le modèle se trompe.

De suppositions opaques à des partenaires transparents

Pour les non-spécialistes, le résultat principal est que MedicalPatchNet montre qu’il est possible de conserver des performances proches de l’état de l’art pour le diagnostic sur radiographie thoracique tout en rendant le raisonnement de l’IA beaucoup plus transparent. Plutôt que des cartes de chaleur mystérieuses qui reflètent ou non ce qui a réellement motivé la décision, cette approche lie chaque mise en évidence directement à un vote local dans le calcul du modèle. Les cliniciens peuvent voir non seulement si l’IA pense qu’une maladie est présente, mais aussi exactement où dans l’image elle a trouvé des preuves favorables ou contradictoires. Bien que la méthode ait encore des limites — par exemple pour des conditions qui dépendent de la considération simultanée de régions éloignées de l’image — elle offre une voie pratique vers des outils d’IA qui ressemblent moins à des boîtes noires et plus à des partenaires en imagerie médicale clairs et responsables.

Citation: Wienholt, P., Kuhl, C., Kather, J.N. et al. MedicalPatchNet: a patch-based self-explainable AI architecture for chest X-ray classification. Sci Rep 16, 7467 (2026). https://doi.org/10.1038/s41598-026-40358-0

Mots-clés: IA pour radiographie thoracique, apprentissage profond explicable, MedicalPatchNet, cartes de saillance d’images médicales, assistance à la décision en radiologie