Clear Sky Science · fr

Colorisation d'images par apprentissage profond transféré avec VGG19 et CLAHE

Redonner vie aux vieilles photos

Beaucoup d'entre nous possèdent des boîtes de photos de famille en noir et blanc ou apprécient les films classiques et les documentaires d'époque. Imaginer à quoi ces scènes ressemblaient dans la réalité — ciels bleus, champs verts, tons de peau chaleureux — peut rendre le passé plus proche et plus tangible. Cet article explore une nouvelle méthode informatique qui ajoute automatiquement des couleurs réalistes et un contraste agréable aux images en niveaux de gris, facilitant ainsi la restauration de vieux clichés, la modernisation de films en noir et blanc et même l'amélioration d'images médicales, sans qu'il soit nécessaire qu'un expert peint chaque nuance à la main.

Du coloriage manuel aux machines intelligentes

La colorisation d'images est plus difficile qu'il n'y paraît parce qu'une même nuance de gris peut correspondre à de nombreuses couleurs possibles : un gris moyen peut être une brique rouge, une feuille verte ou une chemise bleue. Les outils plus anciens reposaient beaucoup sur l'intervention humaine. Les artistes pouvaient tracer des « gribouillis » colorés sur certaines zones d'une image, et le logiciel étendait ces indices aux régions similaires. D'autres systèmes empruntaient les couleurs à une photo de référence au contenu proche. Ces méthodes pouvaient être convaincantes, mais elles échouaient lorsque les indications étaient rares, que l'image de référence n'était pas parfaitement adaptée ou que la scène était complexe. Avec l'essor de l'apprentissage profond, de nouveaux programmes ont appris à « deviner » les couleurs directement à partir de larges collections de photos d'exemple, réduisant le travail manuel mais exigeant des temps d'entraînement et des ressources de calcul considérables.

Apprendre à un réseau à connaître l'apparence du monde

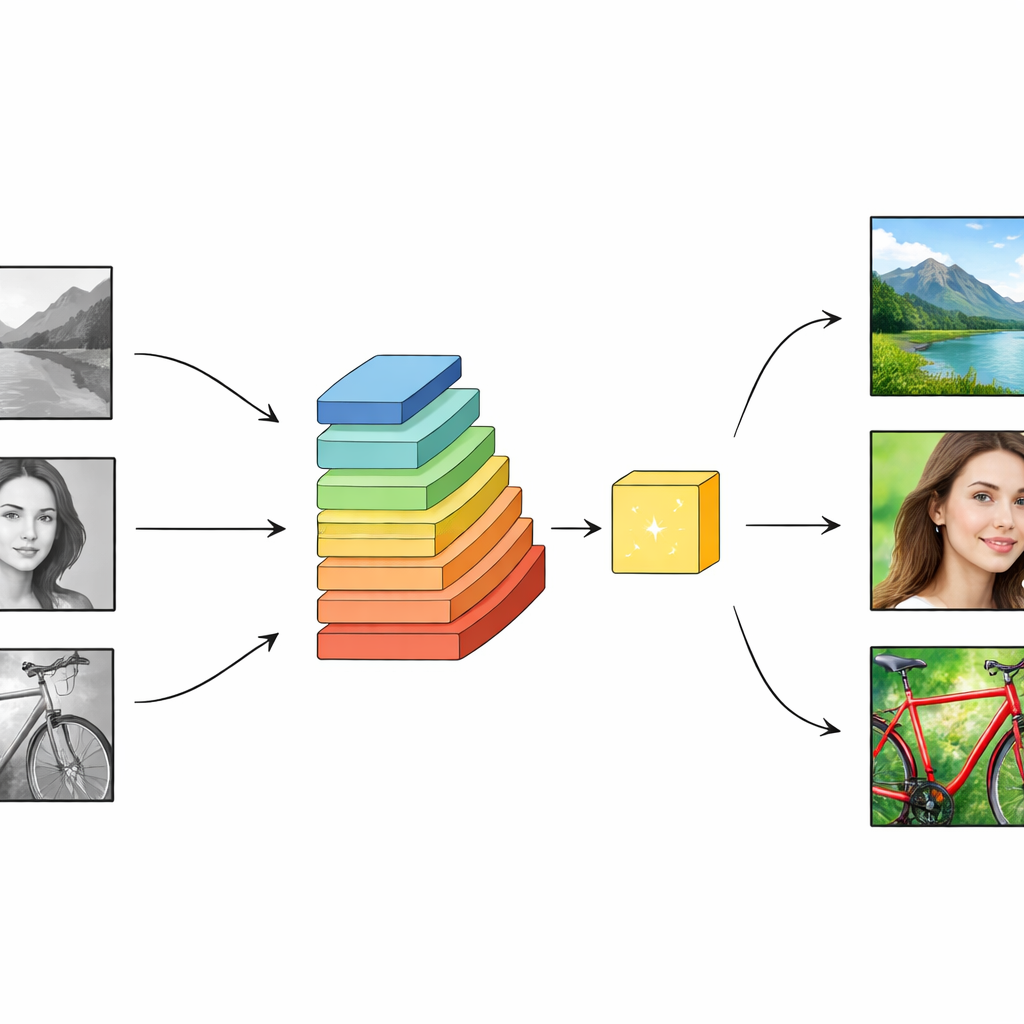

Les auteurs s'appuient sur ces avancées avec une stratégie dite d'apprentissage par transfert. Plutôt que d'entraîner un système nouveau depuis zéro, ils réutilisent un puissant réseau de vision nommé VGG19, déjà entraîné sur des millions d'images couleur. Ce réseau comporte de nombreuses couches qui passent progressivement de motifs simples tels que bords et textures à des objets et scènes entiers : visages, arbres, bâtiments, ciels. Le système de colorisation injecte une version en niveaux de gris d'une image dans VGG19 et collecte des caractéristiques provenant de plusieurs couches à la fois, formant une riche « pile » d'informations pour chaque pixel. Cela aide le modèle à comprendre à la fois le détail fin — comme des mèches de cheveux ou les bords des feuilles — et le contexte plus large, par exemple s'il s'agit d'une plage, d'une rue urbaine ou d'une forêt. Avec ce contexte, le réseau est mieux à même de choisir des couleurs plausibles et crédibles, et pas seulement des solutions mathématiquement possibles.

Transformer lumière et ombre en couleur et contraste

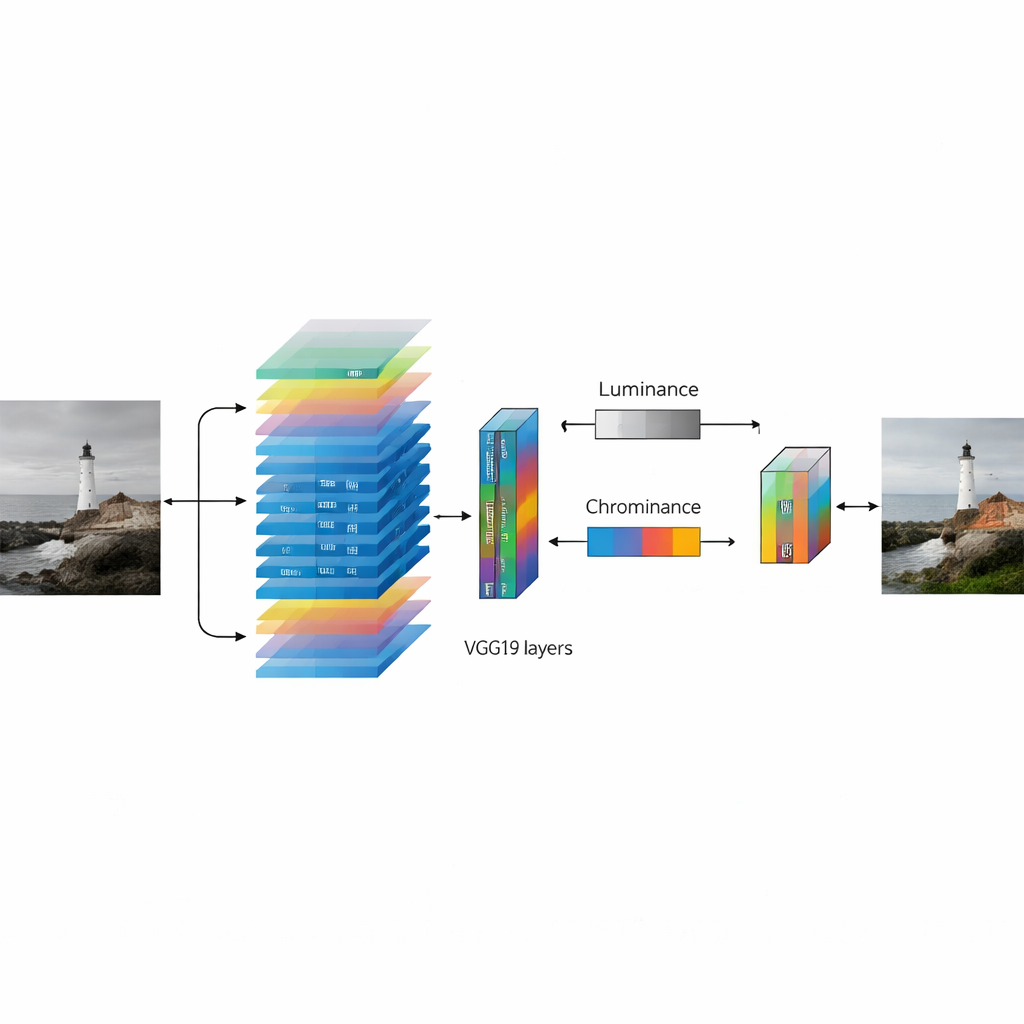

Pour rendre les décisions de couleur plus stables, la méthode représente les images dans un espace colorimétrique qui sépare la luminosité du contenu chromatique. L'entrée en niveaux de gris sert de canal de luminosité, tandis que la tâche du réseau est de prédire les deux canaux restants qui codent les nuances entre rouge et vert, et entre bleu et jaune. En conservant la luminosité fixe, le système préserve l'ombrage et la structure originels de l'image. Après que le réseau produit sa meilleure estimation des informations colorimétriques manquantes, une étape finale d'amélioration est appliquée. Les auteurs utilisent ici une technique appelée égalisation d'histogramme adaptative, qui étire localement l'écart entre les zones sombres et claires. Cela rend les textures plus nettes, les contours plus francs et les couleurs plus vives, sans simplement « brûler » les zones lumineuses ni perdre du détail dans les ombres.

Évaluer la méthode

Pour mesurer l'efficacité de leur approche en pratique, les chercheurs l'ont entraînée et évaluée sur plusieurs collections d'images bien connues comprenant objets, scènes, personnes et environnements quotidiens. Ils ont comparé leurs résultats à une variété de méthodes concurrentes, y compris des systèmes guidés par l'utilisateur, des modèles génératifs qui tentent d'inventer des images réalistes, et des modèles récents basés sur des transformers. En utilisant des mesures standard de qualité d'image, leur méthode a constamment produit des couleurs plus nettes et plus fidèles ainsi que des structures plus claires, avec des performances particulièrement solides sur un ensemble difficile de photographies de scènes. Les comparaisons visuelles montrent que leurs images colorisées ressemblent souvent davantage aux photos couleur d'origine, avec une saturation plus riche mais maîtrisée et un contraste mieux équilibré. Ils soulignent aussi les limites : des images très sombres ou trop lumineuses, ou des scènes avec des textures inhabituelles et des couleurs rares, peuvent encore entraîner des teintes étranges ou un éclairage inégal.

Ce que cela signifie pour les images ordinaires

En termes simples, cette étude montre qu'offrir à un système de colorisation une solide éducation préalable sur le monde visuel — puis améliorer soigneusement le résultat — peut produire des images qui paraissent plus naturelles à l'œil humain. En s'appuyant sur un grand réseau pré-entraîné et en ajoutant une étape intelligente de renforcement du contraste, les auteurs proposent un outil pratique capable de redonner vie à des photographies historiques, d'enrichir des films en noir et blanc et de faciliter l'interprétation de certains types d'images médicales. Bien que la méthode ne soit pas parfaite et puisse échouer face à des éclairages extrêmes ou des scènes très singulières, elle rapproche la colorisation automatisée d'une solution sur laquelle les non‑experts peuvent compter, rendant la couleur réaliste accessible pour une large gamme d'usages quotidiens.

Citation: Ghosh, N., Mandal, G. Deep transfer learning based image colorization using VGG19 and CLAHE. Sci Rep 16, 9528 (2026). https://doi.org/10.1038/s41598-026-40292-1

Mots-clés: colorisation d'images, apprentissage profond, apprentissage par transfert, restauration de photos, amélioration du contraste