Clear Sky Science · fr

Un cadre intégré pour la mitigation proactive des deepfakes via un tatouage basé sur l’attention et une vérification d’authenticité sur blockchain

Pourquoi les vidéos truquées sont un problème pour tous

Des vidéos qui semblent réelles peuvent aujourd’hui être falsifiées avec des logiciels grand public, estompant la frontière entre vérité et fiction en ligne. Ces pseudo–deepfakes sont déjà utilisés pour des escroqueries, du harcèlement et des manipulations politiques. Plutôt que d’essayer de repérer les faux une fois qu’ils se sont répandus, cette étude pose une question différente : et si nous pouvions protéger discrètement les vidéos authentiques au moment même de leur création, de sorte que toute altération ultérieure devienne évidente ?

Passer de la chasse aux faux à la protection des originaux

La plupart des travaux actuels cherchent à détecter les deepfakes a posteriori, en entraînant des algorithmes à repérer de minuscules artefacts laissés par les modèles génératifs. Mais à mesure que ces modèles s’améliorent, ce jeu du chat et de la souris devient plus difficile à gagner. Les auteurs plaident pour une approche proactive : protéger les séquences authentiques dès leur enregistrement, afin que les spectateurs et les plateformes puissent ensuite vérifier si ce qu’ils voient est l’original intact. Leur cadre combine trois couches : un analyseur vidéo intelligent qui décide où la protection est la plus importante, une marque numérique invisible tissée dans chaque image, et un enregistrement sur blockchain qui verrouille l’identité du fichier dans son ensemble.

Apprendre au système ce qui compte vraiment dans une vidéo

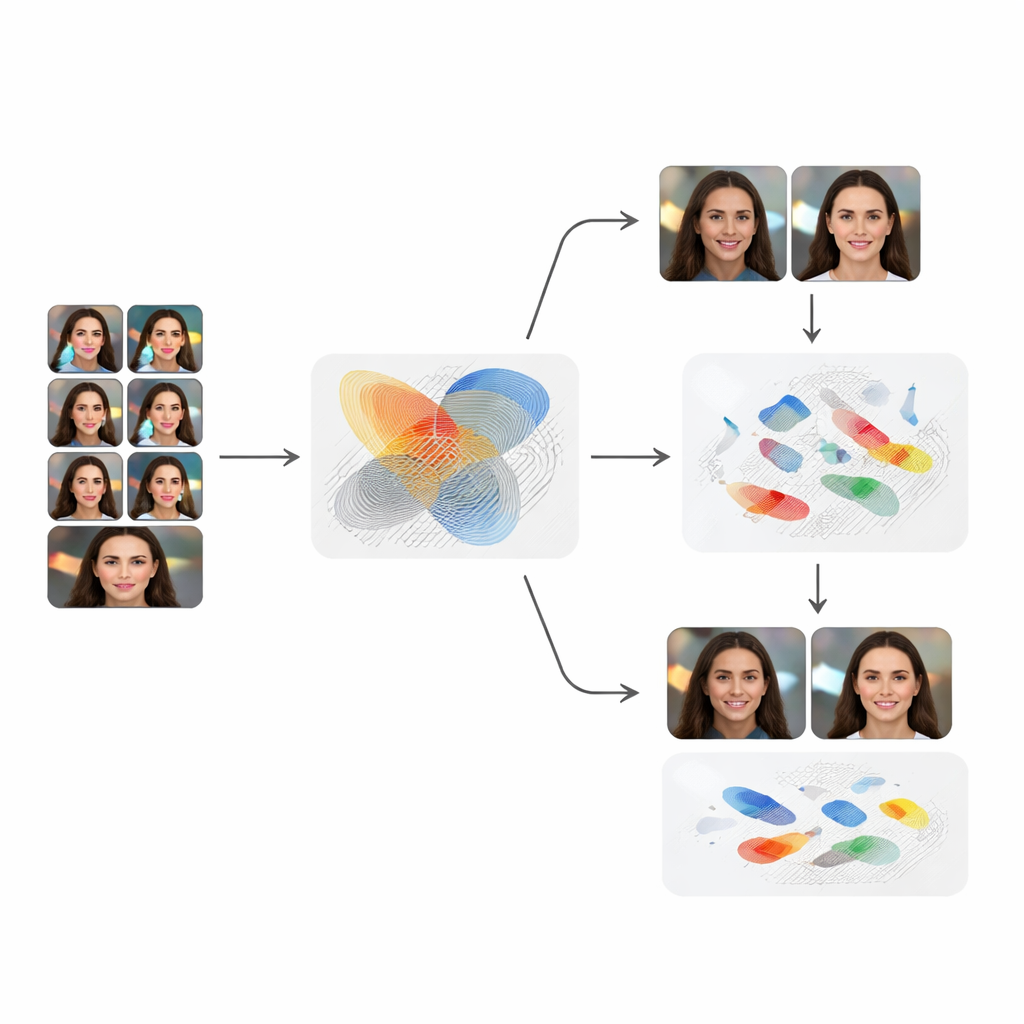

La première couche est un modèle d’attention qui apprend quelles parties d’une vidéo contiennent le mouvement et les détails les plus signifiants au fil du temps. L’équipe entraîne un réseau compact mais puissant sur des milliers de clips quotidiens montrant des personnes en action. Une partie du réseau examine chaque image comme une photographie fixe, tandis qu’une autre analyse la façon dont les éléments se déplacent sur des séquences de 16 images. Ensemble, ils obtiennent plus de 97 % de précision sur un test standard de reconnaissance d’actions, ce qui montre que le système a appris des motifs riches sur la manière dont les humains et les scènes évoluent. Ces motifs sont ensuite transformés en cartes d’attention qui mettent en évidence les régions où toute manipulation affecterait le plus la narration véhiculée par la vidéo.

Cacher une marque secrète là où les faussaires feront le plus de dégâts

Ensuite, une marque numérique invisible — un tatouage — est incorporée dans chaque image, mais pas de manière simple et uniforme. Un réseau génératif crée un motif subtil, proche du bruit, qui est mélangé plus fortement dans les régions que le modèle d’attention signale comme importantes, telles que les visages ou les mains en mouvement, et plus faiblement ailleurs pour préserver la qualité visuelle. Les spectateurs ne remarquent aucune différence, et les mesures de qualité confirment que les images marquées sont presque indiscernables des originaux. Pourtant, le motif est suffisamment fort et complexe pour qu’un réseau compagnon, entraîné comme une sorte de décodeur, puisse ensuite récupérer la signature cachée à partir des séquences authentiques, image par image.

Soumettre les deepfakes et les distorsions courantes à l’épreuve

Pour vérifier si cette protection résiste dans le monde réel, les auteurs réalisent une série de tests de résistance. Ils tatouent d’abord un ensemble diversifié de courts clips de stock, puis les passent dans DeepFaceLab, l’un des outils d’échange de visages les plus couramment utilisés, pour créer des deepfakes convaincants. Dans chacun des 50 clips manipulés, la marque cachée est soit détruite, soit fortement dégradée, et le système signale correctement la vidéo comme altérée. La méthode tient aussi bien face à des traitements courants comme une recompression agressive, un redimensionnement et un floutage qui surviennent souvent lors du partage en ligne, bien qu’un bruit aléatoire très intense puisse finir par submerger le signal caché. Des expériences soignées montrent que l’orientation par attention et l’utilisation du mouvement au fil du temps sont cruciales ; supprimer l’un ou l’autre affaiblit sensiblement la protection.

Verrouiller la confiance avec une empreinte permanente

La couche finale va au‑delà du contenu des images et sécurise le fichier vidéo lui‑même. Après le tatouage, le fichier complet est passé dans une fonction cryptographique qui produit une courte empreinte numérique. Cette empreinte, ainsi que des informations de base sur le clip, est écrite dans un registre blockchain, où elle ne peut être modifiée sans laisser de trace. Plus tard, n’importe qui peut téléverser une copie de la vidéo : le système tente de récupérer le tatouage et recalculer l’empreinte. Si la marque cachée et l’empreinte cryptographique correspondent aux enregistrements originaux, la vidéo peut être traitée comme authentique avec une grande confiance ; si l’une ou l’autre échoue, les spectateurs savent que la séquence a été modifiée.

Ce que cela signifie pour les vidéos que vous voyez

En termes clairs, ce travail montre que nous pouvons passer de l’hypothèse qu’une vidéo est fausse à la preuve qu’une vidéo est réelle. En tissant discrètement une marque intelligente et difficile à falsifier dans les parties les plus signifiantes de chaque image et en la sauvegardant par une entrée immuable dans un registre, le cadre détecte toutes les attaques de substitution de visage testées et résiste à de nombreuses distorsions courantes. Bien qu’il peine encore face à un bruit visuel extrême et nécessite des tests plus larges, il ouvre la voie à un futur où les caméras, les plateformes et les rédactions pourraient diffuser des vidéos avec une preuve d’authenticité intégrée — rendant beaucoup plus difficile pour les deepfakes de passer pour la vérité.

Citation: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Mots-clés: protection contre les deepfakes, authenticité vidéo, tatouage numérique, vérification blockchain, sécurité des médias