Clear Sky Science · fr

L'impact de l'IA générative sur les réseaux sociaux : une étude expérimentale

Pourquoi cela compte pour votre vie en ligne

Chaque jour, une part croissante de ce que nous lisons et écrivons sur les réseaux sociaux est discrètement façonnée par l’intelligence artificielle. Cette étude pose une question qui concerne toute personne qui publie, commente ou fait défiler : lorsque l’IA aide à rédiger, améliore-t-elle les conversations ou les rend-elle simplement plus bruyantes ? En recréant un espace de discussion de style réseau social avec des centaines d’utilisateurs ordinaires, les chercheur·e·s montrent que les outils d’IA peuvent attirer davantage de personnes dans la conversation — mais peuvent aussi rendre ces échanges plus génériques, moins dignes de confiance et moins humains.

Mettre en place une conversation en ligne réaliste

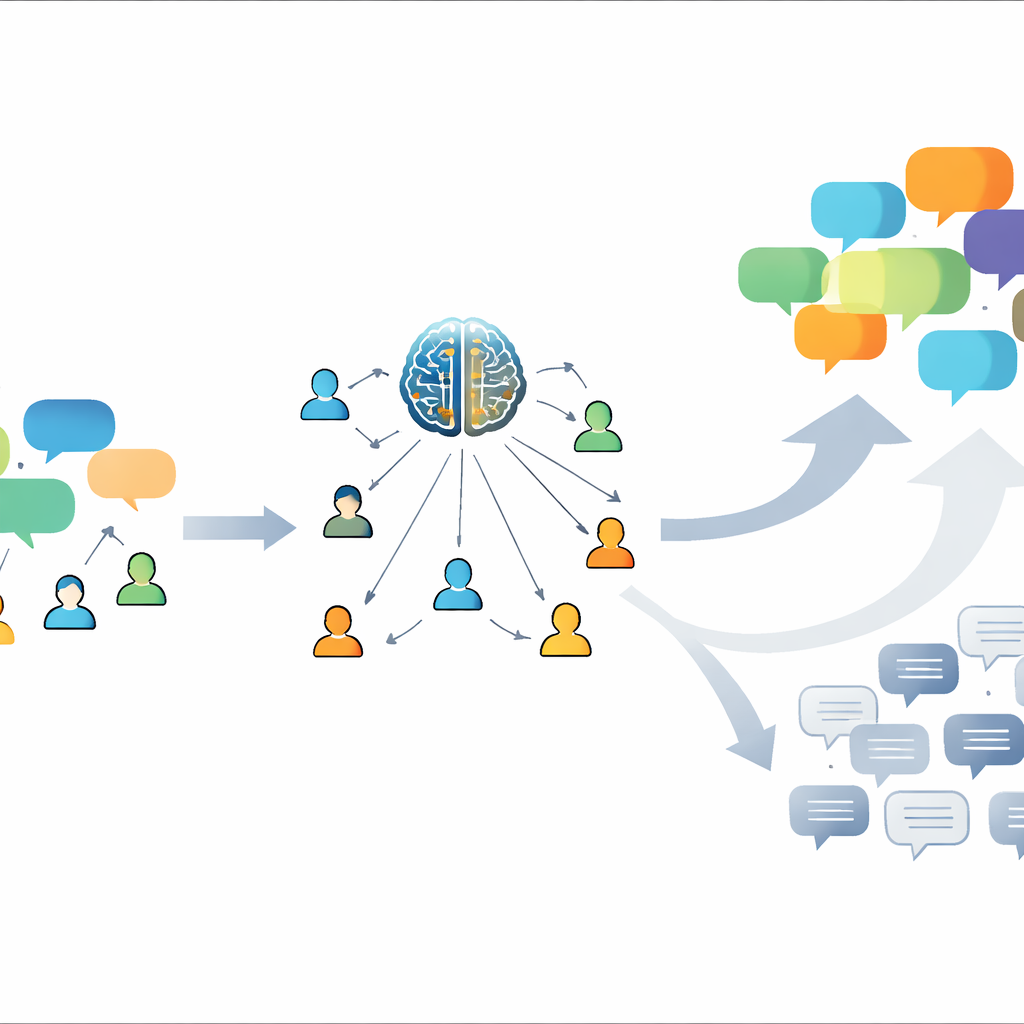

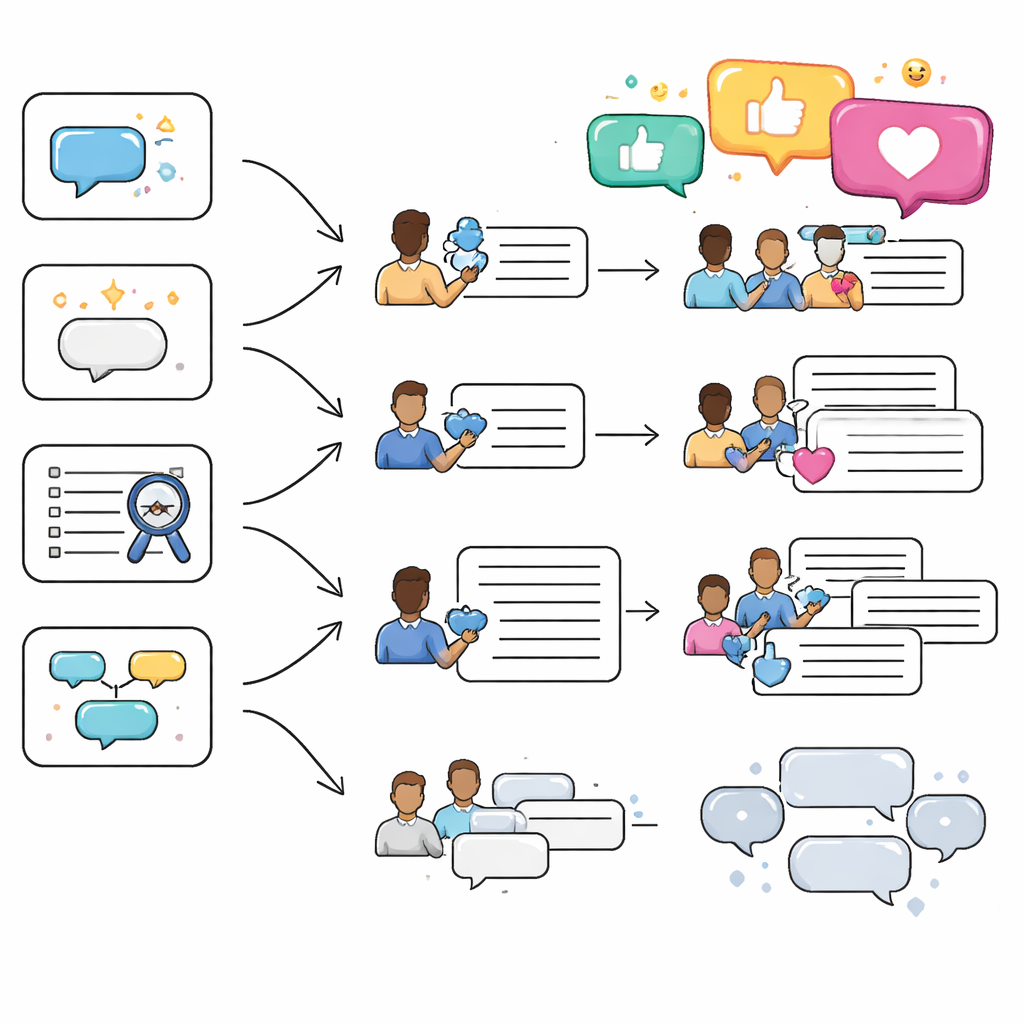

Pour explorer ces questions, l’équipe a construit sa propre plateforme de discussion inspirée des forums populaires. Six cent quatre-vingts adultes de tous les États-Unis ont été répartis en petits groupes de cinq et invités à débattre de trois types de sujets : un sujet léger (chats contre chiens), un sujet lié à la science (les bienfaits de l’avoine pour la santé) et un sujet politique (le revenu universel). Certains groupes n’avaient aucune aide technologique. D’autres utilisaient l’un des quatre outils d’IA suivants : un assistant de chat ouvert, des amorces de conversation courtes rédigées par l’IA, des suggestions de réponses, ou des retours sur des brouillons rédigés par les participants. Ce dispositif a permis aux chercheur·e·s de comparer le comportement des personnes et leur ressenti à propos de la discussion, avec et sans aide de l’IA.

Plus de voix et des messages plus longs, mais des impressions mitigées

À un niveau, les outils d’IA ont fait exactement ce que leurs concepteurs pourraient espérer. Les participant·e·s aidé·e·s par l’IA ont rédigé davantage de commentaires, et plus longs, que celles et ceux des groupes témoins. Certains outils ont également favorisé une participation plus large, de sorte que la discussion n’était pas uniquement dominée par une ou deux personnes. Par exemple, les amorces générées par l’IA ont aidé les utilisateurs plus discrets à entrer dans la conversation, et l’assistant de chat a rendu les gens plus enclins à publier en fournissant des idées, des faits ou des tournures lorsqu’ils ne savaient pas quoi dire.

Quand l’utile tourne au creux

Toutefois, lorsqu’on jugeait ces mêmes conversations du point de vue des lectrices et lecteurs, le tableau évoluait. Dans la plupart des conditions impliquant l’IA, les personnes estimaient que ce qu’elles voyaient était moins informatif et de moindre qualité que dans les discussions uniquement humaines. Elles ont réagi par plus de « je n’aime pas » et décrit de nombreux commentaires influencés par l’IA comme « robotiques » ou « génériques ». Si les suggestions de réponses étaient parfois appréciées, d’autres outils donnaient l’impression que le ton de la discussion avait perdu en authenticité. Même celles et ceux qui n’avaient pas utilisé l’IA ressentaient sa présence une fois qu’elle entrait dans un fil, car elle poussait le style global vers des réponses plus longues mais moins signifiantes — une sorte de « déchet sémantique » qui encombre l’espace sans ajouter beaucoup de substance.

Comment les gens ont réellement utilisé les outils

Une observation fine des comportements a révélé que les participant·e·s ne traitaient pas toutes les aides de la même manière. L’assistant de chat était largement utilisé, notamment pour vérifier des faits sur le sujet scientifique et pour explorer des arguments sur le sujet politique. Les retours sur brouillons ont été adoptés lorsque les enjeux semblaient plus élevés — par exemple pour des questions de santé ou politiques — et ont souvent conduit les gens à renforcer la structure et l’argumentation. Les amorces de conversation ont abaissé la barrière à l’engagement mais étaient tout aussi souvent ignorées lorsqu’elles ne correspondaient pas à l’intention d’un utilisateur. Les suggestions de réponses ont été utilisées modérément et, sur des sujets tendus, les gens ont fortement préféré les suggestions qui étaient en accord plutôt qu’en désaccord, ce qui laisse entendre que l’IA pourrait orienter doucement les discussions vers des terrains plus sûrs et moins conflictuels.

Leçons de conception pour un avenir en ligne plus humain

À partir de ces expériences, les auteurs soutiennent que la voie à suivre n’est pas de rejeter l’IA sur les réseaux sociaux, mais de la concevoir avec plus de soin. Les gens appréciaient d’avoir une IA en aide optionnelle, notamment pour le brainstorming, la vérification d’informations et pour surmonter le « blocage de l’écrivain », mais ils voulaient des outils qui paraissent plus personnels et mieux adaptés au sujet et à leur propre voix. Les chercheur·e·s recommandent un étiquetage clair quand un texte est copié directement depuis une IA, une personnalisation plus intelligente qui s’adapte à chaque utilisateur, un comportement contextuel qui ajuste le ton entre le registre familier, scientifique et politique, ainsi que des interfaces simples et familières. Sans telles balises, préviennent-ils, les plateformes sociales risquent de remplir les espaces publics de bavardages lisses mais superficiels qui érodent la confiance. Avec elles, l’IA pourrait au contraire abaisser les barrières à la participation et soutenir des conversations plus inclusives et réfléchies qui paraissent, et se ressentent, comme provenant de vraies personnes.

Citation: Møller, A.G., Romero, D.M., Jurgens, D. et al. The impact of generative AI on social media: an experimental study. Sci Rep 16, 9376 (2026). https://doi.org/10.1038/s41598-026-40110-8

Mots-clés: réseaux sociaux, IA générative, discussion en ligne, authenticité, interaction homme-machine