Clear Sky Science · fr

Calibrer des classificateurs profonds avec propagation dynamique de confiance et normalisation adaptative

Pourquoi il est important de faire confiance à la confiance de l'IA

Les systèmes d'intelligence artificielle modernes ne se contentent pas d'indiquer ce qu'ils pensent voir dans une image ou une mesure ; ils fournissent aussi un degré de confiance. Cette confiance auto‑déclarée est cruciale dans des contextes où la sécurité est primordiale, comme l'imagerie médicale, la conduite autonome ou la surveillance industrielle, où une assurance mal placée peut être dangereuse. Pourtant, les réseaux neuronaux profonds d'aujourd'hui sont tristement célèbres pour être trop confiants dans leurs erreurs, et les remèdes existants s'effondrent souvent lorsque les données sont déséquilibrées ou proviennent d'environnements changeants. Cet article présente une nouvelle méthode, dite Propagation Dynamique de la Confiance avec Normalisation Alternée (DCP‑AN), conçue pour rendre les scores de confiance des systèmes d'IA plus honnêtes, stables et efficaces dans des conditions réalistes et évolutives.

Quand les machines intelligentes sont trop sûres d'elles

La plupart des modèles d'apprentissage profond populaires sont entraînés pour prédire la bonne étiquette, pas pour évaluer la fiabilité de chaque prédiction. En conséquence, un réseau peut être « sûr à 99 % » qu'une image montre un chat alors qu'il s'agit en réalité d'un chien. Les techniques de calibration standard, comme le temperature scaling ou le regroupement des prédictions en classes de confiance, cherchent à corriger cela après l'entraînement par des ajustements globaux. Cependant, ces méthodes traitent toutes les catégories et tous les exemples de la même façon. Dans le monde réel, les données sont rarement équilibrées : quelques classes fréquentes (« head ») contiennent de nombreux exemples, tandis que des classes rares (« tail ») n'apparaissent que quelques fois. Les réseaux ont tendance à être trop confiants sur les classes fréquentes et sous‑confiants sur les classes rares, un écart qu'une correction statique et uniforme ne peut combler — surtout lorsque la distribution des données change entre domaines, par exemple des croquis artistiques aux photos réelles.

Une nouvelle façon de faire circuler l'information entre données et étiquettes

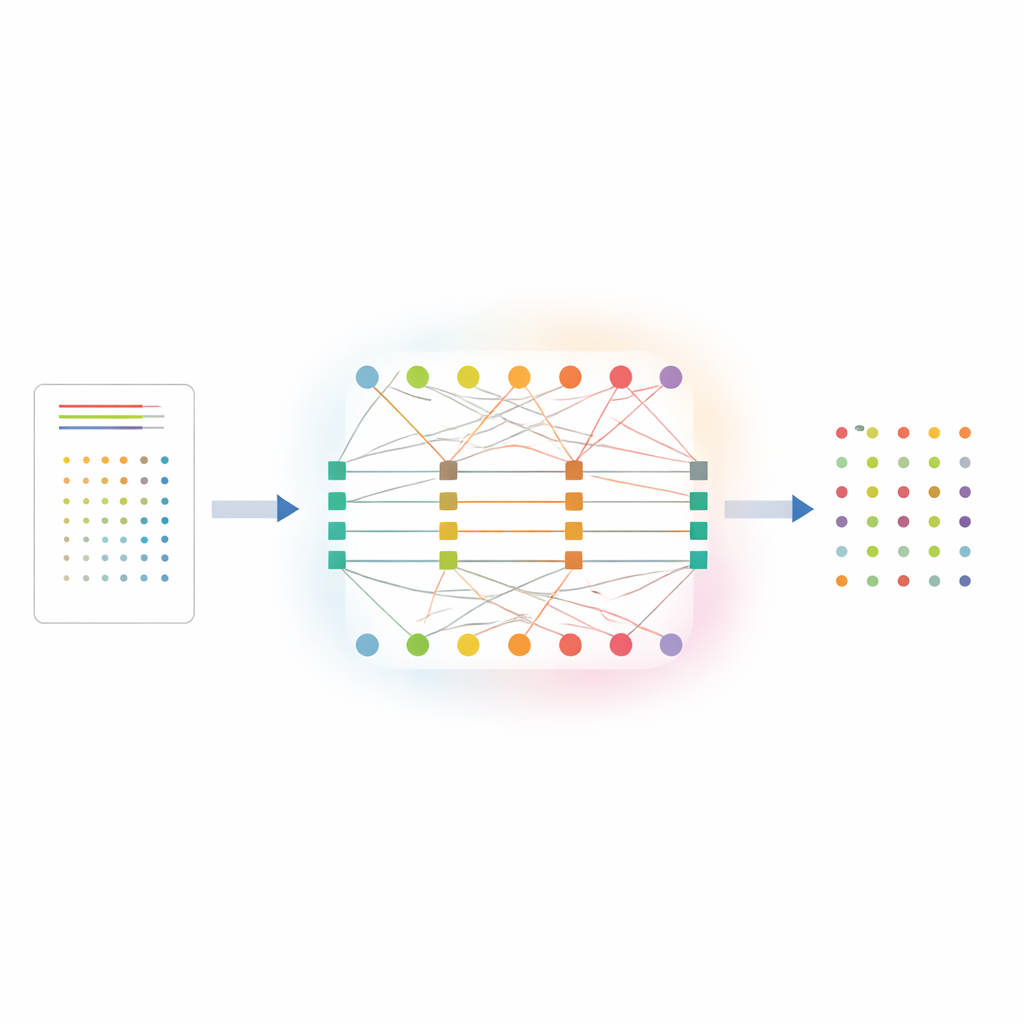

DCP‑AN aborde ce problème en modélisant explicitement comment la confiance doit circuler entre les échantillons individuels et les classes auxquelles ils appartiennent. La méthode représente la relation entre échantillons et classes comme un réseau à deux couches : une couche de nœuds pour les échantillons, une autre pour les classes, reliées par des connexions pondérées qui encodent les forces de prédiction initiales. La confiance est ensuite raffinée via une danse en deux étapes. Dans la première étape, l'information circule des échantillons vers les classes, ajustant la dispersion des prédictions de chaque classe en fonction de l'incertitude apparente de cette classe. Dans la seconde étape, l'information retourne des classes vers les échantillons, ajustant le profil de confiance de chaque échantillon selon sa cohérence avec les estimations précédentes. En répétant ce va‑et‑vient un nombre limité de fois, le système favorise une meilleure « coopération » entre exemples et étiquettes, de sorte que les classes rares reçoivent des signaux plus nets au lieu d'être noyées par les classes courantes.

Augmenter l'intensité là où c'est nécessaire

Une innovation clé de DCP‑AN est un « champ de température » adaptatif qui modifie l'intensité avec laquelle la méthode remodèle la confiance, selon l'incertitude locale et globale. Plutôt que d'utiliser une seule valeur de température pour toutes les prédictions, la méthode calcule des forces d'ajustement séparées pour les classes et pour les échantillons, basées sur des mesures d'incertitude et de désaccord au fil du temps. Pour les classes head que le réseau traite déjà avec assurance, la température effective s'abaisse légèrement, évitant un lissage excessif et préservant des distinctions nettes. Pour les classes tail et les échantillons ambigus, la température augmente, autorisant des corrections plus fortes qui relèvent leur confiance lorsque cela est justifié et atténuent les pics trompeurs. Ce comportement dynamique émerge d'une règle de mise à jour principée et répond rapidement lorsque l'incertitude croît, tout en restant stable lorsque le modèle est déjà bien aligné.

Amélioration fiable à travers tâches et matériels

Les auteurs évaluent soigneusement DCP‑AN sur plusieurs jeux de données d'images largement utilisés. Sur une version à longue traîne d'ImageNet, où certaines catégories comptent des centaines de fois plus d'images que d'autres, la méthode améliore l'exactitude sur les classes rares d'environ 10 points de pourcentage absolus et réduit une mesure standard d'erreur de calibration de plus de moitié par rapport à une base non corrigée. Dans un test inter‑domaines transférant un modèle entraîné sur des œuvres d'art vers des photos du monde réel, DCP‑AN augmente à la fois l'exactitude dans le nouveau domaine et réduit une mesure statistique de l'écart entre les données source et cible. Fait important, ces gains ne nécessitent pas une forte charge de calcul : en s'exécutant sur une carte graphique moderne, la méthode ajoute un peu plus d'une milliseconde de latence et moins d'un demi‑mégaoctet de mémoire supplémentaire, ce qui la rend pratique pour des dispositifs temps réel et en périphérie.

Ce que cela signifie pour l'IA du quotidien

En termes simples, ce travail montre que nous pouvons rendre les systèmes d'IA non seulement plus intelligents, mais aussi plus conscients de leurs propres incertitudes. En laissant l'information de confiance circuler entre exemples et catégories, et en adaptant l'agressivité des corrections selon l'incertitude changeante, DCP‑AN fournit des estimations de probabilité qui correspondent mieux à la réalité — même pour les événements rares et dans des environnements en mutation. Parce qu'il s'accompagne d'une garantie mathématique que ses mises à jour itératives convergent rapidement, et parce qu'il fonctionne avec une surcharge minimale, ce cadre peut être intégré aux réseaux neuronaux existants dans des domaines comme la santé, la robotique et la surveillance. Le résultat est une IA qui continue à se tromper parfois, mais qui est beaucoup plus honnête sur son degré de certitude — une étape cruciale vers des systèmes sur lesquels on peut compter en toute sécurité.

Citation: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Mots-clés: calibration de la confiance, réseaux neuronaux profonds, reconnaissance à longue traîne, estimation de l'incertitude, adaptation de domaine