Clear Sky Science · fr

ACFM : algorithme de fusion adaptative à pondération par canal pour améliorer la détection d’objets de petite taille dans le trafic vu par UAV

Voir davantage depuis le ciel

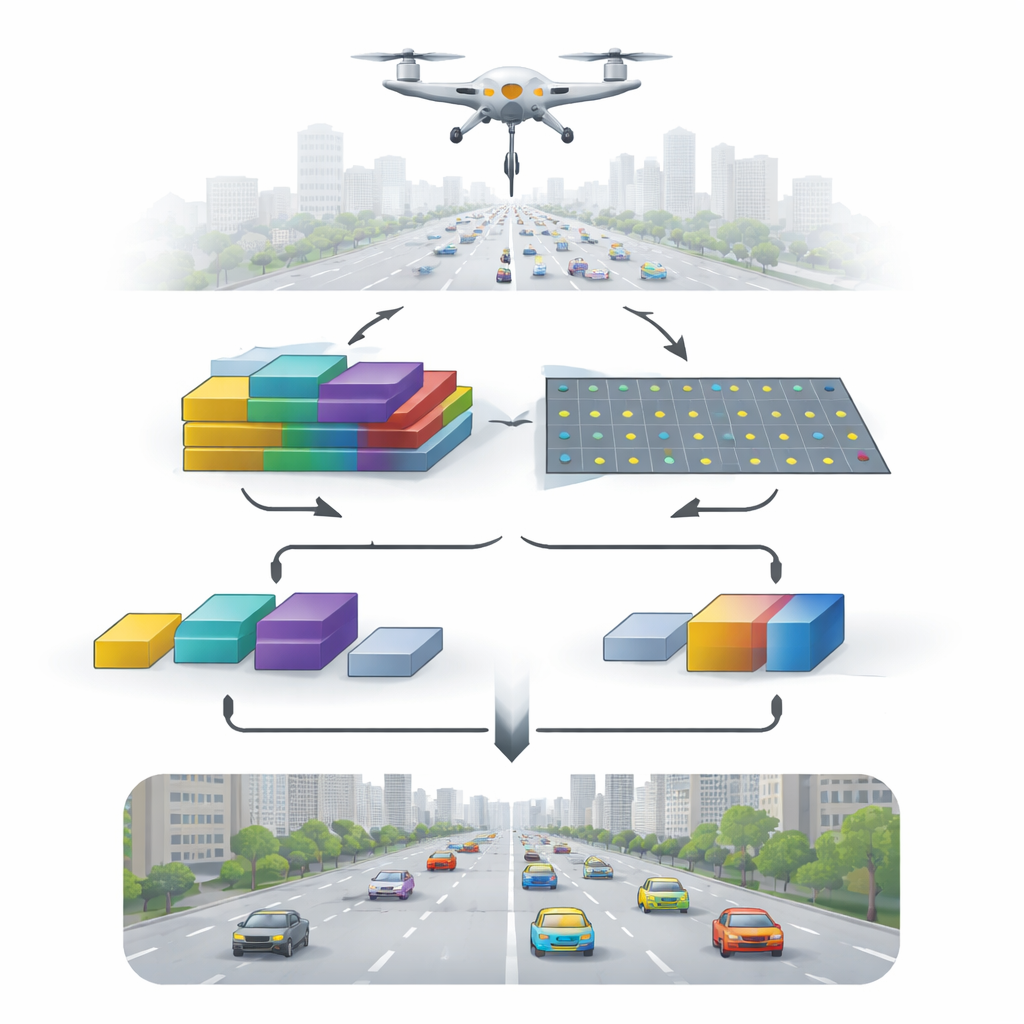

Alors que les drones surveillent de plus en plus le trafic, la sécurité des foules et les zones sinistrées, ils se heurtent à un problème simple mais tenace : vus d’en haut, les éléments qui nous intéressent — voitures, bus, voire personnes — occupent souvent seulement quelques pixels. Ces points minuscules sont faciles à manquer pour les algorithmes, notamment dans des rues urbaines encombrées d’ombres, de panneaux et de flou de mouvement. Cet article présente une nouvelle méthode pour aider les ordinateurs à « voir » plus clairement ces petits objets dans les séquences de drones, sans ralentir excessivement la détection.

Pourquoi les tout petits points comptent

Les caméras de drones captent de larges scènes depuis de grandes altitudes : une seule image peut contenir des autoroutes, des immeubles, des arbres et des dizaines de véhicules. La plupart de ces véhicules apparaissent très petits et peuvent se chevaucher ou se cacher les uns derrière les autres. Les détecteurs profonds traditionnels excellent pour trouver des objets grands et nets, mais ils ont tendance à perdre les détails fins à mesure que l’information traverse les couches profondes du réseau. Le résultat est que les petits véhicules se fondent dans le fond, en particulier aux carrefours encombrés, en faible luminosité ou sur des images légèrement floues. Les méthodes multi-échelle existantes aident dans une certaine mesure en combinant l’information de différentes couches, mais elles reposent généralement sur des règles fixes et préétablies et peinent à s’adapter lorsque la scène devient particulièrement chargée ou complexe.

Une façon plus intelligente de combiner les indices

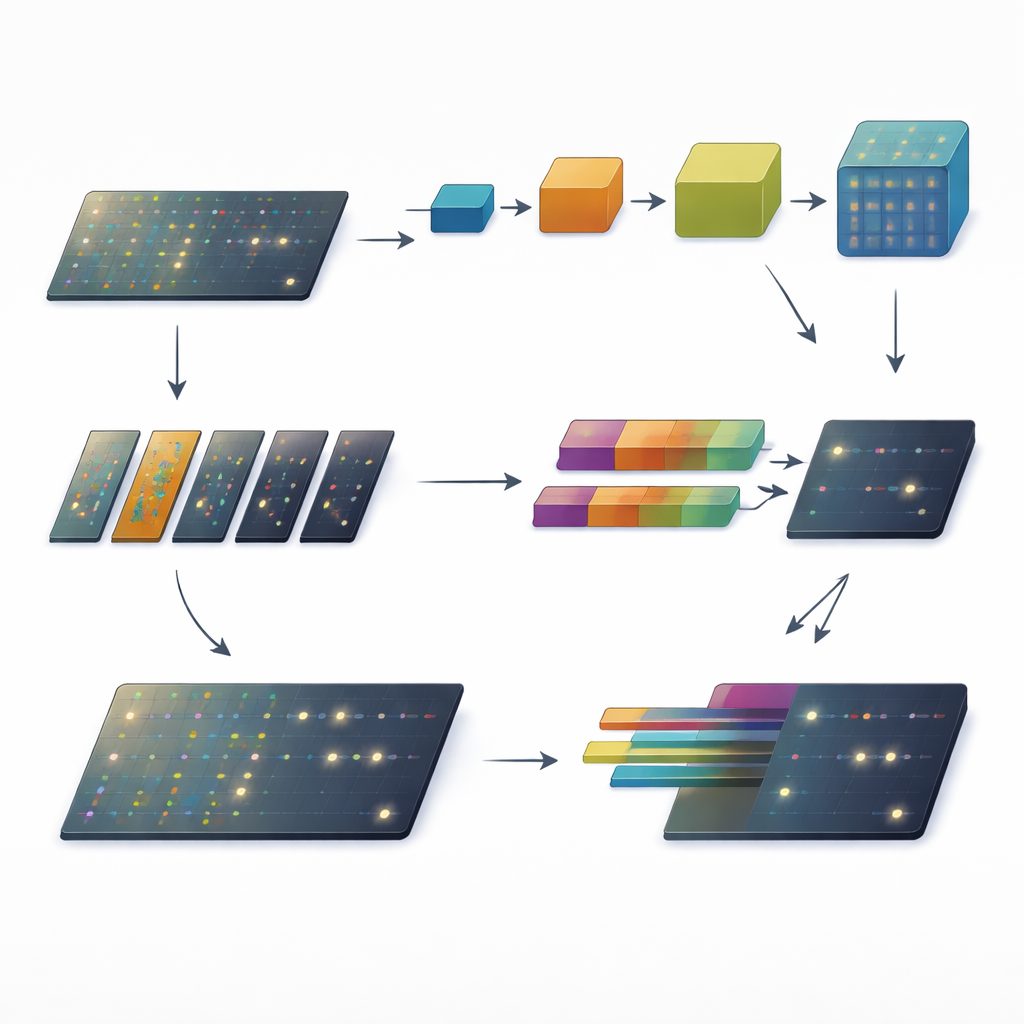

Les auteurs proposent un module de fusion adaptative à pondération par canal, ou ACFM, conçu pour s’intégrer aux détecteurs d’objets existants et améliorer leur capacité à repérer les petites cibles dans les scènes de trafic filmées par drone. Plutôt que de traiter toute l’information visuelle de façon identique, l’ACFM exécute deux branches spécialisées en parallèle puis fusionne leurs sorties de manière dépendante de la scène. Une branche affine le traitement des caractéristiques à travers les échelles afin que les détails spatiaux fins ne soient pas estompés. L’autre branche agit comme un projecteur, renforçant les indices réellement importants concernant les petits objets tout en supprimant les motifs de fond distrayants. Surtout, la fusion entre ces branches n’est pas figée : l’ACFM ajuste la confiance accordée à chaque branche en fonction de l’image courante, permettant au système de réagir différemment à une autoroute calme qu’à un carrefour très dense.

Conserver les détails à travers les échelles

Dans la première branche, appelée bloc de raffinement multi-échelle, le réseau fait passer les caractéristiques par une paire de chemins. Un chemin préserve simplement l’information d’origine, garantissant que les détails fins et à haute résolution survivent. L’autre chemin compresse puis ré-expand l’information visuelle, encourageant le modèle à comprendre le contexte plus large de l’emplacement des petits véhicules dans la scène. À la fin, ces chemins sont fusionnés afin que chaque pixel de sortie bénéficie à la fois d’un détail local net et d’une compréhension de l’environnement proche. Cela facilite pour le détecteur le tracé de boîtes englobantes plus serrées et plus cohérentes autour de petites voitures et bus de tailles différentes, même lorsque l’arrière-plan est chargé ou partiellement masqué.

Atténuer le bruit de fond

La deuxième branche se concentre sur l’attention. Elle divise les canaux de caractéristiques en groupes et, pour chaque groupe, apprend un « masque » parcimonieux qui met en évidence uniquement les régions les plus prometteuses. Les zones qui ressemblent à du fond — surfaces de chaussée, toitures, houppiers d’arbres — sont atténuées, tandis que les signaux minuscules mais significatifs, comme les reflets et les arêtes des véhicules, sont amplifiés. En combinant ces détails affinés avec les caractéristiques d’origine de manière contrôlée, cette branche d’attention groupée et parcimonieuse produit une vue de la scène plus propre et plus discriminative. Le détecteur a alors moins de chances de confondre des motifs sur l’asphalte ou des ombres projetées par des bâtiments avec de véritables véhicules.

Laisser la scène choisir la combinaison

La dernière pièce de l’ACFM est un mécanisme de pondération adaptative au niveau des canaux qui décide, canal par canal, dans quelle mesure se fier à chaque branche. Il commence par résumer ce qui se passe dans l’image entière, puis utilise une opération légère pour inférer un ensemble de poids compris entre zéro et un. Si la scène est simple et que les objets sont bien séparés, le réseau peut s’appuyer davantage sur le raffinement multi-échelle. Si la scène est dense, encombrée ou bruyante, il peut accorder plus d’importance à la branche d’attention qui supprime les distractions de fond. Cet équilibrage dynamique remplace des règles de fusion rigides et artisanales par une stratégie automatique et guidée par les données, permettant au détecteur de réagir de manière souple aux changements d’un cadre à l’autre.

Des yeux plus précis pour le trafic par drone

Intégré à un détecteur populaire nommé GFL et testé sur trois jeux de données publics de trafic par drone, l’ACFM a systématiquement amélioré les scores de détection, en particulier sur des ensembles difficiles contenant de nombreux petits véhicules se chevauchant. Les gains d’exactitude s’obtiennent avec un surcoût informatique limité, ce qui signifie que le système amélioré peut encore fonctionner proche du temps réel — une exigence critique pour la surveillance pratique du trafic. Pour les non-spécialistes, la conclusion est simple : en préservant les détails, en supprimant le bruit et en adaptant la façon dont les caractéristiques sont combinées selon la scène, l’ACFM aide les drones à se comporter davantage comme des observateurs humains attentifs et moins comme des appariements de motifs rigides, offrant une base plus fiable pour les applications futures de villes intelligentes et de surveillance aérienne.

Citation: Liu, S., Zhu, H., Yuan, Z. et al. ACFM: adaptive channel weighted fusion algorithm for improving small object detection performance in UAV traffic. Sci Rep 16, 8366 (2026). https://doi.org/10.1038/s41598-026-39789-6

Mots-clés: surveillance du trafic par drone, détection d’objets de petite taille, vision par ordinateur, mécanismes d’attention, fusion de caractéristiques multi-échelle