Clear Sky Science · fr

Un cadre flexible pour l’optimisation d’hyperparamètres utilisant l’homotopie et des modèles de substitution

Pourquoi régler les commandes de l’IA importe

Les systèmes d’intelligence artificielle modernes dépendent non seulement d’algorithmes astucieux et d’immenses jeux de données, mais aussi d’une couche étonnamment pointilleuse de paramètres appelée « hyperparamètres ». Ce sont les commandes qui déterminent la taille d’un modèle, sa vitesse d’apprentissage et sa gestion du bruit dans les données. Les mal régler peut transformer un système prometteur en échec. Cet article présente HomOpt, une nouvelle manière d’ajuster ces commandes de façon plus efficace et plus fiable, en particulier lorsque l’espace de recherche est vaste et désordonné, ce qui en fait une option attrayante pour quiconque souhaite améliorer l’IA avec moins d’essais et d’erreurs.

Une nouvelle façon d’orienter la recherche

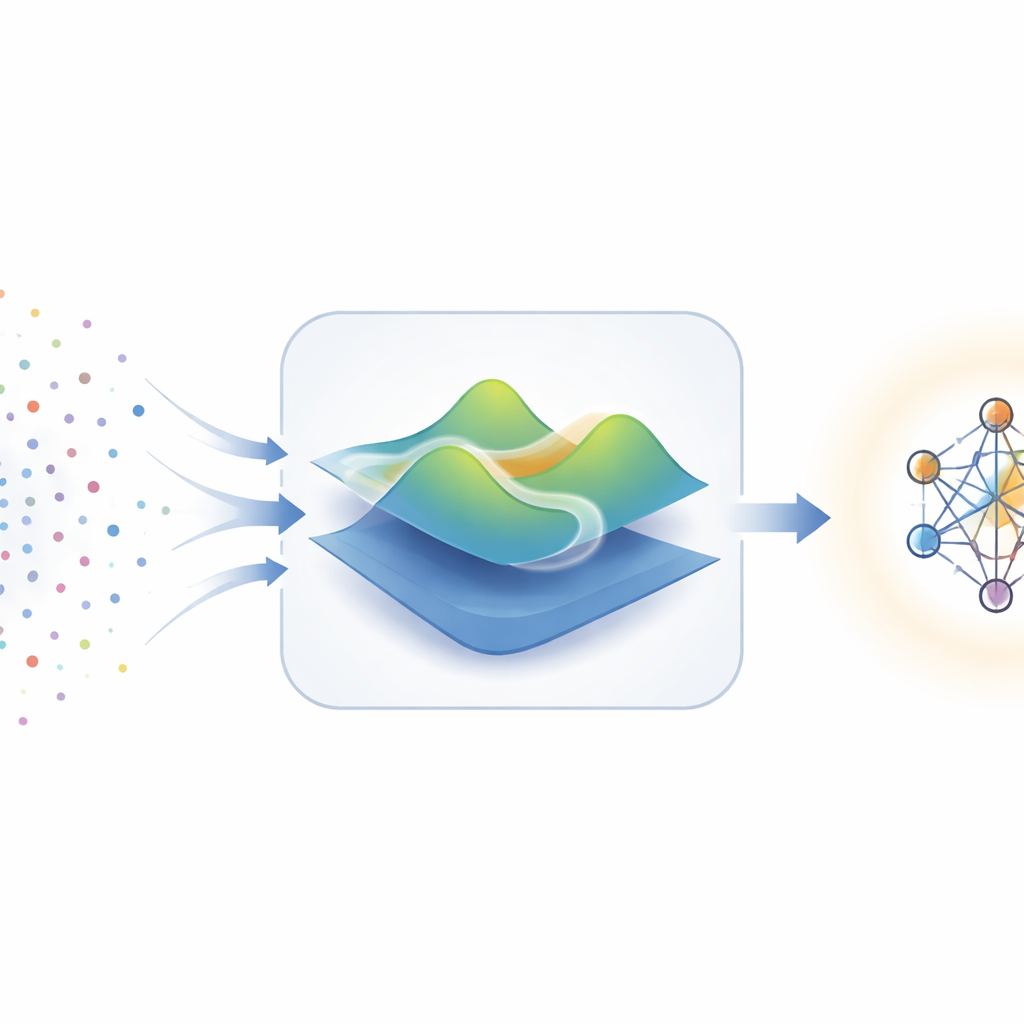

Les approches traditionnelles d’ajustement des hyperparamètres, comme la recherche en grille ou la recherche aléatoire, ressemblent un peu à essayer des recettes en mélangeant des ingrédients en espérant un bon résultat. Des méthodes plus raffinées, comme l’optimisation bayésienne, cherchent à être plus intelligentes en construisant un modèle approximatif de l’influence des réglages sur les performances, puis en utilisant ce modèle pour choisir la prochaine combinaison à tester. Mais ces méthodes supposent que le « paysage » des performances est lisse et bien comporté, ce qui n’est souvent pas le cas dans des problèmes réels pleins d’irrégularités, de bruit et de sauts brusques. HomOpt relève ce défi en construisant à répétition des remplaçants approximatifs du paysage réel — appelés modèles de substitution — puis en transformant en douceur un substitut en un autre à mesure que de nouvelles données arrivent, tout en suivant la manière dont la meilleure solution se déplace au cours de cette transformation.

Morpher les modèles en douceur au lieu de tout recommencer

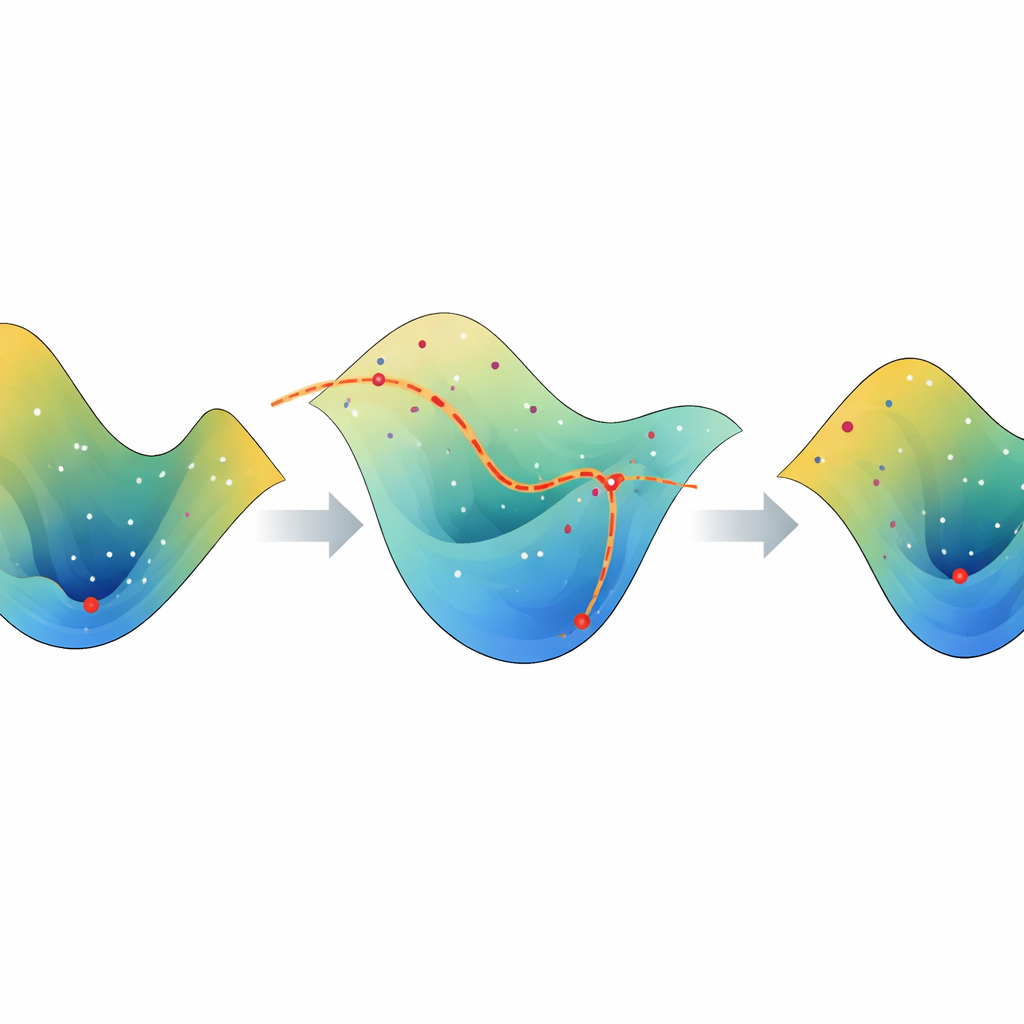

L’idée clé derrière HomOpt provient d’un concept mathématique appelé homotopie qui, en termes simples, consiste à transformer progressivement une forme en une autre sans déchirure ni saut. Dans ce cadre, chaque modèle de substitution est une représentation lissée de la façon dont différents réglages d’hyperparamètres affectent les performances d’un modèle. À mesure que de nouveaux résultats expérimentaux sont recueillis, HomOpt construit un substitut mis à jour puis définit une transformation continue entre les versions ancienne et nouvelle. Plutôt que de jeter le travail précédent et de redémarrer la recherche, il suit la manière dont le meilleur point sur l’ancienne surface glisse à travers ce paysage en transformation pour aboutir à un bon point sur la nouvelle. Ce mouvement guidé rend la recherche plus dirigée et moins aléatoire, augmentant les chances de trouver de meilleurs réglages en moins d’étapes.

Outils flexibles pour différents types de données

Pour montrer que l’idée fonctionne en pratique, les auteurs intègrent deux types très différents de modèles de substitution dans HomOpt. D’abord, ils utilisent des modèles additifs généralisés, qui sont lisses et relativement faciles à interpréter, ce qui les rend utiles lorsque les relations entre réglages et performances évoluent en douceur. Ensuite, ils utilisent CatBoost, une méthode d’ensemble puissante bien adaptée aux problèmes complexes et de grande dimension comme la reconnaissance d’images. HomOpt ne se verrouille pas sur un seul substitut ; il considère le choix du substitut comme un composant enfichable pouvant correspondre à la difficulté et à la structure de la tâche. Le cadre peut gérer des paramètres continus, discrets et catégoriels, et peut s’appuyer sur des stratégies de recherche courantes telles que la recherche aléatoire, l’optimisation bayésienne ou des méthodes basées sur des arbres, agissant comme une couche de raffinement plutôt que comme un remplacement.

Mettre la méthode à l’épreuve

Les chercheurs évaluent HomOpt sur un ensemble diversifié de benchmarks. Sur des tâches classiques d’apprentissage automatique issues de jeux de données tabulaires publics, ils ajustent des modèles tels que les machines à vecteurs de support, les forêts aléatoires, la régression logistique, les perceptrons multicouches et les arbres à gradient boosté. Ils examinent également des problèmes exigeants de reconnaissance à classes ouvertes, où un système doit gérer des catégories inconnues jusqu’alors, en utilisant un classificateur spécialisé appelé Extreme Value Machine. Enfin, ils testent HomOpt sur des tables de recherche d’architecture neuronale pour des jeux d’images bien connus tels que CIFAR-10 et des collections de type ImageNet, où l’espace des conceptions possibles est particulièrement vaste et accidenté. Dans bon nombre de ces contextes, HomOpt accélère soit la descente vers de bonnes solutions, soit améliore la performance finale par rapport aux méthodes sous-jacentes seules, souvent en utilisant moins d’évaluations coûteuses de modèles.

Ce que cela signifie pour la pratique courante de l’IA

Pour les praticiens, le message principal est que HomOpt offre une manière structurée de rendre l’ajustement des hyperparamètres plus intelligent plutôt que simplement plus exhaustif. En affinant continuellement une image approximative du paysage des performances et en suivant de façon lisse le déplacement de son meilleur point à mesure que cette image s’améliore, la méthode réduit les recherches inutiles et optimise l’utilisation de chaque exécution de modèle. Parce qu’elle fonctionne avec une large gamme de mesures de perte, de types de modèles et de stratégies de recherche, HomOpt peut être considérée comme un module complémentaire polyvalent pour les outils d’optimisation existants. En termes clairs, elle promet d’obtenir des systèmes d’IA plus précis et plus robustes avec le même budget de calcul — et ce, de manière évolutive, des petits problèmes tabulaires aux tâches visuelles larges et complexes.

Citation: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Mots-clés: optimisation des hyperparamètres, modèles de substitution, méthodes d’homotopie, apprentissage automatique automatisé, recherche d’architecture neuronale