Clear Sky Science · fr

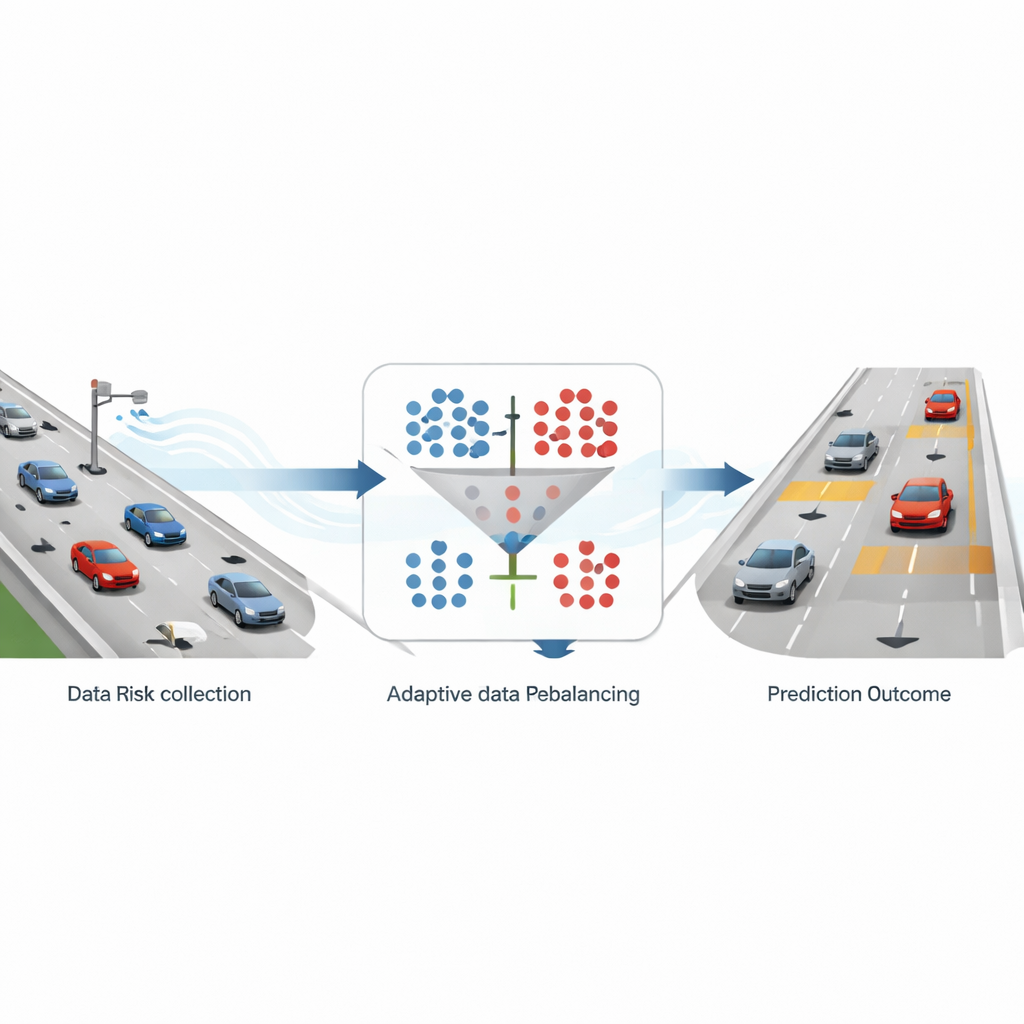

Un cadre adaptatif de rééquilibrage des données pour la prédiction en temps réel des risques routiers

Pourquoi le rééquilibrage des données de trafic est important pour la sécurité

Les accidents autoroutiers sont des événements rares comparés à l’immense quantité de conduite ordinaire et sans incident. C’est une bonne nouvelle pour la sécurité, mais cela crée un problème caché pour les ordinateurs qui tentent de prédire en temps réel quand et où des accidents pourraient survenir. Lorsque les données sont dominées par des situations sûres, les algorithmes peuvent devenir très bons pour prédire « il ne se passera rien » et paraître précis sur le papier — tout en manquant silencieusement les moments réellement dangereux. Cette étude aborde directement ce déséquilibre en proposant une méthode adaptative de « rééquilibrage » des données de trafic afin que les systèmes d’alerte puissent mieux reconnaître des conditions rares mais importantes de risque sans devenir trop lents pour une utilisation opérationnelle.

Comment le trafic réel est transformé en signaux d’alerte

Les chercheurs construisent leur cadre sur des données de trajectoires autoroutières détaillées issues d’un large jeu de données capturé par drone sur des autoroutes allemandes. La position et la vitesse de chaque véhicule sont suivies plusieurs fois par seconde le long de sections à six voies. À partir de cet enregistrement de mouvement riche, l’équipe calcule un indicateur de sécurité largement utilisé appelé temps avant collision, qui estime combien de temps il faudrait à un véhicule suiveur pour percuter le véhicule devant si les deux continuaient de la même façon. Lorsque ce temps passe sous trois secondes, la situation est étiquetée « risque élevé » ; sinon, elle est traitée comme « non risquée ». Après avoir agrégé ces mesures en tranches de 10 secondes et s’être concentrés sur les routes à six voies, ils obtiennent environ neuf échantillons sûrs pour un échantillon risqué, un jeu de données fortement biaisé qui reflète les conditions réelles d’autoroute.

Corriger le biais sans perdre l’essentiel

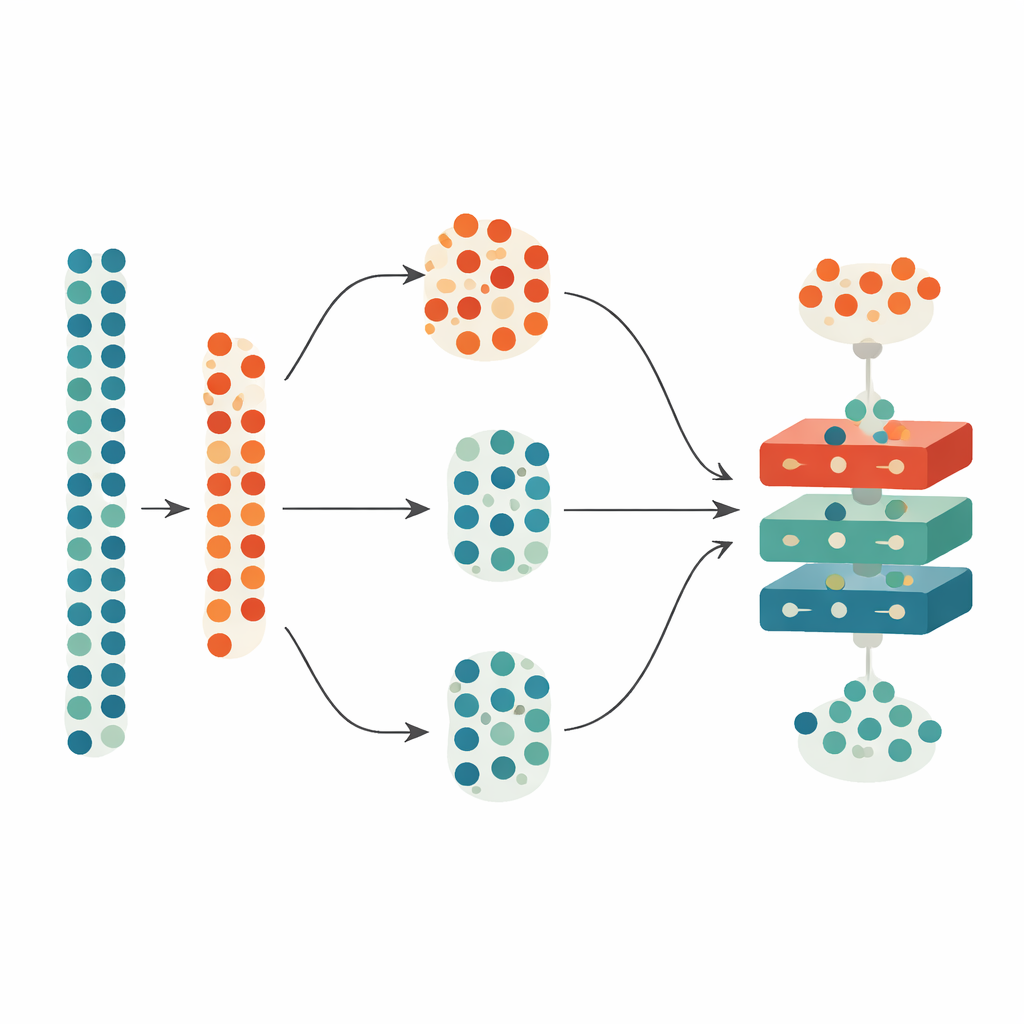

Pour traiter ce biais, l’étude compare deux stratégies courantes. La première, appelée suréchantillonnage, ajoute davantage d’exemples de situations risquées rares en créant des échantillons synthétiques similaires aux cas réels à risque élevé. L’autre, le sous-échantillonnage, réduit le grand nombre de cas sûrs en en supprimant aléatoirement certains. Les auteurs utilisent une méthode de suréchantillonnage populaire (SMOTE) et une méthode simple de sous-échantillonnage aléatoire, en les appliquant à plusieurs ratios fixes de cas sûrs par rapport aux cas risqués — 1:1, 2:1, 3:1 et 4:1. Ils alimentent ensuite à la fois les jeux de données originaux et modifiés dans quatre modèles de prédiction : deux approches traditionnelles d’apprentissage automatique et deux modèles d’apprentissage profond spécialisés dans le traitement des séries temporelles. En testant toutes ces combinaisons, ils peuvent voir comment différentes façons d’équilibrer les données modifient la capacité du système à détecter le risque tout en reconnaissant les conditions sûres.

Laisser un algorithme chercher le point d’équilibre

Plutôt que de supposer qu’un nombre parfaitement égal d’échantillons sûrs et risqués est optimal, les chercheurs laissent un algorithme génétique — une méthode de recherche inspirée de l’évolution — chercher l’équilibre le plus efficace. Cet optimiseur ajuste le ratio sûr/risque dans une plage réaliste allant de 1:1 à 4:1, en générant à plusieurs reprises des ratios candidats, en les évaluant et en les affinant sur des centaines d’itérations. De manière cruciale, il ne se concentre pas uniquement sur la précision de la prédiction : il prend aussi en compte le temps nécessaire pour entraîner le modèle et effectuer les prédictions, reflétant les exigences en temps réel des centres de gestion du trafic. Pour garantir que précision et temps de calcul puissent être combinés équitablement, toutes les mesures sont normalisées avant d’être fusionnées en un seul score de « fitness » que l’algorithme cherche à minimiser.

Ce que les modèles apprennent sur le risque routier

À travers les nombreuses expériences, un constat se dégage. Le rééquilibrage des données améliore la prédiction du risque par rapport au maintien du biais original, et le suréchantillonnage avec des cas risqués synthétiques tend à mieux marcher que l’élimination de cas sûrs. Un ratio de 2:1 de cas sûrs à risqués fournit la meilleure performance parmi les réglages fixes, surpassant le choix répandu de 1:1. Lorsque l’algorithme génétique est autorisé à affiner ce ratio, il converge vers des valeurs légèrement inégales mais optimales — environ 2,3:1 pour le suréchantillonnage et 2,7:1 pour le sous-échantillonnage. Parmi les modèles de prédiction, un type particulier de réseau de neurones récurrents connu sous le nom de gated recurrent unit offre systématiquement les meilleurs résultats, surtout lorsqu’il est associé au suréchantillonnage et à l’optimisation. Les modèles montrent également que les vitesses moyennes des véhicules en amont et en aval d’un point de l’autoroute sont plus informatives pour le risque que de simples comptages de véhicules.

Vérifier la stabilité et préparer le déploiement réel

Comme les méthodes d’optimisation peuvent parfois rester bloquées sur des solutions trompeuses, les auteurs examinent le comportement de leur recherche au fil du temps. Ils montrent que les scores de fitness diminuent régulièrement puis se stabilisent, suggérant que l’algorithme converge vers des ratios stables et de haute qualité plutôt que d’osciller. Ils font ensuite varier les ratios choisis de quelques pourcents pour voir si la performance s’effondre. En pratique, la précision diminue seulement légèrement sous de petits changements, indiquant que le système est robuste et pas excessivement ajusté à un réglage unique et fragile. Cependant, lorsque la portion des données réservée au test devient très grande, les modèles deviennent plus sensibles, ce qui souligne la nécessité de disposer de données d’entraînement suffisamment riches.

Ce que cela signifie pour des autoroutes plus sûres et plus intelligentes

En termes simples, l’étude montre que faire apprendre aux ordinateurs à reconnaître le danger sur la route ne dépend pas seulement de modèles ingénieux ; il s’agit aussi d’alimenter ces modèles avec une vision équilibrée des événements rares mais critiques. En ajustant soigneusement le nombre d’exemples sûrs et risqués utilisés pour l’entraînement — et en laissant un algorithme adaptatif trouver le meilleur compromis entre précision et rapidité — le cadre proposé rend la prédiction du risque en temps réel sur autoroute plus fiable et plus pratique. Les agences de la circulation pourraient intégrer cette approche dans des systèmes qui surveillent les données des détecteurs de trafic et émettent des alertes précoces sur les collisions par l’arrière probables, aidant à orienter les alertes aux conducteurs, le déploiement des patrouilles ou les stratégies de freinage automatique. Bien que le travail soit démontré sur des autoroutes allemandes par temps favorable, l’idée sous-jacente du rééquilibrage adaptatif des données offre une recette générale pour améliorer les prédictions de sécurité partout où les événements dangereux sont rares mais trop importants pour être manqués.

Citation: Chen, S., Cui, B. & Chang, A. An adaptive data rebalancing framework for real-time traffic risk prediction. Sci Rep 16, 8882 (2026). https://doi.org/10.1038/s41598-026-39539-8

Mots-clés: sécurité routière, prédiction du risque d’accident, données déséquilibrées, apprentissage automatique, trajectoires autoroutières