Clear Sky Science · fr

Évaluation comparative des grands modèles vidéo en langage pour l’évaluation de la qualité des vidéos de vulgarisation sur le syndrome de l’œil sec

Pourquoi cela compte pour les spectateurs quotidiens

Les applications de courtes vidéos deviennent rapidement le premier réflexe des gens pour obtenir des conseils de santé, y compris pour des problèmes oculaires comme l’œil sec, qui touche des centaines de millions de personnes dans le monde. Mais, aux côtés de clips utiles, il est facile de trouver des vidéos de faible qualité ou trompeuses, et les médecins ont du mal à les contrôler. Cette étude se demande si les nouveaux systèmes d’intelligence artificielle capables de « regarder » des vidéos pourraient aider à vérifier automatiquement la qualité de ces contenus de santé, et montre pourquoi, pour l’instant, ces outils ne sont pas prêts à remplacer le jugement d’un expert.

Les yeux secs et l’essor des vidéos de santé

L’œil sec n’est pas une simple nuisance ; il peut brouiller la vision, provoquer des douleurs et perturber le travail et la vie quotidienne. À mesure que cette affection devient plus fréquente, en particulier chez les personnes âgées et les gros utilisateurs d’écrans, beaucoup recherchent en ligne des explications et des conseils d’auto‑soins. Des plateformes comme TikTok hébergent d’innombrables courtes vidéos sur l’œil sec, mais leur caractère ouvert permet à quiconque de publier du contenu, sans exigence de formation médicale. Des conseils erronés ou exagérés peuvent retarder un traitement adapté ou encourager des remèdes dangereux à domicile, d’où l’urgence de méthodes fiables pour vérifier la qualité des vidéos à grande échelle.

Comment les chercheurs ont testé les réviseurs vidéo IA

L’équipe a rassemblé 185 vidéos en chinois sur TikTok portant sur l’œil sec en utilisant un nouveau compte neutre et des règles strictes pour ne garder que des clips originaux et éducatifs. Deux spécialistes en ophtalmologie ont ensuite noté chaque vidéo avec trois outils établis souvent utilisés dans la recherche en éducation médicale. Un outil évaluait la facilité de compréhension des vidéos et la clarté avec laquelle elles proposaient des étapes concrètes que les spectateurs pouvaient entreprendre. Un second attribuait une note globale de qualité allant de médiocre à excellente. Le troisième décomposait la qualité en aspects tels que la fluidité de la présentation, l’exactitude des informations, l’utilisation d’éléments supplémentaires comme des animations, et la concordance entre le contenu et le titre de la vidéo.

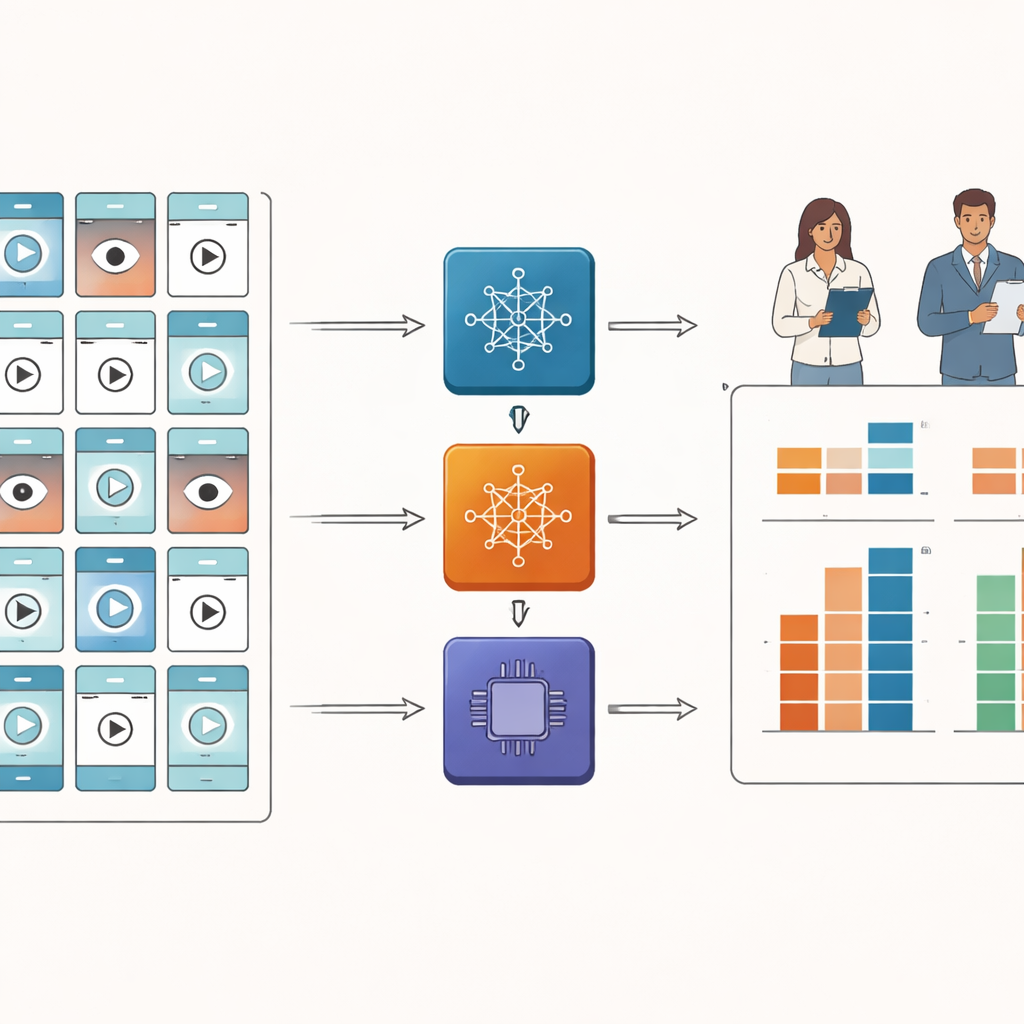

Mettre à l’épreuve des modèles IA spécialisés vidéo

Puis, les chercheurs ont soumis les mêmes vidéos à trois « grands modèles vidéo en langage » avancés, des systèmes d’IA conçus pour interpréter des informations visuelles image par image et répondre à des questions sur ce qu’ils voient. Ils ont rédigé des instructions détaillées afin que chaque modèle imite au plus près les outils de notation des médecins. La question clé était de savoir si l’IA et les experts humains donneraient des notes similaires. Pour le mesurer, l’équipe a utilisé une statistique de fiabilité standard qui capture combien deux « juges » différents concordent, non seulement en tendances mais en valeurs numériques réelles.

Ce que l’IA a bien — et mal — fait

Les évaluateurs humains étaient globalement d’accord entre eux, ce qui suggère que leurs notes étaient stables et fiables. En revanche, les trois systèmes d’IA ont montré une faible concordance avec les experts sur la plupart des points. Aucun des modèles n’a pu reproduire de façon fiable les médecins sur la qualité globale des vidéos ni sur des caractéristiques détaillées telles que la fidélité du titre au contenu. Un modèle avait tendance à attribuer des notes plus élevées que les experts, un autre à noter plus bas, et un seul se situait parfois entre les deux. Le seul point relativement positif concernait l’« actionnabilité » — la clarté des consignes données aux spectateurs — où deux modèles ont atteint un niveau moyen d’accord, sans toutefois atteindre le seuil requis pour une prise de décision en conditions réelles.

Pourquoi l’IA actuelle est insuffisante

Les auteurs évoquent plusieurs raisons à cet écart. Les systèmes testés ont été principalement entraînés sur des scènes de la vie quotidienne et des tâches vidéo génériques, pas sur des contenus d’éducation sanitaire structurés. De nombreuses vidéos scientifiques reposent fortement sur des explications orales, des sous‑titres, des graphiques et des métaphores plutôt que sur des images animées spectaculaires ; or les modèles de cette étude n’ont analysé que les images fixes extraites des vidéos et n’ont ni écouté l’audio ni lu les titres et autres informations descriptives que les humains utilisent pour juger de la pertinence et de l’exactitude. Par conséquent, de larges pans de sens n’ont jamais atteint l’IA, en particulier lorsque des détails clés étaient énoncés plutôt que montrés. Le langage figuré, fréquent dans l’éducation à la santé en chinois, peut aussi dérouter des systèmes qui interprètent les énoncés au pied de la lettre.

Ce que cela signifie pour les patients et les plateformes

Ce travail fournit une feuille de route préliminaire, pas un filet de sécurité prêt à l’emploi. Il montre que, en principe, des listes de contrôle de qualité familières pour l’information sanitaire peuvent être traduites en consignes pour des modèles d’IA capables d’analyser des vidéos. Il souligne aussi que les systèmes généraux actuels ne sont pas encore suffisamment fiables pour noter des vidéos médicales ou combattre la désinformation sans supervision humaine. En publiant leur cadre d’évaluation et leur jeu de données vidéo annoté, les auteurs espèrent inciter le développement de modèles plus spécialisés qui sauront combiner visuel, son et contexte supplémentaire, et fonctionneront à travers maladies et langues. Pour l’heure, les spectateurs devraient continuer à considérer les courtes vidéos de santé comme des points de départ, et non comme des conseils médicaux, et les plateformes ne devraient pas compter uniquement sur l’IA pour garantir des informations dignes de confiance.

Citation: Zhou, S., Huang, M., Wei, J. et al. Benchmark evaluation of video large language models in quality assessment of science popularization videos for dry eye. Sci Rep 16, 8756 (2026). https://doi.org/10.1038/s41598-026-39444-0

Mots-clés: maladie de l’œil sec, vidéos de santé, intelligence artificielle, désinformation, TikTok