Clear Sky Science · fr

Optimisation des mesures d’intervention contre les maladies infectieuses par apprentissage par renforcement avec les données épidémiques du COVID-19 au Royaume-Uni

Outils intelligents pour des décisions sanitaires difficiles

Lorsqu’une nouvelle maladie se propage dans un pays, les responsables doivent décider rapidement du degré de restriction de la vie quotidienne. Tout fermer peut sauver des vies mais ruiner l’économie ; agir trop lentement peut conduire à la saturation des hôpitaux. Cet article examine si une forme d’intelligence artificielle, appelée apprentissage par renforcement, peut aider les gouvernements à trouver des réponses plus intelligentes et équilibrées en s’appuyant sur des simulations détaillées de la manière dont un virus comme le COVID‑19 se propage réellement dans des communautés réelles.

Simuler un pays dans un ordinateur

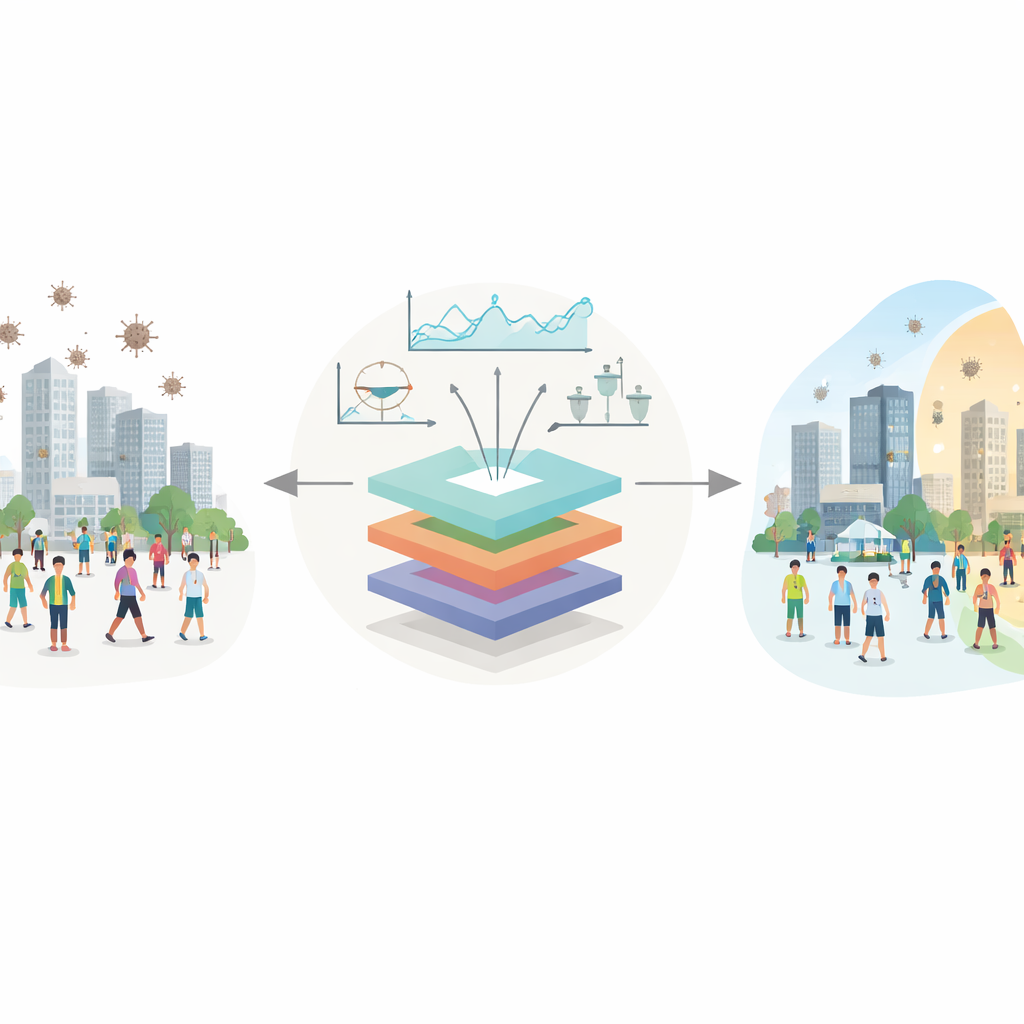

Plutôt que d’utiliser des équations simples qui traitent les individus comme identiques, les auteurs s’appuient sur Covasim, un modèle informatique riche qui suit des milliers d’individus virtuels dans leur vie quotidienne : domicile, travail, études et interactions. Chaque personne simulée a un âge, une place dans un foyer, des réseaux scolaires et professionnels, et un état de santé pouvant évoluer de sain à infecté, puis rétabli ou décédé. En ajustant soigneusement les paramètres du modèle, l’équipe fait en sorte que ce Royaume‑Uni virtuel se comporte comme le Royaume‑Uni réel pendant la première vague de COVID‑19, en reproduisant les comptes officiels de cas et de décès du début de 2020. Cette étape de calibration est cruciale, car toute stratégie apprise par l’ordinateur doit fonctionner dans un monde ressemblant au nôtre, et non dans un univers jouet.

Apprendre à un conseiller numérique à agir

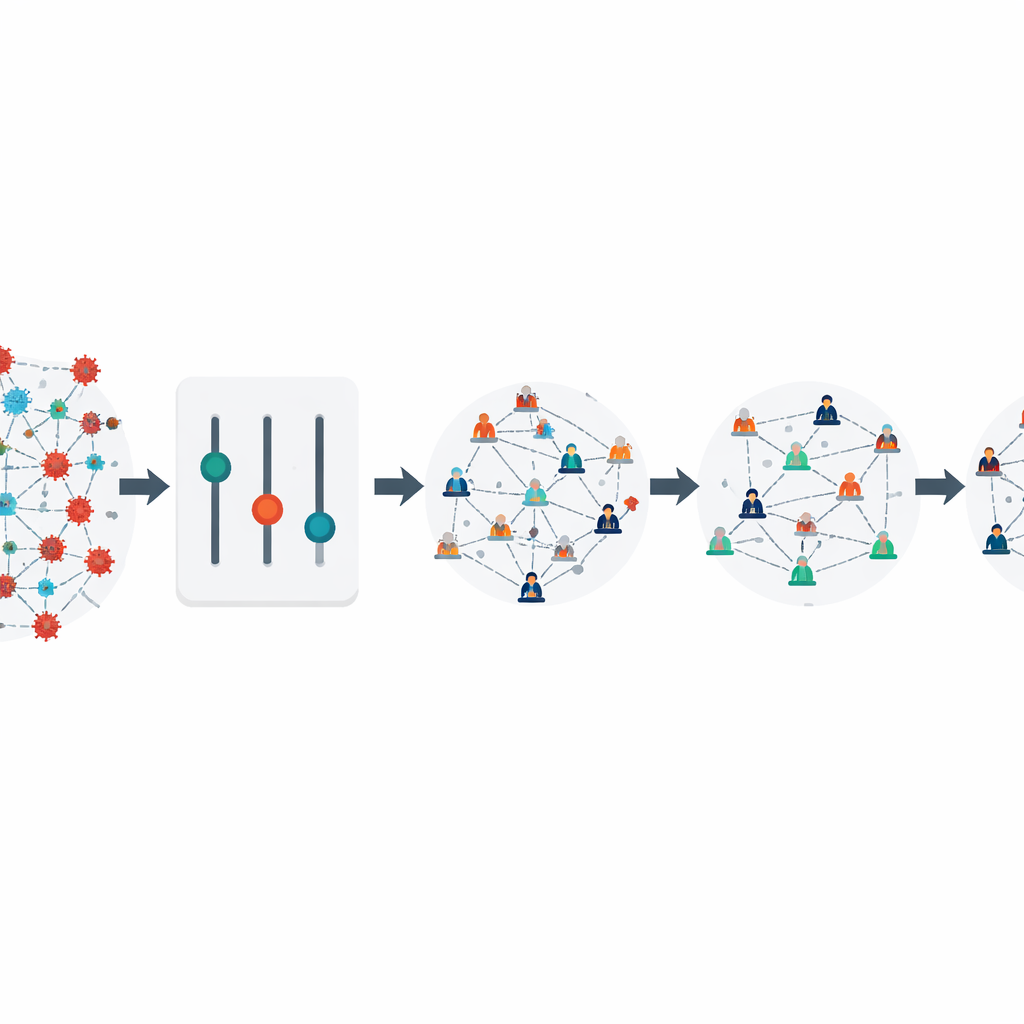

Une fois le modèle rendu proche de la réalité, les chercheurs intègrent l’apprentissage par renforcement, une branche de l’IA dans laquelle un « agent » logiciel teste à répétition des décisions et est récompensé ou pénalisé selon les résultats. Ici, l’agent peut ajuster trois leviers principaux chaque semaine simulée : le degré de sévérité des confinements partiels, le nombre de personnes testées et l’intensité du traçage des contacts. Le système de récompense est conçu pour capturer deux objectifs concurrents : maintenir bas le nombre d’infections, de formes graves et de décès, tout en limitant les dommages économiques causés par la fermeture des lieux de travail et l’isolement des personnes. En exécutant des milliers d’épidémies simulées, l’agent découvre quelles combinaisons et quels calendriers de mesures obtiennent le meilleur score global.

Trouver un meilleur équilibre que des règles fixes

L’étude compare plusieurs méthodes d’apprentissage et manières de représenter les choix de l’agent. Une méthode qui traite les actions comme des réglages continus, plutôt que comme un petit menu d’options fixes, donne des résultats particulièrement bons. Elle apprend à répondre rapidement lorsque le virus commence à se propager, en imposant des restrictions courtes mais fortes associées à un dépistage et un traçage intensifs. Quand l’épidémie simulée est sous contrôle, elle assouplit les confinements tout en maintenant une certaine capacité de test et de traçage, puis resserre à nouveau brièvement si les infections menacent de repartir. Ce schéma flexible limite le nombre total d’infections à environ 300 000 dans le modèle, bien en dessous de ce qui s’est produit avec les politiques réelles appliquées au Royaume‑Uni durant la même période, et aussi inférieur à une règle simple de « sept jours ouverts, sept jours confinés ». Les pertes économiques dans le modèle sont réduites de plus des deux tiers par rapport à cette stratégie rigide d’alternance de confinements.

Le calendrier est décisif

Les auteurs examinent aussi comment ces différentes stratégies influent sur le nombre de reproduction en temps réel, une mesure du nombre de nouvelles infections générées par chaque cas. Dans leurs simulations, la politique conçue par l’IA fait passer ce nombre en dessous de la valeur critique d’un environ un mois plus tôt que la réponse réelle du Royaume‑Uni. Ce décalage apparemment faible réduit dramatiquement le nombre cumulé d’infections, soulignant l’importance d’une action rapide et bien planifiée. Ils testent en outre la politique apprise dans un contexte très différent, en utilisant les données de la forte vague de COVID‑19 à Hong Kong en 2022, et trouvent que la même stratégie fonctionne encore bien, ce qui suggère que les règles apprises captent des principes généraux plutôt que de se surajuster à un seul pays.

Qu’est‑ce que cela signifie pour les futures épidémies

Pour le grand public, le message principal est que l’on n’a pas à choisir aveuglément entre sauver des vies et préserver des moyens de subsistance. En combinant des simulations détaillées de la façon dont un virus circule dans des réseaux sociaux réels avec une IA qui apprend par essais‑erreurs, les décideurs pourraient disposer de guides d’action fondés sur les données et adaptables aux évolutions. Les auteurs soulignent que de tels outils ne sont pas destinés à remplacer le jugement humain, mais à servir d’aides puissantes à la décision, explorant d’innombrables scénarios « et si » bien plus rapidement que ne le peuvent les humains. À l’émergence de nouvelles épidémies, cette approche pourrait aider les responsables à agir plus tôt et avec plus de précision, en utilisant un dépistage, un traçage et des fermetures partielles ciblés pour contenir la maladie tout en préservant autant que possible la vie normale et l’activité économique.

Citation: Zhang, B., Chen, Y., Li, H. et al. Optimization of infectious disease intervention measures using reinforcement learning with UK COVID-19 epidemic data. Sci Rep 16, 10627 (2026). https://doi.org/10.1038/s41598-026-39377-8

Mots-clés: politique COVID-19, apprentissage par renforcement, simulation épidémique, interventions non pharmaceutiques, stratégie de santé publique