Clear Sky Science · fr

Analyse de la relation entre traits du locuteur et caractéristiques multimodales respectueuse de la vie privée dans les entretiens d’embauche

Pourquoi votre voix dans les entretiens d’embauche soulève de nouvelles questions

De plus en plus d’entreprises recourent à des entretiens vidéo automatisés, où des algorithmes analysent la façon dont vous parlez pour en déduire des traits tels que la confiance, la fiabilité ou la sociabilité. Mais la voix véhicule bien plus qu’une première impression : elle peut suggérer votre identité, votre état de santé ou votre origine. Cet article examine s’il est possible de masquer qui vous êtes dans un enregistrement tout en permettant aux systèmes informatiques d’évaluer la façon dont vous vous présentez en tant que candidat. Autrement dit, peut-on conserver les bénéfices du recrutement assisté par IA sans compromettre discrètement notre vie privée ?

Des premières impressions aux jugements automatisés

Les psychologues du travail savent depuis longtemps que des schémas de personnalité larges — souvent décrits par les cinq grands traits (ou Big Five) : ouverture, conscienciosité, extraversion, agréabilité et stabilité émotionnelle — sont importants pour la réussite professionnelle. Les progrès récents en intelligence artificielle permettent aux machines d’estimer ces traits à partir de la façon dont les personnes parlent lors d’entretiens, en captant non seulement ce que disent les candidats mais aussi comment ils le disent : hauteur, intensité, rythme et style global de la parole. Ces systèmes promettent un tri des candidats plus rapide et plus cohérent. Ils posent cependant une question préoccupante : si une entreprise conserve votre voix, ces mêmes données pourraient-elles être réutilisées plus tard pour vous identifier, vous profiler ou inférer des informations sensibles que vous n’avez pas accepté de partager ?

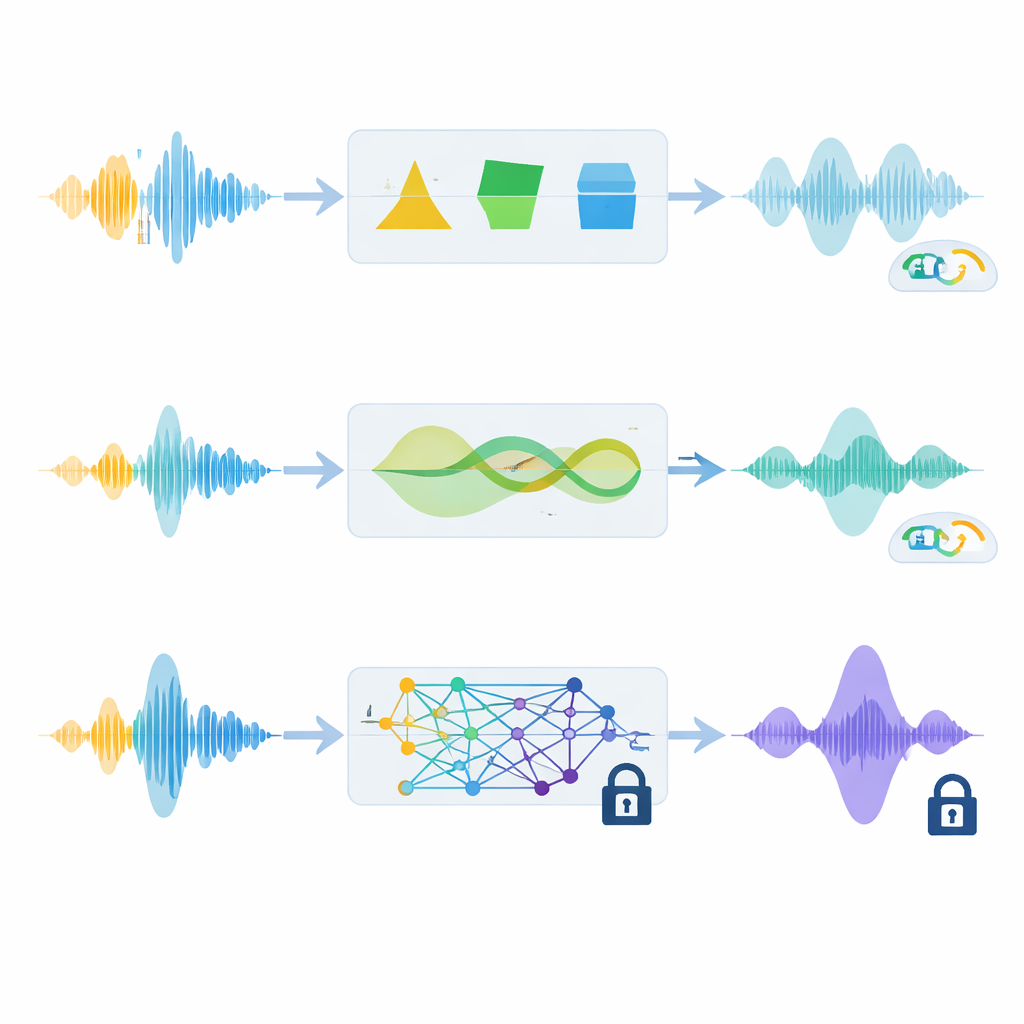

Comment masquer une voix sans en perdre le caractère

Pour aborder ce dilemme, les chercheurs ont étudié des techniques qui transforment la voix d’une personne pour qu’elle ne lui ressemble plus, tout en préservant les indices nécessaires aux évaluations de personnalité et d’aptitude. Ils se sont concentrés sur trois méthodes d’anonymisation. Deux d’entre elles utilisent des procédés audio traditionnels, comme le remodelage subtil des fréquences et l’étirement ou le décalage de la hauteur sur la durée. La troisième repose sur un codec audio neuronal moderne, qui compresse la voix en une série de codes numériques puis la reconstruit sous la forme d’une voix nouvelle, de haute qualité mais différente. De manière cruciale, l’équipe a ajusté toutes les méthodes pour que le genre perçu du locuteur reste le même et que la voix convertie soit cohérente sur plusieurs réponses au cours d’un long entretien en ligne.

Tester la confidentialité et l’utilité

En utilisant près de 1 900 vidéos réelles d’entretiens d’embauche en ligne provenant de personnes aux États-Unis, les auteurs ont posé deux questions principales. D’abord, dans quelle mesure un attaquant pourrait-il associer des voix anonymisées aux locuteurs originaux en utilisant un système avancé de reconnaissance vocale ? Ensuite, après anonymisation, les algorithmes pouvaient-ils encore prédire les notes de personnalité clés et les recommandations de recrutement avec une précision comparable ? Ils ont évalué la confidentialité à l’aide d’un taux d’erreur issu de la vérification automatique du locuteur — plus l’erreur est élevée, meilleure est la protection — et mesuré l’utilité via la précision de la reconnaissance vocale, la qualité audio perçue et la capacité des modèles d’apprentissage automatique à inférer traits et décisions de recrutement à partir de caractéristiques acoustiques et linguistiques.

À quoi ressemble vraiment le compromis

Les résultats révèlent un équilibre nuancé entre sécurité et performance. La méthode la plus simple, qui modifie légèrement les fréquences de la voix, n’a offert qu’une confidentialité modeste et pouvait échouer presque complètement lorsque le système de l’attaquant était adapté aux voix anonymisées. Une technique plus avancée basée sur le signal, qui modifie le timing et la hauteur, s’est montrée bien plus efficace : elle a réduit significativement les chances de réidentification tout en préservant le rythme et l’expressivité de la parole. En conséquence, les prédictions liées au recrutement et à la personnalité restaient proches de celles faites sur les enregistrements originaux. Le codec audio neuronal a fourni la confidentialité la plus forte, rendant beaucoup plus difficile le lien entre voix anonymisées et locuteurs réels, et a souvent permis d’atténuer le bruit de fond. Cependant, dans les enregistrements d’entretien bruyants et réalistes, cette méthode a aussi perturbé des indices prosodiques subtils qui influencent la perception des traits, entraînant une baisse notable des performances d’estimation des traits et des erreurs plus élevées dans la transcription automatique.

Ce que cela signifie pour un recrutement équitable et privé

L’étude montre qu’il n’existe pas de solution universelle : une confidentialité renforcée se fait souvent au détriment de la capacité de l’IA à lire la personnalité et à recommander des candidats. Pour des contextes de recrutement typiques où l’estimation des traits et les décisions équitables sont prioritaires, des approches de traitement du signal affinées — en particulier la méthode basée sur la phase testée ici — peuvent offrir le meilleur compromis, protégeant l’identité tout en préservant la « couleur » de la voix d’une personne. Dans des situations où les exigences de confidentialité sont plus élevées, comme le partage large de données vocales ou la protection contre des attaquants puissants, les méthodes de codec neuronal apportent une meilleure protection, mais les concepteurs doivent accepter une perte de précision dans l’évaluation de la personnalité et de l’adéquation. En fin de compte, les auteurs soutiennent que la protection de la voix des candidat·e·s doit être considérée comme une exigence éthique, et non comme une réflexion après coup, et que les outils futurs doivent cibler avec soin les aspects de la parole à masquer et ceux à préserver.

Citation: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Mots-clés: anonymisation de la voix, recrutement par IA, traits du locuteur, confidentialité des données vocales, entretiens d’embauche