Clear Sky Science · fr

Reconnaissance des émotions dominantes par vidéo pour appareils EEG portables

Pourquoi vos vidéos peuvent savoir ce que vous ressentez

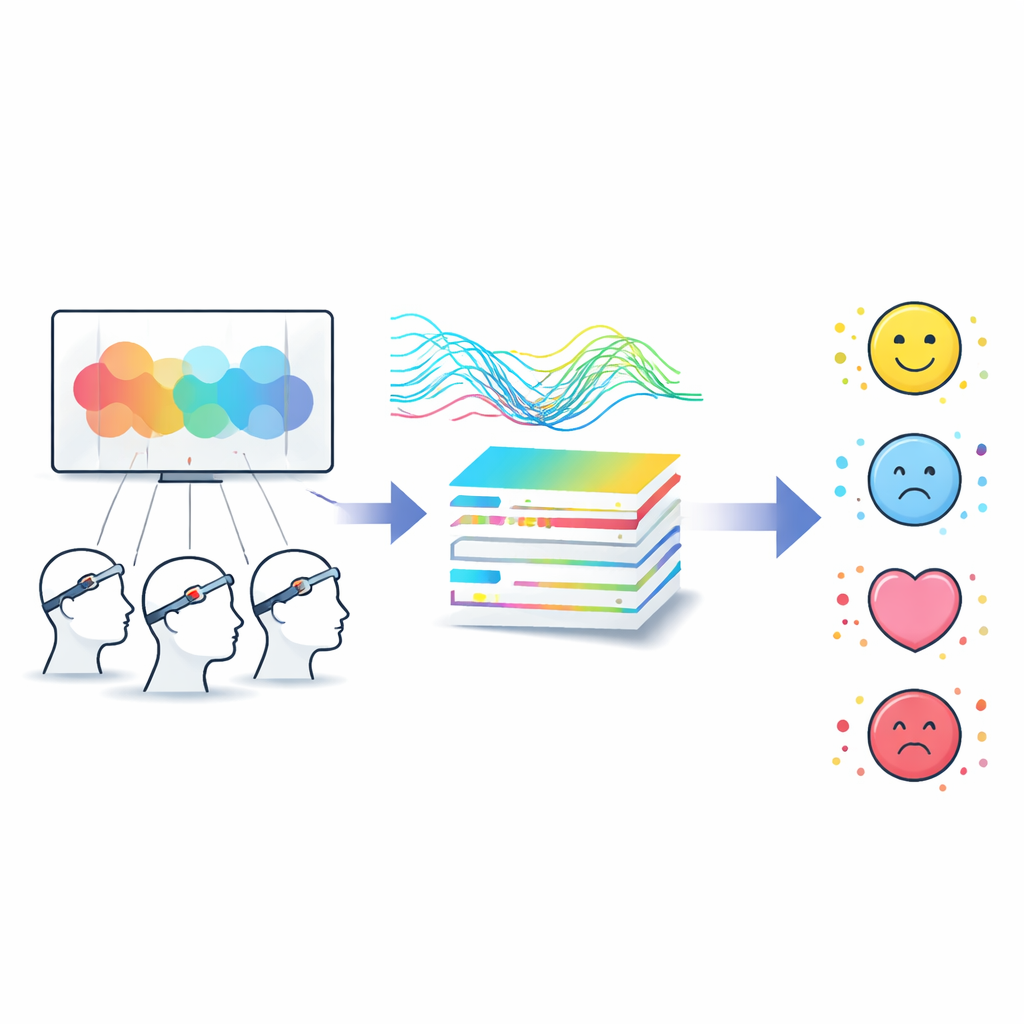

Imaginez regarder une bande-annonce pendant qu'un bandeau léger écoute discrètement votre cerveau et devine si vous vous sentez heureux, détendu, triste ou effrayé. Cette étude explore comment rendre ce scénario réaliste en utilisant un petit appareil portable d'électroencéphalographie (EEG) plutôt que du matériel volumineux de laboratoire. Ce travail intéresse quiconque s'intéresse aux médias plus intelligents : des annonceurs souhaitant comprendre les réactions du public aux plateformes de streaming qui pourraient recommander des programmes en fonction de ce que les spectateurs ressentent réellement, et non seulement de ce sur quoi ils cliquent.

Lire les émotions à partir des ondes cérébrales

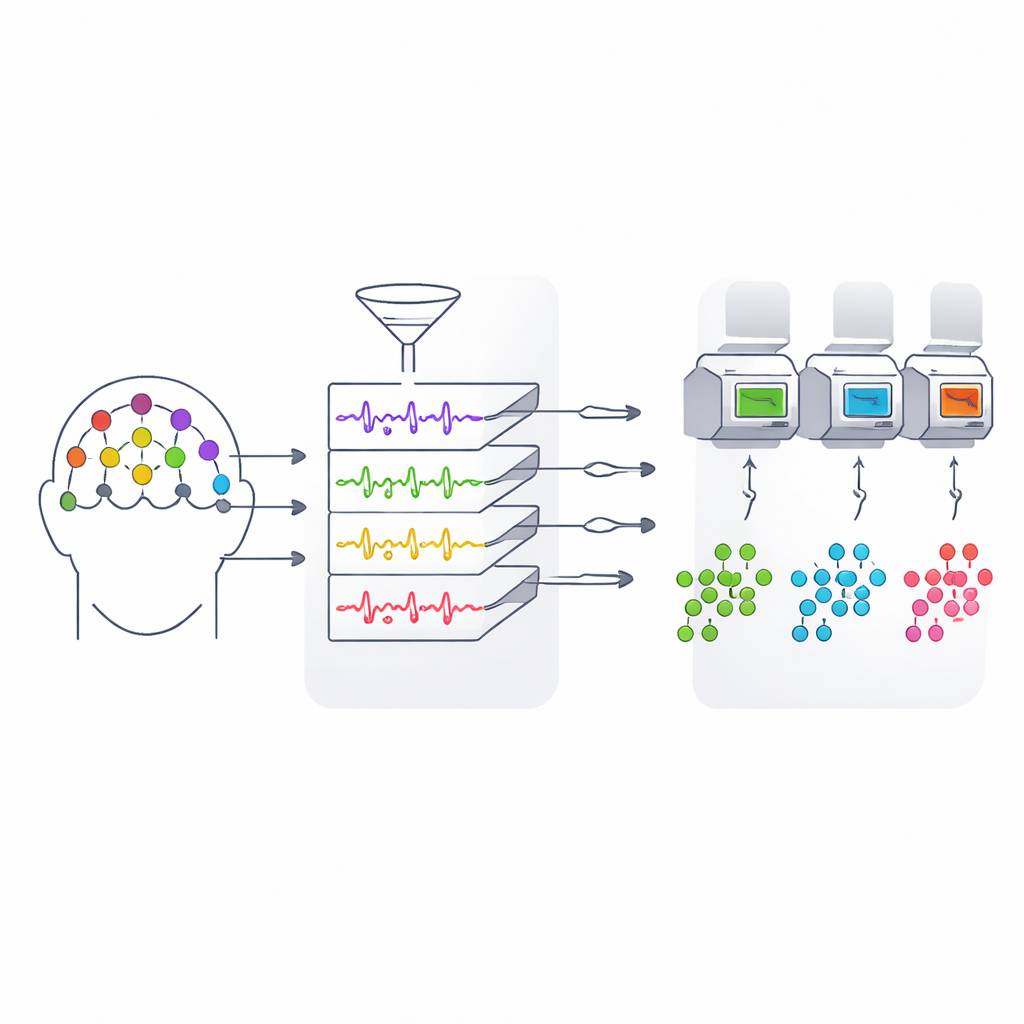

Notre cerveau produit de faibles signaux électriques captables au niveau du cuir chevelu par électroencéphalographie, ou EEG. Ces signaux varient subtilement lorsque nous éprouvons différentes émotions. Un jeu de données de recherche populaire, appelé DEAP, a enregistré l'EEG de personnes regardant des clips musicaux puis leur a demandé d'évaluer combien chaque vidéo était agréable, intense, contrôlée et appréciée. La plupart des études antérieures ont cherché à maximiser la précision en utilisant de nombreux électrodes et des ordinateurs puissants, mais dans des conditions de laboratoire idéales qui ne correspondent pas à la vie réelle. Cet article pose au contraire une question plus pragmatique : avec un appareil portable peu coûteux et moins d'électrodes, peut-on toujours capturer l'émotion principale qu'une vidéo tend à évoquer chez un grand nombre de personnes ?

Trouver une histoire émotionnelle partagée

Un obstacle est que les personnes n'expriment pas leurs sentiments de la même manière. Deux spectateurs peuvent regarder le même extrait, l'un le qualifiant d'« excitant », l'autre de « juste correct ». Les chercheurs traitent cela en construisant un système d'étalonnage des étiquettes étape par étape qui recherche des motifs à travers les spectateurs plutôt que de se fier à la note d'une seule personne. D'abord, toutes les évaluations sont mises sur une échelle commune et compressées en quelques dimensions clés. Ensuite, un regroupement non supervisé classe les réponses émotionnelles similaires, visant à répartir les vidéos en quatre grands pôles de l'espace émotionnel : heureux (agréable et intense), détendu (agréable et calme), effrayé (désagréable et intense) et triste (désagréable et calme). Une étape de raffinement finale ajuste les cas incertains en s'appuyant sur des informations d'évaluation supplémentaires, aboutissant à une étiquette d'émotion dominante pour chaque vidéo qui reflète mieux l'impression globale du groupe.

Obtenir plus avec moins de matériel

Un autre défi est matériel : les bonnets EEG complets avec 32 électrodes ou plus sont encombrants et coûteux. L'équipe conçoit une façon de réduire cela à seulement 11 emplacements soigneusement choisis sur le front, le sommet, les côtés et l'arrière de la tête — des régions liées au contrôle émotionnel, à l'éveil, à l'audition, à la vision et à l'attention. Ils réalisent ensuite une analyse détaillée de la façon dont l'énergie du signal se répartit à travers les bandes d'ondes cérébrales classiques (des rythmes lents aux rapides) sous différents états émotionnels. En comparant ces motifs, ils montrent que certaines combinaisons de fréquences et d'emplacements crâniens apportent des indices particulièrement solides sur le fait qu'un spectateur est, par exemple, fortement éveillé ou profondément détendu. Cette approche basée sur le rapport d'énergie multi-bandes leur permet de conserver les signaux les plus informatifs tout en éliminant une grande partie de la redondance.

Laisser les données faire ressortir l'essentiel

Même avec moins d'électrodes, chaque seconde d'enregistrement contient un flot de chiffres. Pour éviter de submerger les modèles, les auteurs combinent plusieurs types de caractéristiques — telles que des mesures d'énergie basées sur les ondelettes, la force de fluctuation conjointe entre différentes régions cérébrales, et l'évolution temporelle de la puissance dans diverses fréquences — en une description riche mais structurée de chaque session de visionnage. Une étape de sélection guidée par saillance classe ensuite ces caractéristiques selon leur utilité pour différencier les émotions, ne conservant qu'un sous-ensemble compact. Avec cette représentation allégée, trois modèles d'apprentissage automatique standard sont entraînés pour reconnaître laquelle des quatre émotions dominantes correspond le mieux à une vidéo donnée. Dans des tests exigeants où le système doit généraliser à des personnes totalement nouvelles, le meilleur modèle atteint environ 45 % de précision, un résultat solide pour un choix à quatre classes avec des données cérébrales bruitées et seulement 11 canaux.

Ce que cela signifie pour la technologie quotidienne

Pour le grand public, le message clé est que l'on peut commencer à mesurer ce que ressentent des groupes de personnes à propos de vidéos en utilisant de petits dispositifs EEG portables plutôt que des installations de laboratoire complètes. En clarifiant les étiquettes émotionnelles, en se concentrant sur les parties les plus informatives du signal EEG et en sélectionnant seulement quelques capteurs bien placés, les auteurs montrent qu'il est possible de détecter la tonalité émotionnelle dominante d'une vidéo — heureux, détendu, effrayé ou triste — à travers les spectateurs. Le système n'est pas parfait, mais il ouvre la voie à des outils pratiques pour le suivi du sentiment du public, les tests de contenu et les recommandations sensibles aux émotions qui s'appuient sur des réponses cérébrales objectives plutôt que seulement sur des sondages ou des clics.

Citation: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Mots-clés: reconnaissance des émotions par EEG, interface cerveau–ordinateur, analyse affective vidéo, neurosciences portables, informatique émotionnelle