Clear Sky Science · fr

Une analyse comparative des modèles de chatbot intégrés et de ChatGPT‑4 pour répondre aux questions sur le traitement orthodontique

Pourquoi des chatbots plus intelligents comptent pour les appareils dentaires

Quiconque a porté un appareil dentaire sait que les questions n’attendent pas les heures de consultation : est‑ce que cette douleur va s’arrêter ? Puis‑je manger ceci ? Dois‑je m’inquiéter pour ma mâchoire ? Cette étude examine si un chatbot orthodontique conçu spécifiquement pour répondre à ces questions quotidiennes peut fournir des réponses plus claires et plus fiables qu’un système d’intelligence artificielle généraliste, ChatGPT‑4. Le travail offre un aperçu de la manière dont des outils d’IA soigneusement adaptés pourraient soutenir à la fois les patients et les cliniciens dans les soins dentaires modernes.

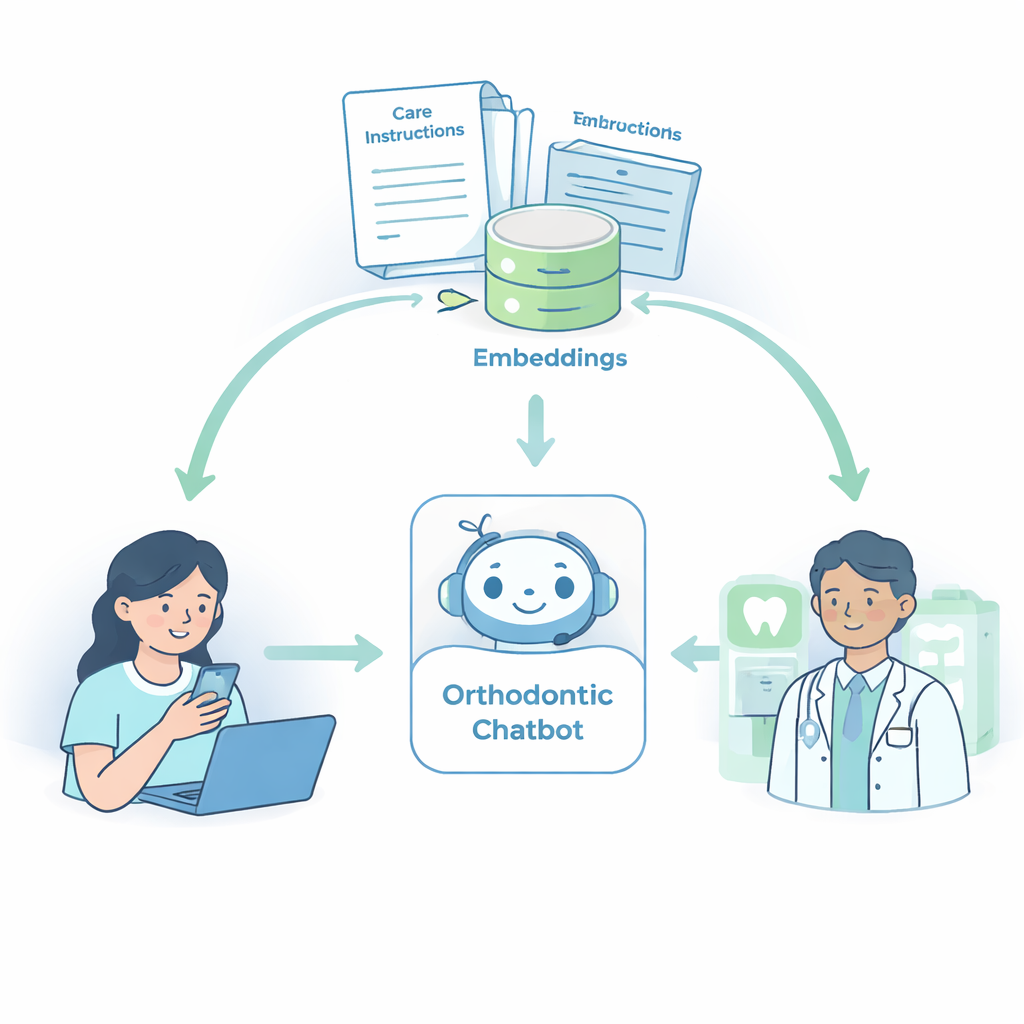

Un chatbot conçu uniquement pour les questions sur les appareils

Les chercheurs ont créé un chatbot intégré focalisé uniquement sur le traitement orthodontique. Plutôt que d’entraîner une nouvelle IA depuis zéro, ils ont relié un modèle de langage avancé à une bibliothèque sélectionnée de documents destinés aux patients et d’extraits clés de manuels. Cette bibliothèque comprenait des brochures de la British Orthodontic Society portant sur l’hygiène bucco‑dentaire, l’alimentation, l’entretien des appareils, les élastiques et les contentions, ainsi que de courtes explications tirées de manuels orthodontiques standard. En utilisant une technique appelée génération augmentée par récupération, le système cherchait dans cette bibliothèque des passages pertinents à chaque question posée et s’en servait pour façonner sa réponse, visant à refléter ce qu’un patient entendrait lors d’une conversation habituelle au fauteuil.

Comment l’étude a testé les deux systèmes

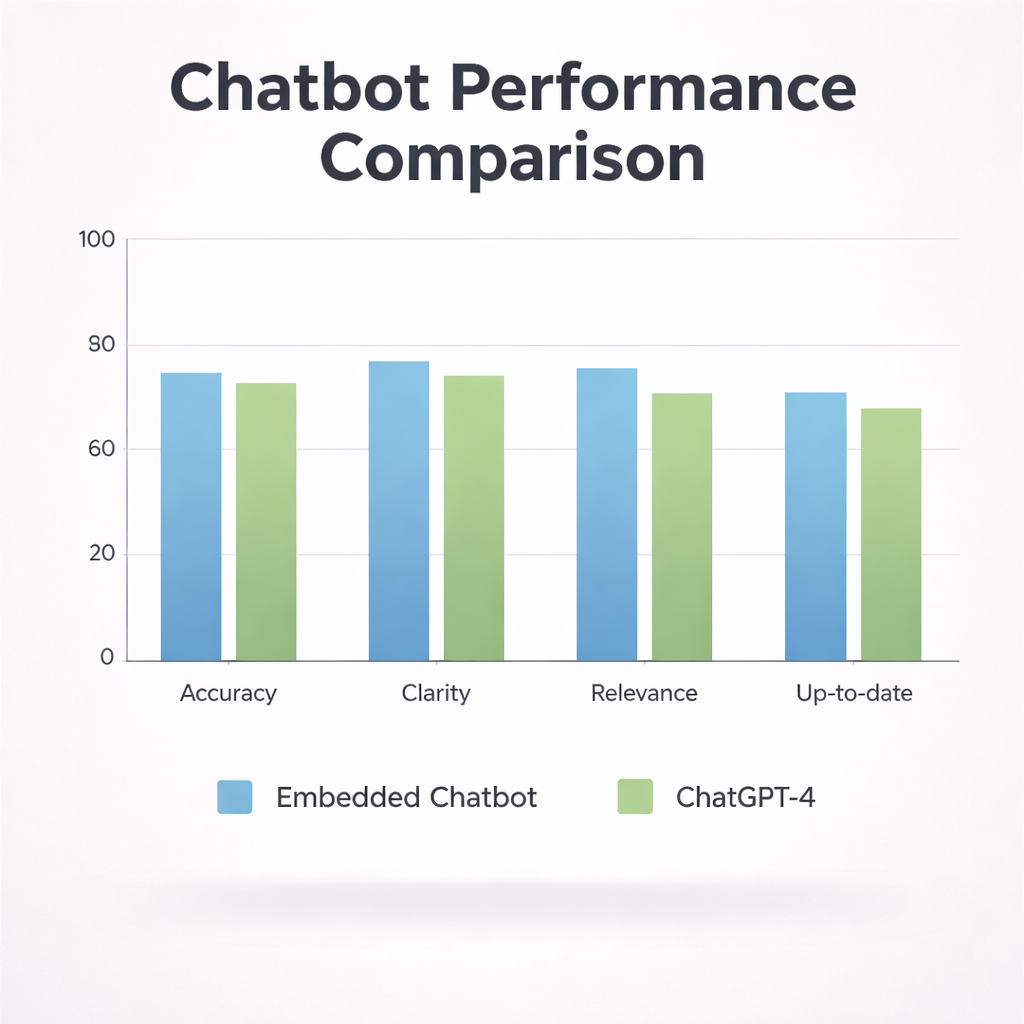

Pour évaluer les performances de ce chatbot spécialisé, l’équipe l’a comparé à ChatGPT‑4, utilisé de manière standard via l’interface ChatGPT Plus. Ils ont rassemblé 30 questions issues du monde réel que les patients posent couramment avant, pendant et après un traitement par appareil — par exemple, si les appareils causent de la douleur, comment ils affectent la parole ou le chant, à quelle fréquence des contrôles sont nécessaires, et si les appareils peuvent aider les problèmes de l’articulation de la mâchoire. Les deux systèmes ont reçu les mêmes consignes, leur demandant de répondre en tant qu’experts en orthodontie en langage clair et adapté aux patients. Six consultants orthodontistes expérimentés ont ensuite noté chaque réponse anonymisée selon quatre aspects : exactitude, clarté, pertinence par rapport à la question et actualité des informations, en utilisant une échelle en cinq points.

Mesurer la qualité, pas seulement les impressions

Plutôt que de se fier à des impressions générales, les chercheurs ont utilisé une méthode de notation structurée appelée indice de validité de contenu. Pour chaque question et chaque aspect de qualité, ils ont compté combien d’experts ont évalué une réponse comme « d’accord » ou « tout à fait d’accord » et l’ont converti en un score compris entre zéro et un. Des scores élevés signifiaient que la plupart des experts jugeaient la réponse exacte, claire, pertinente ou actuelle. Ils ont aussi calculé des moyennes sur l’ensemble des questions pour voir les performances globales de chaque système. Des tests statistiques ont été appliqués pour vérifier si les différences entre les deux chatbots étaient suffisamment importantes pour être considérées comme significatives plutôt que dues au hasard.

Ce que les orthodontistes ont pensé des réponses

Le chatbot intégré est généralement arrivé en tête. Environ trois quarts de ses réponses ont atteint un seuil de qualité acceptable, contre un peu plus de la moitié des réponses de ChatGPT‑4. En moyenne, le chatbot spécialisé a obtenu de meilleurs scores en exactitude, clarté et pertinence, et il semblait également un peu plus conforme aux recommandations actuelles. Par exemple, lorsqu’il expliquait la douleur pendant le port d’appareils ou l’impact des appareils sur la parole, ses réponses étaient directes, concrètes et bien alignées avec les conseils habituels aux patients. En revanche, les réponses de ChatGPT‑4, bien que souvent raisonnables, avaient tendance à être plus générales et parfois plus techniques, ce qui a pu diminuer leur clarté aux yeux des experts. Toutefois, lorsque les chercheurs ont effectué des tests statistiques formels, les différences entre les deux systèmes n’étaient pas suffisamment grandes pour être considérées comme statistiquement significatives.

Limites et enseignements pour l’avenir de l’IA en clinique

L’étude a également révélé que même les experts ne s’accordent pas toujours sur ce qui constitue la « meilleure » réponse. L’accord global entre les orthodontistes a été plus faible que prévu, notamment pour des aspects subjectifs comme la clarté et la pertinence. Les chercheurs ont noté plusieurs autres limites : ils n’ont étudié que deux configurations d’IA, n’ont pas impliqué directement les patients et ont fondé leur chatbot spécialisé sur un ensemble précis de documents écrits. Néanmoins, leur travail s’ajoute aux preuves croissantes que les systèmes d’IA peuvent répondre correctement à de nombreuses questions dentaires courantes, et que l’ajout de documents de référence ciblés et actualisés peut améliorer les performances.

Ce que cela signifie pour les personnes portant un appareil

Pour les patients, la conclusion est encourageante mais prudente. Un chatbot bien conçu, axé sur l’orthodontie, peut fournir des réponses claires et dignes de confiance à de nombreuses questions quotidiennes et réduire l’anxiété entre les rendez‑vous. En même temps, cette étude montre qu’un tel outil ne remplace pas encore le jugement professionnel ni le conseil en personne. La vraie promesse réside dans la combinaison de ces assistants d’IA sur mesure avec des soins d’experts, afin que les personnes portant un appareil puissent obtenir des informations rapides et faciles à comprendre tout en continuant à s’en remettre à leur orthodontiste pour les décisions finales.

Citation: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Mots-clés: chatbot orthodontique, IA dentaire, questions sur les appareils dentaires, éducation des patients, comparaison ChatGPT