Clear Sky Science · fr

Évaluation d'assistants d'apprentissage alimentés par l'IA dans l'enseignement supérieur en ingénierie : implications pour l'engagement des étudiants, l'éthique et les politiques

Pourquoi cela importe pour les étudiants universitaires d'aujourd'hui

Les étudiants se tournent vers des chatbots et d'autres outils d'intelligence artificielle pour les aider dans leurs devoirs, leur codage et les notions de cours qui leur paraissent confuses. Mais ces outils peuvent‑ils réellement soutenir l'apprentissage, et qu'advient‑il des questions de tricherie, d'équité et de confiance quand un logiciel devient un partenaire d'étude ? Cet article suit une expérience réelle menée dans des cours de génie civil et environnemental qui a testé un « Hub IA éducatif » alimenté par l'IA et a demandé aux étudiants ce qui fonctionnait, ce qui les inquiétait et comment ils imaginent l'IA dans l'avenir de l'enseignement supérieur.

Un camarade d'étude numérique, de nombreux outils intégrés

Le Hub IA éducatif est un assistant d'apprentissage spécifique à un cours intégré à la plateforme d'apprentissage en ligne de l'université. Plutôt que d'envoyer des questions à un chatbot général formé sur l'ensemble d'Internet, les étudiants interagissent avec un assistant étroitement lié à leurs propres cours, devoirs et au syllabus. En coulisses, le système lit des PDF de cours approuvés par les enseignants, les transforme en segments consultables et n'alimente que ceux‑ci dans un modèle de langage avancé pour répondre aux questions des étudiants. Le Hub propose six outils principaux : notes courtes générées par l'IA, un chatbot questions‑réponses, des flashcards, des quiz corrigés automatiquement, un « bac à sable » d'aide au codage et des réponses rapides sur la logistique du syllabus. Il est conçu pour agir comme un assistant pédagogique amical et toujours disponible, plutôt que comme un moteur de raccourcis.

Comment l'étude a été menée

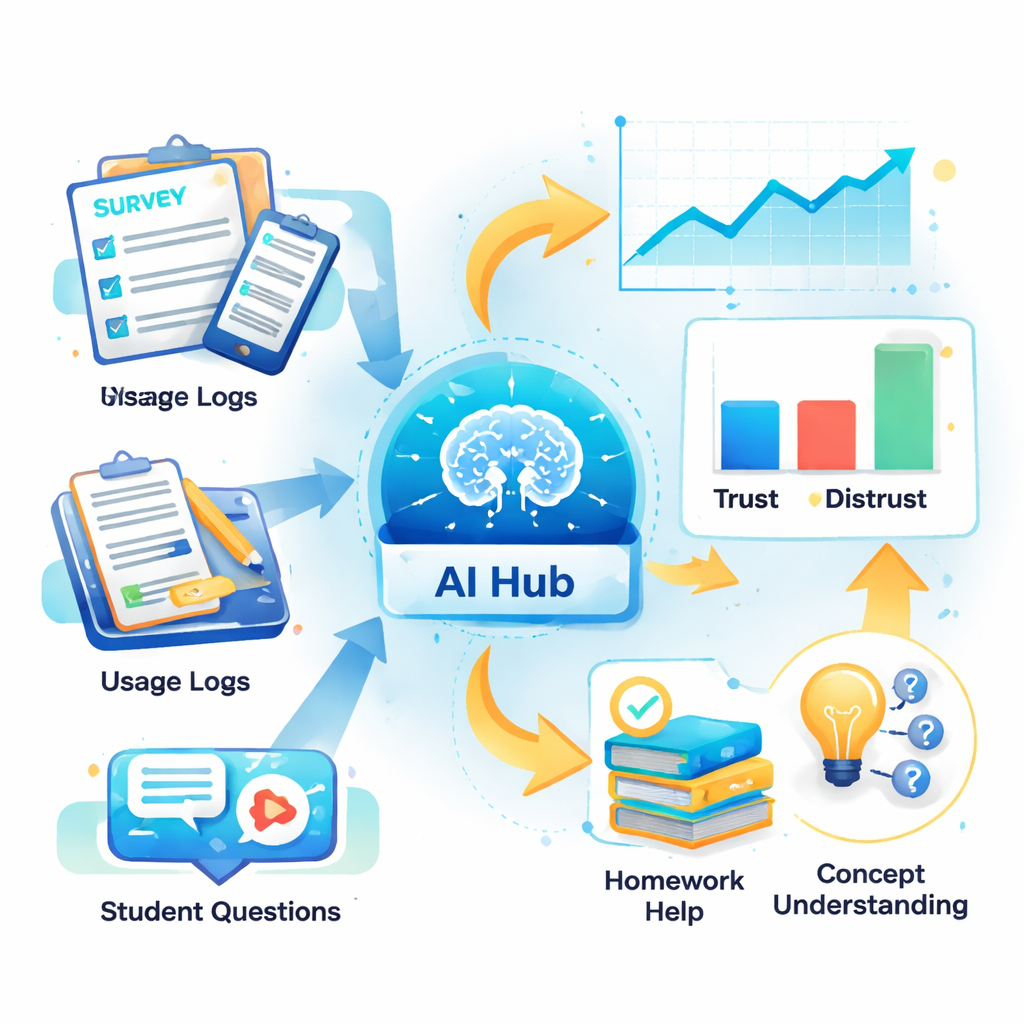

Pour observer l'utilisation réelle de cet assistant, les chercheurs l'ont intégré dans deux cours de premier cycle en ingénierie d'une grande université publique de recherche. Soixante‑cinq des 77 étudiants inscrits se sont portés volontaires pour participer. Ils ont rempli des enquêtes en début et en fin de semestre sur leur expérience de l'IA, leur confiance envers ces outils et leurs préoccupations éthiques et relatives à l'intégrité académique. Dans le même temps, le système a consigné discrètement chaque interaction : quelles fonctionnalités les étudiants ont utilisées, la fréquence de retour et les types de questions posées. L'équipe a également catégorisé des centaines de requêtes étudiantes en thèmes tels que « aide logicielle », « questions de théorie » et « clarification de devoir » pour comprendre quel type d'aide les étudiants recherchaient réellement.

Ce que les étudiants ont apprécié — et ce en quoi ils n'avaient pas entièrement confiance

La fonctionnalité la plus populaire de loin fut le chatbot, qui représentait plus de 90 % de toutes les interactions. Les étudiants l'ont beaucoup utilisé pour se débloquer sur des tâches logicielles techniques dans des outils comme ArcGIS et MATLAB, et pour clarifier des concepts fondamentaux et des formules en ingénierie. Nombre d'entre eux ont déclaré que l'assistant facilitait la compréhension du matériel de cours et l'achèvement des devoirs, et certains ont dit qu'ils se sentaient plus à l'aise de poser des questions à l'IA qu'aux professeurs ou assistants pédagogiques. Cependant, la plupart considéraient toujours l'aide humaine comme égale ou supérieure en qualité. Les inquiétudes concernant des réponses incorrectes ou trompeuses de l'IA — parfois appelées « hallucinations » — faisaient que beaucoup d'utilisateurs considéraient l'assistant comme un premier niveau pratique plutôt que comme une autorité finale.

Zones grises éthiques et confusion sur les politiques

Même lorsque les étudiants appréciaient l'outil, ils se montraient mal à l'aise sur les règles d'utilisation. Beaucoup n'étaient pas sûrs de ce qui constituait exactement une faute académique en travaillant avec l'IA et craignaient d'être faussement accusés de tricherie. Près de la moitié pensait que l'IA ne sapait pas automatiquement l'intégrité académique, mais une proportion similaire se disait réticente à l'utiliser pour des travaux notés. Fait important, les étudiants ne souhaitaient pas l'interdiction de l'IA ; au contraire, ils demandaient des politiques de cours « plutôt restrictives » avec des consignes claires. La plupart étaient d'accord pour dire que l'utilisation de l'IA comme aide académique peut être éthique et déclaraient vouloir des outils similaires dans d'autres cours, à condition que les attentes soient formulées en termes simples et reliées à des pratiques responsables comme la vérification des sources et la citation de l'aide reçue.

Des données à un meilleur enseignement et apprentissage

Les journaux d'utilisation et les réponses aux enquêtes racontent une histoire cohérente : les étudiants utilisaient le Hub IA principalement quand ils lui faisaient confiance, se sentaient à l'aise avec lui et le jugeaient réellement utile pour des tâches de cours comme la révision de concepts et les devoirs. Une moindre confiance dans l'IA allait de pair avec une utilisation plus faible, tandis que le confort et l'utilité perçue étaient liés à un engagement plus fréquent. Pourtant, les étudiants n'attribuaient pas au seul outil l'amélioration de leurs notes, et beaucoup continuaient de recourir à des chatbots généralistes pour du codage ou des mathématiques dépassant le cadre des documents de cours. Ces tendances suggèrent que les assistants IA fonctionnent mieux comme une couche de soutien ciblée à l'intérieur d'un cours — non comme un remplacement des enseignants, et non comme une solution universelle.

Ce que cela signifie pour la salle de classe du futur

Pour un non‑spécialiste, la conclusion est que les aides d'étude par IA peuvent rendre les matières techniques plus accessibles et offrir aux étudiants un moyen sans pression de poser des questions à toute heure, mais elles ne résolvent pas magiquement l'apprentissage à elles seules. Dans cette étude, les étudiants en ingénierie considéraient le Hub IA éducatif comme un compagnon pratique capable de débloquer des problèmes et d'expliquer des idées difficiles, tout en continuant à s'appuyer sur les enseignants et les méthodes d'étude traditionnelles. Leurs principales inquiétudes ne portaient pas sur la technologie en elle‑même mais sur des règles peu claires et la crainte d'accusations de tricherie. Les auteurs soutiennent que si les universités veulent que l'IA améliore réellement l'enseignement, elles doivent associer des outils intelligents et spécifiques aux cours à des politiques claires et transparentes et à un encadrement actif des enseignants, pour aider les étudiants à apprendre non seulement grâce à l'IA, mais aussi à l'utiliser de manière responsable.

Citation: Sajja, R., Sermet, Y., Fodale, B. et al. Evaluating AI-powered learning assistants in engineering higher education with implications for student engagement, ethics, and policy. Sci Rep 16, 7565 (2026). https://doi.org/10.1038/s41598-026-39237-5

Mots-clés: IA dans l'éducation, étudiants en ingénierie, assistant d'apprentissage, intégrité académique, engagement des étudiants