Clear Sky Science · fr

Les modèles de langage multimodaux défient le concours d’images du NEJM

Pourquoi cela compte pour les patients et les médecins

Obtenir le bon diagnostic au bon moment peut faire la différence entre un traitement rapide et des années de souffrance. Pourtant, les médecins, même très expérimentés, omettent ou retardent encore des diagnostics, en particulier pour des maladies rares ou inhabituelles. Cette étude pose une question frappante : lorsque des images médicales et des éléments cliniques sont fournis aux systèmes d’intelligence artificielle les plus avancés d’aujourd’hui, peuvent‑ils réellement diagnostiquer des cas complexes mieux qu’un grand nombre de médecins réels — et si oui, qu’est‑ce que cela implique pour les soins médicaux futurs ?

Un immense puzzle construit à partir de cas réels

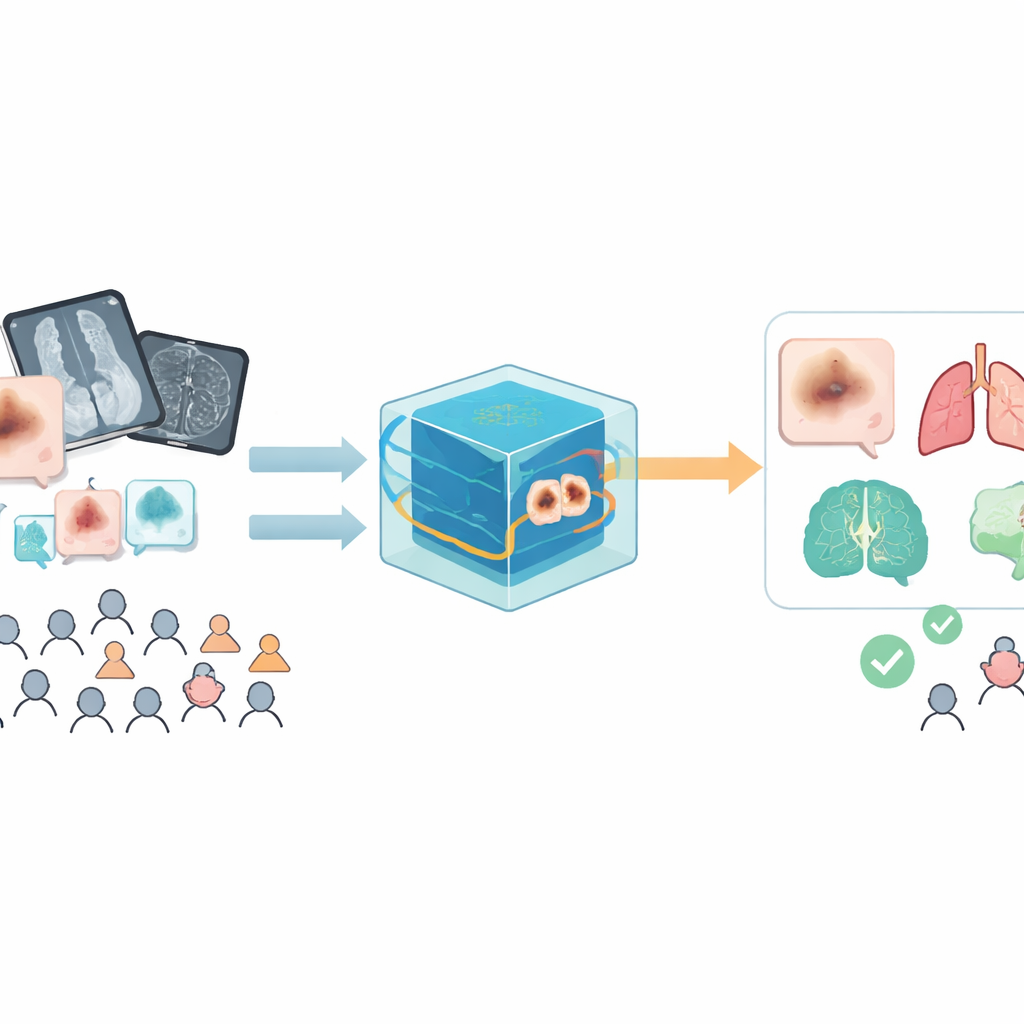

Les chercheurs se sont tournés vers une rubrique de longue date du New England Journal of Medicine appelée « Image Challenge ». Chaque défi présente l’image médicale d’un véritable patient — par exemple une photo de peau, une radiographie, une IRM ou une lame de microscope — accompagnée d’un court récit clinique et de cinq diagnostics possibles. Plus de 16 millions de réponses provenant de plus de 60 000 médecins par cas se sont accumulées depuis 2009, créant un enregistrement mondial unique de la performance des médecins sur les mêmes questions difficiles. À partir de cet archive, l’équipe a sélectionné 272 cas couvrant tous les âges, les deux sexes et un large éventail d’affections, des infections et troubles immunitaires aux cancers, maladies génétiques et blessures.

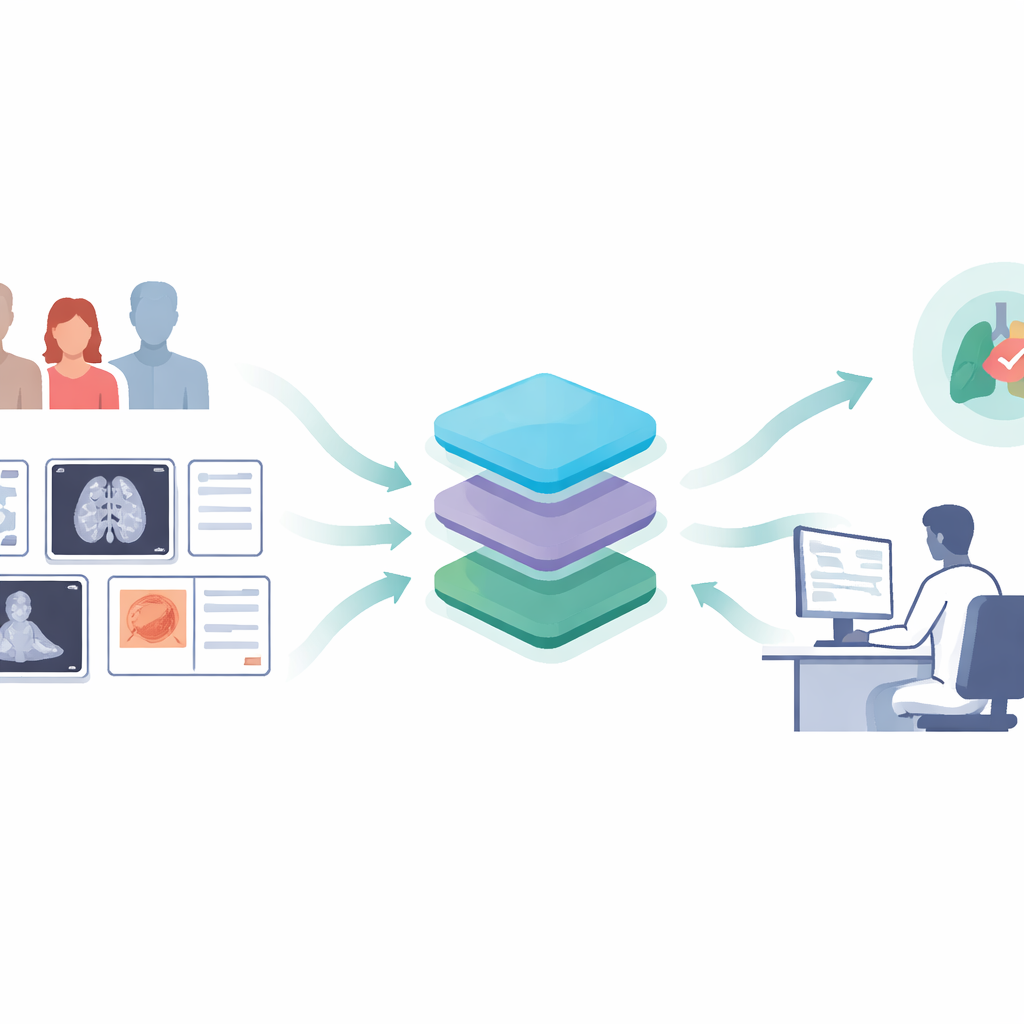

Mettre l’IA et les médecins sur le même terrain

L’étude a testé trois modèles multimodaux de grande taille leaders — des systèmes capables d’analyser des images et du texte ensemble : GPT‑4o, Claude 3.7 et Doubao. Pour chaque cas, les modèles ont d’abord vu uniquement l’image et devaient choisir l’une des cinq options en fournissant une explication. Ensuite ils ont vu l’image plus la description clinique et ont répondu de nouveau. Pour que le test soit équitable, les modèles ont été utilisés dans des paramètres standard, avec la recherche web et les fonctions de raisonnement supplémentaires désactivées, et chaque cas a été exécuté dans une session nouvelle pour éviter toute contamination par des réponses antérieures. Deux médecins ont noté les réponses de l’IA par rapport aux solutions officielles du New England Journal, en se concentrant sur la concordance entre le choix final et le diagnostic véritable, comme pour la référence humaine.

Performance surhumaine à travers les maladies et les images

Lorsqu’on leur a fourni à la fois images et texte, les trois systèmes d’IA ont nettement surpassé l’ensemble des médecins. Claude 3.7 et GPT‑4o ont atteint environ 89–90 % de précision, contre 46,7 % pour le vote majoritaire des répondants humains — un écart de plus de 40 points de pourcentage. Même dans les cas les plus difficiles, où moins de 40 % des médecins étaient corrects, Claude 3.7 a tout de même trouvé 86,5 % des diagnostics. L’avantage s’est maintenu pour la plupart des types de maladies et des formats d’image : les modèles étaient particulièrement performants pour les affections liées aux médicaments et les maladies génétiques, et ils ont traité non seulement des photos et des radiographies mais aussi des ensembles d’images endoscopiques, pathologiques et mixtes. Les performances étaient tout aussi fortes pour les hommes et les femmes, et dans certains des groupes les plus vulnérables, comme les nourrissons de moins d’un an, les modèles étaient nettement plus précis que les médecins.

Des modes de pensée différents, pas seulement plus rapides

La découverte peut‑être la plus surprenante a été la fréquence à laquelle les modèles réussissaient là où les médecins échouaient. Dans près de la moitié des cas, Claude 3.7 était correct alors que la majorité des médecins se trompait, et l’inverse — médecins corrects, modèle en erreur — était rare. Globalement, pour Claude 3.7, il y avait environ quinze cas « avantage modèle » pour un cas « avantage médecin ». Pourtant l’accord entre humains et IA sur la réponse à choisir était faible, signe que les systèmes n’imitent pas simplement les schémas humains mais parviennent aux bons diagnostics par des voies différentes. L’ajout du texte clinique a généralement beaucoup aidé, augmentant la précision de l’IA de 28–42 points de pourcentage par rapport aux seules images. Toutefois, dans une infime fraction de cas, des détails supplémentaires ont fait basculer un modèle d’une réponse correcte basée sur l’image à une réponse erronée, suggérant de nouveaux types de biais et de modes de défaillance qui nécessiteront une étude attentive.

Ce que cela pourrait signifier pour les soins futurs

Les auteurs concluent que les modèles multimodaux de grande taille ont atteint un niveau « surhumain » sur ce quiz diagnostique exigeant : ils sont plus précis que la foule moyenne de médecins et conservent leur avance même lorsque les cas laissent la plupart des cliniciens perplexes. Dans le même temps, leur faible recoupement avec les choix humains suggère qu’ils pensent de manière complémentaire plutôt que d’agir comme des copies numériques des cliniciens. Utilisés judicieusement, ces systèmes pourraient servir de puissants seconds lecteurs, offrant des avis indépendants sur les cas difficiles ou rares et aidant à repérer des problèmes que les médecins pourraient manquer. Ils ne sont pas encore prêts à remplacer le jugement clinique, mais ils pourraient bientôt devenir des partenaires précieux au chevet et en salle de lecture, vérifiant discrètement notre travail et élargissant le filet de sécurité pour les patients.

Citation: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Mots-clés: diagnostic médical, intelligence artificielle, imagerie médicale, maladies rares, assistant à la décision clinique