Clear Sky Science · fr

RFGLNet pour la segmentation sémantique généralisée en domaine par mauvais temps avec amélioration basse-rang en fréquence

Voir la route quand le temps se dégrade

Les voitures autonomes et les robots de livraison promettent des rues plus sûres et plus efficaces — mais seulement s’ils peuvent « voir » de façon fiable leur environnement. La pluie, le brouillard, la neige et la nuit rendent cette vision particulièrement difficile : ils atténuent les contrastes, ajoutent des taches de bruit et floutent les contours des piétons, des voitures et des trottoirs. Cet article présente RFGLNet, un nouveau système de vision par ordinateur conçu pour préserver la compréhension de la route par les machines, même lorsque les conditions météo sont les plus mauvaises.

Pourquoi le mauvais temps aveugle les machines

Les systèmes de conduite actuels reposent souvent sur un procédé appelé segmentation sémantique, où un algorithme attribue une classe — route, voiture, piéton ou bâtiment — à chaque pixel d’une image. En plein jour et par beau temps, les réseaux neuronaux modernes font cela remarquablement bien. Sous une pluie battante ou dans un brouillard dense, cependant, les images perdent en luminosité, gagnent du bruit et voient les frontières entre objets devenir floues. Collecter et annoter d’énormes ensembles de données pour chaque condition météorologique défavorable est prohibitivement coûteux, si bien que la plupart des systèmes sont entraînés principalement sur des images ensoleillées et normales. Lorsqu’ils affrontent des orages ou de la neige inconnus, leurs performances chutent fortement. Les solutions précédentes tentaient soit de nettoyer d’abord les images avant de les segmenter, soit d’adapter les modèles à des conditions cibles spécifiques. Ces approches ont tendance à être fragiles, lentes ou trop dépendantes de données annotées en mauvais temps.

Un nouveau réseau conçu pour les conditions difficiles

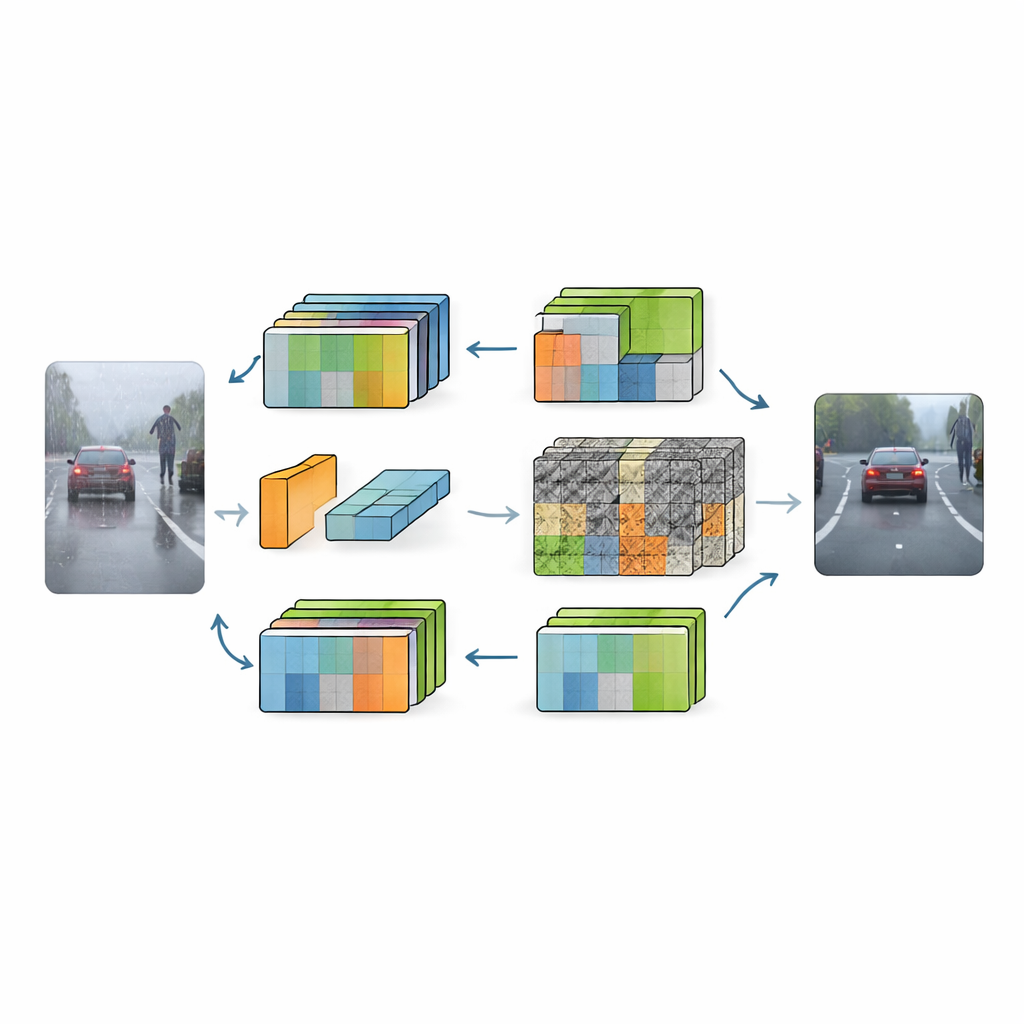

RFGLNet aborde ce problème par une stratégie différente : il s’entraîne uniquement sur des scènes urbaines diurnes standard, tout en se généralisant à une large gamme de conditions difficiles. Les auteurs partent de DINOv2, un grand modèle visuel préentraîné reconnu pour capturer une structure riche des scènes. Au lieu de réentraîner ce backbone lourd depuis zéro, ils figent ses paramètres et ajoutent par-dessus un ensemble de modules légers. Ces modules font office d’adaptateurs intelligents, remodelant les représentations internes du backbone pour qu’elles soient moins perturbées par le désordre visuel causé par les flocons de neige, les gouttes de pluie ou l’obscurité. Le résultat est un système qui n’utilise que 4,32 millions de paramètres entraînables — une taille minime comparée aux modèles de vision classiques — tout en apprenant à gérer des conditions météo qu’il n’a jamais vues pendant l’entraînement.

Comment le réseau apprend à filtrer le mauvais temps

La première innovation de RFGLNet est un module basse-rang qui se branche dans chaque couche du backbone figé. Avant l’entraînement, ce module exécute une procédure mathématique connue sous le nom de décomposition en valeurs singulières (SVD) sur une matrice de caractéristiques simulée. Cela lui fournit un ensemble de composantes compactes qui correspondent approximativement à la structure des caractéristiques internes de DINOv2 dès le départ, au lieu de partir du hasard. Pendant l’entraînement, ces composantes sont ajustées, permettant au module de corriger en douceur les caractéristiques du backbone pour la nouvelle tâche sans perturber ses connaissances fondamentales. Le réseau applique ensuite un bloc d’attention basé sur la transformée de Fourier qui déplace les caractéristiques dans le domaine fréquentiel. Là, les structures larges et lentement variantes tendent à représenter des objets significatifs, tandis que les motifs brusques et erratiques correspondent souvent au bruit météorologique. En supprimant le désordre à haute fréquence et en amplifiant les composantes plus lisses, le système renforce la compréhension globale de la scène tout en atténuant les interférences.

Aiguiser les détails sans se laisser distraire

Même avec des caractéristiques globales plus propres, les petits détails — marquages au sol, traverses de clôture, silhouette d’un piéton lointain — restent vulnérables au flou par mauvais temps. Pour y remédier, les auteurs introduisent un module d’attention spatiale groupée dans la partie décodeur du réseau. Plutôt que de traiter ensemble tous les canaux de caractéristiques, ce module les divise en groupes et apprend des cartes de poids spatiaux distinctes pour chaque groupe. Les canaux portant une structure importante, comme les bords, peuvent ainsi être mis en avant, tandis que les canaux dominés par le bruit sont atténués. Ces cartes spécifiques à chaque groupe sont fusionnées en un poids spatial global qui renforce les détails fins et aiguise les contours des objets à plusieurs résolutions. En pratique, RFGLNet apprend où regarder de près et où ignorer les taches distrayantes de brouillard ou de pluie.

Des gains concrets sur des scènes routières difficiles

Pour évaluer leur approche, les chercheurs ont entraîné RFGLNet sur le célèbre jeu de données Cityscapes, composé de scènes urbaines diurnes claires, puis l’ont testé sur le jeu ACDC, qui cible la conduite sous pluie, neige, brouillard et de nuit. Sans jamais voir les annotations d’ACDC pendant l’entraînement, RFGLNet a atteint une intersection sur union moyenne de 78,3 % — dépassant plusieurs méthodes de généralisation de domaine et d’adaptation de pointe, dont beaucoup sont plus volumineuses et plus coûteuses en calcul. Il a été particulièrement performant pour segmenter des classes difficiles comme les murs et les clôtures, dont les bords se perdent facilement par mauvais temps. Parallèlement, le modèle a tourné de manière efficace sur un GPU grand public unique, traitant des dizaines d’images par seconde, une exigence clé pour les systèmes de conduite en temps réel.

Une vision plus claire pour une autonomie plus sûre

Pour les non-spécialistes, la conclusion est que RFGLNet montre comment améliorer des backbones de vision existants pour une autonomie plus sûre sans retrainings interminables sur chaque tempête possible. En combinant un ajustement basse-rang compact, un filtrage du bruit fondé sur les fréquences et une attention spatiale groupée, le système apprend à préserver la structure essentielle de la scène tout en balayant le désordre lié au temps. À mesure que ces méthodes mûrissent et sont entraînées sur des collections plus larges de conditions réelles, elles pourraient aider voitures autonomes et robots à maintenir une conscience situationnelle fiable quand le ciel s’assombrit et que la route devant eux devient incertaine.

Citation: Ye, X., Shi, X. & Li, Y. RFGLNet for adverse weather domain-generalized semantic segmentation with frequency low-rank enhancement. Sci Rep 16, 8253 (2026). https://doi.org/10.1038/s41598-026-39052-y

Mots-clés: conduite autonome, perception par mauvais temps, segmentation sémantique, robustesse en vision par ordinateur, généralisation de domaine