Clear Sky Science · fr

Comparaison des stratégies d’imputation pour les séries temporelles manquantes en soins intensifs à l’aide de scénarios inspirés du monde réel

Pourquoi combler les trous de données compte pour les patients en réanimation

Dans les unités de soins intensifs modernes, chaque battement de cœur, chaque respiration et chaque impulsion de tension artérielle sont enregistrés sous forme de flux continu de nombres. Pourtant, dans la réalité, ces flux sont parsemés de vides : des capteurs se détachent, les patients quittent le lit pour des examens, et des appareils sont brièvement éteints. Lorsque médecins et algorithmes utilisent ces dossiers incomplets pour prévoir l’évolution d’un patient ou guider un traitement, la manière dont nous « comblons » ces pièces manquantes peut subtilement changer l’histoire racontée par les données. Cette étude pose une question pragmatique aux grandes implications : parmi une large gamme de stratégies de comblement — des lignes droites simples aux intelligences artificielles dernier cri — lesquelles fonctionnent le mieux dans les types de lacunes qui se produisent réellement en réanimation ?

Un examen approfondi des signes vitaux en USI

Les chercheurs se sont appuyés sur MIMIC-IV, une vaste base de données publique de séjours en soins intensifs anonymisés provenant d’un hôpital américain. Ils se sont concentrés sur 26 167 séjours d’adultes et ont examiné les 48 premières heures après l’admission en USI, en suivant quatre signes vitaux mesurés en continu au chevet : la fréquence cardiaque, la saturation en oxygène du sang, la fréquence respiratoire et la pression artérielle moyenne. Pour préserver le réalisme des signaux, les mesures manifestement impossibles ont été retirées, et toutes les mesures ont été résumées une fois par heure. Toute heure sans valeur enregistrée pour un signe vital donné a été considérée comme manquante. Bien qu’environ 4 % seulement des valeurs fussent absentes, l’équipe a constaté que ces lacunes n’étaient pas réparties aléatoirement — elles se concentraient souvent vers la fin des 48 heures et affectaient parfois plusieurs signes vitaux à la fois.

Recréer des lacunes inspirées du monde réel

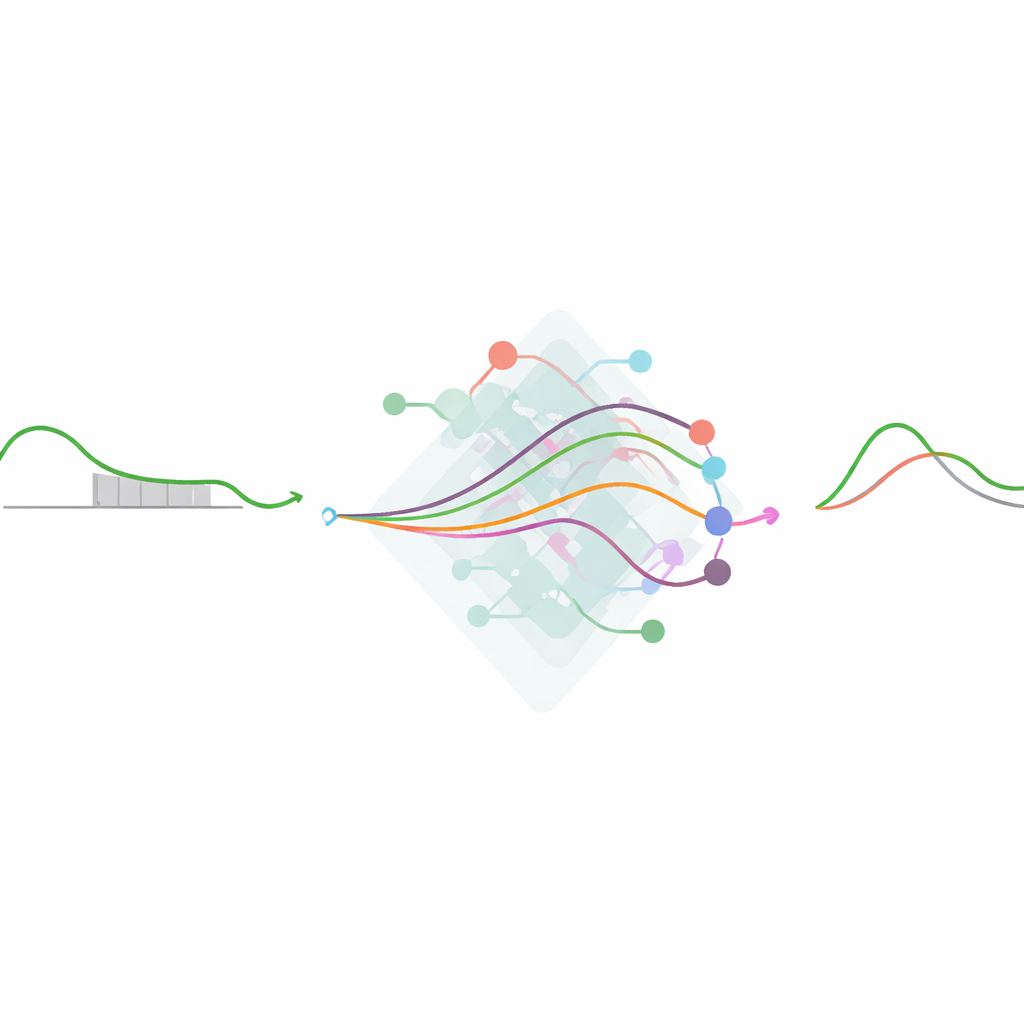

Plutôt que d’inventer des schémas purement artificiels de valeurs manquantes, les auteurs ont construit trois scénarios inspirés de ce qu’ils ont observé dans les données brutes et de ce que les cliniciens voient au chevet. Dans le premier, des mesures individuelles étaient supprimées au hasard, imitant des valeurs occasionnellement perdues. Dans le second, des blocs de 1 à 3 heures sur les quatre signes vitaux disparaissaient ensemble, représentant les moments où un patient est éloigné des moniteurs — par exemple pendant un examen d’imagerie. Dans le troisième, un seul signe vital — par exemple la tension artérielle — était retiré pendant une période continue de 4 heures, reflétant un capteur défaillant ou une sonde déplacée. Chaque scénario éliminait environ 30 % des données, constituant un test sévère pour toute méthode visant à reconstituer les courbes originales.

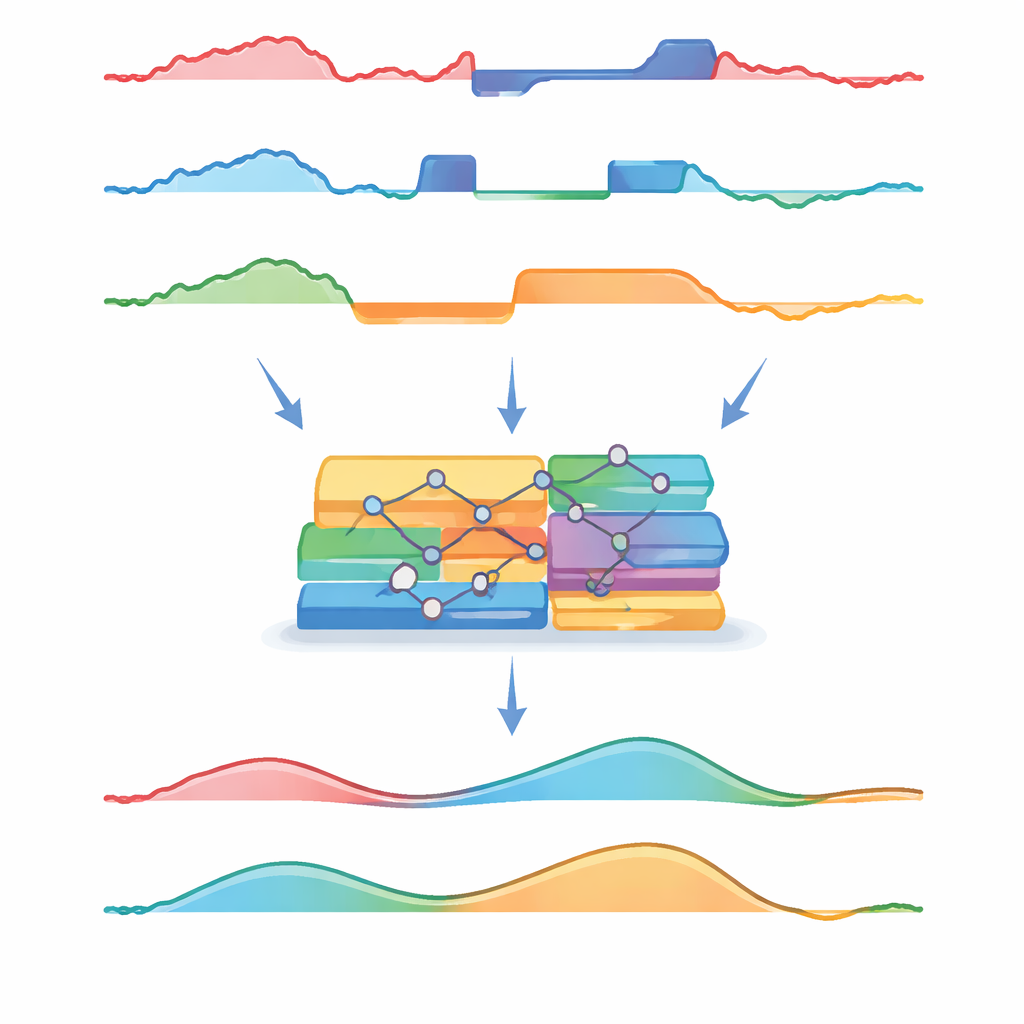

Vieilles méthodes contre intelligence machine moderne

L’équipe a ensuite confronté un large éventail de méthodes de reconstruction. Les approches simples comprenaient le remplissage de chaque lacune par la valeur moyenne du patient, la propagation de la dernière observation connue ou le tracé d’une ligne droite entre les points connus les plus proches. Des outils statistiques plus avancés ont essayé de prédire les valeurs manquantes à partir des autres signes vitaux, mais pour ce faire, ils ont dû aplatir la dimension temporelle et traiter chaque heure comme une ligne supplémentaire d’un tableau. À l’autre extrémité du spectre se trouvaient des modèles d’apprentissage profond — Transformers, réseaux récurrents et modèles génératifs — qui apprennent explicitement des motifs dans le temps et entre variables. Tous les modèles ont été entraînés sur des données où 30 % des valeurs étaient masquées aléatoirement, puis testés sur chacun des trois scénarios de masquage. Les performances ont été jugées en fonction de l’écart entre leurs reconstructions et les valeurs originales, avec une attention particulière portée aux erreurs sur la pression artérielle moyenne, un signal crucial pour la gestion de la circulation.

Ce qui a marché, quand et dans quelle mesure

Globalement, les modèles les plus sophistiqués — en particulier une approche basée sur Transformer et un réseau antagoniste génératif — ont affiché les erreurs moyennes les plus faibles, surtout lorsque les lacunes étaient courtes ou dispersées. Cependant, une méthode humble — l’interpolation linéaire — s’est révélée remarquablement performante, rivalisant avec ces modèles neuronaux dans de nombreuses situations. Les outils statistiques qui ignoraient l’ordre des mesures, comme les forêts aléatoires et les équations chaînées, ont pris du retard malgré leur complexité. La forme des lacunes importait aussi. Lorsque les valeurs manquaient au hasard, toutes les méthodes paraissaient meilleures, donnant une image trop optimiste de leur précision. Les trous longs et continus dans l’enregistrement, en particulier sur plusieurs heures ou lors de la défaillance d’un seul capteur, se sont avérés beaucoup plus difficiles à restituer correctement. Dans ces contextes plus difficiles, les meilleures méthodes d’apprentissage profond se dégradaient de manière plus progressive que les approches simples, mais les gains restaient souvent modestes une fois traduits en unités réelles de pression artérielle.

Pourquoi ces résultats importent pour les décisions au chevet

Dans les plages de pression artérielle usuelles, la différence entre les meilleurs modèles d’apprentissage profond et une interpolation simple n’était souvent que de quelques millimètres de mercure — généralement trop faible pour modifier la décision d’un médecin. Pourtant, toutes les méthodes, y compris les plus avancées, ont eu des difficultés lorsque la pression artérielle était très basse ou très élevée — précisément les moments où une surveillance attentive est la plus cruciale. L’étude conclut que le choix de la façon de gérer les données manquantes en USI dépend autant de la compréhension de la façon et du lieu d’apparition des lacunes que du choix de l’algorithme le plus récent. Les modèles sophistiqués peuvent offrir des gains marginaux, en particulier pour des lacunes longues ou plus complexes, mais des méthodes simples et transparentes peuvent suffire dans de nombreuses utilisations pratiques. Surtout, un meilleur comblement des lacunes ne garantit pas automatiquement de meilleures performances prédictives ; des travaux futurs devront évaluer comment ces choix de reconstruction se répercutent sur les décisions cliniques réelles.

Citation: Poette, M., Mouysset, S., Ruiz, D. et al. Benchmarking imputation strategies for missing time-series data in critical care using real-world-inspired scenarios. Sci Rep 16, 8116 (2026). https://doi.org/10.1038/s41598-026-39035-z

Mots-clés: Séries temporelles en USI, données manquantes, méthodes d’imputation, apprentissage profond, signes vitaux