Clear Sky Science · fr

Optimisation énergétique assistée par DQN pour les réseaux de communication alimentés sans fil

Alimenter de minuscules dispositifs par l’air

Des lampadaires intelligents aux détecteurs d’incendie dissimulés en forêt, d’innombrables petits appareils constituent aujourd’hui l’Internet des objets. Les maintenir alimentés pose un vrai casse-tête : les batteries s’épuisent et poser des câbles partout est impraticable. Cet article explore une méthode pour transmettre de l’énergie sans fil vers ces dispositifs et utiliser l’intelligence artificielle pour répartir cette énergie judicieusement, afin que les capteurs critiques restent opérationnels plus longtemps et que l’ensemble du réseau fonctionne de manière plus fluide.

Pourquoi l’alimentation sans fil nécessite un contrôle plus intelligent

Les réseaux de communication alimentés sans fil émettent des ondes radio que les dispositifs peuvent convertir en électricité tout en les utilisant pour transmettre des données. Dans la plupart des études antérieures, cette conversion d’énergie était traitée comme si elle suivait une relation simple et linéaire : plus le signal est fort, plus la puissance reçue augmente proportionnellement. En réalité, les circuits de collecte d’énergie commencent à « saturer » quand le signal entrant est important, gaspillent une partie de l’énergie. Parallèlement, les environnements réels sont chaotiques : l’ensoleillement pour des panneaux solaires varie, des bâtiments bloquent les signaux et des événements soudains comme des incendies peuvent créer des besoins de données urgents pour certains nœuds. Des règles statiques qui ignorent ces aléas peuvent laisser certains capteurs à court d’énergie et conduire d’autres à la gaspiller, réduisant la durée de vie globale du réseau.

Un cerveau apprenant pour le réseau d’alimentation

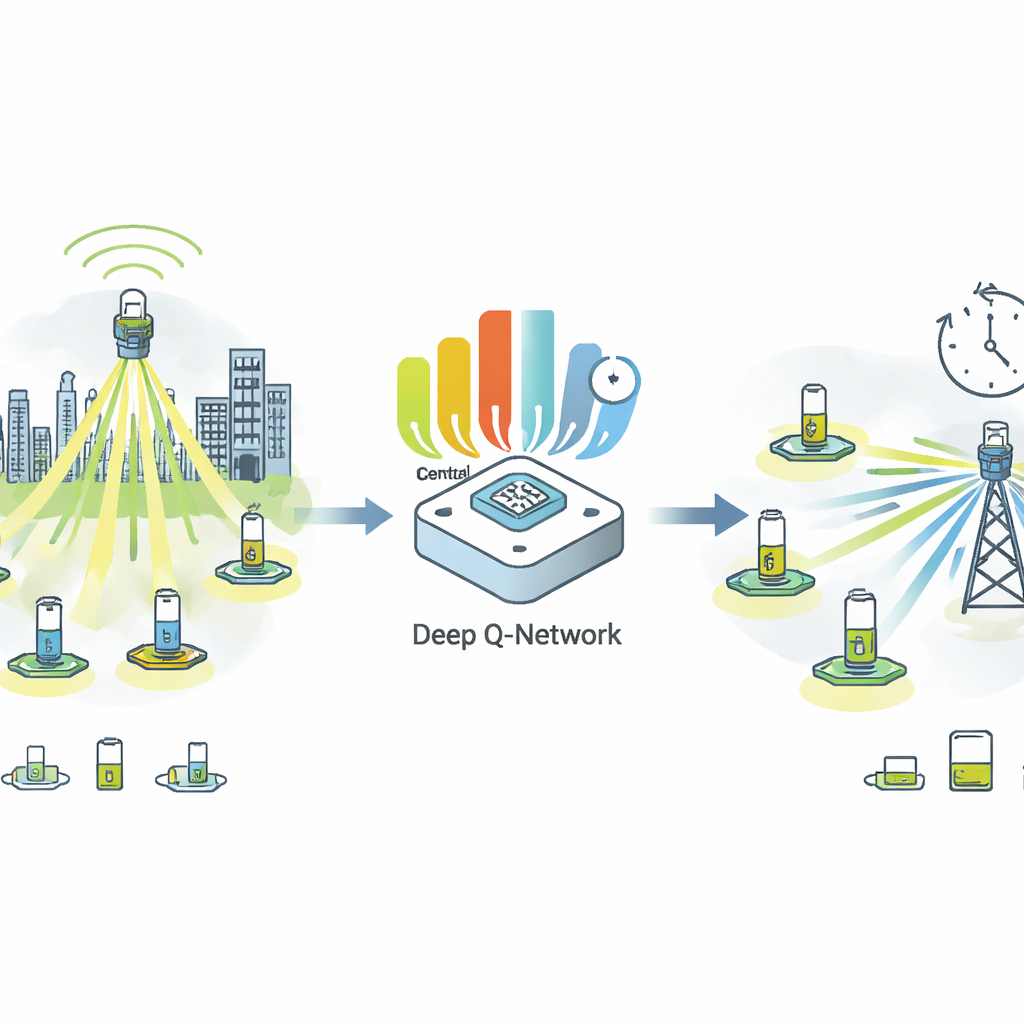

Pour y remédier, les auteurs conçoivent un contrôleur basé sur l’apprentissage fondé sur une technique appelée Deep Q-Networks, une forme d’apprentissage par renforcement. Plutôt que de se fier à des formules mathématiques fixes, ce contrôleur considère le réseau comme un jeu joué dans le temps. À chaque tour, il observe l’énergie restante dans chaque nœud, la qualité des liaisons radio et l’urgence de chaque tâche — par exemple la surveillance incendie versus des relevés de température de routine. À partir de ces observations, il décide combien d’énergie diriger vers chaque nœud. Après chaque décision, il reçoit un retour qui combine plusieurs objectifs : transmettre le plus de données utiles possible, répartir l’énergie équitablement pour qu’aucun dispositif ne soit systématiquement négligé, et éviter le gaspillage par surutilisation de la source d’énergie partagée. Au fil des tours, le contrôleur apprend quelles politiques de partage de l’énergie conduisent à la meilleure performance à long terme.

Anticiper et équilibrer des objectifs concurrents

Un ingrédient clé du cadre est la prédiction. Le système utilise une méthode statistique appelée régression par processus gaussien pour prévoir combien d’énergie les nœuds sont susceptibles de récolter dans un avenir proche, par exemple lorsque l’ensoleillement change. Il s’appuie aussi sur un modèle flexible de l’atténuation et de la propagation des signaux radio dans des environnements réalistes de type urbain. Ces éléments alimentent un processus de décision mis à jour toutes les quelques secondes, permettant au contrôleur de réagir rapidement lorsque les conditions du réseau évoluent. Le signal de récompense qui guide l’apprentissage mélange trois idées simples : l’efficacité (combien de bits d’information sont livrés par unité d’énergie), l’équité (comment l’énergie est répartie entre les nœuds) et la priorité (s’assurer que les tâches à forte urgence obtiennent ce dont elles ont besoin). En ajustant l’importance relative de ces trois composantes, les opérateurs peuvent privilégier durée de vie maximale, équité stricte ou taux de données de pointe.

Ce que révèlent les simulations

Comme les expériences en conditions réelles sont encore en cours, les auteurs évaluent leur méthode dans des simulations informatiques détaillées d’un réseau de 30 dispositifs alimentés sans fil, et explorent aussi des scénarios jusqu’à 100 nœuds. Comparé à une répartition fixe simple de l’énergie et à une méthode d’apprentissage plus traditionnelle, le nouveau contrôleur maintient le réseau opérationnel beaucoup plus longtemps : environ une moitié de tours supplémentaire avant l’extinction des nœuds. Il réduit aussi la dispersion des niveaux d’énergie entre les dispositifs, ce qui signifie beaucoup moins de « zones mortes » où des nœuds tombent en panne prématurément. La stratégie apprise s’adapte plusieurs fois plus vite aux changements soudains, tels qu’une chute de qualité de signal ou une hausse d’urgence des tâches, et maintient un débit de données plus élevé sur une large gamme de conditions radio. De manière importante, les auteurs tiennent compte des détails pratiques, montrant qu’une version compacte du modèle d’apprentissage peut fonctionner sur des microcontrôleurs peu coûteux utilisés dans de nombreux appareils IoT, avec des temps de décision de l’ordre de quelques dizaines de millisecondes.

De la simulation aux déploiements réels de capteurs

L’étude conclut qu’associer l’alimentation sans fil à un contrôleur basé sur l’apprentissage peut étendre significativement la durée de vie et la fiabilité des réseaux de capteurs, en particulier lorsque les conditions sont imprévisibles et que les tâches ont des degrés d’urgence différents. En tenant compte de la saturation des circuits de collecte, des fluctuations de l’environnement radio et du fait que certains capteurs sont plus importants que d’autres à un moment donné, l’approche proposée apprend à jongler entre des besoins concurrents mieux que des règles statiques. Les auteurs précisent que leurs résultats proviennent pour l’instant de simulations et que les gains exacts devront être confirmés sur du matériel réel. Néanmoins, leur travail laisse entrevoir un futur où d’immenses réseaux de petits dispositifs pourraient fonctionner longtemps avec un minimum d’intervention humaine, puisant intelligemment de l’énergie dans l’air tout en maintenant le flux de données vitales.

Citation: Chen, H., Wang, X., Yuan, L. et al. DQN-empowered energy optimization for wireless powered communication networks. Sci Rep 16, 7987 (2026). https://doi.org/10.1038/s41598-026-38904-x

Mots-clés: alimentation sans fil, Internet des objets, collecte d’énergie, apprentissage par renforcement, réseaux de capteurs