Clear Sky Science · fr

VolE : Un cadre par nuage de points pour la reconstruction 3D des aliments et l’estimation du volume

Pourquoi mesurer votre dîner compte

Compter les calories à partir d’une photo ressemble à de la magie, mais pour les médecins et les diététiciens cela peut devenir un outil puissant. Savoir avec précision combien les gens mangent réellement est essentiel pour gérer des affections comme le diabète et l’obésité, pourtant peser chaque repas sur une balance de cuisine est irréaliste au quotidien. Cet article présente VolE, une nouvelle méthode qui permet à un smartphone moderne ordinaire de construire un modèle tridimensionnel détaillé d’un seul aliment et d’en estimer le volume avec une précision étonnamment élevée — sans matériel spécial, carte de référence ni capteur de profondeur.

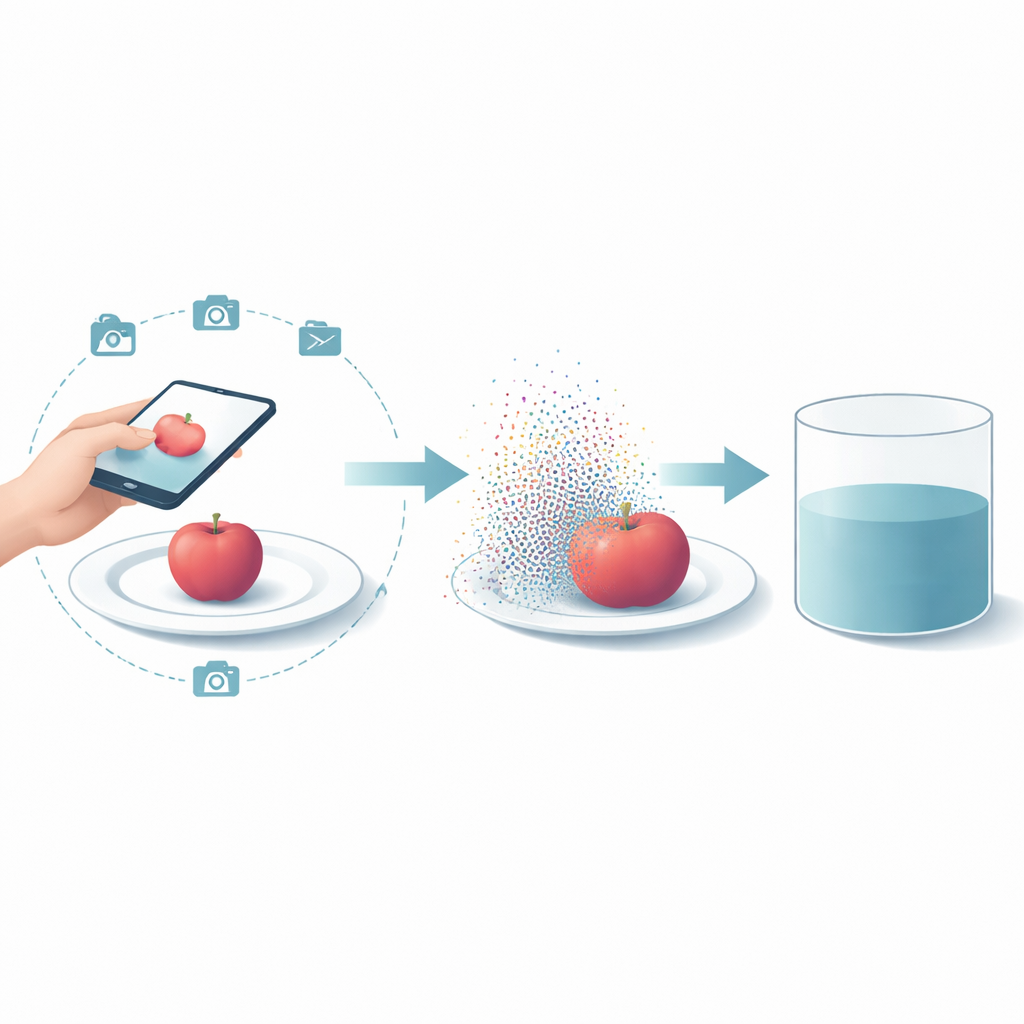

De simples photos à des formes solides

L’idée centrale de VolE est de transformer une courte vidéo prise au téléphone, de façon décontractée, en une forme 3D précise qui peut être mesurée. Lorsque l’utilisateur déplace lentement son téléphone autour d’une assiette, les fonctions de réalité augmentée intégrées (ARCore sur Android ou ARKit sur iOS) enregistrent à la fois les images et la position et l’orientation exactes de la caméra dans l’espace réel. VolE combine ces flux d’images et ces trajectoires de caméra pour reconstruire un « nuage de points » dense de l’aliment — des milliers de petits points flottant dans l’espace qui tracent la surface de l’objet. Parce que le système AR du téléphone connaît déjà les distances réelles, cet objet virtuel est créé à l’échelle physique correcte, résolvant un problème de longue date en vision où la forme 3D peut être récupérée mais pas sa taille réelle.

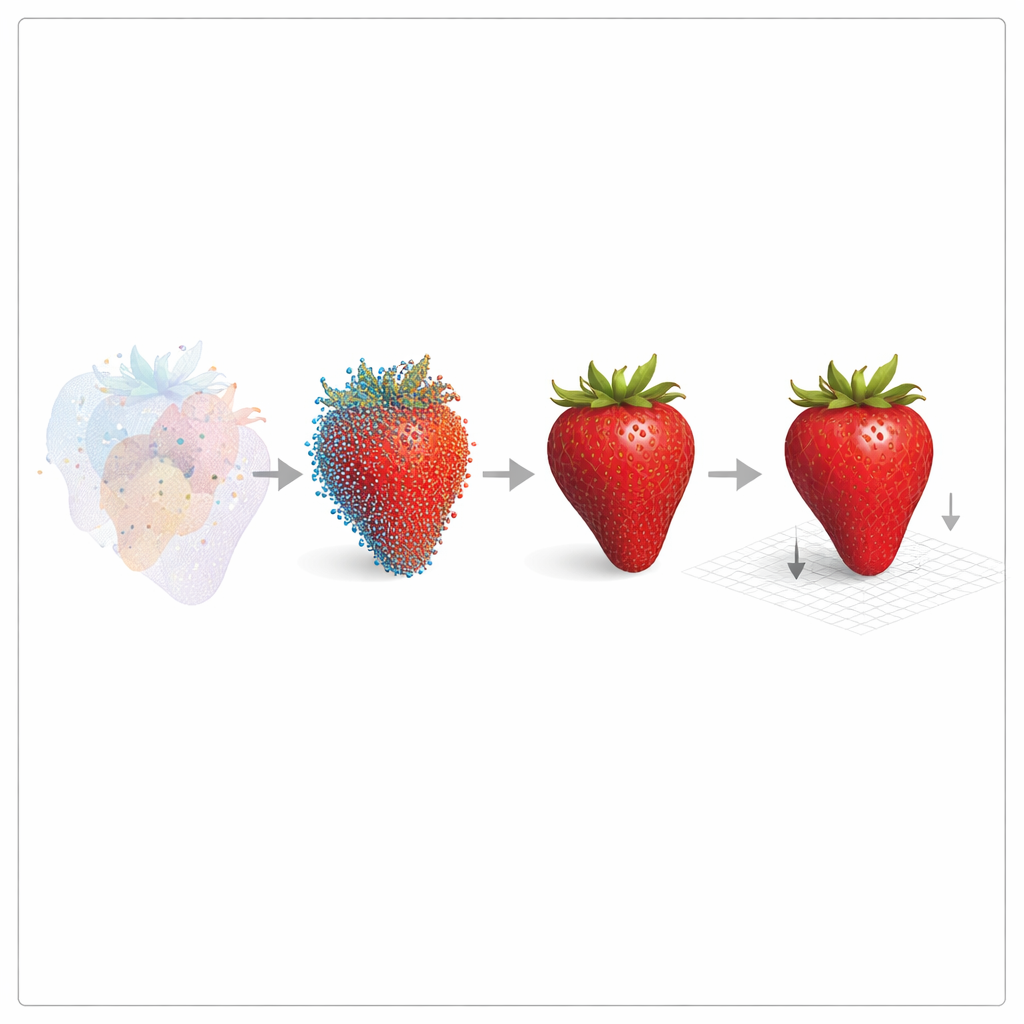

Localiser l’aliment et nettoyer la scène

Les photos d’aliments sont chargées : assiettes, tables et désordre d’arrière-plan se disputent l’attention. VolE s’attaque à cela par une étape automatique de segmentation vidéo qui agit comme des ciseaux intelligents. Un modèle appelé FoodMem identifie quels pixels appartiennent à l’aliment sur toutes les images de la vidéo, même lorsque le téléphone bouge et que l’aliment devient partiellement masqué. En utilisant les positions de caméra raffinées, VolE projette les points 3D dans chaque image segmentée et ne conserve que ceux qui se retrouvent systématiquement sur l’aliment dans chaque vue. Le résultat est un nuage de points propre et isolé appartenant uniquement à l’objet ciblé, tandis que la plupart des points d’arrière-plan et des erreurs de segmentation sont filtrés.

Des points à un objet mesurable

Les nuages de points seuls sont difficiles à mesurer, donc VolE les convertit en une surface numérique continue appelée maillage. Des logiciels 3D spécialisés relient les points voisins par de petits triangles qui enveloppent l’aliment comme une peau tendue, comblant les petits trous et rendant l’objet « étanche ». Le maillage est ensuite affiné par des étapes de lissage, de débruitage et d’optimisation qui enlèvent bosses et trous sans modifier la taille réelle de manière significative. Enfin, on utilise un tour de force mathématique connu sous le nom de théorème de la divergence : la surface est décomposée en nombreuses petites pièces, chacune traitée comme une petite pyramide ancrée à l’origine. La somme des volumes signés de toutes ces pièces donne le volume total de l’aliment en centimètres cubes, prêt à être converti en masse et en calories via des tables de densité standard.

Tests sur des aliments réels et des bancs d’essai exigeants

Pour évaluer les performances de VolE, les auteurs ont constitué un nouveau jeu de données « Foodkit » de 21 aliments réels — des pommes et bananes aux wraps et pâtisseries — capturés avec 700 à 1200 images chacun. Ils ont mesuré le volume réel par déplacement d’eau et la masse avec une balance de laboratoire, puis comparé ces valeurs aux estimations de VolE. Sur l’ensemble des items, l’erreur moyenne de volume était d’environ 1–2 %, correspondant à une précision d’environ 99 %, et restait stable sur des exécutions répétées malgré l’aléa interne du logiciel de reconstruction. VolE a également été évalué sur des jeux de données publics difficiles utilisés dans des compétitions internationales, surpassant ou égalant les meilleures méthodes existantes d’estimation du volume des aliments tout en ne nécessitant ni planche de calibration, ni capteurs de profondeur, ni montures de caméra fixes.

Ce que cela signifie pour la santé quotidienne

En termes simples, ce travail montre qu’un téléphone que vous possédez déjà peut, avec les bons algorithmes, mesurer votre nourriture presque aussi bien que du matériel de laboratoire. En transformant des vidéos décontractées en modèles 3D précis, VolE élimine le besoin de balances, de scanners spécialisés ou de photos soigneusement mises en scène avec objets de référence. Bien qu’il fonctionne actuellement mieux pour un seul élément principal sur une assiette et qu’il s’exécute encore sur un ordinateur puissant plutôt que directement sur le téléphone, la méthode ouvre la voie à un avenir proche où les applications de suivi nutritionnel pourront estimer automatiquement et de manière fiable les portions. Cela pourrait rendre le suivi nutritionnel à long terme plus objectif, moins contraignant et beaucoup plus accessible aux personnes gérant leur santé au quotidien.

Citation: Haroon, U., AlMughrabi, A., Zoumpekas, T. et al. VolE: A point-cloud framework for food 3D reconstruction and volume estimation. Sci Rep 16, 8648 (2026). https://doi.org/10.1038/s41598-026-38756-5

Mots-clés: estimation du volume des aliments, reconstruction 3D, santé mobile, réalité augmentée, évaluation diététique