Clear Sky Science · fr

Prédiction de charge basée sur l’attention et allocation dynamique des ressources pour environnements de calcul hétérogènes

Pourquoi des ordinateurs plus intelligents comptent pour tous

Derrière chaque film que vous diffusez, chaque carte que vous ouvrez ou chaque assistant IA avec lequel vous échangez, d’immenses entrepôts d’ordinateurs travaillent silencieusement 24 heures sur 24. À mesure que l’intelligence artificielle devient plus puissante, ces centres de données sont poussés à leurs limites : ils doivent jongler avec de nombreux types de tâches sur de nombreux types de machines tout en maîtrisant les coûts, la rapidité et la consommation d’énergie. Cet article présente une nouvelle méthode pour prédire les besoins futurs de ces ordinateurs à court terme et pour répartir les travaux entre différents types de matériel afin que les services restent rapides et fiables tout en gaspillant moins d’électricité.

Beaucoup de tâches, beaucoup de machines

Les centres de données modernes ne reposent plus sur un seul type de serveur. Ils combinent processeurs classiques, cartes graphiques puissantes, cartes AI spécialisées et circuits reprogrammables. Différentes tâches d’IA — comme l’entraînement d’un grand modèle de langage, la diffusion de recommandations en temps réel ou l’analyse d’images — conviennent très différemment à ces machines. Aujourd’hui, les opérateurs allouent souvent les ressources en suivant des règles fixes ou des prévisions simples basées sur l’usage d’hier. Quand la demande augmente soudainement, cela peut provoquer des réponses lentes ou des ruptures d’accord de service ; quand la demande baisse, du matériel coûteux peut rester inactif, consommant de l’énergie sans faire grand-chose.

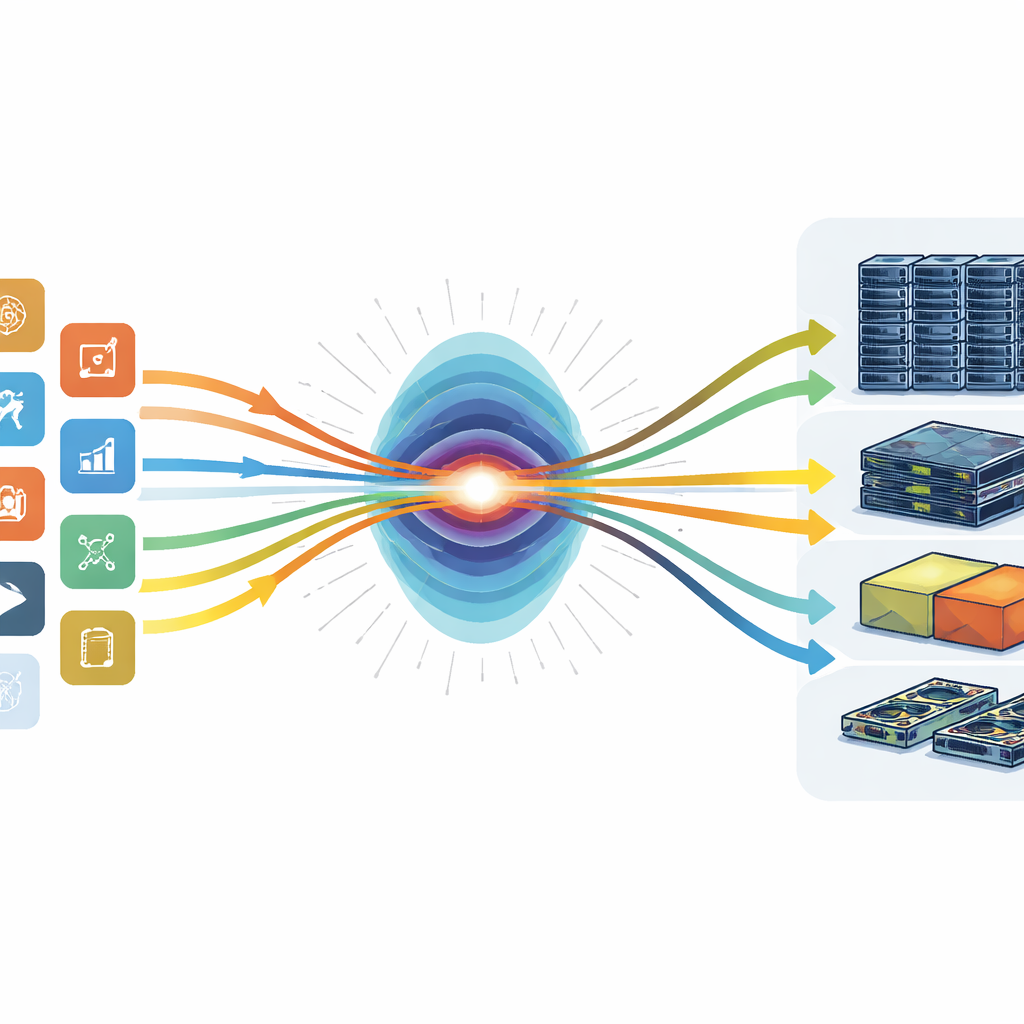

Apprendre à regarder là où ça compte

Les auteurs empruntent un concept des modèles d’IA de pointe appelé « attention » et l’appliquent à la gestion des centres de données. Au lieu de traiter toutes les données d’usage passées de la même manière, leur système apprend quels instants et quels types de tâches sont les plus utiles pour deviner ce qui se passera ensuite. Une partie du modèle se concentre sur l’évolution dans le temps de chaque charge de travail — par exemple un travail d’entraînement ou un service en ligne. Une autre partie examine transversalement les différentes charges qui tournent au même moment pour déceler des connexions cachées, comme le schéma où la fin d’un lot d’entraînements entraîne souvent une vague de requêtes en ligne associées. En superposant ces deux perspectives, le système peut prévoir les demandes futures de processeurs, mémoire et accélérateurs avec plus de précision que les méthodes antérieures.

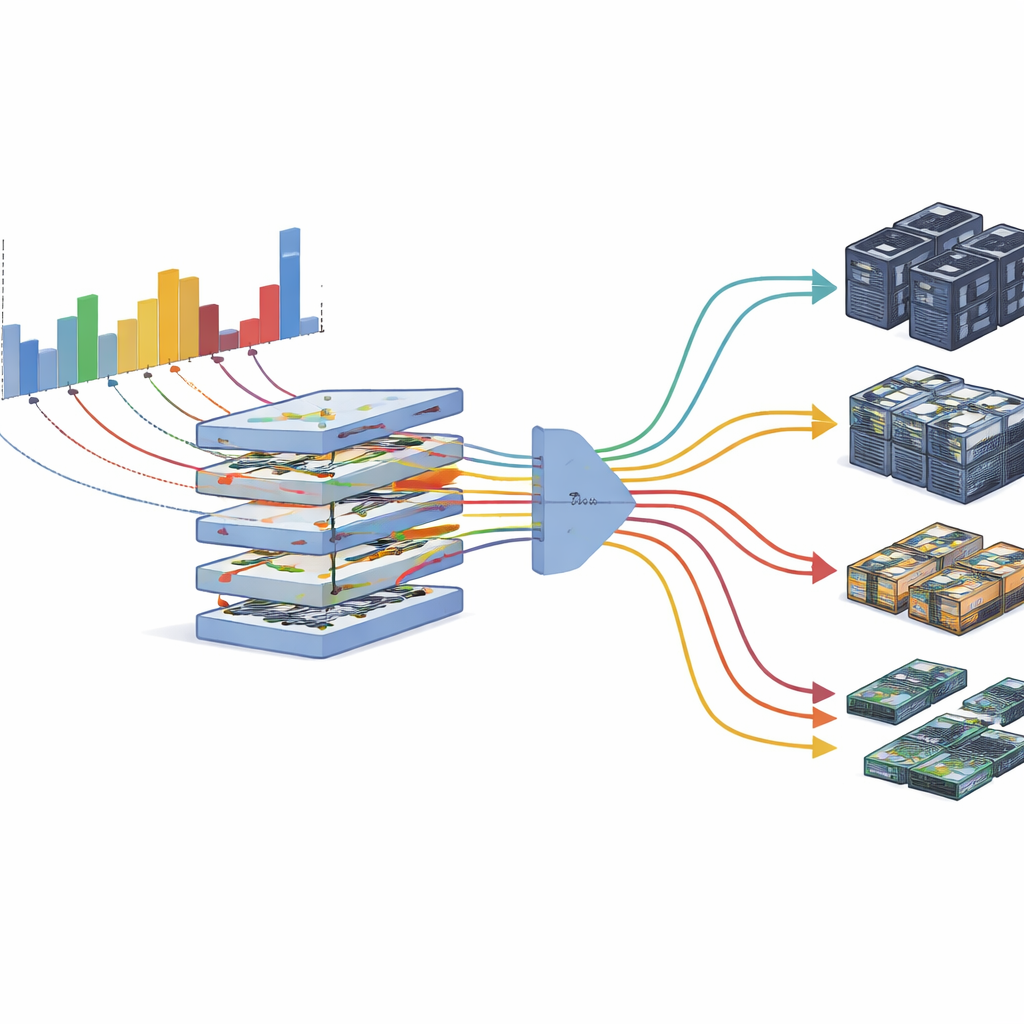

Transformer les prévisions en meilleures décisions

La prévision seule ne suffit pas ; le centre de données doit en tenir compte pour agir. La seconde moitié du cadre transforme ces prévisions en décisions concrètes sur l’emplacement d’exécution de chaque tâche. Les auteurs considèrent cela comme un exercice d’équilibre entre trois objectifs : terminer les tâches rapidement, utiliser le moins d’énergie possible et garder les machines occupées plutôt qu’inactives. Leur ordonnanceur représente le centre de données comme un réseau d’appareils différents et utilise une procédure d’optimisation pour choisir des placements qui arbitrent entre ces objectifs selon les préférences de l’opérateur. Parce que les prévisions ne sont jamais parfaites, le système estime aussi sa propre incertitude et laisse des marges de sécurité quand c’est nécessaire, puis surveille la réalité en temps réel pour ajuster en suspendant les travaux de faible priorité ou en déplaçant des tâches quand l’utilisation diverge des attentes.

Mettre le système à l’épreuve

Pour évaluer cette approche en pratique, les chercheurs ont construit un cluster de test avec un mélange réaliste de processeurs, GPU et matériel AI spécialisé, et y ont injecté des traces d’activité détaillées provenant de centres de données réels chez Google, Alibaba et un laboratoire académique. Ils ont comparé leur méthode à des outils de prévision et des stratégies d’ordonnancement populaires, y compris des techniques utilisées en production et des contrôleurs basés sur l’apprentissage par renforcement. Le prédicteur basé sur l’attention a systématiquement fourni des estimations plus précises, en particulier pour les pics brusques qui surviennent souvent dans les charges de travail IA. Couplé à leur allocateur dynamique, le système a porté l’utilisation globale du matériel à environ quatre cinquièmes de la capacité, réduit le temps moyen d’achèvement des tâches d’environ un quart et diminué la consommation d’énergie d’environ 15 %, tout en maintenant les violations de service à un très faible niveau.

Ce que cela signifie pour les utilisateurs quotidiens

Pour les non-spécialistes, la principale conclusion est que mieux coordonner l’intérieur des centres de données peut rendre les services d’IA plus rapides, moins chers et plus écologiques sans nécessiter de nouvelles puces ou de nouveaux bâtiments. En apprenant où « porter attention » dans le flot de données d’usage, ce cadre aide le matériel existant à accomplir davantage de travail utile et à rester inactif moins souvent. Cela permet aux entreprises de proposer des applications plus réactives et des outils d’IA plus puissants tout en maîtrisant la facture d’électricité et l’empreinte carbone. À mesure que des systèmes similaires de prédiction et d’allocation se répandent et mûrissent, la machinerie invisible d’internet pourrait devenir non seulement plus performante mais aussi plus durable.

Citation: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Mots-clés: ordonnancement des centres de données, prédiction de charge IA, informatique hétérogène, informatique économe en énergie, allocation des ressources