Clear Sky Science · fr

Audit de confidentialité plus strict de la descente de gradient stochastique différentiellement privée dans le modèle de menace à état caché

Pourquoi cela importe pour la technologie du quotidien

Les applications modernes apprennent en permanence de nos données, des photos et messages aux dossiers médicaux. Une méthode de référence pour préserver la sécurité de cet apprentissage s’appelle la confidentialité différentielle, qui ajoute un bruit finement calibré pour qu’aucune donnée individuelle ne ressorte. Mais comment savoir que ces protections fonctionnent réellement en pratique, surtout pour les réseaux neuronaux profonds utilisés aujourd’hui ? Cet article explore cette question et montre quand le fait de cacher le « film d’entraînement » d’un modèle aide vraiment la confidentialité — et quand ce n’est pas le cas.

Comment l’apprentissage privé est censé fonctionner

La descente de gradient stochastique différentiellement privée (DP-SGD) est l’algorithme de référence pour l’apprentissage automatique respectueux de la vie privée. Il entraîne les modèles étape par étape sur de petits lots de données, en rognant (clipping) le gradient de chaque étape (la direction d’amélioration) et en ajoutant du bruit aléatoire avant de mettre à jour le modèle. La théorie fournit des bornes supérieures sur l’influence que les données d’une personne peuvent avoir sur le modèle final, résumées par un nombre de confidentialité souvent appelé epsilon. Parallèlement, « l’audit de confidentialité » tente d’attaquer le modèle entraîné pour mesurer combien d’information peut réellement être extraite en pratique. Si la théorie et l’audit concordent, nous pouvons faire confiance à notre comptabilité de confidentialité ; si elles divergent, quelque chose d’important échappe à l’analyse.

Ce qui change lorsque seul le modèle final est révélé

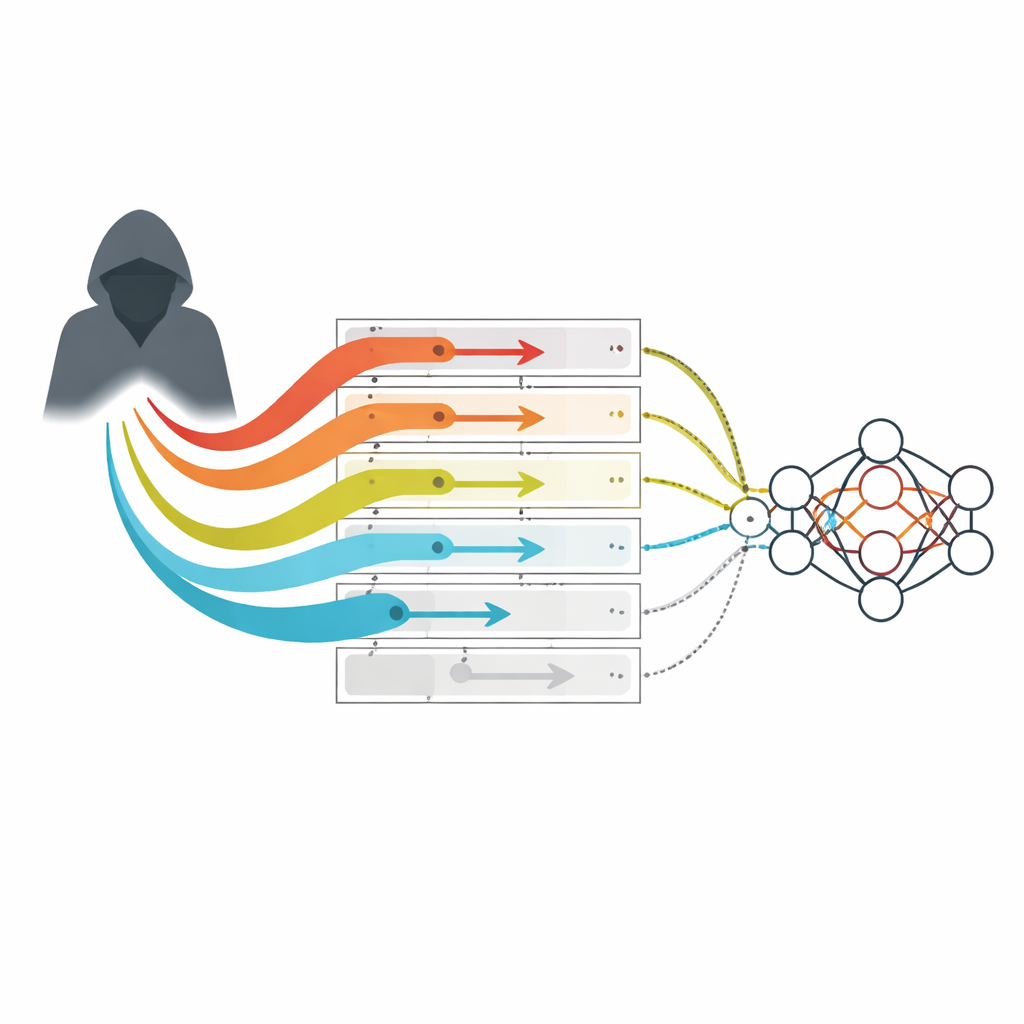

La plupart des audits antérieurs supposaient un adversaire puissant capable de voir tous les points de contrôle intermédiaires du modèle pendant l’entraînement. En réalité, de nombreuses organisations ne publient que le modèle final, pas l’historique complet de l’entraînement. Ce cadre plus réaliste s’appelle le modèle de menace à état caché. Des travaux théoriques récents ont suggéré que, du moins pour des problèmes convexes simples, le fait de cacher les modèles intermédiaires pourrait amplifier la confidentialité au fil du temps : les données utilisées tôt dans l’entraînement seraient « lavées » par des mises à jour bruitées ultérieures. Cependant, l’apprentissage profond moderne repose sur des modèles fortement non convexes, où la surface de perte est rugueuse et complexe. Il était incertain que la même amplification y survienne réellement — ou si les attaques existantes étaient simplement trop faibles pour révéler la perte de confidentialité complète.

Une nouvelle manière pour les adversaires d’influencer le modèle

L’auteur introduit une nouvelle famille d’adversaires « façonnant les gradients » (gradient-crafting) adaptée au modèle d’état caché. Plutôt que d’essayer de concevoir un point de donnée spécial puis d’observer comment sa perte évolue pendant l’entraînement (comme dans les attaques classiques basées sur la perte), ces adversaires prescrivent directement la séquence de gradients qui seraient appliqués si un point de donnée pire-cas était présent. Ils choisissent des gradients qui atteignent toujours le seuil de clipping et s’alignent sur des directions de paramètres rarement utilisées, rendant leur influence plus facile à détecter même sans voir les modèles intermédiaires. Deux variantes simples sont étudiées : l’une qui choisit aléatoirement une direction de paramètre, et l’autre qui simule le processus d’entraînement pour trouver la direction la moins mise à jour avant d’injecter des gradients forts et répétés le long de celle-ci.

Ce que révèlent les expériences sur le risque réel pour la confidentialité

En utilisant ce cadre, l’article audite DP-SGD sur des jeux de données d’images et tabulaires avec des architectures courantes comme les réseaux convolutionnels et résiduels, ainsi qu’un petit modèle fully connected. Lorsque le gradient façonné est utilisé à chaque étape d’entraînement, les nouveaux adversaires atteignent les bornes théoriques strictes de confidentialité — bien qu’ils voient uniquement le modèle final. Cela signifie que, dans ce cas extrême, cacher les points de contrôle intermédiaires n’apporte aucune confidentialité supplémentaire. Lorsqu’on insère le gradient façonné moins souvent, le tableau change : pour des lots de grande taille par rapport au niveau de bruit, les audits restent proches de la théorie (ce qui suggère à nouveau une faible amplification réelle), mais pour des lots plus petits et un bruit plus élevé, un écart apparaît indiquant une amplification véritable, quoique modeste, de la confidentialité dans des réglages non convexes.

Un regard à l’intérieur de la limite pire-cas

Pour comprendre les limites absolues de la confidentialité dans le modèle d’état caché, l’article étudie aussi un adversaire théorique plus extrême qui non seulement façonne des gradients mais conçoit également un paysage de perte entier pour maintenir l’influence d’un point de donnée spécial à travers les itérations. Dans ce cadre contrôlé, les résultats distinguent clairement deux régimes : avec de grands lots, la comptabilité de confidentialité basée sur la théorie standard est essentiellement serrée, mais avec de petits lots et un bruit important, l’information initiale sur un point de donnée est en partie oubliée au fil du temps. Crucialement, cette amplification est plus faible que ce qui est connu pour des problèmes convexes simples et n’efface jamais complètement le risque pour la confidentialité.

Ce que cela signifie pour les utilisateurs et les praticiens

Pour les non-spécialistes, la conclusion est que le simple fait de cacher l’historique d’entraînement d’un modèle d’apprentissage profond n’assure pas magiquement une confidentialité beaucoup plus forte. Lorsqu’une personne voit ses données utilisées très fréquemment pendant l’entraînement, son risque est proche de ce que prédit déjà la théorie conservatrice actuelle. Une protection supplémentaire apparaît dans des régimes plus favorables — petits lots avec un bruit significatif — mais elle reste modeste et ne réduit pas le risque à zéro. Ces conclusions valident certaines parties de la comptabilité de confidentialité existante tout en en soulignant les limites, offrant une image plus claire et réaliste de la protection que DP-SGD peut fournir lorsque seul le modèle final est partagé.

Citation: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Mots-clés: confidentialité différentielle, DP-SGD, audit de confidentialité, sécurité de l'apprentissage automatique, modèle à état caché