Clear Sky Science · fr

Un réseau YOLOv11 amélioré pour la détection des débris marins en milieu sous-marin

Pourquoi il est important de repérer les déchets sous l’eau

Bien en dessous de la surface de l’océan, sacs plastiques, bouteilles, lignes de pêche et autres débris s’accumulent silencieusement. Ces déchets nuisent à la vie marine, obstruent des habitats sensibles et peuvent même gêner les robots sous-marins que les scientifiques utilisent pour étudier et protéger la mer. L’article résumé ici décrit un système de vision par ordinateur plus intelligent qui aide caméras et robots à repérer et étiqueter automatiquement les déchets sous-marins en temps réel, même dans des eaux troubles et encombrées.

Le défi de voir clairement sous la mer

Contrairement aux photos diurnes claires sur terre, les images sous-marines sont souvent sombres, brumeuses et teintées de bleu ou de vert. La lumière s’atténue rapidement avec la profondeur, le sable et le plancton brouillent l’eau, et les déchets sont souvent petits, partiellement cachés ou ressemblent à des roches et des plantes. Les méthodes traditionnelles de traitement d’images peinent dans ces conditions, et même les détecteurs modernes d’apprentissage profond peuvent manquer de minuscules objets ou confondre des textures de fond avec des débris. Pourtant, une détection précise et rapide est cruciale pour cartographier la pollution, piloter des robots de nettoyage et suivre l’évolution des déchets marins au fil du temps.

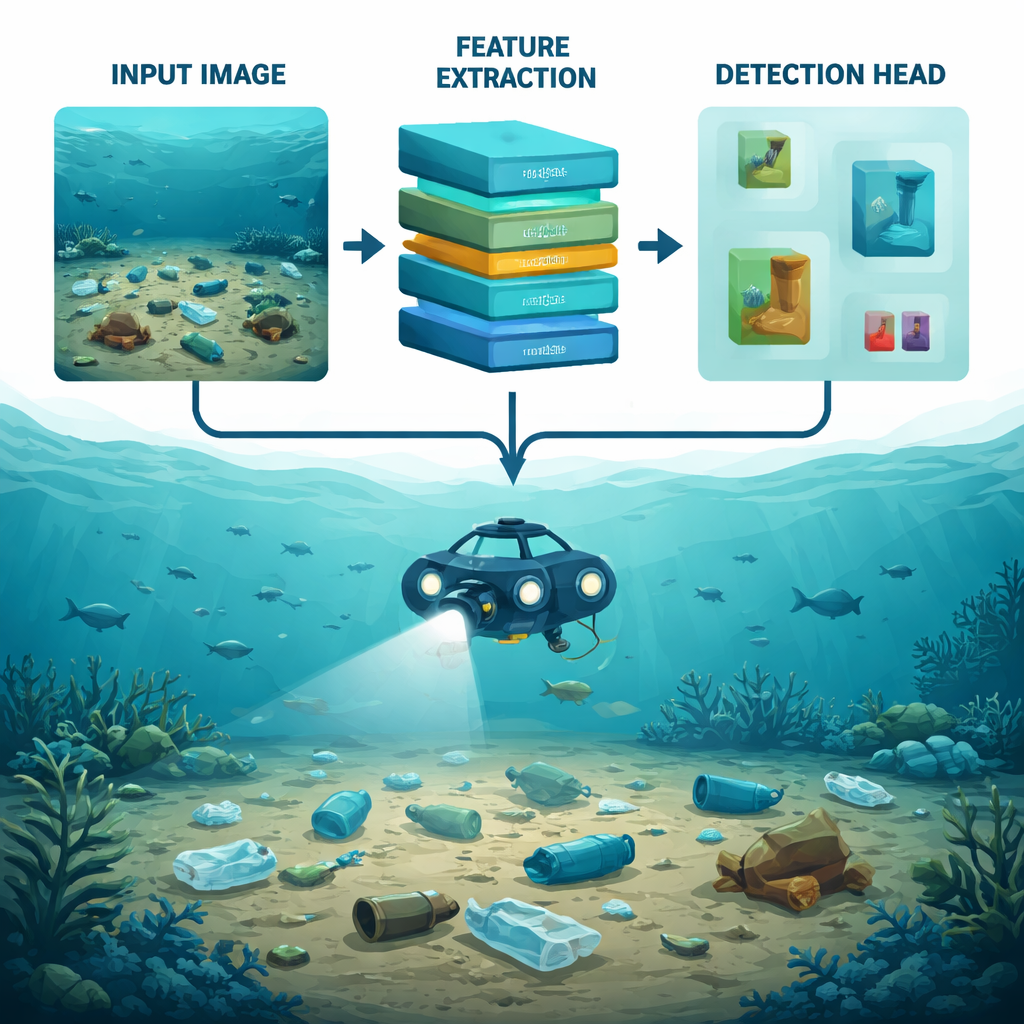

Partir d’un moteur visuel rapide

Les auteurs s’appuient sur YOLOv11, un membre récent de la famille « You Only Look Once » de détecteurs d’objets. Les modèles YOLO sont appréciés car ils parcourent une image une seule fois et prédisent en temps réel les emplacements et les types de nombreux objets. Toutefois, la conception standard de YOLOv11 a été créée pour des scènes plus classiques, comme des rues ou des photos d’intérieur, et non pour le monde visuelement exigeant sous-marin. Pour combler cet écart, les chercheurs repensent deux parties clés du réseau : la manière dont il extrait d’abord les motifs visuels d’une image, et la façon dont il décide ensuite quelles zones constituent des objets de déchets importants et quelles zones ne sont que du bruit de fond.

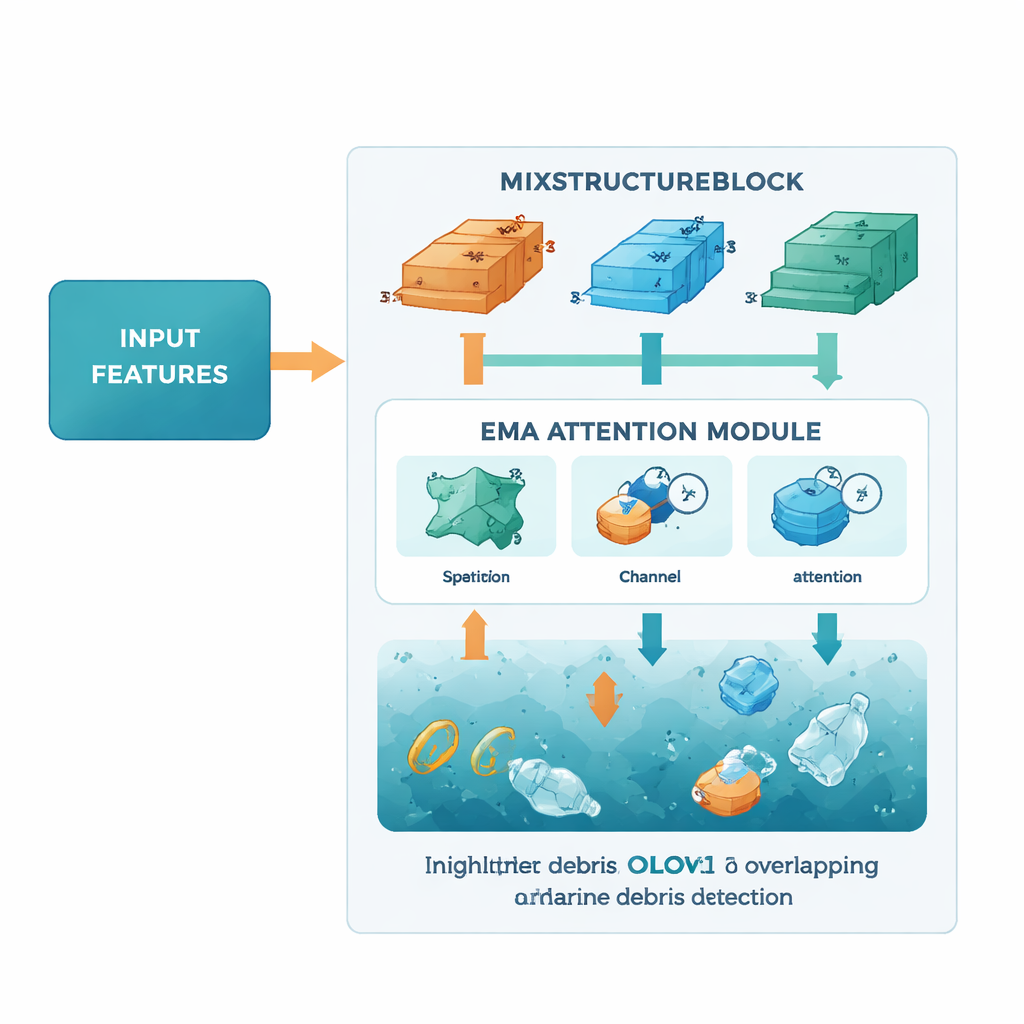

Une nouvelle façon de repérer les détails à plusieurs échelles

La première amélioration est un module appelé MixStructureBlock, qui remplace un bloc standard dans la colonne vertébrale (backbone) de YOLOv11. Au lieu d’utiliser un seul motif fixe de filtres, MixStructureBlock exécute plusieurs branches en parallèle qui examinent la scène avec différentes « tailles de fenêtre » et espacements. Cela aide le réseau à détecter à la fois de fins détails, comme le bord d’un bouchon de bouteille, et des formes plus larges, comme un sac dérivant. De plus, le bloc inclut de simples mécanismes d’attention qui apprennent à mettre en avant les couleurs et les zones informatives tout en atténuant les parties de fond peu utiles. Le résultat est un ensemble de caractéristiques plus riche et plus propre qui facilite la détection de petits débris faibles.

Apprendre au réseau où porter son attention

La seconde amélioration est un module Efficient Multi-scale Attention (EMA), ajouté plus loin dans le réseau là où sont effectuées les détections. EMA examine les cartes de caractéristiques à la fois dans l’espace et entre les canaux, se posant en quelque sorte deux questions à la fois : « Où dans l’image se passe quelque chose d’important ? » et « Quels types de motifs sont les plus pertinents maintenant ? » En regroupant l’information à plusieurs échelles et en utilisant des opérations mathématiques légères, EMA aiguise la focalisation du réseau sur les régions susceptibles de contenir des déchets — comme des objets qui se chevauchent ou des éléments faibles et éloignés de la caméra — tout en conservant un modèle global compact et suffisamment rapide pour une utilisation en temps réel sur du matériel embarqué.

Tester le système

Pour évaluer leur conception, l’équipe a entraîné et testé le modèle sur TrashCan, une grande collection publique d’images en eaux profondes rassemblée au Japon. Une version du jeu de données étiquette les débris par type d’objet spécifique (comme gobelet, sac ou tuyau métallique), tandis qu’une autre regroupe les éléments par matériau (comme plastique ou tissu). Sur les deux versions, le réseau amélioré surpasse plusieurs références solides, y compris le YOLOv11 original, des systèmes antérieurs de détection de débris marins et d’autres variantes YOLO adaptées au milieu sous-marin. Il détecte non seulement davantage de débris correctement, en particulier les objets petits et en forte densité, mais le fait aussi avec une taille de modèle remarquablement réduite d’environ 5 mégaoctets, adaptée aux véhicules sous-marins à puissance limitée.

Ce que cela signifie pour des océans plus propres

En termes simples, l’étude montre que repenser soigneusement la façon dont une IA « regarde » les images sous-marines peut réellement améliorer la détection des déchets sous les vagues. En combinant une extraction multi-échelle des motifs avec une attention intelligente aux régions importantes, le système proposé repère plus de débris tout en restant suffisamment efficace pour une utilisation en temps réel. Déployée sur des systèmes de caméras et des robots sous-marins, une telle technologie pourrait aider les scientifiques et les agences environnementales à cartographier les points chauds de pollution, orienter les opérations de nettoyage et surveiller si les politiques visant à réduire les déchets marins portent leurs fruits — nous rapprochant ainsi d’océans en meilleure santé.

Citation: Yuanwei, J., Yijiang, D., Xuemei, W. et al. An improved YOLOv11 network for marine debris detection in underwater environment. Sci Rep 16, 7074 (2026). https://doi.org/10.1038/s41598-026-38305-0

Mots-clés: détection des débris marins, robotique sous-marine, détection d'objets, apprentissage profond, pollution océanique