Clear Sky Science · fr

DeepLab V3+ à attention multi-niveaux avec EfficientNetB0 pour la segmentation des organes du tube digestif sur scans IRM

Une visée plus précise sur les tumeurs

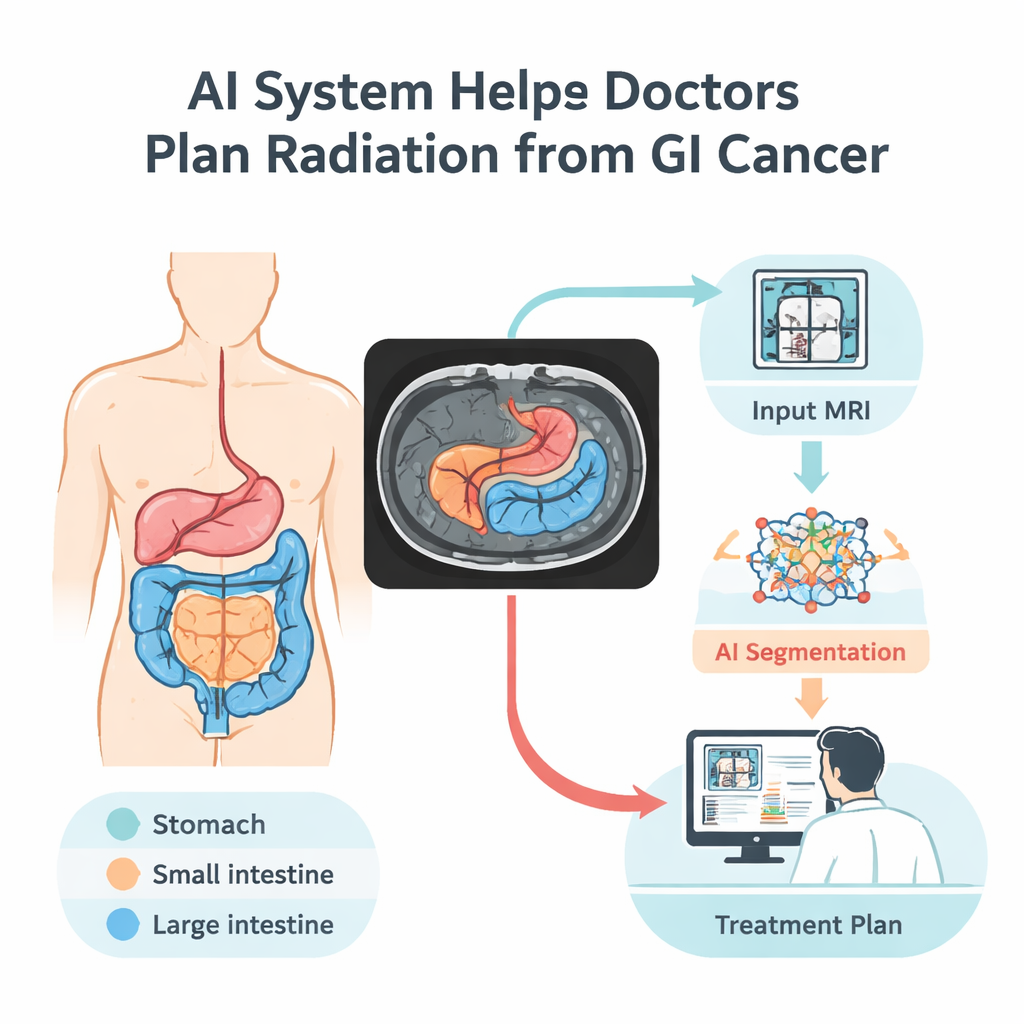

Lorsque les médecins traitent les cancers du système digestif par radiation, ils doivent ménager un équilibre délicat : cibler fermement la tumeur tout en épargnant les organes sains voisins comme l’estomac et les intestins. Aujourd’hui, délimiter ces organes manuellement sur chaque image par résonance magnétique (IRM) peut prendre jusqu’à une heure par patient et par séance. Cette étude présente un système de vision par ordinateur qui trace automatiquement ces organes sur les images IRM, promettant une planification des traitements plus rapide, plus précise et avec moins d’effets secondaires pour les patients.

Pourquoi cartographier l’intestin est important

Les cancers gastro-intestinaux sont fréquents et souvent mortels, avec une survie globale autour de 30 %. La radiothérapie est un pilier du traitement, mais le tube digestif est compacté dans l’abdomen et les organes sains peuvent légèrement bouger d’un jour à l’autre. Pour éviter d’endommager l’estomac, l’intestin grêle et le gros intestin, les spécialistes doivent localiser précisément ces organes avant chaque séance. Le traçage manuel est lent et sujet à des variations entre experts. Une méthode automatisée et fiable pour dessiner ces frontières pourrait raccourcir les rendez-vous, permettre aux médecins de traiter davantage de patients et améliorer la sécurité et la précision des doses de radiation.

Apprendre aux ordinateurs à lire les IRM

Les chercheurs ont construit un modèle d’intelligence artificielle qui apprend à reconnaître trois organes digestifs clés sur les scans IRM : l’estomac, l’intestin grêle et le gros intestin. Ils l’ont entraîné sur le jeu de données UW–Madison GI Tract, la seule collection publique avec des contours d’organes détaillés sur des IRM abdominales. Ce jeu comprend 38 496 images provenant de 85 patients, ainsi que des annotations soigneusement préparées indiquant où chaque organe apparaît — ou quand aucun organe n’est présent. Pour tirer parti de cet échantillon relativement restreint, l’équipe a séparé les données par patient (pour que le modèle ne voie jamais la même personne à la fois en entraînement et en test) et augmenté le jeu par des retournements, rotations, modifications de luminosité et déformations douces des images. Ces variations contrôlées aident le système à supporter les différences réelles de position du patient, de luminosité d’image et de formes subtiles.

Comment le nouveau modèle d’IA perçoit les motifs

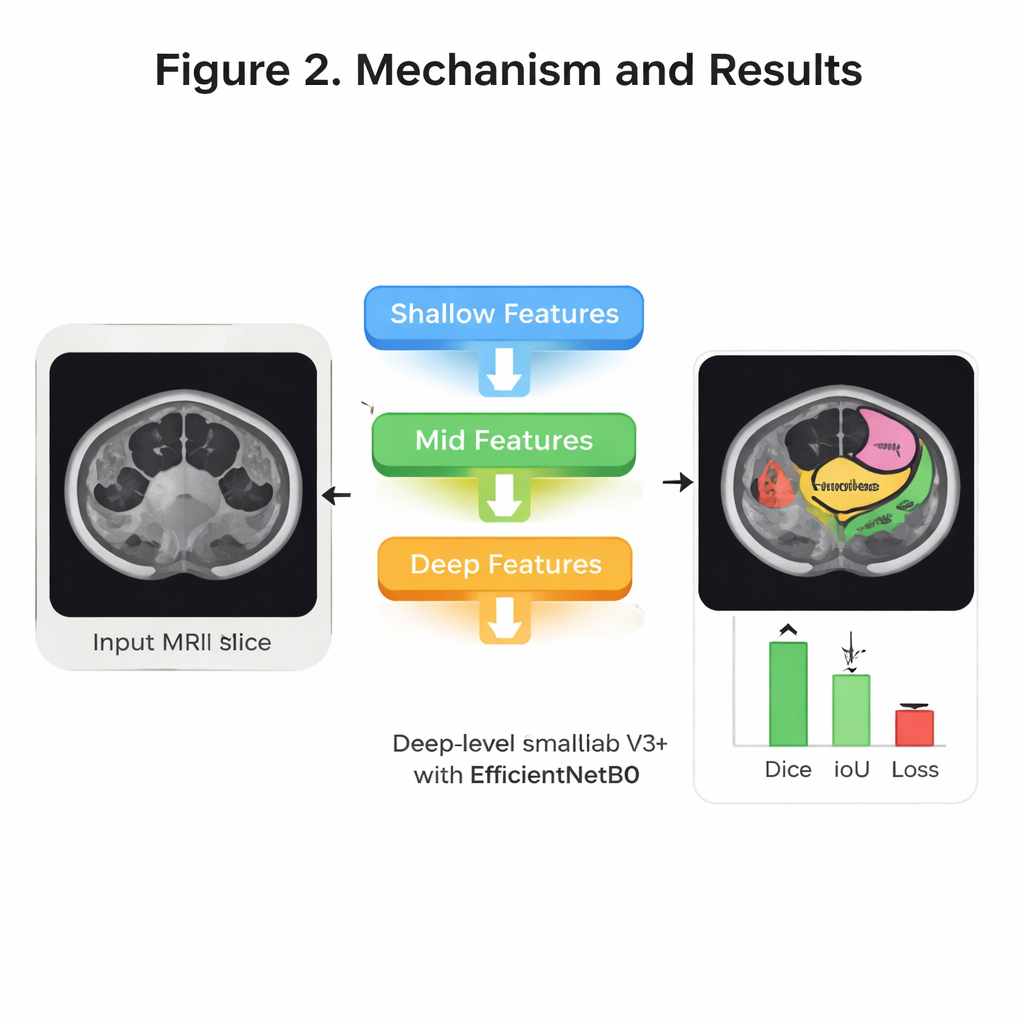

Dans le modèle, plusieurs idées issues de la reconnaissance d’images moderne sont combinées pour affiner son « regard » sur l’anatomie. D’abord, un réseau compact appelé EfficientNet B0 balaie chaque image et construit des couches de caractéristiques visuelles — des bords simples aux formes d’organes complexes — tout en maintenant des besoins de calcul modestes. Ensuite, une architecture nommée DeepLab V3+ examine l’image à plusieurs échelles, un peu comme zoomer en avant et en arrière pour comprendre à la fois les détails fins et le contexte global. Par-dessus cela, les auteurs ajoutent un mécanisme d’« attention » à plusieurs niveaux de détail. Concrètement, l’attention aide le système à décider quelles parties de l’image et quelles signaux internes méritent plus d’importance, afin de se concentrer sur des indices subtils mais importants qui distinguent, par exemple, l’estomac des anses de l’intestin grêle. Enfin, une étape de décodage recoud ces indices pour produire un masque propre en taille réelle montrant les trois organes.

Évaluer la précision et l’efficacité

L’équipe a réglé systématiquement les paramètres d’entraînement du système — en testant différentes méthodes d’optimisation, nombres de cycles d’entraînement et façons de répartir les données pour la validation. Leur meilleure configuration utilisait un optimiseur appelé RMSprop, une validation croisée à quatre volets et 30 cycles d’entraînement. Sur des patients réservés pour le test, le modèle a correctement étiqueté plus de 99 % des pixels au total et a montré un très fort chevauchement avec les contours tracés par des experts. Une mesure de recouvrement largement utilisée, le score Dice, a atteint environ 94 % en moyenne sur les trois organes, tandis qu’une mesure connexe, l’Intersection over Union, a atteint environ 92 %. Tout aussi important pour une utilisation hospitalière, le système est relativement léger : il compte environ 8,3 millions de paramètres entraînables et peut traiter une coupe IRM typique de 224×224 en environ 31 millisecondes, suffisamment rapide pour un support quasi temps réel lors de la planification quotidienne des traitements.

Ce que cela pourrait signifier pour les patients

En termes concrets, cette étude montre qu’une IA soigneusement conçue peut tracer de manière fiable l’estomac et les intestins sur des images IRM, atteignant une performance comparable à celle d’experts tout en étant beaucoup plus rapide et cohérente. Cette capacité pourrait aider les oncologues radiothérapeutes à ajuster les faisceaux plus précisément autour des tissus sensibles, réduisant les dommages indésirables et les effets secondaires pendant le traitement. Bien que le modèle actuel ait été entraîné sur des scans d’un seul centre et sur une anatomie majoritairement saine, il constitue une base solide pour des systèmes futurs intégrant des organes malades et des données de plusieurs hôpitaux. Avec des tests et des améliorations supplémentaires, des outils de ce type pourraient devenir des assistants routiniers en salle de planification de radiothérapie, garantissant discrètement que les rayons salvateurs atteignent exactement les zones où ils sont le plus nécessaires.

Citation: Sharma, N., Gupta, S., Al-Yarimi, F.A.M. et al. Multi-level attention DeepLab V3+ with EfficientNetB0 for GI tract organ segmentation in MRI scans. Sci Rep 16, 7546 (2026). https://doi.org/10.1038/s41598-026-38247-7

Mots-clés: cancer gastro-intestinal, segmentation IRM, planification de radiothérapie, apprentissage profond en médecine, analyse d'images médicales