Clear Sky Science · fr

Un cadre hybride d’apprentissage profond utilisant des modèles convolutionnels et transformeurs pour une classification robuste des maladies végétales

Pourquoi repérer les plantes malades importe

Les maladies des plantes détruisent silencieusement une part considérable de la production alimentaire mondiale chaque année, réduisant les rendements, affectant les revenus des agriculteurs et menaçant la sécurité alimentaire. Les détecter tôt est difficile : les champs sont vastes, les spécialistes en phytopathologie sont rares et de nombreux symptômes sont discrets. Cet article examine comment un nouveau type d’intelligence artificielle peut apprendre à reconnaître des dizaines de maladies foliaires à partir de photos simples, offrant une voie vers des outils pour smartphone ou caméras de terrain qui aident les agriculteurs à agir avant que les problèmes ne se propagent.

De l’estimation humaine aux yeux numériques

Le diagnostic traditionnel repose sur l’inspection visuelle des feuilles par des personnes et parfois l’envoi d’échantillons en laboratoire. Ce processus est lent, subjectif et souvent indisponible dans les régions rurales. Au cours de la dernière décennie, les chercheurs ont entraîné des programmes informatiques à interpréter des images de feuilles. Les systèmes antérieurs exigeaient soit que des ingénieurs conçoivent à la main des indices visuels, soit utilisaient des modèles d’apprentissage profond appelés réseaux de neurones convolutionnels, excellents pour repérer textures, couleurs et contours. Ces méthodes ont amélioré la précision mais peinaient encore lorsque les signes de maladie étaient faibles, répartis sur la feuille ou similaires entre différentes affections. La nouvelle étude se demande si la combinaison de deux approches d’IA modernes peut fournir des réponses plus fiables dans ces cas difficiles.

Mélanger deux manières de voir

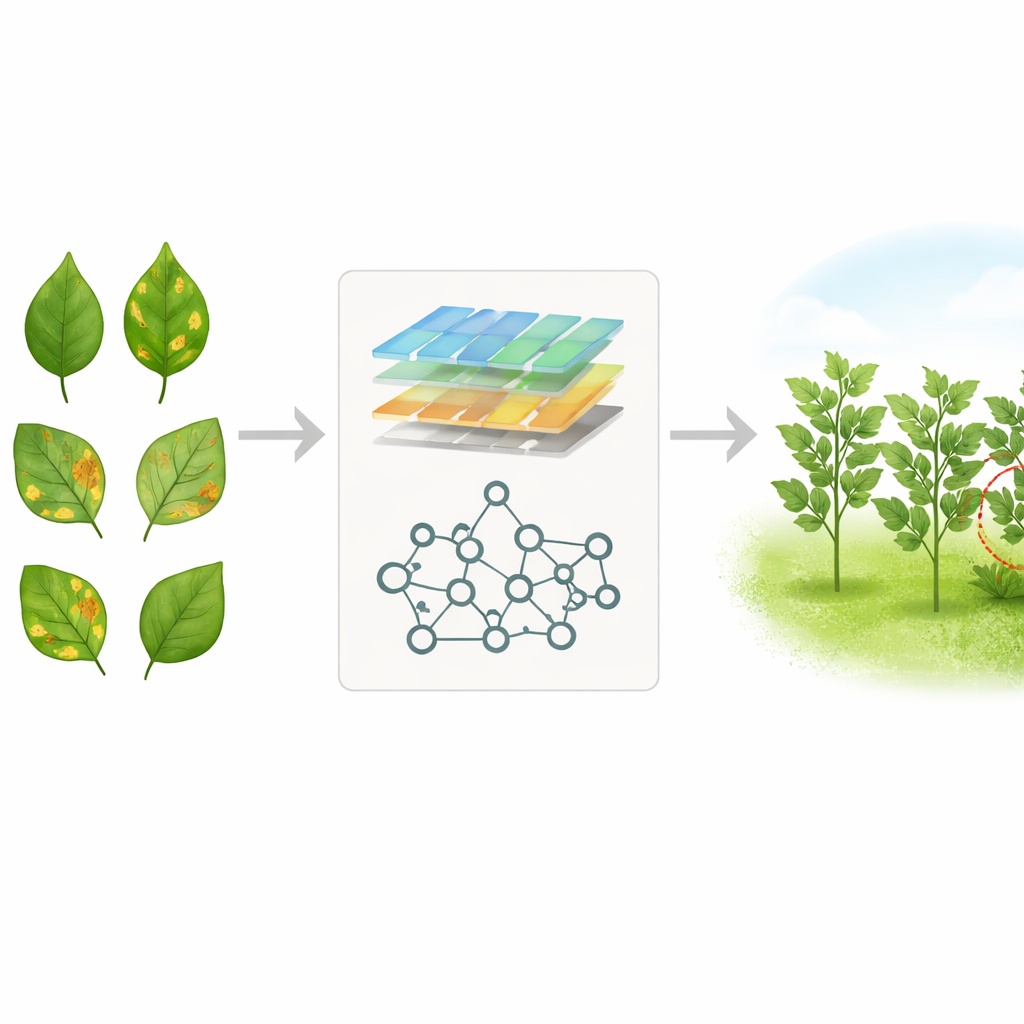

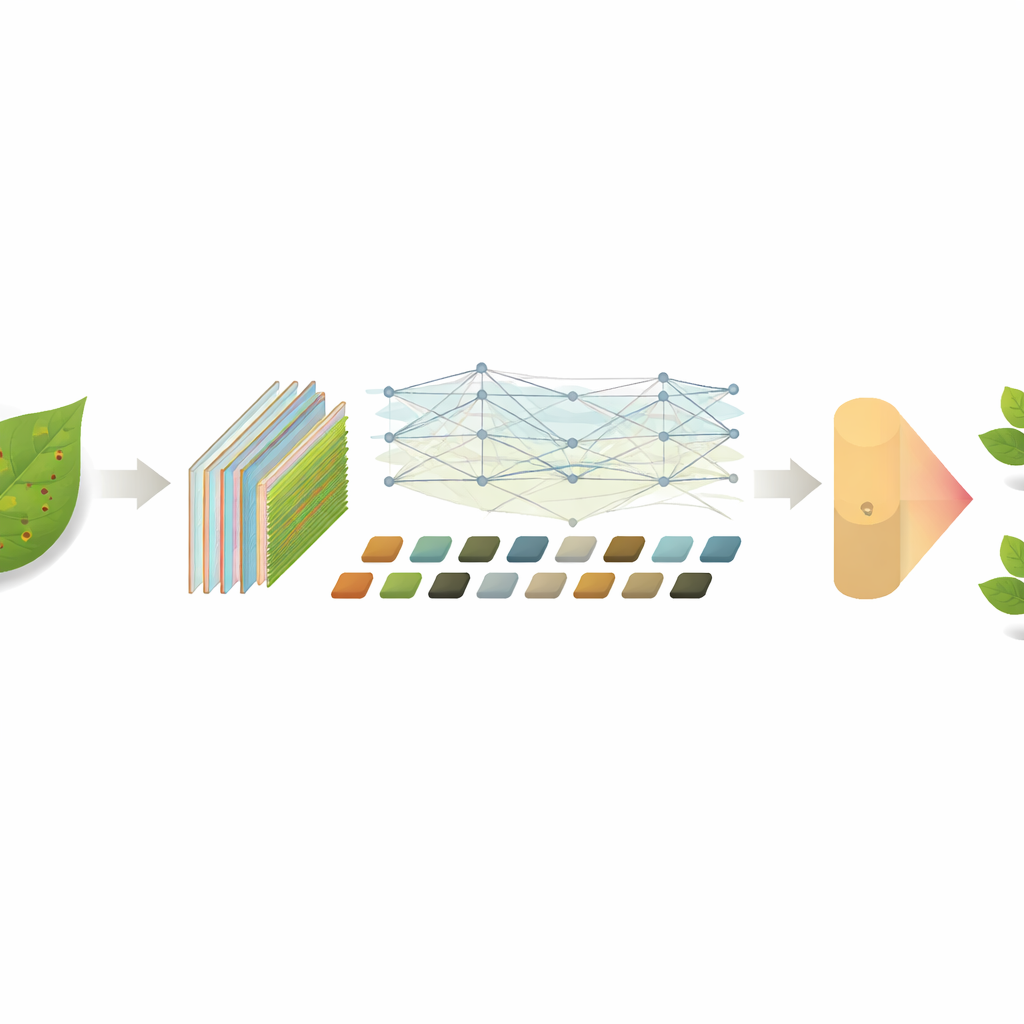

Les auteurs construisent un système hybride qui fusionne un réseau convolutionnel avec un modèle d’image plus récent connu sous le nom de vision transformer. La première partie, EfficientNet-B7, joue le rôle d’une loupe, explorant les photos de feuilles pour détecter des détails fins tels que petites taches, nervures et changements de couleur. Sa sortie est ensuite remodelée et transmise à un transformeur (ViT-B16), conçu pour remarquer comment différentes régions de l’image se rapportent les unes aux autres sur de longues distances. En transformant les caractéristiques détaillées en une série de petits patchs et en laissant le transformeur évaluer comment chaque patch interagit avec les autres, le système peut comprendre à la fois les lésions locales et le motif global à la surface de la feuille. Cette combinaison vise à imiter la manière dont un agronome expérimenté observe de près une lésion tout en considérant son emplacement et son environnement.

Apprendre au système avec des milliers de feuilles

Pour entraîner et tester leur modèle, les chercheurs ont utilisé une grande collection publique de 21 534 images montrant 38 conditions différentes, incluant de nombreuses maladies et des feuilles saines de cultures telles que le pommier, la tomate, la vigne et le maïs. Ils ont standardisé les photos à une taille commune et appliqué des astuces numériques — rotations, retournements et zooms — pour simuler les conditions désordonnées des champs réels. Le modèle apprend d’abord des motifs visuels généraux à partir de données d’images existantes, puis est affiné sur cette collection végétale. Tout au long de l’entraînement, l’équipe suit non seulement la précision globale mais aussi la fréquence à laquelle le système identifie correctement chaque maladie et sa capacité à éviter les faux positifs, s’assurant que les performances résistent tant pour les classes courantes que pour les classes rares.

Performances de l’approche hybride

Évalué sur des images inédites, le modèle hybride classe correctement l’état sanitaire et les maladies des plantes dans 98,13 % des cas, et maintient des scores élevés sur des mesures strictes de précision, rappel et équilibre entre les deux. Il gère à la fois les feuilles saines et les maladies difficiles, bien que les symptômes très précoces restent plus problématiques. Les auteurs comparent leur système à une gamme d’alternatives populaires, incluant des réseaux convolutionnels autonomes, des modèles transformeurs purs, des réseaux mobiles légers, des détecteurs rapides comme YOLO, ainsi que des outils classiques tels que les machines à vecteurs de support et les forêts aléatoires. Dans ces confrontations, l’hybride se classe systématiquement en tête, devançant même de solides concurrents utilisant uniquement EfficientNet ou des ensembles de plusieurs réseaux.

Ce que cela signifie pour les exploitations et l’alimentation

Concrètement, l’étude montre que la combinaison de deux « regards » complémentaires sur une image — détail local net et contexte large — peut améliorer sensiblement la détection automatique des maladies des plantes. Bien que le système actuel requière encore des photos relativement nettes et fonctionne au mieux sur des machines équipées de processeurs graphiques, les mêmes idées de conception pourraient être adaptées en versions allégées pour smartphones, drones ou dispositifs de terrain à faible coût. À mesure que ces outils mûriront, ils pourraient fournir aux agriculteurs des conseils rapides et sur place sur ce qui attaque leurs cultures et où, favorisant un traitement plus précoce, une réduction de l’utilisation de produits chimiques et des récoltes plus stables. Pour le grand public, le message clé est que des caméras et des algorithmes plus intelligents deviennent des alliés puissants pour protéger l’approvisionnement alimentaire mondial.

Citation: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Mots-clés: détection des maladies des plantes, apprentissage profond, vision transformer, agriculture de précision, classification d’images