Clear Sky Science · fr

Réseaux neuronaux quantiques récurrents à diagonale stables pour l’identification de systèmes non linéaires

Apprendre aux machines à comprendre des systèmes désordonnés

Beaucoup de systèmes qui influent sur notre quotidien — des moteurs électriques dans les appareils aux écoulements d’air turbulents, voire certains processus médicaux — se comportent de façon complexe et non linéaire. Cela signifie que de petites variations des entrées peuvent produire des réponses surprenantes ou chaotiques. Prédire et contrôler de tels systèmes est difficile, mais essentiel pour l’efficacité, la sécurité et les économies d’énergie. Cet article présente un nouveau type de machine d’apprentissage qui mêle des idées issues de l’informatique quantique, des réseaux neuronaux et de la théorie de la stabilité pour modéliser ces comportements difficiles de manière plus précise et plus fiable.

Pourquoi les modèles ordinaires montrent leurs limites

Les outils de modélisation traditionnels supposent souvent que cause et effet sont ordonnés et proportionnels, ce qui fonctionne bien pour des systèmes simples ou presque linéaires. Mais de nombreux systèmes réels ont de la mémoire, des boucles de rétroaction et des seuils qui génèrent un comportement fortement non linéaire. Les réseaux neuronaux classiques ont aidé, mais ils ont leurs propres problèmes. Les réseaux à propagation avant, où l’information circule dans un seul sens, sont performants sur des tâches statiques mais peinent quand l’histoire importe. Les réseaux récurrents, qui réinjectent l’information pour créer de la mémoire, peuvent capturer des comportements dépendant du temps mais sont souvent difficiles à entraîner, sujets à l’instabilité et coûteux en calcul quand chaque neurone communique avec tous les autres.

Mélanger des idées quantiques avec des boucles simples

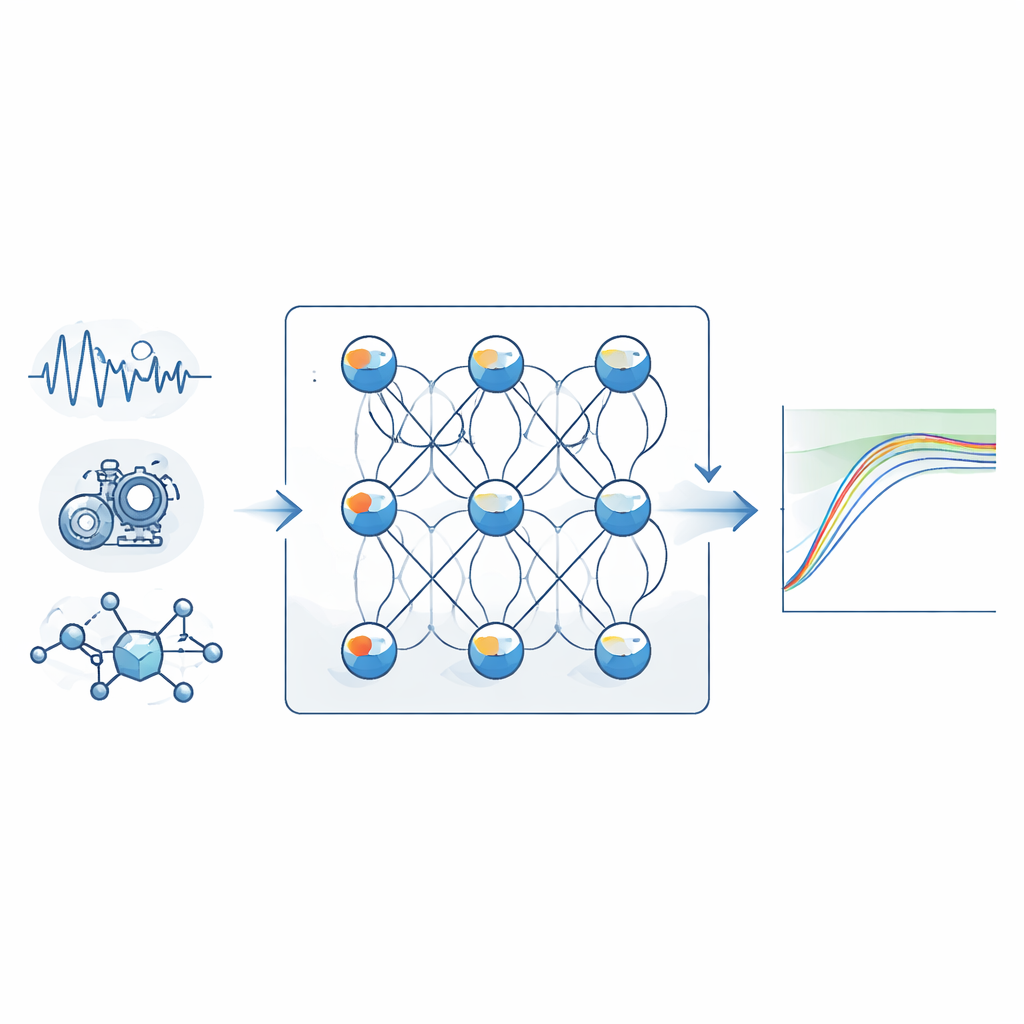

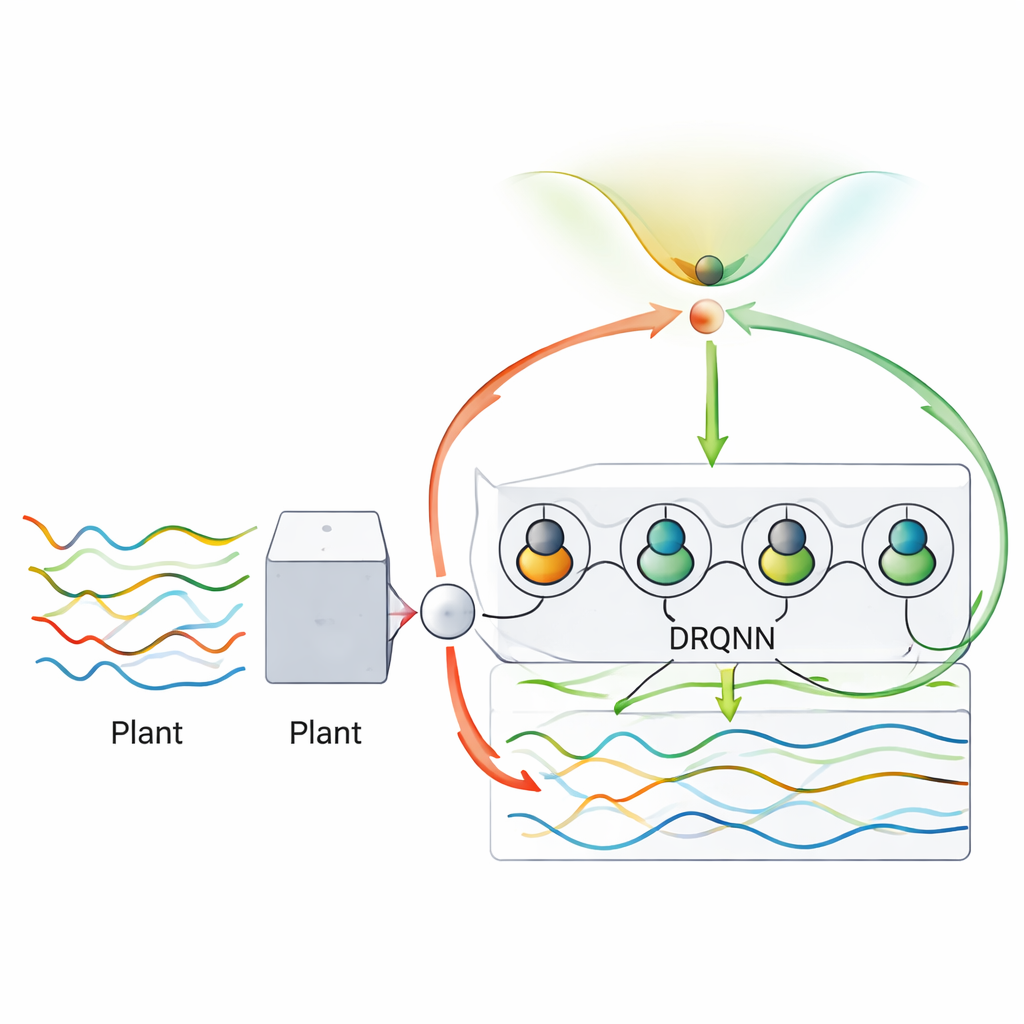

Les auteurs proposent un réseau neuronal récurrent diagonal inspiré du quantique avec stabilité de Lyapunov, abrégé DRQNN-LS. Au cœur, ce réseau ressemble toujours à un réseau à trois couches familier : entrées, couche cachée et sortie. Mais deux éléments le rendent particulier. D’une part, les unités cachées se comportent comme des bits quantiques simplifiés, dont les états internes sont décrits par des grandeurs analogues à des phases plutôt que par de simples nombres. Cette représentation d’inspiration quantique permet à chaque unité d’encoder une information plus riche de façon compacte, améliorant la capacité du réseau à approcher des relations complexes. D’autre part, au lieu d’un enchevêtrement de liaisons de rétroaction, chaque neurone caché ne rétroagit que sur lui‑même. Cette récurrence « diagonale » conserve la mémoire nécessaire pour suivre des motifs variants dans le temps tout en réduisant drastiquement le nombre de connexions à ajuster.

Maintenir l’apprentissage stable et sous contrôle

Un défi majeur lors de l’entraînement de tout réseau récurrent est de garder l’apprentissage stable : si les poids évoluent trop rapidement, la sortie du modèle peut exploser ou osciller ; s’ils évoluent trop lentement, l’apprentissage prend une éternité et peut rester bloqué. Ici, les auteurs s’appuient sur la théorie de la stabilité de Lyapunov, un cadre mathématique développé à l’origine pour analyser la sûreté des systèmes physiques. Ils construisent une fonction spéciale de type énergie qui combine l’erreur de modélisation et l’amplitude des paramètres du réseau. En dérivant soigneusement l’évolution de cette fonction au fil du temps, ils obtiennent des règles automatiques de mise à jour des poids et des paramètres internes du réseau de sorte que l’« énergie » globale ne puisse que décroître. Cela fournit des taux d’apprentissage adaptatifs qui s’accélèrent ou se ralentissent automatiquement, garantissant la convergence sans réglage manuel.

Mettre le nouveau réseau à l’épreuve

Pour montrer que le DRQNN-LS n’est pas qu’une belle idée théorique, les auteurs le testent sur trois tâches très différentes. D’abord, ils modélisent un système non linéaire mathématique au comportement connu, vérifiant la précision du suivi de la sortie par le réseau. Ensuite, ils affrontent la carte chaotique de Henon, un banc d’essai classique où de petites variations des conditions initiales peuvent produire des trajectoires radicalement différentes. Enfin, ils appliquent la méthode à des données réelles d’un petit moteur à courant continu, un dispositif pratique et bruité dont les mécanismes internes ne sont pas complètement connus. Dans chaque cas, ils comparent la nouvelle approche à plusieurs modèles neuronaux existants, y compris des réseaux récurrents diagonaux classiques et des versions antérieures inspirées du quantique entraînées par des règles de gradient plus simples.

Meilleure précision, robustesse et tolérance au bruit

Sur les trois exemples, le DRQNN-LS produit systématiquement des erreurs de prédiction plus faibles et une meilleure adéquation aux signaux réels que les méthodes concurrentes, même lorsque les données sont volontairement corrompues par un bruit important. Bien que le nouveau modèle demande un peu plus de calcul par pas — car il suit des états récurrents d’inspiration quantique et évalue la mise à jour basée sur Lyapunov — les temps d’exécution restent assez faibles pour une utilisation en temps réel sur des processeurs modernes. Les résultats suggèrent que combiner une structure récurrente épurée, des états neuronaux de type quantique et un apprentissage garanti stable d’un point de vue mathématique donne un outil puissant et pratique pour comprendre et prédire des dynamiques non linéaires dans le monde réel.

Ce que cela implique pour la suite

Pour les non‑spécialistes, la conclusion est que nous apprenons à construire des jumeaux numériques plus intelligents et plus fiables de systèmes physiques désordonnés. Le DRQNN-LS offre un moyen d’apprendre le comportement d’un processus complexe directement à partir des données tout en garantissant que son apprentissage ne « s’emballe » pas ni ne dérive de façon imprévisible. Cette combinaison de flexibilité et de stabilité pourrait s’avérer précieuse dans des domaines allant du contrôle industriel et de la robotique aux systèmes électriques et peut‑être même à la modélisation biologique ou médicale, où les comportements non linéaires et les mesures bruitées sont la norme.

Citation: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Mots-clés: identification de systèmes non linéaires, réseau neuronal quantique, réseau neuronal récurrent, stabilité de Lyapunov, modélisation de dynamiques chaotiques