Clear Sky Science · fr

Un cadre d’apprentissage profond pour le diagnostic du cancer du sein utilisant Swin Transformer et le réseau de fusion multi‑échelle à double attention

Pourquoi cela compte pour les patientes et les médecins

Le cancer du sein est l’un des cancers les plus fréquents chez les femmes, et la mammographie reste l’outil principal pour le détecter tôt. Pourtant, l’interprétation de ces radiographies est difficile, même pour les spécialistes, et de petits signes d’alerte peuvent passer inaperçus. Cette étude présente un nouveau système d’intelligence artificielle (IA) conçu pour aider les radiologues à repérer le cancer du sein de façon plus fiable en combinant deux manières complémentaires d’« analyser » les mammographies : l’une qui perçoit la structure globale et l’autre qui zoome sur de très petits détails.

Le défi de voir à la fois la forêt et les arbres

Les systèmes d’IA modernes aident déjà à lire les images médicales, mais la plupart reposent sur un seul type de modèle. Les réseaux de neurones convolutionnels excellent pour repérer des motifs locaux, comme des contours nets ou de petits points brillants. Les vision transformers, une famille de modèles plus récente, sont performants pour comprendre les relations à l’échelle de l’image entière. Les mammographies exigent cependant ces deux capacités simultanément : le cancer peut se manifester par de minuscules microcalcifications ou des distorsions subtiles, mais leur interprétation dépend de leur intégration dans la structure globale du sein. Par ailleurs, les jeux de données de mammographie sont relativement petits et souvent déséquilibrés, avec beaucoup moins de cas cancéreux que d’examens normaux, ce qui facilite le surapprentissage ou l’apparition de biais dans les systèmes d’IA.

Une IA à double voie qui voit large et grossit les détails

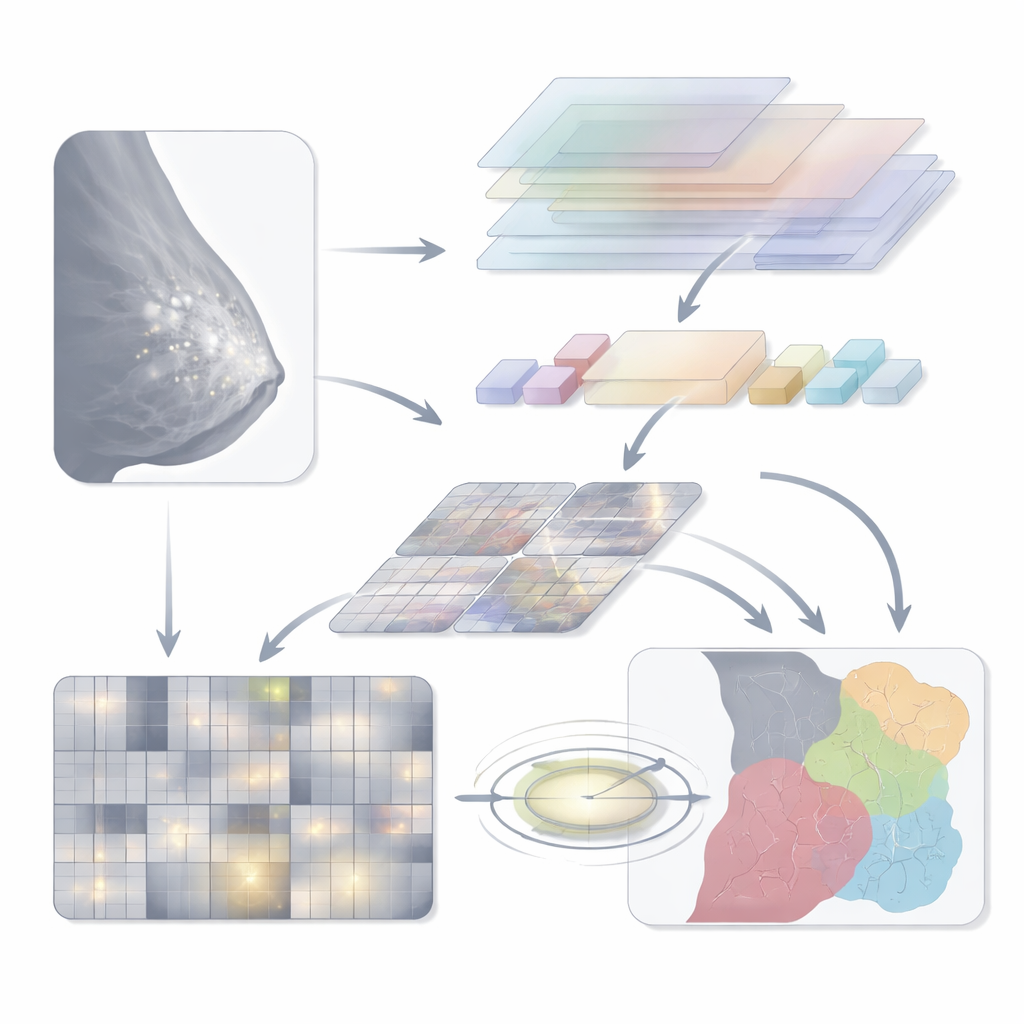

Les auteurs présentent un modèle hybride qu’ils appellent Swin‑DAMFN, conçu explicitement pour fusionner vision globale et locale. Une branche repose sur le Swin Transformer, qui découpe la mammographie en fenêtres et utilise un mécanisme d’attention pour capturer le contexte à longue portée — comment différentes régions du sein se relient entre elles. La seconde branche est un réseau convolutionnel personnalisé, le Dual‑Attention Multi‑scale Fusion Network (DAMFN). Cette branche est réglée pour détecter des détails extrêmement fins comme les microcalcifications et de légères distorsions tissulaires. Des blocs spécialisés y analysent l’image à plusieurs échelles et orientations, puis des modules d’attention mettent en avant les régions d’intérêt clinique tout en atténuant le bruit de fond.

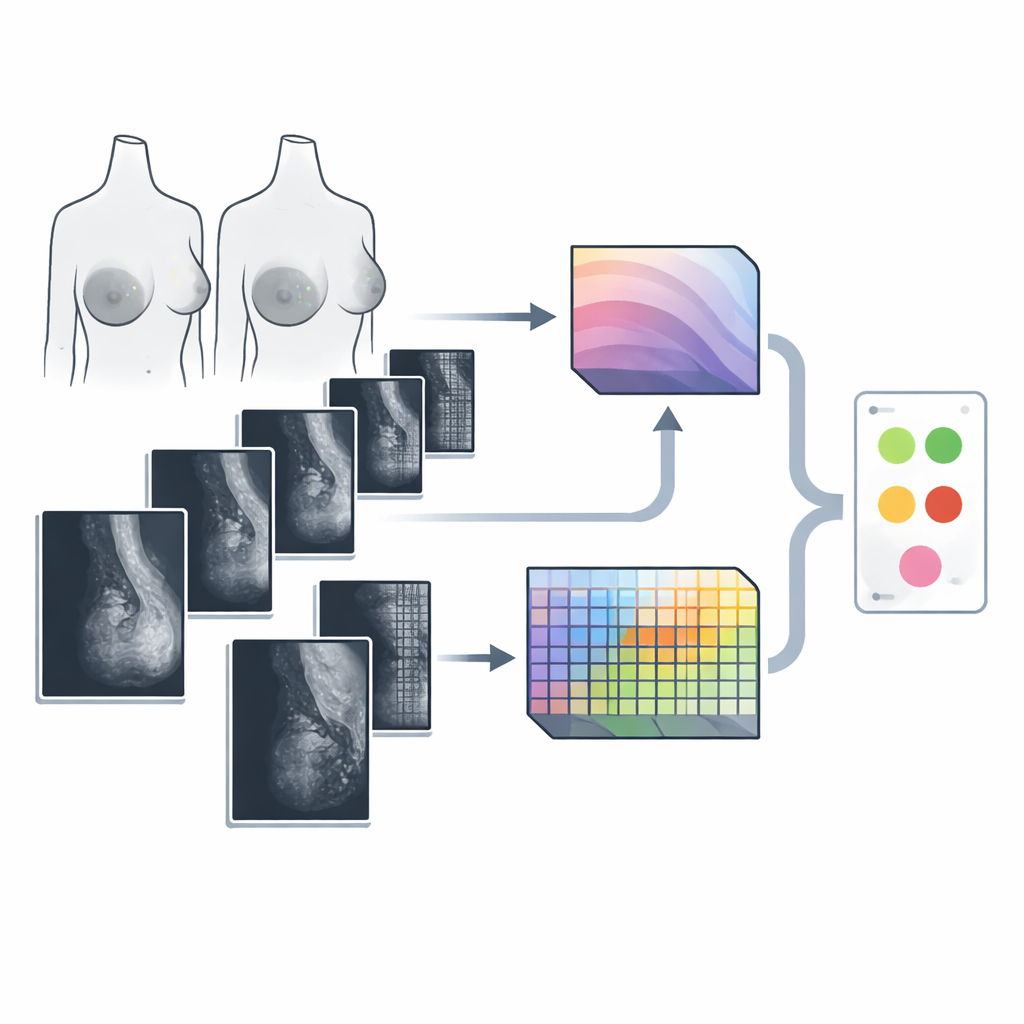

Enseigner au système avec plus d’images et plus de variété

Parce que les jeux de données réels de mammographie sont limités et biaisés vers les cas non cancéreux, les chercheurs ont renforcé les données d’entraînement de deux manières complémentaires. D’abord, ils ont utilisé un type de modèle génératif appelé GAN conditionnel pour synthétiser des patches de mammographie réalistes, en particulier pour les catégories malignes sous‑représentées. Ces images générées aident à rééquilibrer les classes et exposent le modèle à plus de variations d’apparence de la maladie. Ensuite, ils ont appliqué des modifications photométriques — petits ajustements aléatoires de luminosité, contraste et netteté — aux images réelles et synthétiques. Cela contraint l’IA à se focaliser sur des motifs anatomiques réels plutôt que sur des variations d’éclairage ou du bruit superficiel, améliorant ainsi sa capacité à généraliser à de nouveaux examens.

Comment les éléments fonctionnent ensemble lors du diagnostic

Lors de l’analyse, une mammographie prétraitée est alimentée simultanément dans les deux branches. Le Swin Transformer produit un résumé compact de la structure globale, tandis que DAMFN génère une carte riche de caractéristiques locales. Celles‑ci sont ensuite redimensionnées et fusionnées en une représentation unique. Un bloc léger de « triplet attention » affine cette fusion en vérifiant croisement des canaux et des dimensions spatiales, orientant l’attention du modèle vers les zones les plus susceptibles de contenir une lésion. Enfin, une tête de classification simple agrège l’information et fournit une prédiction sur plusieurs classes, telles que tissu normal, anomalies bénignes ou différents types de lésions malignes.

Ce que signifient les résultats en pratique

L’équipe a évalué Swin‑DAMFN sur deux jeux de données publics largement utilisés, CBIS‑DDSM et MIAS, et l’a comparé à de nombreux modèles d’apprentissage profond populaires. Leur système a atteint environ 99 % de précision sur CBIS‑DDSM et presque 99 % sur MIAS, avec une sensibilité (capacité à détecter les cancers) et une spécificité (éviter les faux positifs) également élevées. Des études d’ablation minutieuses ont montré que chaque composant — les deux branches, la fusion basée sur l’attention et la stratégie d’augmentation des données — contribuait à ces progrès. Si les auteurs soulignent qu’un test plus large sur des données hospitalières diversifiées reste nécessaire, les résultats suggèrent que des systèmes hybrides comme Swin‑DAMFN pourraient devenir des assistants précieux en dépistage du cancer du sein, aidant les radiologues à détecter plus tôt et plus régulièrement des lésions dangereuses tout en réduisant la charge de travail et l’incertitude.

Citation: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Mots-clés: cancer du sein, mammographie, apprentissage profond, modèles transformer, IA en imagerie médicale