Clear Sky Science · fr

Détection d'objets en temps réel pour véhicules aériens sans pilote basée sur un vision transformer et l'edge computing

Des yeux plus intelligents dans le ciel

Les véhicules aériens sans pilote — drones — deviennent rapidement des outils courants pour des tâches telles que l'inspection de ponts, la surveillance du trafic et la recherche de personnes disparues. Mais pour qu'un drone aide réellement dans ces missions sensibles au facteur temps, il doit faire plus que filmer : il doit reconnaître de petits objets en temps réel tout en volant avec une batterie limitée et un ordinateur embarqué modeste. Cet article présente une nouvelle façon d'offrir aux drones des « yeux » plus précis et plus rapides en combinant une technique d'IA avancée appelée vision transformer et une utilisation judicieuse d'ordinateurs en bordure (edge computers) à proximité, afin que des petits objets comme des piétons, des vélos et des voitures puissent être repérés rapidement et de manière fiable depuis les airs.

Pourquoi les drones peinent à voir les petits détails

Vu d'en haut, les personnes et les véhicules peuvent se réduire à quelques dizaines de pixels dans une image vidéo. Les systèmes de réseaux neuronaux traditionnels utilisés sur les drones sont conçus pour s'exécuter rapidement sur des puces à basse consommation, mais ils manquent souvent ces tout petits objets ou échouent lorsque l'éclairage ou l'angle de vue change. Les modèles récents de vision transformer, empruntés au domaine du traitement du langage, sont bien meilleurs pour comprendre l'ensemble de la scène et extraire de petits détails d'arrière‑plans encombrés. Le problème est qu'ils exigent généralement une puissance de calcul énorme, bien au‑delà de ce qu'une plateforme volante peut emporter. Les auteurs ont cherché à combler cet écart : conserver la vision fine du transformer, mais l'alléger suffisamment pour qu'il fonctionne en temps réel sur un drone, et déporter le travail supplémentaire vers un serveur edge à proximité seulement lorsque les conditions le permettent.

Un cerveau partagé : drone et edge qui coopèrent

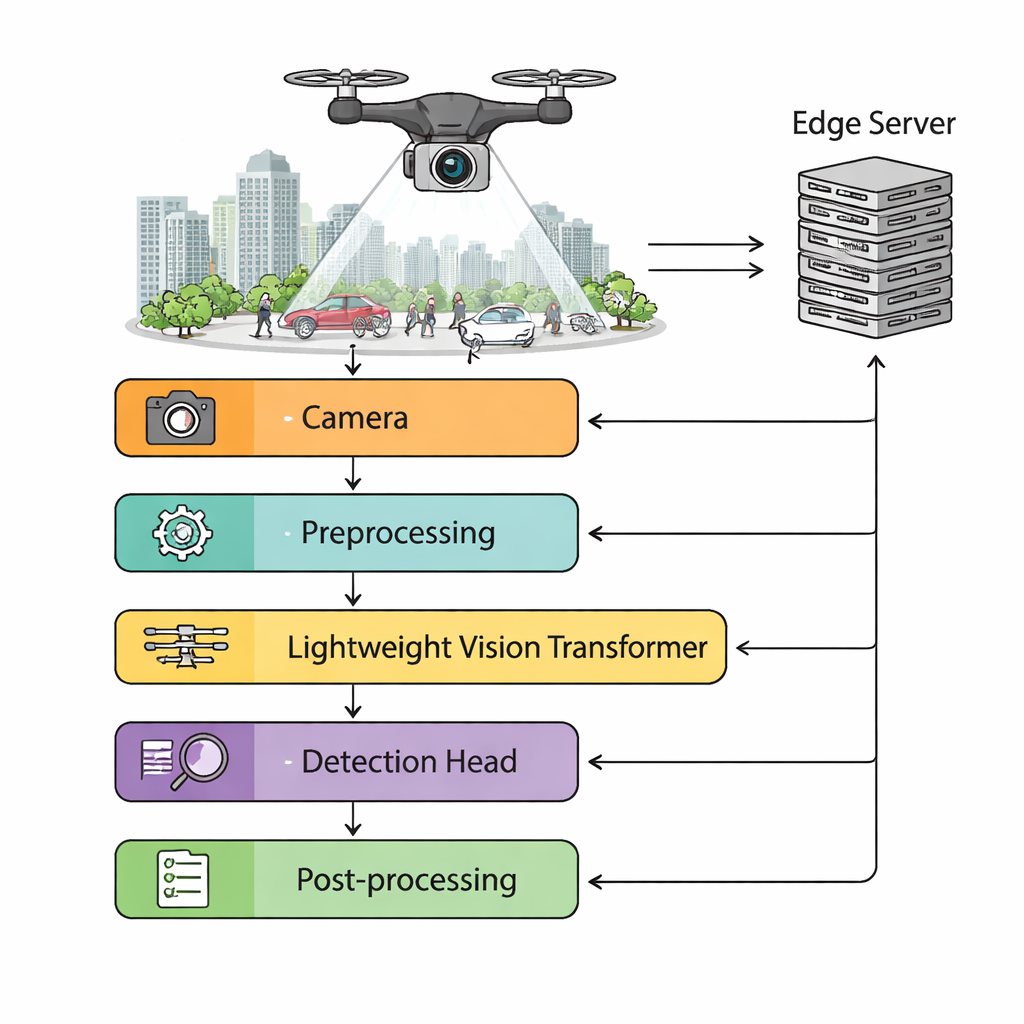

Le cadre proposé répartit le travail entre le drone et un ordinateur edge au sol. La caméra du drone transmet une vidéo haute définition vers un module de prétraitement embarqué qui stabilise les images tremblantes, ajuste la luminosité et redimensionne dynamiquement les images selon la puissance de calcul disponible. Un vision transformer léger extrait ensuite des caractéristiques riches de chaque image, alimentant une tête de détection qui prédit où se trouvent les objets et ce qu'ils sont. Un ordonnanceur surveille la latence du réseau sans fil, le niveau de batterie et la charge de traitement. Lorsque le lien avec le sol est rapide et stable, des tâches plus lourdes — comme le traitement par lots d'images ou l'exécution de modèles supplémentaires pour améliorer la précision — peuvent être déléguées au serveur edge. Lorsque la connexion se dégrade, le système bascule automatiquement sur un traitement entièrement embarqué afin que le drone ne soit jamais « aveugle ».

Alléger le modèle sans lui faire perdre la vue

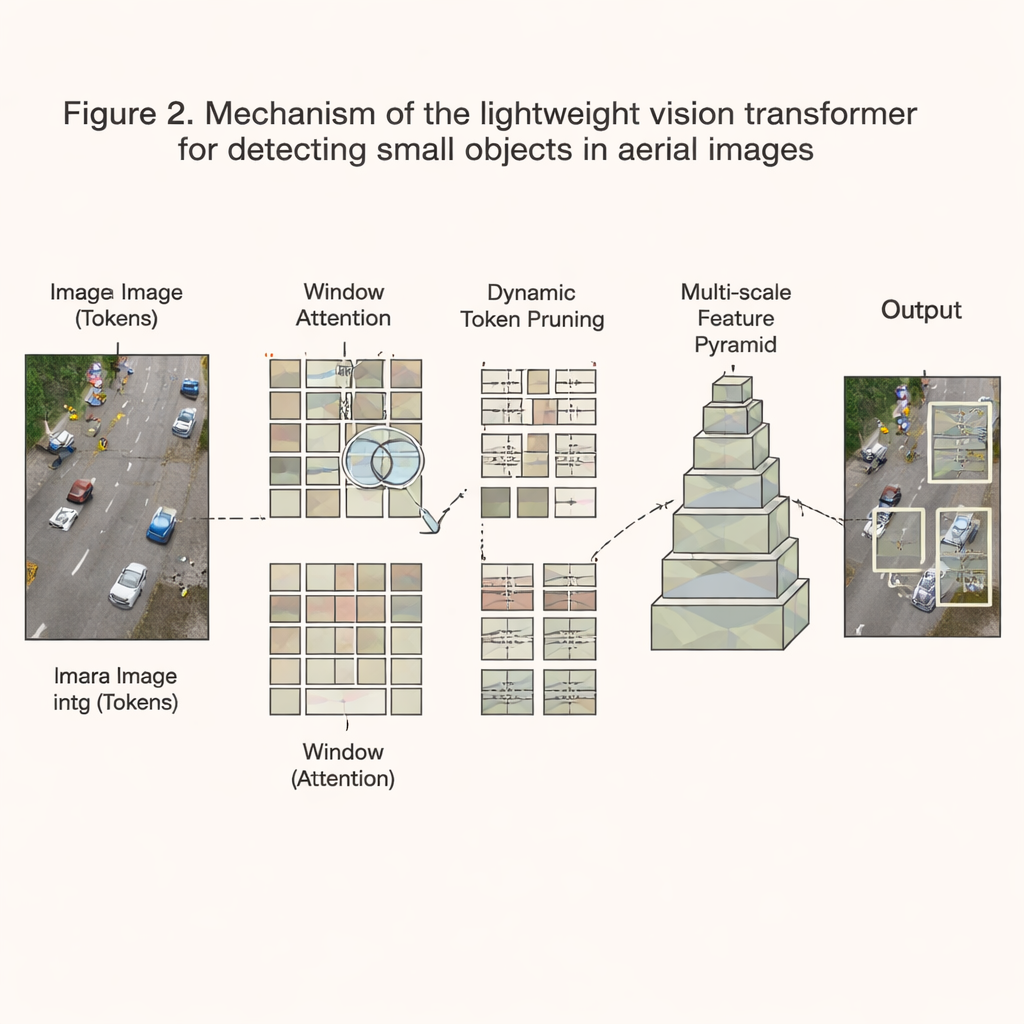

Pour rendre le transformer suffisamment petit et rapide, les auteurs repensent son fonctionnement interne. Plutôt que de laisser chaque partie de l'image se comparer à toutes les autres — un processus dont le coût explose avec la résolution — ils restreignent l'attention à des fenêtres locales qui glissent sur l'image, réduisant ainsi le coût computationnel à des niveaux maîtrisables. De plus, un schéma d'élagage dynamique évalue en continu quelles régions de l'image contiennent des informations utiles et quelles zones sont principalement du fond vide. Les tokens jugés peu informatifs sont éliminés tôt, économisant temps et mémoire, tandis que les scènes complexes et encombrées conservent plus de détails. Le modèle construit aussi une pyramide multi‑échelle de caractéristiques de sorte que les petits piétons et les véhicules plus grands puissent être détectés dans la même image. Combinées à une quantification soignée (utilisation de moins de bits par valeur), à l'élagage des canaux et à des optimisations logicielles bas niveau, ces modifications réduisent les calculs requis d'environ deux tiers tout en préservant plus de 94 % de la précision initiale.

Mise à l'épreuve du système

L'équipe évalue leur conception sur un vaste jeu de données aérien assemblé à partir de benchmarks publics pour drones et de milliers d'images nouvellement collectées au‑dessus de villes, de banlieues et de zones rurales à différentes saisons et conditions d'éclairage. Sur un ordinateur embarqué populaire utilisé dans les drones, le NVIDIA Jetson Xavier NX, leur système s'exécute à environ 39 images par seconde — suffisamment rapide pour une opération en temps réel — tout en atteignant une précision supérieure à celle de détecteurs légers largement utilisés, comme les variantes de YOLO. En particulier, il est nettement meilleur pour repérer les petits objets, avec un gain d'environ sept points de pourcentage en précision moyenne par rapport aux réseaux convolutionnels conventionnels. Des essais en conditions réelles d'une semaine sur une plateforme commerciale de drone montrent que le système maintient ses performances malgré les vibrations de la caméra, les variations d'illumination et la fluctuation de la connectivité sans fil, et qu'il peut passer en douceur des modes assistés par l'edge au tout embarqué lors de vols réels.

Ce que cela implique pour les missions de drones dans le monde réel

Concrètement, ce travail montre qu'il est possible d'offrir aux drones une vision plus nette et plus fiable sans leur attacher un ordinateur de type centre de données. En repensant le vision transformer pour le rendre plus léger, en se concentrant sélectivement sur les parties les plus informatives de chaque image et en associant le drone à un serveur edge à proximité lorsque c'est possible, les auteurs proposent un détecteur qui voit davantage, commet moins d'impairs et fonctionne toujours en temps réel dans des contraintes strictes de puissance et de mémoire. Cela rend des tâches comme les recherches et sauvetages, l'évaluation des catastrophes et l'inspection des infrastructures plus sûres et plus efficaces, car les drones peuvent mieux repérer de petits détails critiques — comme une personne en détresse ou un câble endommagé — exactement quand chaque seconde compte.

Citation: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Mots-clés: drones, détection d'objets, edge computing, vision transformer, imagerie en temps réel