Clear Sky Science · fr

Automatisation de la sécurité industrielle en temps réel utilisant les architectures YOLO exploitant divers domaines chromatiques

Des yeux plus intelligents sur le plancher de l’usine

Des défauts cachés dans des soudures métalliques peuvent transformer des machines robustes, des ponts ou des pipelines en dangers silencieux. Traditionnellement, des inspecteurs qualifiés scrutent les soudures brillantes à la recherche de petites fissures ou cavités avant qu’elles ne causent des accidents. Cet article explore comment l’intelligence artificielle peut prendre en charge une grande partie de cette surveillance, en utilisant un logiciel de reconnaissance d’images rapide pour examiner les soudures en temps réel, même lorsque les pièces défilent sur un convoyeur. En comparant plusieurs versions d’un détecteur IA populaire nommé YOLO et en testant comment différentes représentations de la couleur affectent sa vision, les chercheurs indiquent une voie vers des usines plus sûres et plus efficaces.

Pourquoi repérer les mauvaises soudures est si difficile

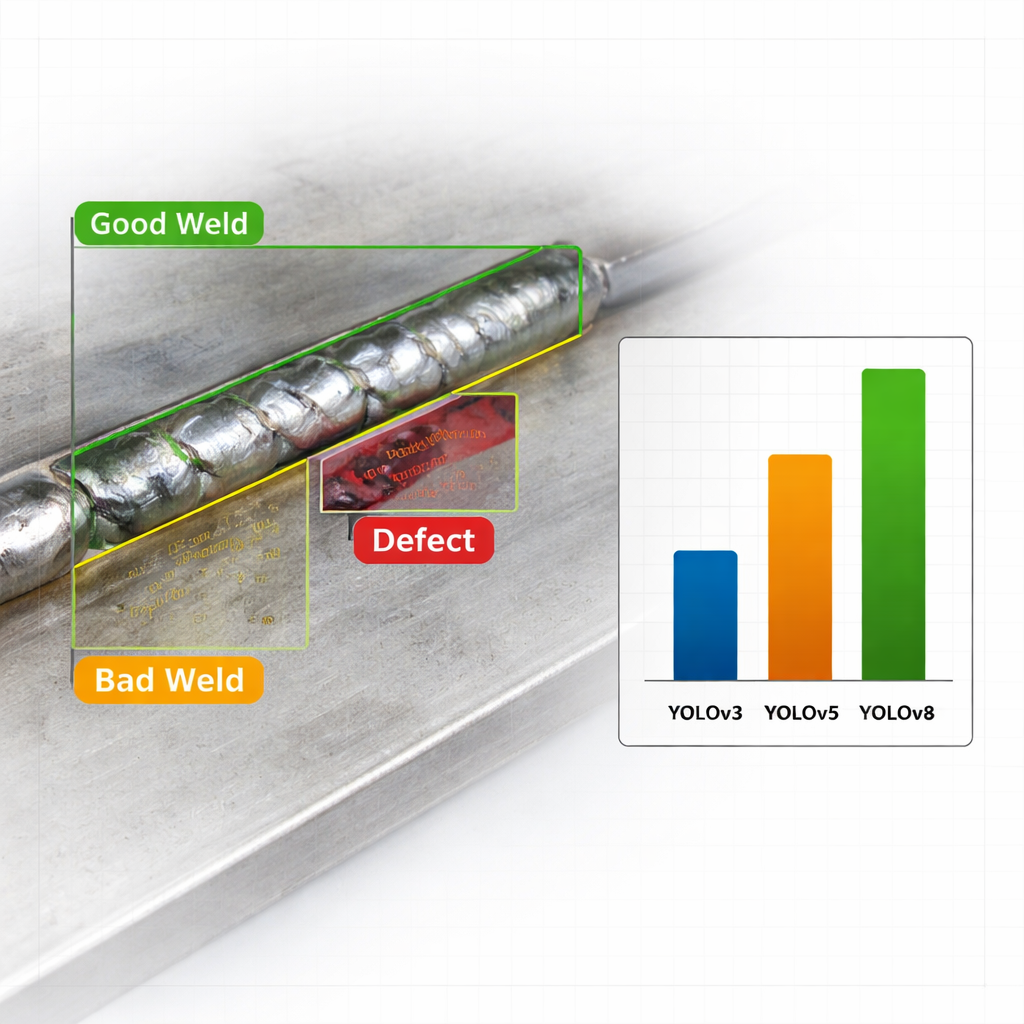

Sur une ligne de production chargée, les soudures varient en forme, en brillance et en bruit de fond. Une seule image peut contenir plusieurs soudures et défauts, ce qui rend la simple classification d’image (« bonne » ou « mauvaise » globalement) beaucoup trop grossière. Le système doit donc à la fois localiser et étiqueter des zones problématiques spécifiques le long d’un cordon. Les auteurs se concentrent sur trois catégories pratiques — soudure correcte, soudure défectueuse et défaut manifeste — car chacune appelle une réponse différente, de l’acceptation d’une pièce à la reprise immédiate. Ils utilisent un jeu de données public de plus de six mille images de soudures annotées, garantissant que l’IA est entraînée et testée sur une gamme réaliste de surfaces, conditions d’éclairage et types de défauts.

Apprendre aux machines à regarder une fois et décider

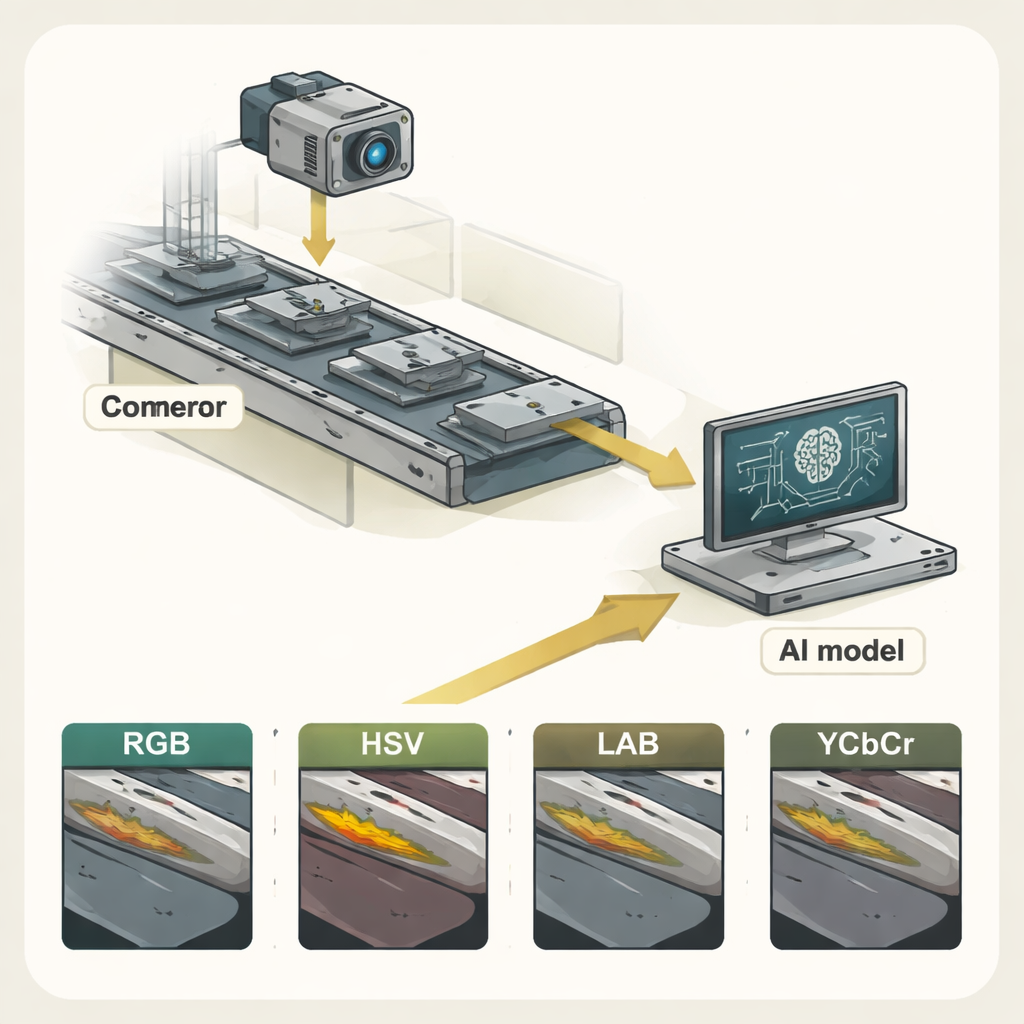

L’étude porte sur la famille de modèles de détection d’objets YOLO (« You Only Look Once »), réputée pour analyser une image en un seul passage et encadrer ce qu’elle trouve. Les chercheurs comparent trois générations : YOLOv3, YOLOv5 et le plus récent YOLOv8. Chaque version améliore la vitesse et la précision grâce à des réseaux plus profonds et des stratégies d’entraînement plus intelligentes. Pour mieux reproduire les défis d’éclairage des usines réelles, l’équipe transforme aussi chaque image de soudure en quatre espaces colorimétriques différents — RGB (le classique rouge–vert–bleu), HSV, LAB et YCbCr — et entraîne des modèles séparés sur chacun. Cette approche multispectrale leur permet de poser une question ciblée : changer la manière dont la couleur est codée aide-t-il l’IA à voir les défauts plus clairement ?

Couleur, vitesse et précision en action

À travers toutes les expériences, un constat est clair : le modèle le plus récent, YOLOv8, surpasse ses prédécesseurs. Lorsqu’il est entraîné sur des images RGB standard, YOLOv8 atteint une précision moyenne normalisée (mAP@0.5) de 0,592, sensiblement supérieure à celle de YOLOv3 et YOLOv5 dans les mêmes conditions. En termes pratiques, cela signifie qu’il est meilleur à la fois pour localiser et pour étiqueter correctement les zones de soudure. Le modèle est aussi extrêmement rapide, traitant environ 138 images par seconde sur une carte graphique moderne — bien au‑dessus des 30 images par seconde souvent considérées comme le seuil du temps réel. Parmi les espaces colorimétriques, le RGB offre systématiquement les meilleurs résultats pour les trois versions de YOLO, tandis que HSV, LAB et YCbCr sont en retrait. Ces codages alternatifs peuvent mettre en évidence certaines caractéristiques visuelles, mais dans ce contexte ils ne compensent pas la simplicité et la richesse d’information du RGB.

Des tests en laboratoire à l’edge de l’usine

Pour démontrer la faisabilité en conditions réelles, les auteurs déploient un modèle YOLOv8 alléger sur un dispositif edge basé sur Raspberry Pi connecté à un convoyeur et à une caméra. À mesure que les pièces soudées passent sous l’objectif, le système capture des images, les nettoie via un prétraitement basique et effectue la détection localement, classant chaque soudure comme correcte, défectueuse ou comportant un défaut. Les résultats sont consignés dans une base de données et affichés sur un tableau de bord pour les inspecteurs, qui peuvent voir des marqueurs de défauts en direct et suivre les tendances qualité à long terme. De plus, le cadre peut générer des recommandations, telles que suggérer des ajustements de vitesse ou de tension de soudage, ou signaler quand une maintenance pourrait être nécessaire en fonction de la récurrence des défauts.

Ce que cela signifie pour une fabrication plus sûre

Pour le grand public, le résultat clé est simple : ce travail montre qu’un modèle IA léger et moderne peut repérer de manière fiable et très rapide les soudures à risque en conditions industrielles réelles, notamment lorsqu’il utilise des images capturées en RGB ordinaires. YOLOv8 s’avère suffisamment précis pour distinguer clairement les soudures réellement défectueuses et suffisamment rapide pour suivre des lignes de production à grande vitesse, tout en tournant sur du matériel modeste proche des machines. Les auteurs soutiennent que ce type d’inspection automatisée, sensible à la couleur, peut réduire l’erreur humaine, détecter les problèmes plus tôt et soutenir une fabrication plus sûre et plus homogène. Des améliorations futures — comme des jeux de données d’entraînement plus riches et une meilleure gestion des types de défauts plus subtils — pourraient faire de ces inspecteurs numériques un élément courant de la sécurité industrielle.

Citation: Pati, N., Sharma, A., Gourisaria, M.K. et al. A real-time industrial safety automation using YOLO architectures leveraging diverse chromatic domains. Sci Rep 16, 7253 (2026). https://doi.org/10.1038/s41598-026-37869-1

Mots-clés: détection de défauts de soudure, automatisation de la sécurité industrielle, YOLOv8, vision par ordinateur en temps réel, IA en périphérie