Clear Sky Science · fr

Cadre d’apprentissage par renforcement adaptatif pour l’optimisation durable de micro-réseaux dans des environnements urbains arides

Maintenir les lumières allumées dans une ville du désert

Imaginez gérer une ville moderne où les journées d’été dépassent régulièrement 40 °C, où les climatiseurs tournent sans arrêt et où les lignes électriques peinent à suivre. C’est le quotidien dans des endroits comme Riyad, en Arabie Saoudite. Cet article examine comment un nouveau type de système de contrôle intelligent, inspiré des méthodes par lesquelles les ordinateurs apprennent à jouer à des jeux vidéo complexes, peut orchestrer les panneaux solaires, les éoliennes, les batteries, les générateurs diesel et le réseau principal pour alimenter une telle ville à moindre coût et avec moins de pollution.

Pourquoi les petits réseaux électriques comptent

Plutôt que de dépendre uniquement de grandes centrales lointaines, de nombreuses villes se tournent vers des « micro‑réseaux » — de petits réseaux locaux qui combinent différentes sources d’énergie et peuvent même échanger de l’électricité entre voisins. Dans les régions chaudes et sèches, cela prend une importance particulière : la demande de climatisation varie fortement selon la météo, l’énergie solaire arrive par à-coups pendant la journée et le vent peut être faible ou imprévisible. Les systèmes de contrôle traditionnels suivent souvent des règles fixes ou des horaires ; ils ne réagissent pas bien aux changements soudains, comme une hausse brutale de l’usage des climatiseurs ou une journée poussiéreuse qui masque le soleil. Le résultat est du gaspillage d’énergie propre, plus de carburant brûlé dans les générateurs diesel et des factures plus élevées.

Un cerveau apprenant pour le système électrique

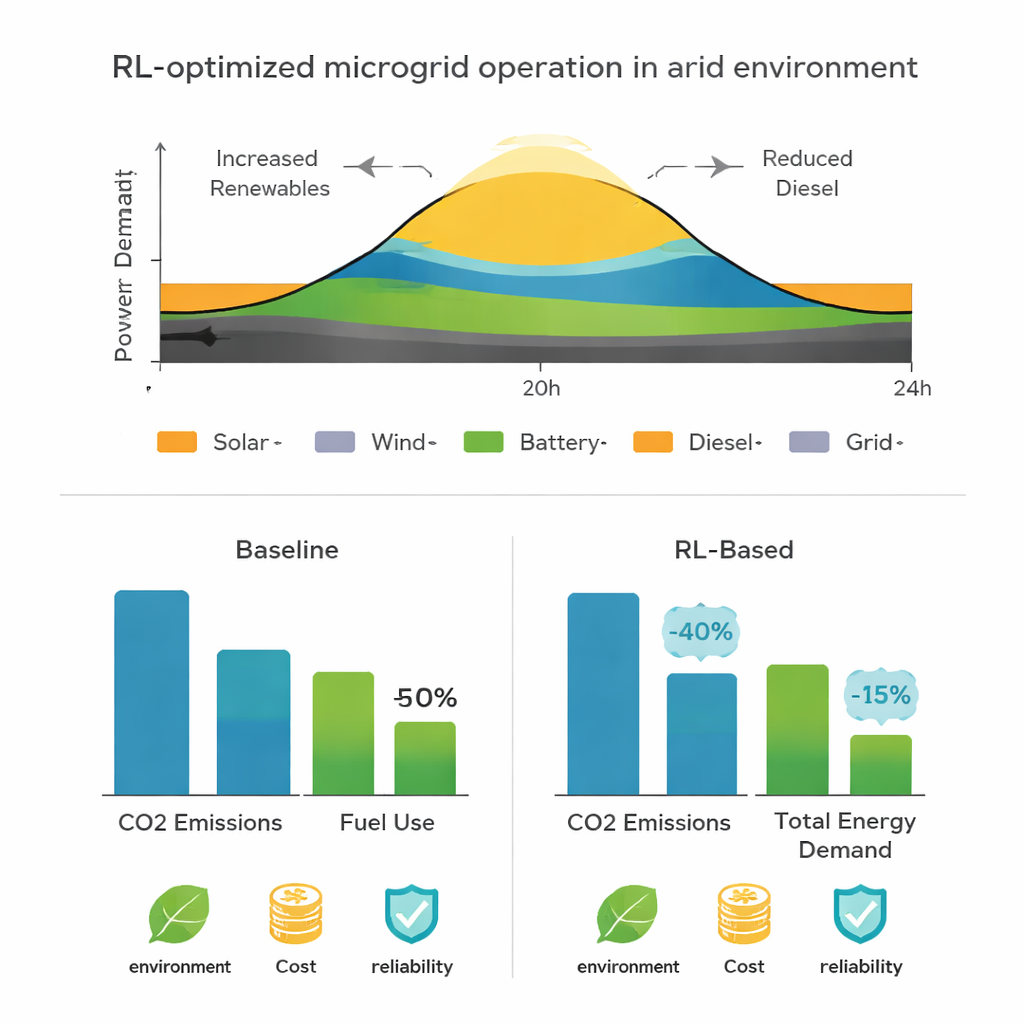

Les chercheurs ont construit un modèle informatique détaillé de cinq micro‑réseaux interconnectés représentant des bâtiments et quartiers types de Riyad — grandes et petites habitations, îlots à usage mixte et zones commerciales. Chaque micro‑réseau comprenait son propre mélange de panneaux solaires, petites éoliennes, secours diesel et stockage par batteries, ainsi qu’une liaison au réseau électrique plus large. À l’aide d’un logiciel de simulation énergétique des bâtiments (EnergyPlus), ils ont généré des données heure par heure sur une année complète : consommation électrique, température, ensoleillement et vitesse du vent. Par‑dessus cela, ils ont ajouté un « agent » d’apprentissage par renforcement — un cerveau logiciel qui observe l’état du système (demande, charge des batteries, ensoleillement et vent disponibles, état des générateurs) et décide des actions à entreprendre : charger ou décharger les batteries, mettre en marche ou arrêter les générateurs diesel, importer ou exporter de l’électricité, et partager l’énergie entre micro‑réseaux.

Comment le système apprend à faire de meilleurs choix

L’apprentissage par renforcement fonctionne par essais et erreurs. Dans la simulation, l’agent teste différentes actions de contrôle heure par heure et reçoit une récompense ou une pénalité selon le résultat. La récompense combine trois idées simples : maintenir les coûts bas, assurer l’alimentation électrique et éviter de gaspiller ou d’ignorer l’énergie renouvelable. Si ses décisions entraînent un usage coûteux de diesel, des pénuries ou de l’énergie solaire inutilisée, l’agent est pénalisé. S’il parvient à satisfaire la demande en utilisant davantage le soleil et le vent, avec moins d’émissions et un fonctionnement stable, il est récompensé. Au fil de dizaines de milliers d’épisodes d’entraînement, l’agent découvre progressivement des stratégies qui équilibrent ces objectifs. Une fois entraîné, il peut prendre des décisions en temps réel en seulement quelques millièmes de seconde.

Que se passe‑t‑il quand le désert riposte

Pour vérifier si cette approche aide réellement dans un climat difficile, l’équipe l’a testée dans des conditions réalistes et contraignantes. Le modèle a reproduit les variations saisonnières de Riyad, avec une forte demande de refroidissement en été et des charges plus douces en hiver. Le contrôleur basé sur l’apprentissage a suivi avec précision la consommation horaire et annuelle (expliquant environ 90–94 % de la variation), ce qui est crucial pour anticiper les pics. Il a réduit les pertes d’énergie sur une journée type et transféré davantage de l’approvisionnement vers le solaire et l’éolien, en utilisant des batteries pour lisser les creux. Lorsqu’ils ont simulé des événements comme une tempête de poussière réduisant soudainement le solaire ou une vague de chaleur augmentant fortement la demande, le système a répondu en déchargeant les batteries, en coordonnant l’usage des diesels et en partageant l’énergie excédentaire entre micro‑réseaux — le tout sans couper l’alimentation des usagers.

Air plus sain et factures allégées

Au‑delà du maintien de l’alimentation, l’étude a examiné l’impact environnemental via une analyse de cycle de vie centrée sur l’exploitation quotidienne. Comparé à une configuration traditionnelle fondée sur des règles, le système adaptatif a réduit les émissions de dioxyde de carbone d’environ 14 %, diminué la pollution acide d’environ 14 % et abaissé la consommation totale d’énergie d’environ 10 %. Ces gains proviennent principalement d’une utilisation moins fréquente des générateurs diesel et d’une meilleure exploitation des énergies renouvelables locales et du stockage. En termes simples, doter le micro‑réseau d’un cerveau apprenant lui a permis d’extraire davantage de travail utile de chaque unité d’énergie propre, de compter moins sur le carburant et de rester fiable même lorsque le climat désertique se dérègle.

Citation: Mohamed, M.A.S., Almazam, K., Alzahrani, M. et al. Adaptive reinforcement learning framework for sustainable microgrid optimization in arid urban environments. Sci Rep 16, 7356 (2026). https://doi.org/10.1038/s41598-026-37752-z

Mots-clés: micro-réseaux, apprentissage par renforcement, énergie renouvelable, gestion de l’énergie, villes arides