Clear Sky Science · fr

Une approche par apprentissage profond pour une IA émotionnellement intelligente améliorant les résultats d’apprentissage

Pourquoi les émotions comptent pour l’apprentissage

Quiconque a essayé d’étudier en étant stressé ou ennuyé sait que les émotions peuvent faire ou défaire l’apprentissage. Pourtant, la plupart des logiciels éducatifs traitent encore les élèves comme des cerveaux désincarnés, ne s’adaptant qu’aux réponses justes ou fausses. Cet article explore un nouveau type de tuteur IA émotionnellement intelligent — capable de percevoir l’état émotionnel d’un apprenant à partir de son visage, de sa voix et de ses mots, et d’utiliser cette information pour le maintenir motivé, soutenu et sur la bonne voie.

Des notes d’examen aux sentiments réels

Les systèmes d’IA éducatifs traditionnels se concentrent presque entièrement sur les données cognitives : combien de questions un étudiant réussit, la rapidité de ses réponses, ou les sujets où il échoue. La recherche montre cependant que la curiosité, la frustration, l’anxiété et la satisfaction influencent fortement l’attention, la mémoire et la persévérance. Ignorer ces sentiments peut conduire un système à augmenter la difficulté au moment où l’élève est sur le point d’abandonner, ou à offrir des encouragements joviaux alors que l’apprenant est en réalité confus. Les auteurs soutiennent qu’un logiciel de tutorat efficace doit lire et répondre à la fois à ce que les étudiants savent et à ce qu’ils ressentent.

Apprendre à l’ordinateur à lire les visages, les voix et les mots

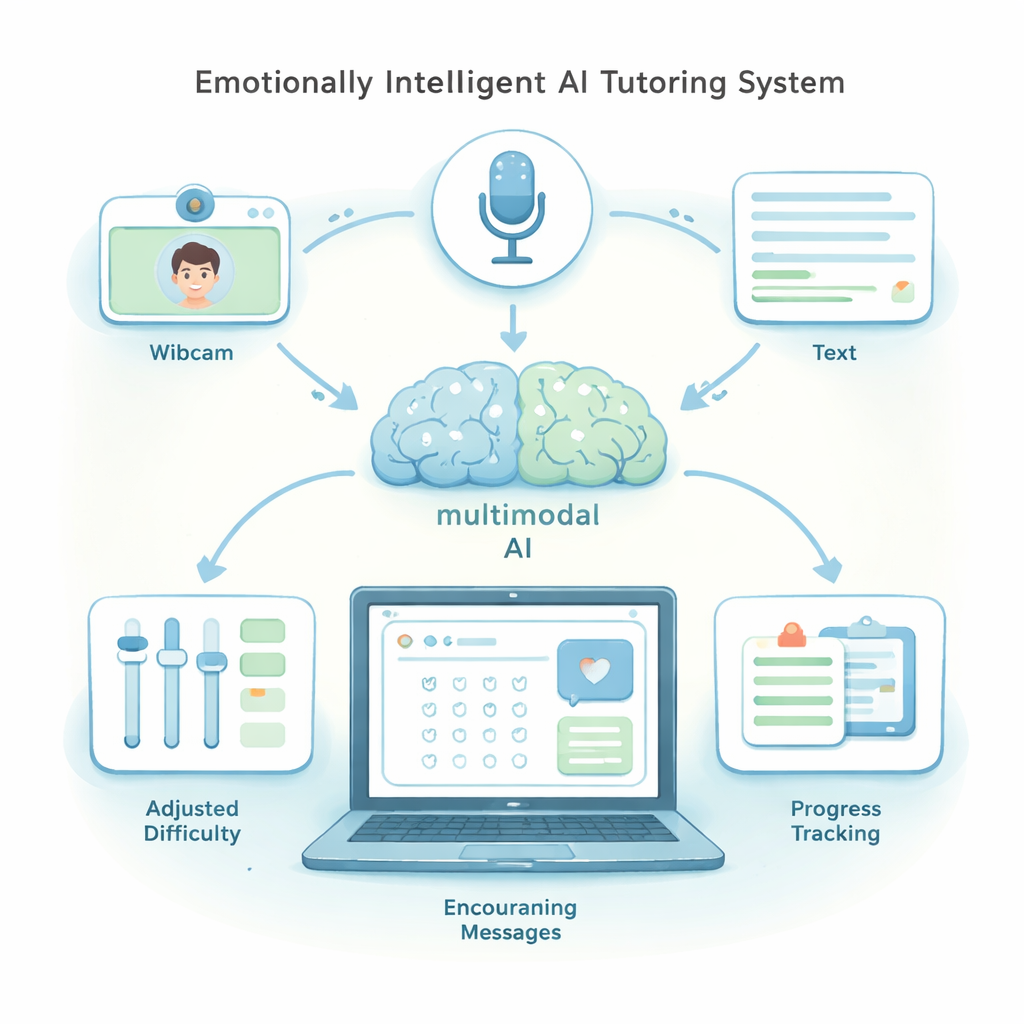

Pour construire un tuteur sensible aux émotions, les chercheurs ont combiné trois flux d’information. D’abord, ils ont utilisé une grande collection d’images de visages annotés par émotion pour entraîner un modèle visuel à repérer des signaux comme les sourires, les froncements de sourcils et les sourcils levés. Ensuite, ils se sont appuyés sur une base de données de parole constituée de conversations jouées et étiquetées par émotions telles que la colère, la joie et la déception, permettant à un modèle audio de capter des indices dans le ton, la hauteur et le rythme de la parole. Enfin, ils ont entraîné un modèle de langage sur des transcriptions textuelles pour qu’il détecte si des commentaires écrits ou des réponses semblent confiants, frustrés ou neutres. Chacun de ces composants transforme des images, des sons ou des mots bruts en une « empreinte émotionnelle » compacte.

Comment le système combine les signaux en une humeur unique

Conscients qu’aucun canal à lui seul ne raconte toute l’histoire, l’équipe a utilisé une méthode d’apprentissage profond basée sur les graphes pour fusionner les trois empreintes. En termes simples, le système traite chaque modalité — visage, voix et texte — comme un nœud connecté dans un réseau. Pendant l’entraînement, le réseau apprend comment ces éléments se rapportent typiquement : par exemple, si une voix tendue apparaît souvent avec une expression faciale sérieuse, ou si un langage optimiste peut compenser un air fatigué. En faisant circuler des messages le long de ces connexions, le modèle parvient à une estimation conjointe de l’état émotionnel de l’étudiant, même lorsqu’une source d’information est bruyante ou manquante. Cette estimation fusionnée pilote ensuite les réponses du tuteur, comme ralentir le rythme, proposer des indices ou ajouter des encouragements.

Une IA sensible aux émotions aide‑t‑elle vraiment les étudiants ?

Les chercheurs ont évalué leur système sur des jeux de données émotionnels standard et l’ont comparé à des modèles plus conventionnels n’utilisant que des images, que de l’audio, ou des méthodes simples de fusion des deux. Pour des émotions telles que la joie, la tristesse, la colère et la neutralité, le nouveau cadre était plus précis et mieux équilibré — en particulier pour les humeurs positives et neutres importantes pour un apprentissage soutenu. Dans des études utilisateurs reproduisant des sessions d’apprentissage, les étudiants ont rapporté que le système sensible aux émotions semblait plus soutenant et réactif. Des résultats mesurables confirment cela : les apprenants sont restés engagés plus longtemps, ont mieux régulé les émotions négatives et ont achevé plus de tâches que ceux utilisant des outils d’IA centrés uniquement sur le cognitif.

Promesses, pièges et perspectives

Parce que les données émotionnelles sont sensibles, les auteurs accordent une attention importante à l’éthique. Ils insistent sur la nécessité d’un consentement éclairé, de protections strictes de la vie privée et de garde‑fous contre les biais entre cultures et tranches d’âge. En regardant vers l’avenir, ils imaginent des systèmes en classe capables de percevoir des sentiments subtils, de fonctionner en temps réel et de se connecter à des outils tels que des tuteurs intelligents ou des leçons en réalité virtuelle. Pour le non‑spécialiste, la conclusion est simple : en prêtant attention non seulement aux réponses mais aussi aux expressions, au ton et au choix des mots, les tuteurs IA peuvent se comporter moins comme des machines à noter et davantage comme des enseignants humains réfléchis — aidant les élèves à mieux apprendre en comprenant ce qu’ils ressentent pendant qu’ils apprennent.

Citation: Wu, X., Lee, T., Lilhore, U.K. et al. A deep learning approach to emotionally intelligent AI for improved learning outcomes. Sci Rep 16, 7431 (2026). https://doi.org/10.1038/s41598-026-37750-1

Mots-clés: apprentissage sensible aux émotions, systèmes de tutorat IA, engagement des étudiants, reconnaissance multimodale des émotions, technologie éducative