Clear Sky Science · fr

Planification autonome de trajectoire pour l’imagerie échographique intercostale robotique utilisant l’apprentissage par renforcement

Des robots pour aider les médecins à voir entre les côtes

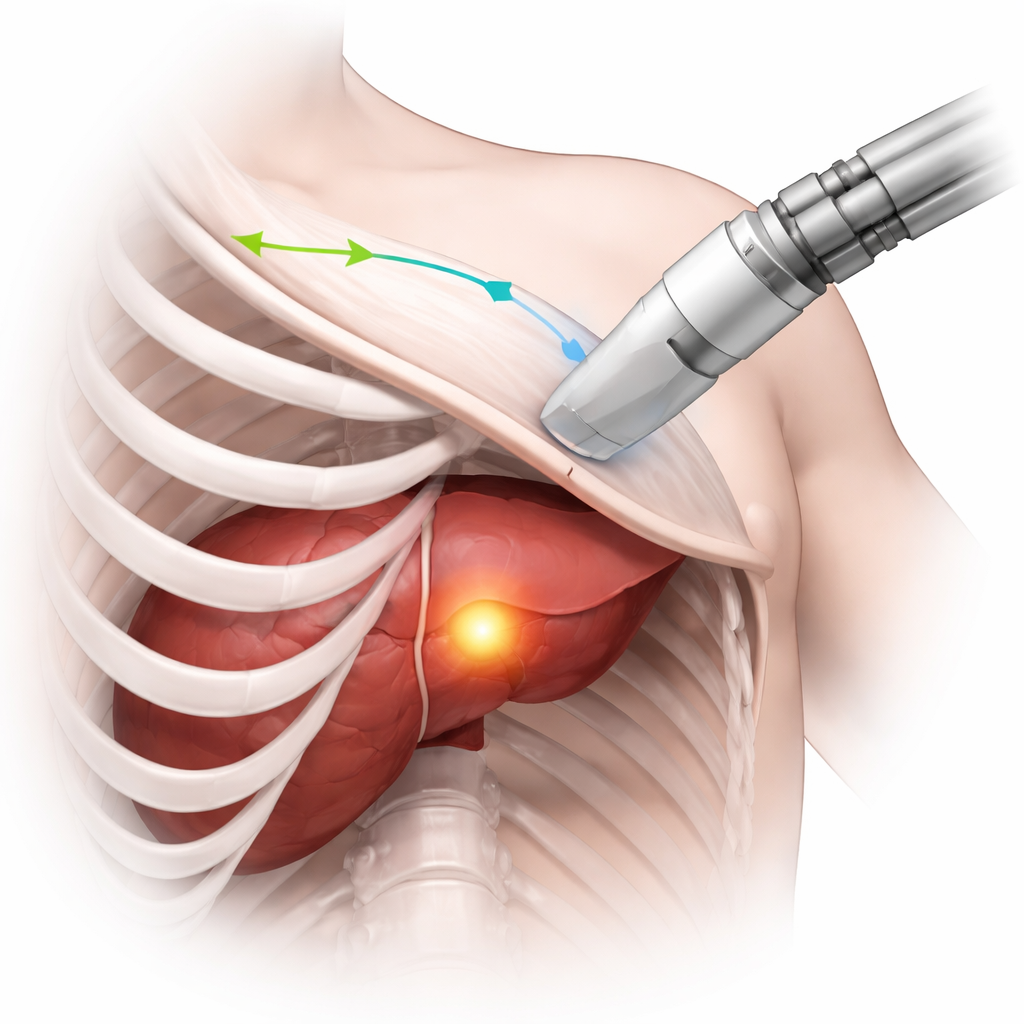

Lorsque les médecins utilisent l’échographie pour surveiller des organes comme le foie ou le cœur, les côtes gênent souvent la vue, projetant des ombres sombres qui cachent des détails cruciaux. Obtenir une image nette dépend fortement de l’adresse et de l’expérience de la personne qui tient la sonde. Cette étude examine comment un robot, guidé par l’intelligence artificielle, peut planifier automatiquement une trajectoire de balayage échographique entre les côtes afin que les tumeurs et autres cibles soient vues clairement et de manière reproductible, quel que soit l’opérateur.

Pourquoi voir entre les côtes est si difficile

L’échographie est courante parce qu’elle est sûre, abordable et fournit des images en temps réel. Mais pour imager des organes protégés par la cage thoracique, la sonde doit être maniée avec soin à travers les étroits intervalles entre les côtes. Si les ondes sonores rencontrent de l’os, elles sont bloquées, créant de larges régions noires dans l’image où rien n’est visible. Les opérateurs humains apprennent, par la formation et l’expérience, à incliner et déplacer la sonde pour éviter ces ombres tout en gardant la zone d’intérêt dans le champ. C’est particulièrement important lors de procédures comme l’ablation des tumeurs du foie, où les chirurgiens doivent vérifier à plusieurs reprises que la tumeur entière a été traitée. Le défi est de transformer cette compétence délicate en trois dimensions en une capacité que le robot peut exécuter de façon autonome.

Apprendre à un robot avec des patients virtuels

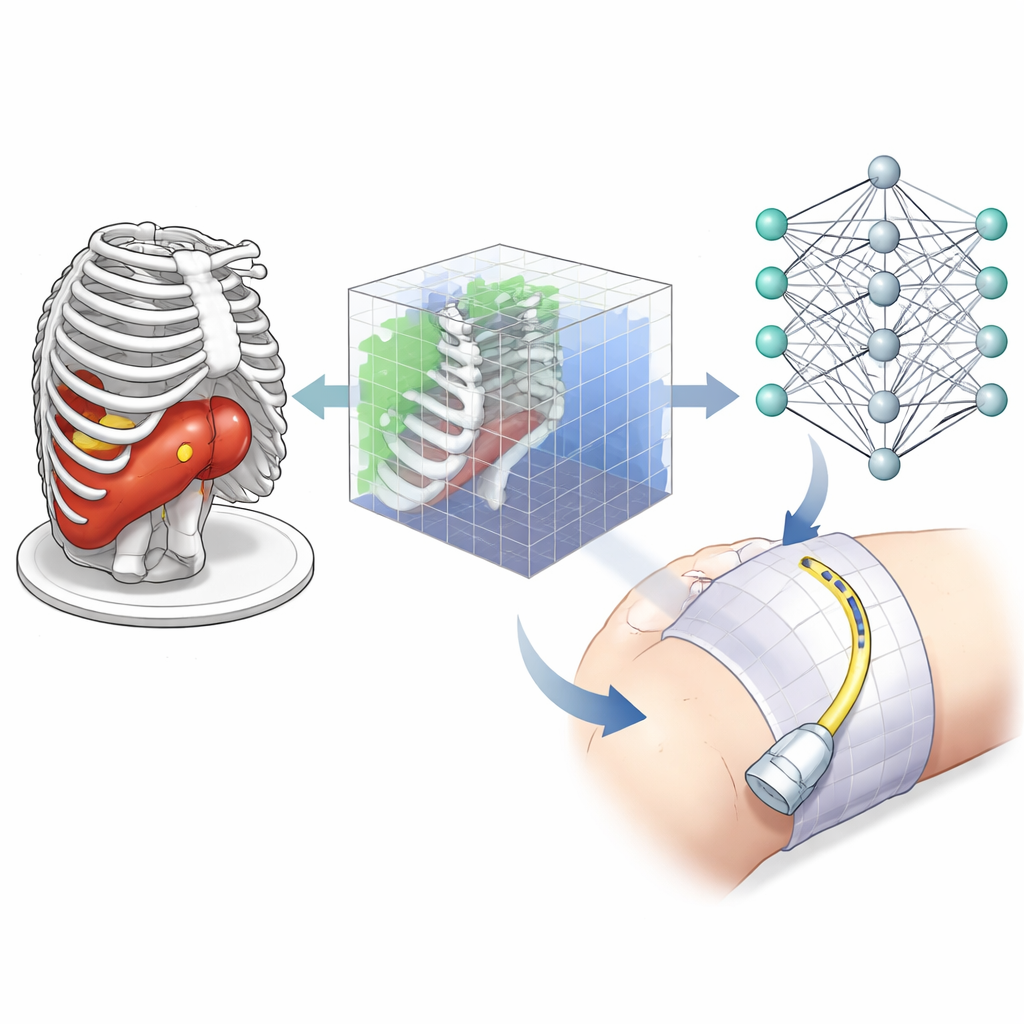

Plutôt que d’apprendre directement à partir d’images échographiques bruitées et variables, les chercheurs ont construit un terrain d’entraînement virtuel en utilisant des scanners de tomodensitométrie (CT). Le CT offre une carte tridimensionnelle nette des os, de la peau et du foie, et des tumeurs peuvent être ajoutées avec différentes formes et positions pour créer de nombreux scénarios réalistes. Dans ce simulateur, une sonde échographique virtuelle se déplace à la surface de la peau au-dessus des côtes, et les trajectoires des faisceaux ultrasonores sont modélisées comme des rayons qui traversent les tissus mous mais sont bloqués par l’os. Ce modèle simple mais réaliste indique au système quelles parties d’une tumeur sont visibles, dans quelle mesure le signal s’affaiblit en chemin et où apparaissent les ombres.

Comment le système d’apprentissage décide où balayer

L’équipe a utilisé une forme d’intelligence artificielle appelée apprentissage par renforcement, où un « agent » apprend par essais et erreurs à choisir des actions qui mènent à des récompenses plus élevées. À chaque étape, l’agent voit une représentation 3D compacte de la scène autour de la tumeur : quels mini-volumes contiennent la tumeur, quels autres contiennent de l’os, et lesquels sont traversés par les rayons ultrasonores simulés. Il peut alors déplacer ou incliner la sonde virtuelle par petits incréments, ou basculer entre un mode « exploration » et un mode « enregistrement » utilisé pour construire la vue 3D finale. La récompense qu’il reçoit combine trois objectifs : couvrir autant que possible le volume cible, maintenir la sonde suffisamment proche pour réduire la perte de signal, et éviter les régions où les rayons sont bloqués par l’os, ce qui créerait des images inutiles et ombrées.

Mettre la méthode à l’épreuve

Pour vérifier si la stratégie apprise se généralise au-delà des exemples d’entraînement, les chercheurs l’ont testée sur de nouveaux scans CT et de nouvelles formes de tumeur que l’agent n’avait jamais vues. Dans ces essais, un plan de balayage était considéré comme réussi si au moins 95 % du volume cible était imagé en un nombre limité d’étapes. Pour des cibles petites, moyennes et grandes, le système a atteint des taux de succès allant jusqu’à 95 %, tout en maintenant un pourcentage élevé de vues sans ombre et des distances raisonnables entre la sonde et la tumeur. La méthode a également fonctionné lorsqu’il y avait plusieurs cibles à couvrir, comme des foyers tumoraux résiduels disséminés dans le foie, bien que les performances aient naturellement légèrement diminué à mesure que la tâche devenait plus complexe.

De la simulation à la salle d’opération

Pour l’instant, le travail se concentre sur la planification de la trajectoire plutôt que sur le déplacement physique d’un robot réel. Les trajectoires sont générées sur des scans CT spécifiques au patient ou sur des « atlas » CT génériques qui peuvent ensuite être ajustés à l’anatomie d’un individu à l’aide de techniques d’alignement existantes. À l’avenir, ce module de planification devrait être combiné au contrôle robotique, à la compensation de mouvement due à la respiration et à une simulation d’images échographiques plus réaliste. Pour un non-spécialiste, l’essentiel est que cette approche pourrait rendre la surveillance échographique pendant des procédures comme le traitement des tumeurs du foie plus fiable et moins dépendante de l’expertise de l’opérateur, en permettant au robot de trouver des trajectoires intelligentes et sans ombre entre les côtes pour garder la cible entière dans le champ.

Citation: Bi, Y., Qian, C., Zhang, Z. et al. Autonomous path planning for intercostal robotic ultrasound imaging using reinforcement learning. Sci Rep 16, 6356 (2026). https://doi.org/10.1038/s41598-026-37702-9

Mots-clés: échographie robotique, apprentissage par renforcement, imagerie des tumeurs du foie, examen intercostal, robotique médicale