Clear Sky Science · fr

Algorithme de fusion d’images infrarouges et visibles basé sur la NSCT et une détection d’éclat FT améliorée

Voir dans l’obscurité et à travers l’encombrement

Les caméras modernes nous offrent des vues nettes et colorées du monde, mais elles peinent dans le brouillard, l’obscurité ou l’éblouissement — précisément quand nous avons le plus besoin d’une vision fiable pour la conduite, la surveillance, les secours ou les drones. Les capteurs infrarouges, qui captent la chaleur plutôt que la couleur, excellent dans ces conditions difficiles mais produisent des images floues et peu détaillées. Cet article présente une méthode pour combiner intelligemment les images infrarouges et visibles afin que l’image finale montre à la fois des détails nets et des personnes ou objets clairement mis en évidence, même dans des scènes difficiles.

Pourquoi deux yeux valent mieux qu’un

Les caméras en lumière visible enregistrent des textures fines et des arrière-plans riches, mais leurs performances s’effondrent la nuit ou dans de fortes ombres, et les cibles peuvent se confondre avec des environs de couleur similaire. Les caméras infrarouges font l’inverse : elles détectent les corps chauds et les objets émettant de la chaleur sur des arrière-plans sombres, de jour comme de nuit, mais perdent une grande partie de la structure subtile des bâtiments, arbres et routes. Fusionner ces deux types d’images en une seule peut, en principe, offrir le meilleur des deux mondes. Cependant, de nombreuses méthodes de fusion existantes soit atténuent le contraste, soit estompent les bords des objets, soit laissent des motifs infrarouges bruités dominer les détails utiles de l’image visible.

L’idée centrale : faire ressortir les parties importantes

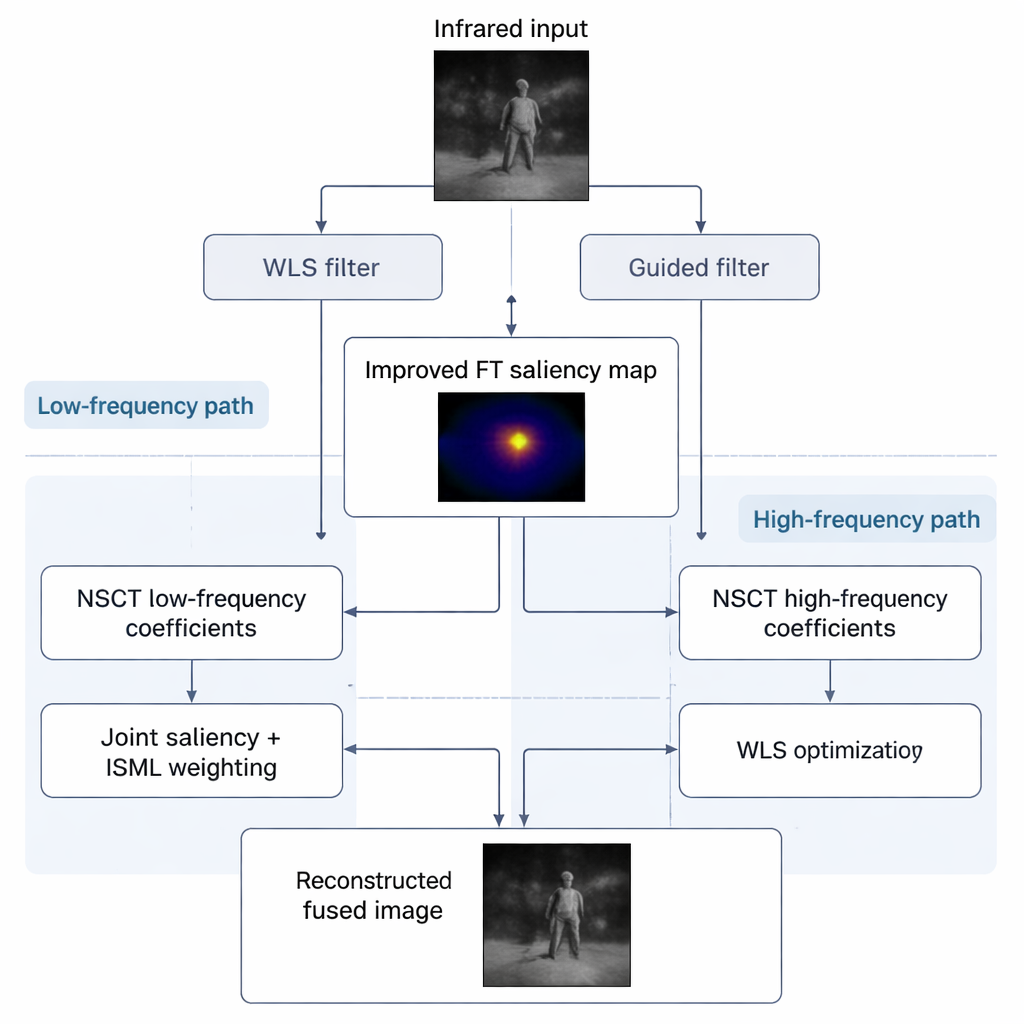

Les auteurs abordent la fusion comme un problème de résolution de conflits entre les deux types d’images. Ils se concentrent sur trois problèmes récurrents : deviner quelles régions sont réellement importantes (« saillantes »), équilibrer la luminosité globale entre les cibles chaudes en infrarouge et les arrière-plans lumineux en visible, et préserver les textures délicates tout en supprimant le bruit infrarouge. Pour ce faire, ils affinent une technique populaire appelée détection de saillance à syntonisation fréquentielle, qui tente d’imiter le système visuel humain en mettant en évidence les régions qui attirent naturellement l’attention. Au lieu de s’appuyer sur un simple flou, ils utilisent une paire de filtres plus sophistiqués — l’un qui lisse en conservant les bords, et l’autre qui améliore le contraste — pour obtenir une carte plus propre et plus nette des cibles infrarouges intéressantes.

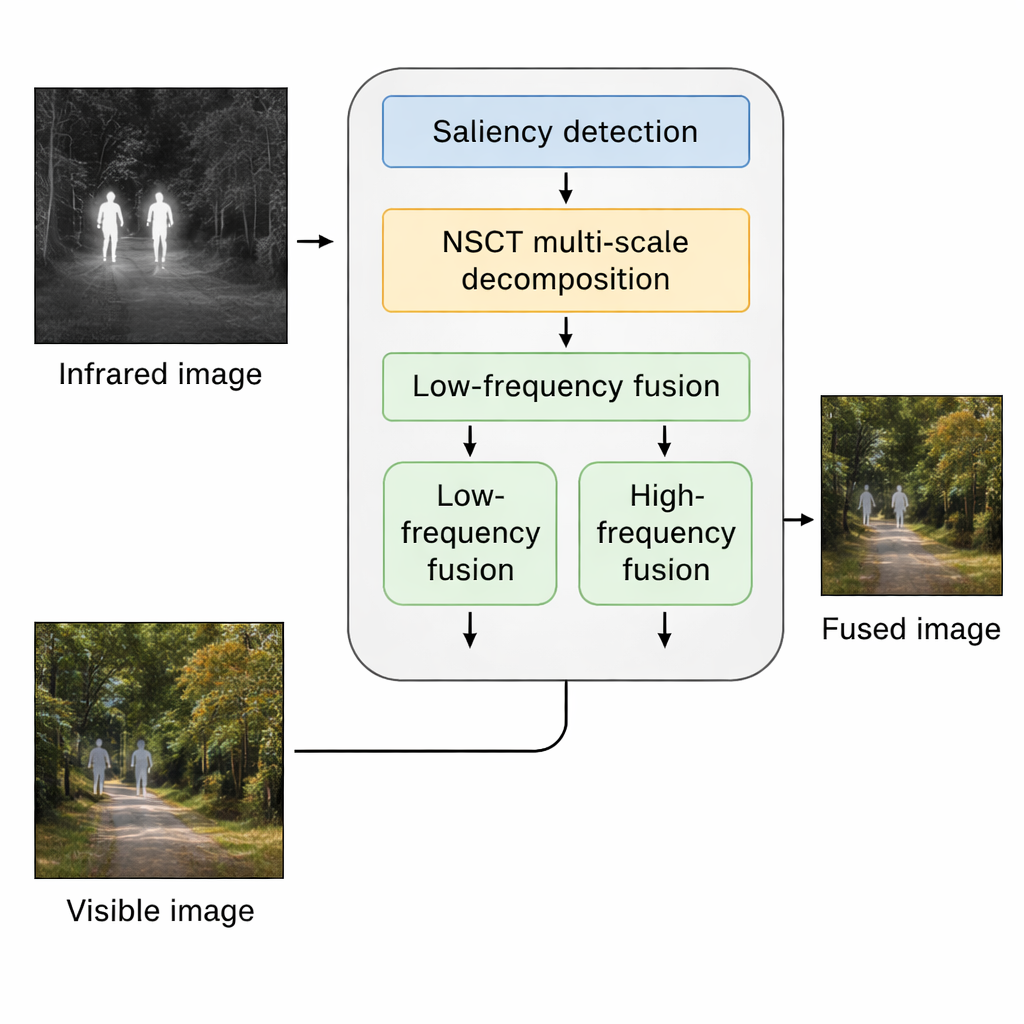

Dissocier formes grossières et détails fins

Une fois que l’algorithme sait où se situent les principales cibles infrarouges, il décompose les images infrarouges et visibles en couches séparant les structures grossières des détails fins à l’aide d’un outil mathématique appelé Transformée Contourlet Non Sous-échantillonnée (NSCT). Les couches basse fréquence contiennent les grands motifs de luminosité, comme le ciel, les routes ou les murs, tandis que les couches haute fréquence capturent les bords, textures et petites caractéristiques. Pour les couches grossières, la méthode mélange l’information en s’appuyant à la fois sur la carte de saillance infrarouge améliorée et sur une mesure basée sur le Laplacien de la netteté des structures locales. Cela permet d’éviter des images délavées où soit les objets chauds dominent la scène, soit l’arrière-plan visible étouffe les cibles importantes.

Conserver les textures nettes, maîtriser le bruit

Les couches haute fréquence exigent une stratégie différente, car elles contiennent à la fois les textures utiles et le bruit gênant. Ici, la méthode choisit d’abord, région par région, le capteur offrant le détail local le plus fort. Puis elle affine ce choix initial grâce à une procédure de moindres carrés pondérés qui favorise les textures visibles plus propres et plus informatives tout en laissant passer les motifs infrarouges significatifs. Le résultat est une image fusionnée où les branches d’arbres, les arêtes de bâtiments et les marquages routiers paraissent nets, tandis que les artefacts ponctués de l’infrarouge sont réduits.

De meilleures images, de meilleures décisions automatiques

L’équipe a testé son approche sur plusieurs jeux de données publics et sur ses propres images en faible luminosité, en la comparant aux techniques traditionnelles et aux méthodes modernes d’apprentissage profond. L’inspection humaine a montré que leurs images fusionnées présentaient des arrière-plans plus clairs, un contraste plus élevé et des cibles plus évidentes, notamment dans des couloirs sombres, des rues la nuit et des scènes extérieures encombrées. Les mesures objectives de contenu informationnel, de netteté et de contraste ont majoritairement favorisé la nouvelle méthode ou montré qu’elle était bien équilibrée selon les métriques. Surtout, lorsque ces images fusionnées ont été fournies à un système de détection d’objets populaire (YOLOv5s), la précision de détection, la précision et le rappel se sont tous améliorés de façon notable. En termes simples, l’algorithme ne se contente pas de produire des images plus agréables ; il aide aussi les systèmes automatisés à détecter personnes et objets de manière plus fiable. Cela suggère qu’une fusion plus intelligente des images infrarouges et visibles pourrait jouer un rôle clé dans une conduite autonome plus sûre, une surveillance plus efficace et des robots plus fiables en conditions d’obscurité ou dans des environnements visuellement complexes.

Citation: Fan, X., Kong, F., Shi, H. et al. Infrared and visible image fusion algorithm based on NSCT and improved FT saliency detection. Sci Rep 16, 7144 (2026). https://doi.org/10.1038/s41598-026-37670-0

Mots-clés: fusion infrarouge-visible, salience d’image, imagerie multi-capteur, vision nocturne, vision par ordinateur