Clear Sky Science · fr

Un cadre d'apprentissage profond explicable pour la détection de maladies des cultures en few-shot dans le riz et la canne à sucre via l'extraction de caractéristiques par CNN

Pourquoi repérer les feuilles malades est important

Le riz et la canne à sucre nourrissent des milliards de personnes et soutiennent de nombreuses communautés agricoles. Lorsque leurs feuilles sont atteintes par des maladies, des récoltes entières peuvent diminuer, les prix des aliments augmenter et les agriculteurs perdre leurs moyens de subsistance. Pourtant, le diagnostic précoce est difficile : les problèmes commencent souvent par de petites taches ou des changements de couleur que des agriculteurs occupés peuvent négliger, et les spécialistes ne sont pas toujours à proximité. Cette étude présente un système informatique capable d'apprendre à partir de seulement quelques photos de feuilles, de signaler automatiquement les maladies et même d'indiquer précisément ce dans l'image qui a motivé le diagnostic, aidant ainsi les agriculteurs à agir plus tôt et avec plus de confiance.

Des yeux intelligents pour le champ

Les chercheurs se concentrent sur deux cultures de base : le riz et la canne à sucre. Ils s'appuient sur deux collections d'images publiques de feuilles, l'une prise dans de véritables champs de canne à sucre avec de nombreux smartphones différents, et une plus petite, plus contrôlée, de photos de feuilles de riz. Chaque image montre soit une feuille saine soit une feuille atteinte d'une maladie spécifique, comme des taches brunes, des pustules couleur rouille ou des stries jaunes. En construisant sur ces jeux de données partagés plutôt que sur des collections privées, l'équipe vise des méthodes que d'autres groupes peuvent tester, réutiliser et, à terme, intégrer dans des outils agricoles réels allant d'applications pour smartphone à des capteurs connectés dans des champs intelligents.

Apprendre aux machines avec très peu d'exemples

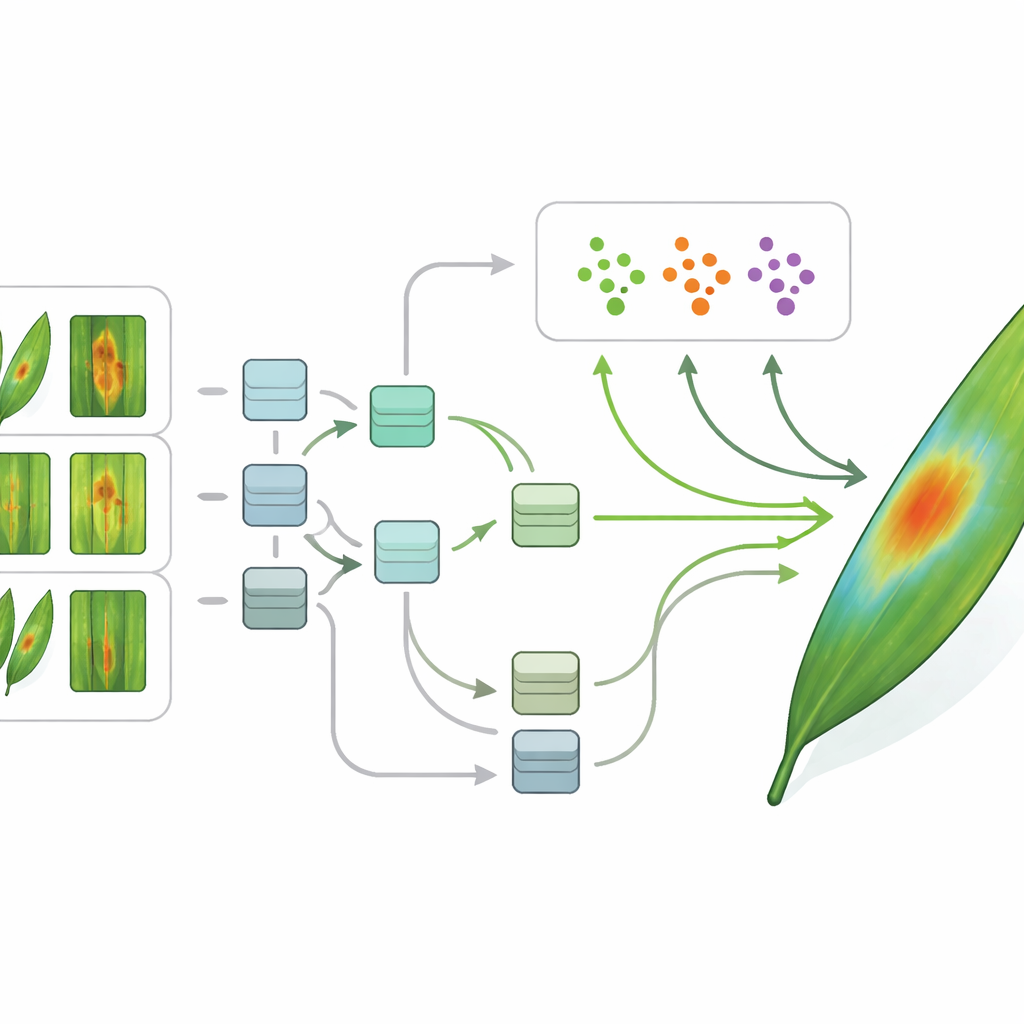

L'intelligence artificielle moderne peut être remarquablement performante pour reconnaître les maladies des plantes, mais elle exige généralement des milliers d'images étiquetées pour chaque condition — une exigence lourde en agriculture, surtout pour des foyers nouveaux ou rares. Pour contourner cet obstacle, les auteurs utilisent l'apprentissage « few-shot », une famille de techniques conçues pour apprendre à partir de seulement quelques exemples. Leur cadre commence par des étapes standard de traitement d'image : nettoyage, redimensionnement et normalisation de chaque photo afin que l'ordinateur voie une représentation cohérente. Un type de modèle d'apprentissage profond appelé réseau de neurones convolutionnels transforme ensuite chaque image de feuille en un ensemble compact de caractéristiques numériques qui capturent les formes, les couleurs et les textures pertinentes pour la maladie.

Rendre le diagnostic compréhensible

Par-dessus ces caractéristiques, l'équipe entraîne deux méthodes avancées few-shot appelées Prototypical Networks et Model-Agnostic Meta-Learning. L'une apprend une sorte de « centre » pour chaque maladie dans l'espace des caractéristiques et assigne les nouvelles feuilles au centre le plus proche ; l'autre apprend à s'adapter rapidement à de nouvelles tâches avec seulement quelques étapes d'entraînement. De manière cruciale, les auteurs combinent ces méthodes avec des outils d'IA explicable. À l'aide de techniques de type carte thermique, le système peut mettre en évidence quelles parties d'une image de feuille ont le plus influencé sa décision — un regroupement de taches sombres, une strie jaune le long de la nervure médiane, ou l'absence de lésions évidentes sur une plante saine. Cela rend le raisonnement du modèle visible, permettant aux agronomes de vérifier si l'ordinateur se concentre sur des signes pertinents sur le plan médical plutôt que sur des éléments de fond sans rapport.

Quels sont les résultats du système

Pour évaluer l'utilité réelle de leur approche, les chercheurs la comparent à plusieurs modèles d'apprentissage profond bien connus qui ont été utilisés pour la détection des maladies des plantes. Ils divisent chaque jeu de données en parties d'entraînement et de test et mesurent la fréquence à laquelle chaque méthode identifie correctement le type de maladie. Sur les feuilles de canne à sucre prises sur le terrain, le nouveau cadre atteint environ 92 % de classifications correctes, dépassant des architectures standard telles que VGG, ResNet, Xception et EfficientNet. Sur le jeu de données de riz, il est encore meilleur, identifiant correctement environ 98 % des images de test. Des outils statistiques qui examinent l'équilibre entre fausses alertes et cas manqués montrent que la nouvelle méthode se comporte comme un excellent dépisteur médical plutôt que comme un devineur aléatoire.

Ce que cela signifie pour les agriculteurs

En termes simples, l'étude montre qu'un ordinateur peut apprendre à détecter avec précision plusieurs maladies du riz et de la canne à sucre à partir d'un petit nombre d'images d'exemple, et qu'il peut aussi indiquer les taches et les stries sur la feuille qui ont motivé son verdict. Cette combinaison d'efficacité des données et de transparence est essentielle pour une utilisation sur le terrain : elle abaisse la barrière pour créer des outils pour de nouvelles cultures et des maladies émergentes, et elle fournit aux agriculteurs et aux experts des preuves visuelles auxquelles ils peuvent se fier. Avec des essais supplémentaires en conditions réelles et des interfaces utilisateurs plus conviviales, de tels systèmes explicables et few-shot pourraient devenir des partenaires quotidiens de l'agriculture intelligente, aidant à protéger les récoltes tout en réduisant l'utilisation inutile de pesticides.

Citation: El-Behery, H., Attia, AF. & Rezk, N.G. An explainable deep learning framework for few shot crop disease detection in rice and sugarcane using CNN based feature extraction. Sci Rep 16, 8272 (2026). https://doi.org/10.1038/s41598-026-37501-2

Mots-clés: détection des maladies des cultures, riz et canne à sucre, apprentissage profond, IA explicable, agriculture intelligente